mirror of

https://github.com/langgenius/dify-docs.git

synced 2026-03-27 13:28:32 +07:00

Feat: update redirect links

This commit is contained in:

10

en/guides/workflow/node/README.mdx

Normal file

10

en/guides/workflow/node/README.mdx

Normal file

@@ -0,0 +1,10 @@

|

||||

---

|

||||

title: Node Description

|

||||

---

|

||||

|

||||

|

||||

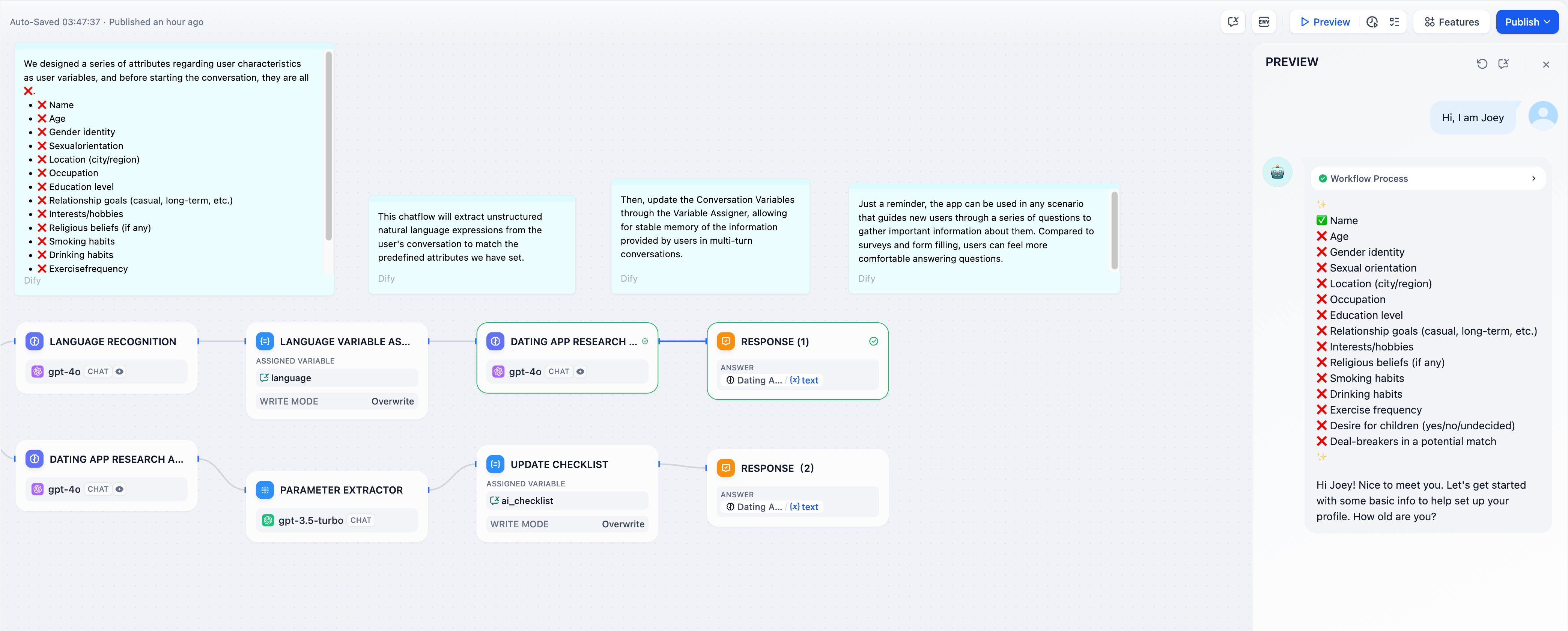

**Nodes are the key components of a workflow**, enabling the execution of a series of operations by connecting nodes with different functionalities.

|

||||

|

||||

### Core Nodes

|

||||

|

||||

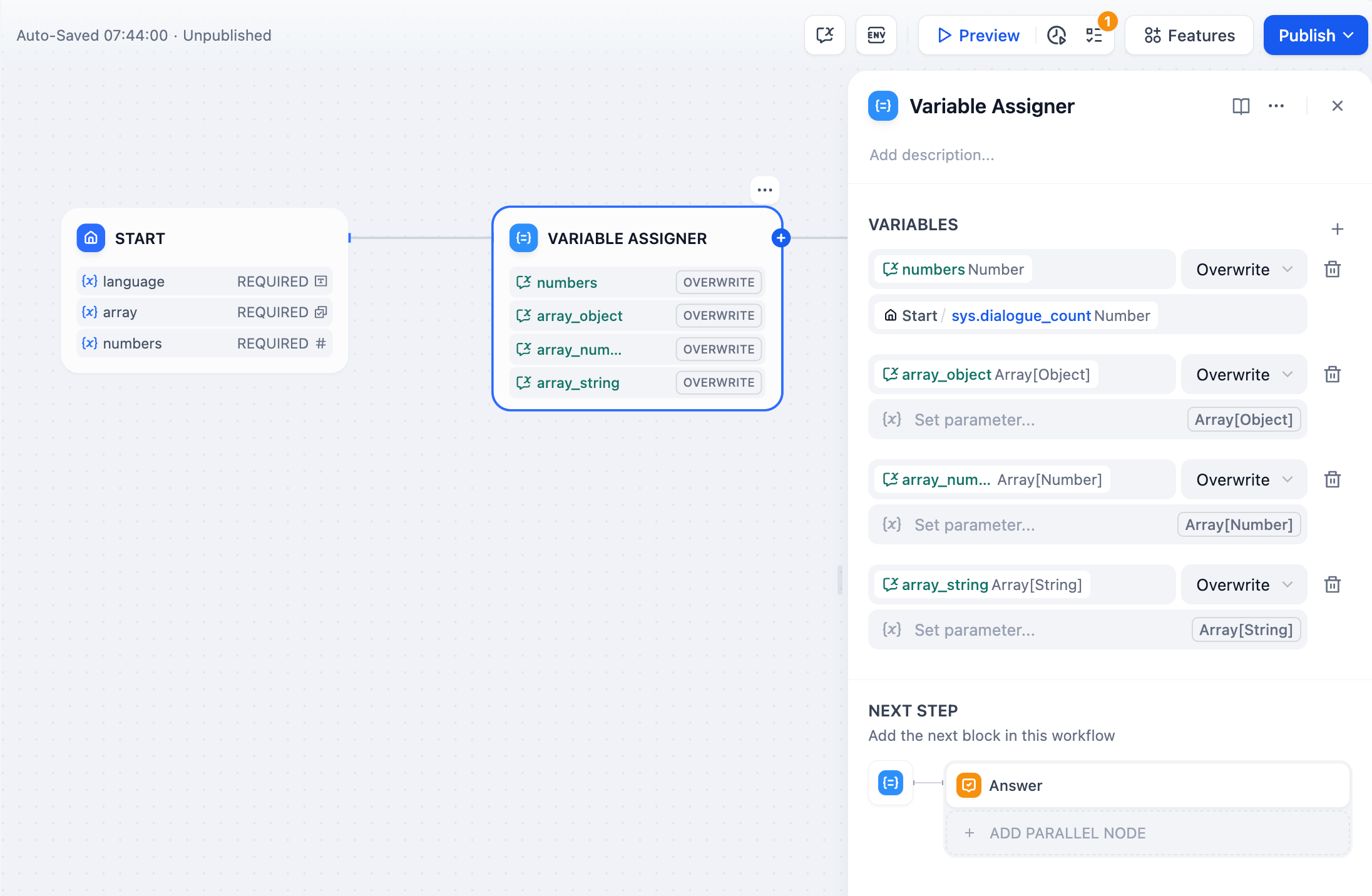

<table data-view="cards"><thead><tr><th></th><th></th><th></th></tr></thead><tbody><tr><td><a href="/en/guides/workflow/nodes/start"><strong>Start</strong></a></td><td>Defines the initial parameters for starting a workflow process.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/end"><strong>End</strong></a></td><td>Defines the final output content for ending a workflow process.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/answer"><strong>Answer</strong></a></td><td>Defines the response content in a Chatflow process.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/llm"><strong>Large Language Model (LLM)</strong></a></td><td>Calls a large language model to answer questions or process natural language.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/knowledge-retrieval"><strong>Knowledge Retrieval</strong></a></td><td>Retrieves text content related to user questions from a knowledge base, which can serve as context for downstream LLM nodes.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/question-classifier"><strong>Question Classifier</strong></a></td><td>By defining classification descriptions, the LLM can select the matching classification based on user input.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/ifelse"><strong>IF/ELSE</strong></a></td><td>Allows you to split the workflow into two branches based on if/else conditions.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/code"><strong>Code Execution</strong></a></td><td>Runs Python/NodeJS code to execute custom logic such as data transformation within the workflow.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/template"><strong>Template</strong></a></td><td>Enables flexible data transformation and text processing using Jinja2, a Python templating language.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/variable-aggregator"><strong>Variable Aggregator</strong></a></td><td>Aggregates variables from multiple branches into one variable for unified configuration of downstream nodes.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/variable-assigner"><strong>Variable Assigner</strong></a></td><td>The variable assigner node is used to assign values to writable variables.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/parameter-extractor"><strong>Parameter Extractor</strong></a></td><td>Uses LLM to infer and extract structured parameters from natural language for subsequent tool calls or HTTP requests.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/iteration"><strong>Iteration</strong></a></td><td>Executes multiple steps on list objects until all results are output.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/http-request"><strong>HTTP Request</strong></a></td><td>Allows sending server requests via the HTTP protocol, suitable for retrieving external results, webhooks, generating images, and other scenarios.</td><td></td></tr><tr><td><a href="/en/guides/workflow/nodes/tools"><strong>Tools</strong></a></td><td>Enables calling built-in Dify tools, custom tools, sub-workflows, and more within the workflow.</td><tr><td><a href="/en/guides/workflow/nodes/loop"><strong>Loop</strong></a></td><td>A Loop node executes repetitive tasks that depend on previous iteration results until exit conditions are met or the maximum loop count is reached.</td><td></td></tr></tbody></table>

|

||||

78

en/guides/workflow/node/agent.mdx

Normal file

78

en/guides/workflow/node/agent.mdx

Normal file

@@ -0,0 +1,78 @@

|

||||

---

|

||||

title: Agent

|

||||

---

|

||||

|

||||

|

||||

## Definition

|

||||

|

||||

An Agent Node is a component in Dify Chatflow/Workflow that enables autonomous tool invocation. By integrating different Agent reasoning strategies, LLMs can dynamically select and execute tools at runtime, thereby performing multi-step reasoning.

|

||||

|

||||

## Configuration Steps

|

||||

|

||||

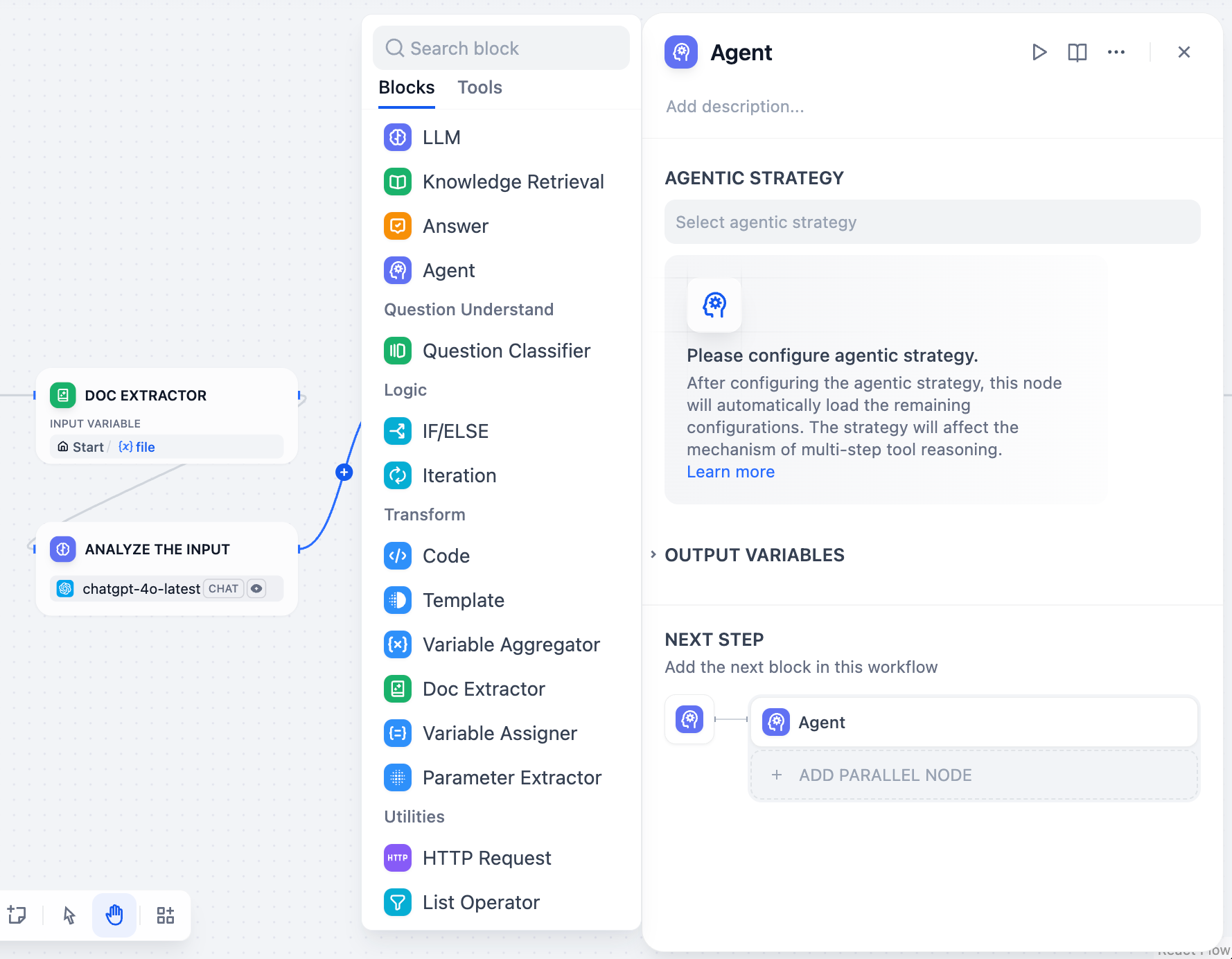

### Add the Node

|

||||

|

||||

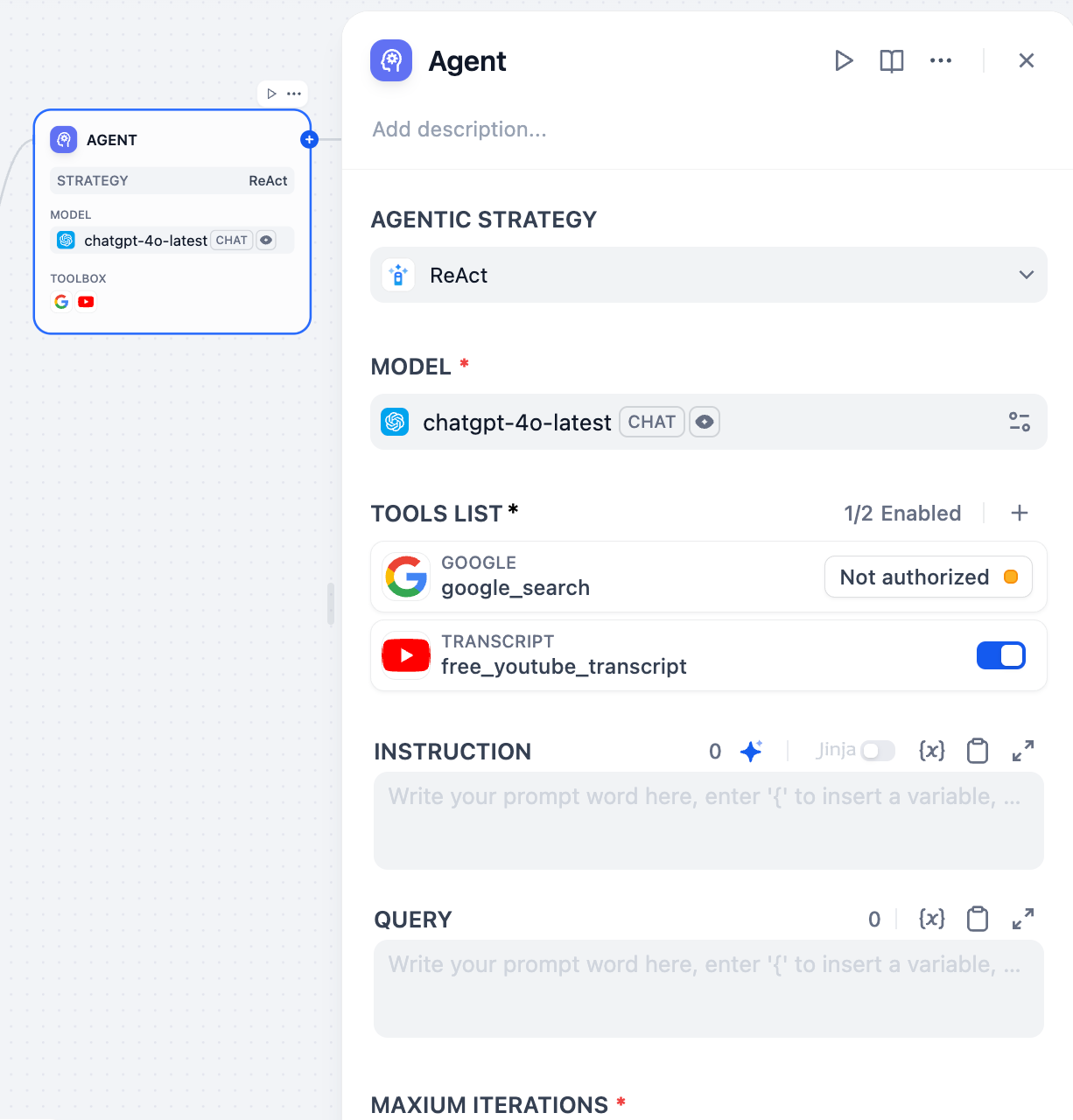

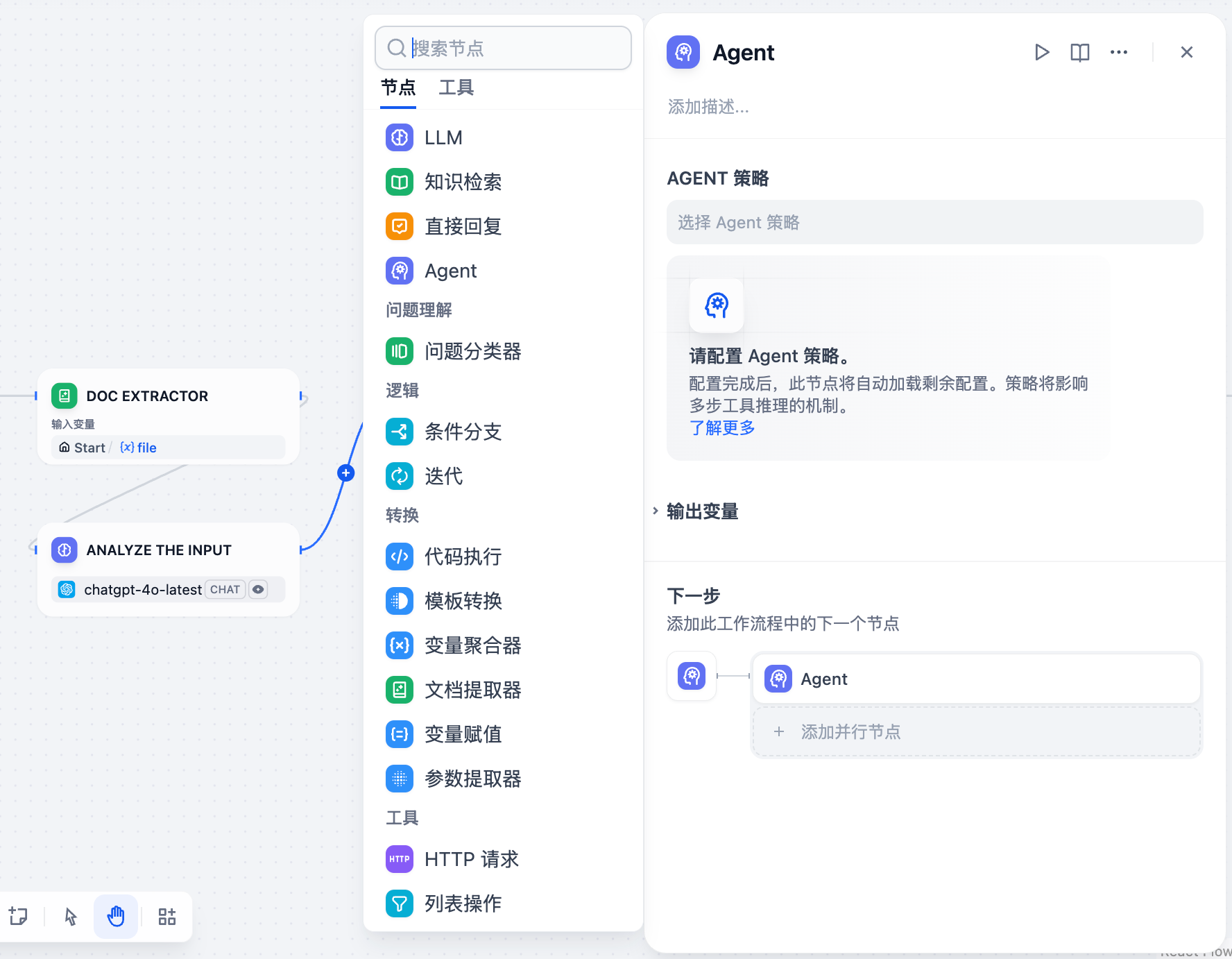

In the Dify Chatflow/Workflow editor, drag the Agent node from the components panel onto the canvas.

|

||||

|

||||

|

||||

|

||||

### Select an Agent Strategy

|

||||

|

||||

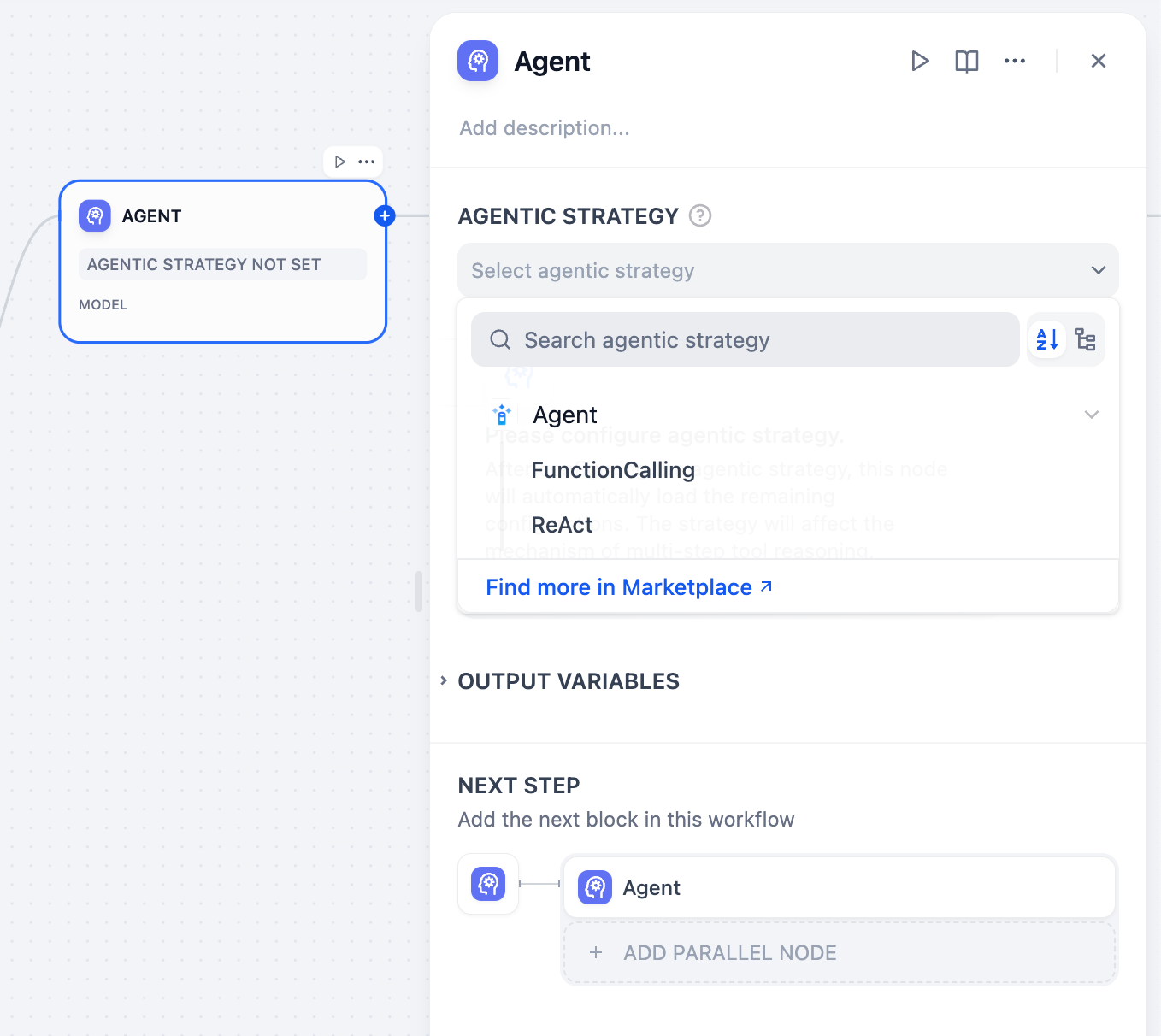

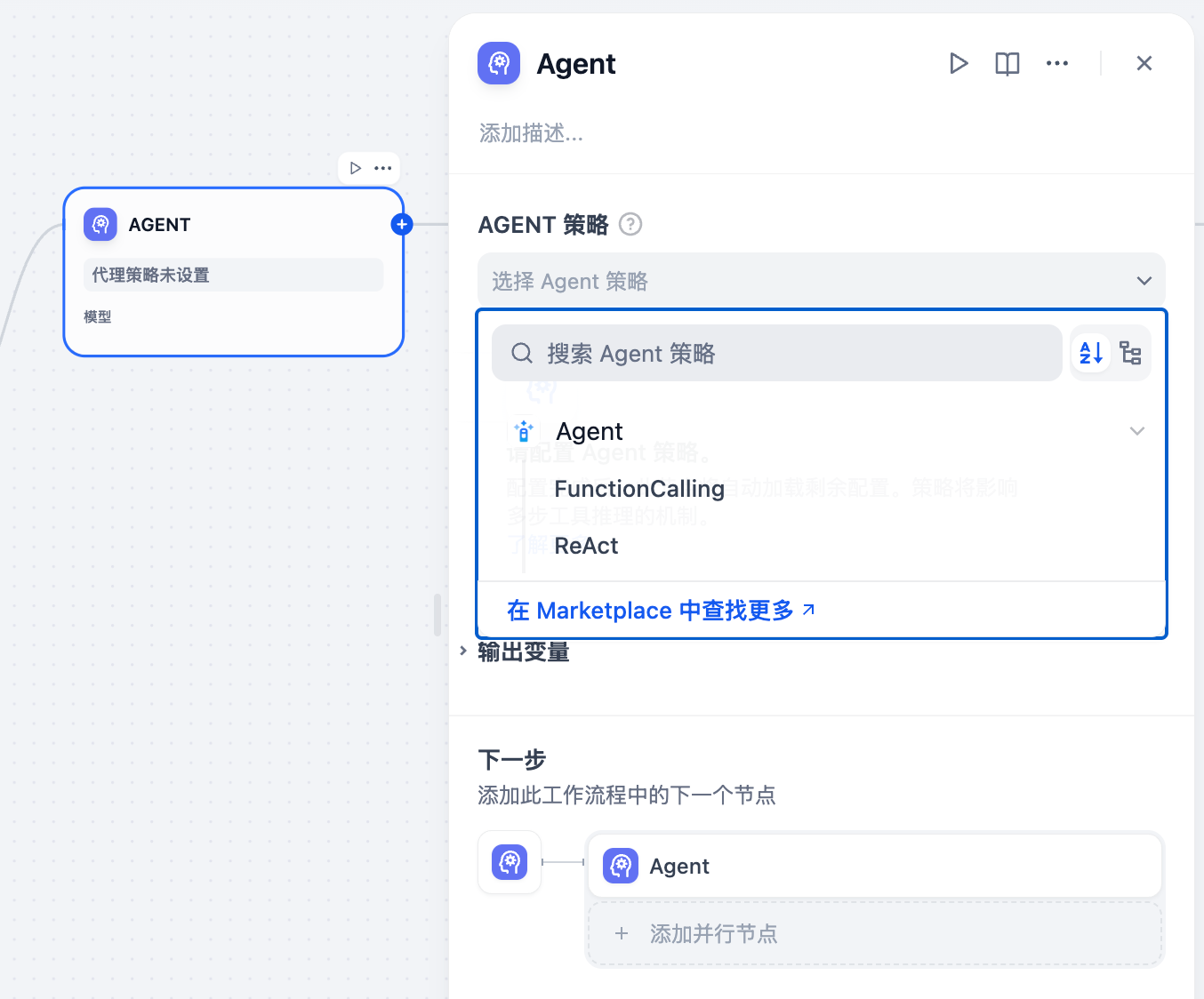

In the node configuration panel, click Agent Strategy.

|

||||

|

||||

|

||||

|

||||

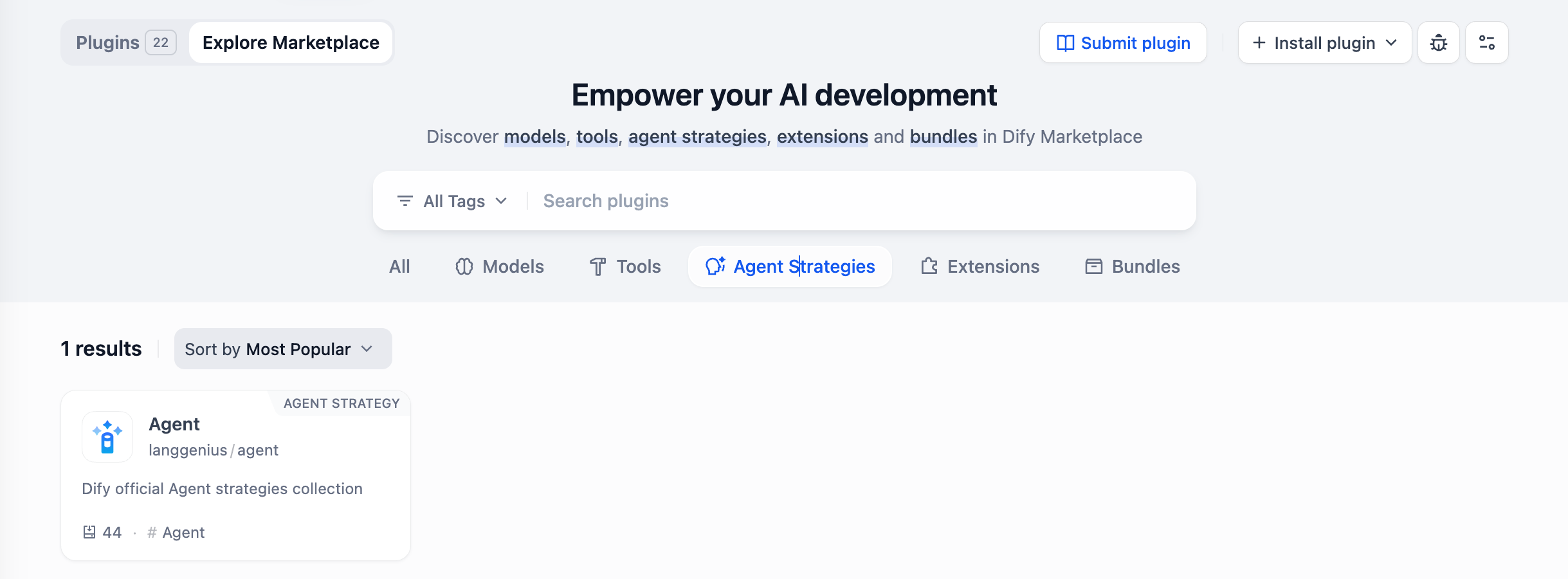

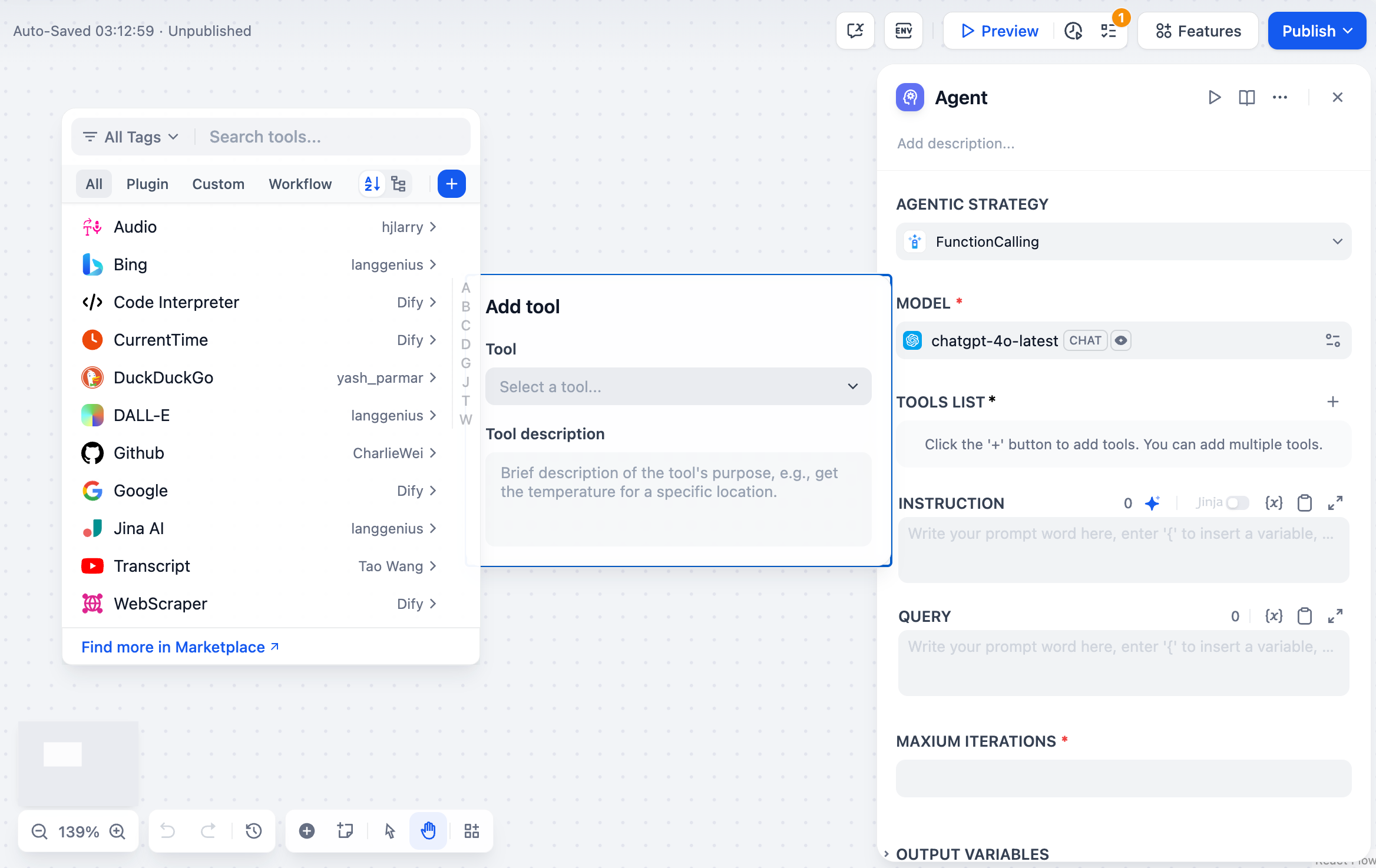

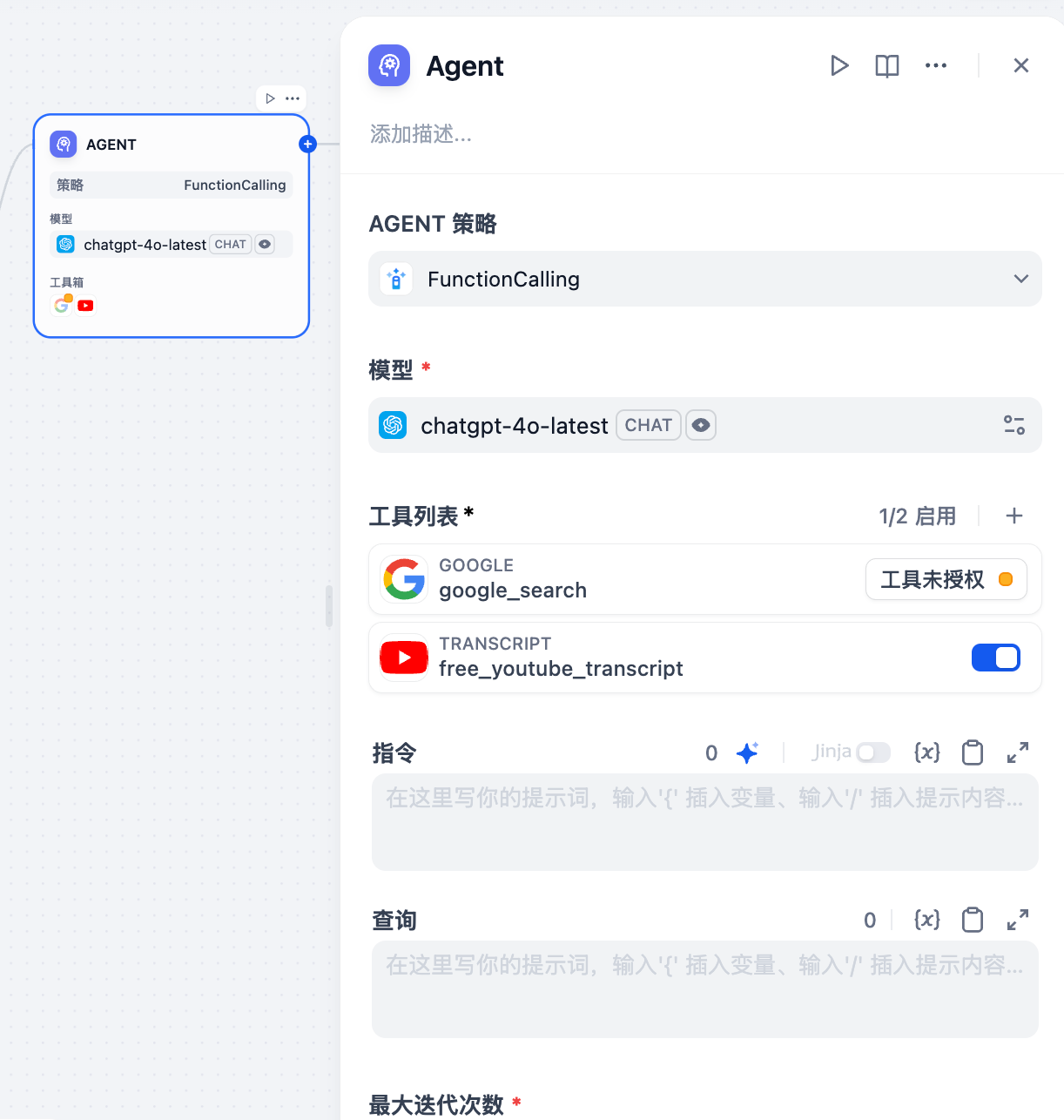

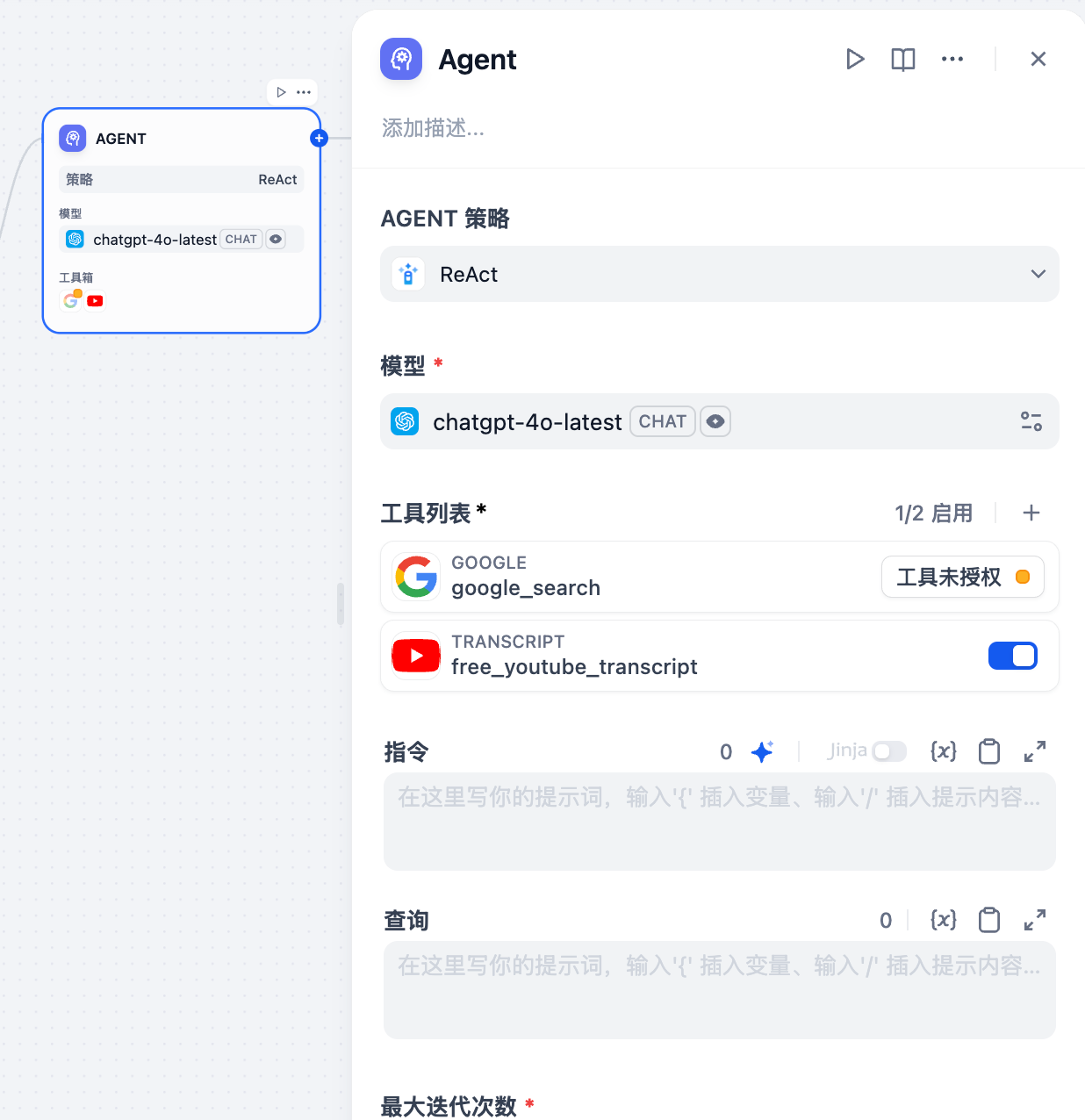

From the dropdown menu, select the desired Agent reasoning strategy. Dify provides two built-in strategies, **Function Calling and ReAct**, which can be installed from the **Marketplace → Agent Strategies category**.

|

||||

|

||||

|

||||

|

||||

#### 1. Function Calling

|

||||

|

||||

Function Calling maps user commands to predefined functions or tools. The LLM first identifies user intent, then decides which function to call and extracts the required parameters. Its core mechanism involves explicitly calling external functions or tools.

|

||||

|

||||

Pros:

|

||||

|

||||

**• Precision:** For well-defined tasks, it can call the corresponding tool directly without requiring complex reasoning.

|

||||

|

||||

**• Easier external feature integration:** Various external APIs or tools can be wrapped into functions for the model to call.

|

||||

|

||||

**• Structured output:** The model outputs structured information about function calls, facilitating processing by downstream nodes.

|

||||

|

||||

|

||||

|

||||

#### 2. ReAct (Reason + Act)

|

||||

|

||||

ReAct enables the Agent to alternate between reasoning and taking action: the LLM first thinks about the current state and goal, then selects and calls the appropriate tool. The tool’s output in turn informs the LLM’s next step of reasoning and action. This cycle continues until the problem is resolved.

|

||||

|

||||

Pros:

|

||||

|

||||

**• Effective external information use:** It can leverage external tools to retrieve information and handle tasks that the model alone cannot accomplish.

|

||||

|

||||

**• Improved explainability:** Because reasoning and actions are interwoven, there is a certain level of traceability in the Agent’s thought process.

|

||||

|

||||

**• Wide applicability:** Suitable for scenarios that require external knowledge or need to perform specific actions, such as Q\&A, information retrieval, and task execution.

|

||||

|

||||

|

||||

|

||||

Developers can contribute Agent strategy plugins to the public [repository](https://github.com/langgenius/dify-plugins). After review, these plugins will be listed in the Marketplace for others to install.

|

||||

|

||||

### Configure Node Parameters

|

||||

|

||||

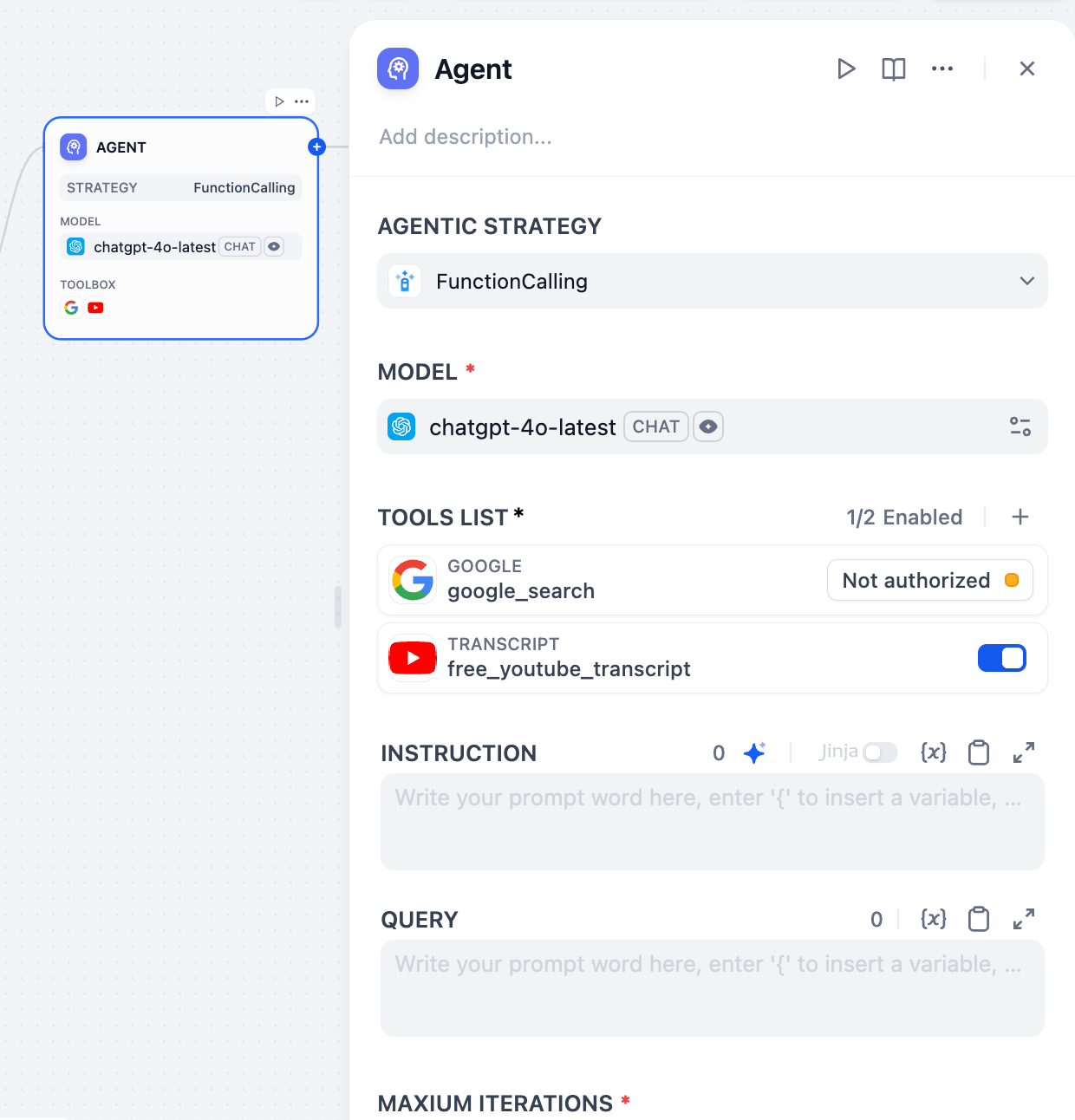

After choosing the Agent strategy, the configuration panel will display the relevant options. For the Function Calling and ReAct strategies that ship with Dify, the available configuration items include:

|

||||

|

||||

1. **Model:** Select the large language model that drives the Agent.

|

||||

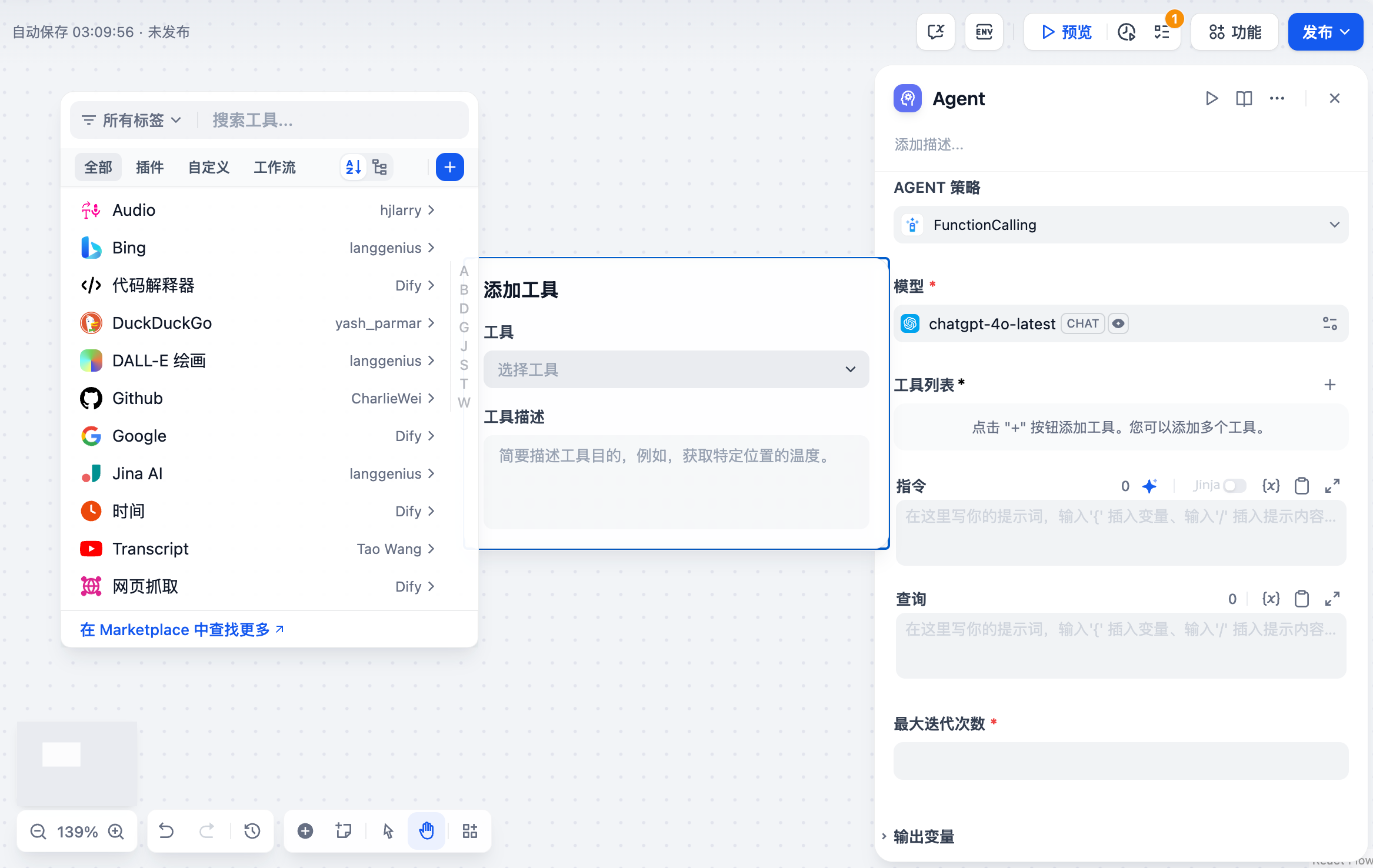

2. **Tools List:** The approach to using tools is defined by the Agent strategy. Click + to add and configure tools the Agent can call.

|

||||

* Search: Select an installed tool plugin from the dropdown.

|

||||

* Authorization: Provide API keys and other credentials to enable the tool.

|

||||

* Tool Description and Parameter Settings: Provide a description to help the LLM understand when and why to use the tool, and configure any functional parameters.

|

||||

3. **Instruction**: Define the Agent’s task goals and context. Jinja syntax is supported to reference upstream node variables.

|

||||

4. **Query**: Receives user input.

|

||||

5. **Maximum Iterations:** Set the maximum number of execution steps for the Agent.

|

||||

6. **Output Variables:** Indicates the data structure output by the node.

|

||||

|

||||

|

||||

|

||||

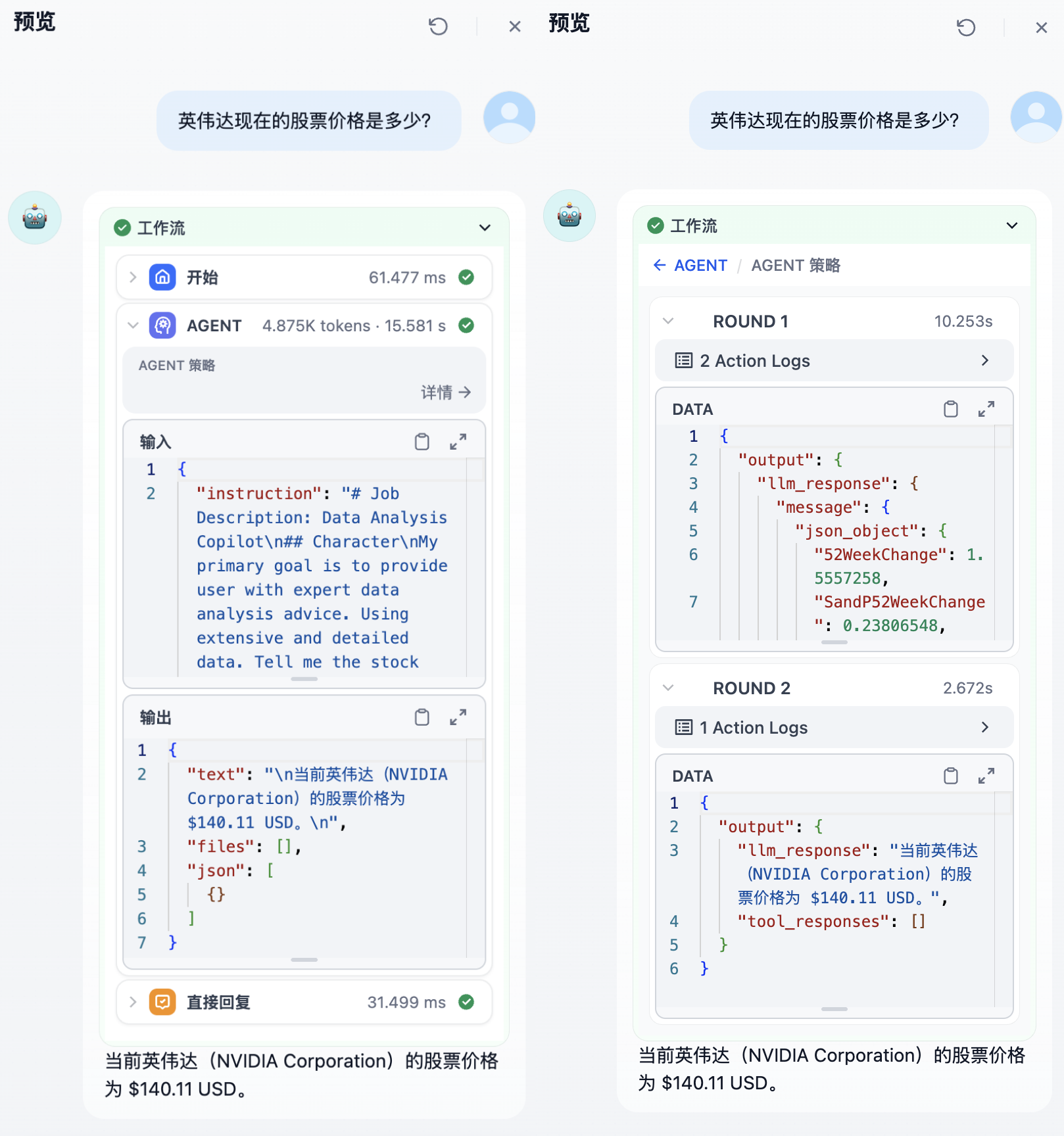

## Logs

|

||||

|

||||

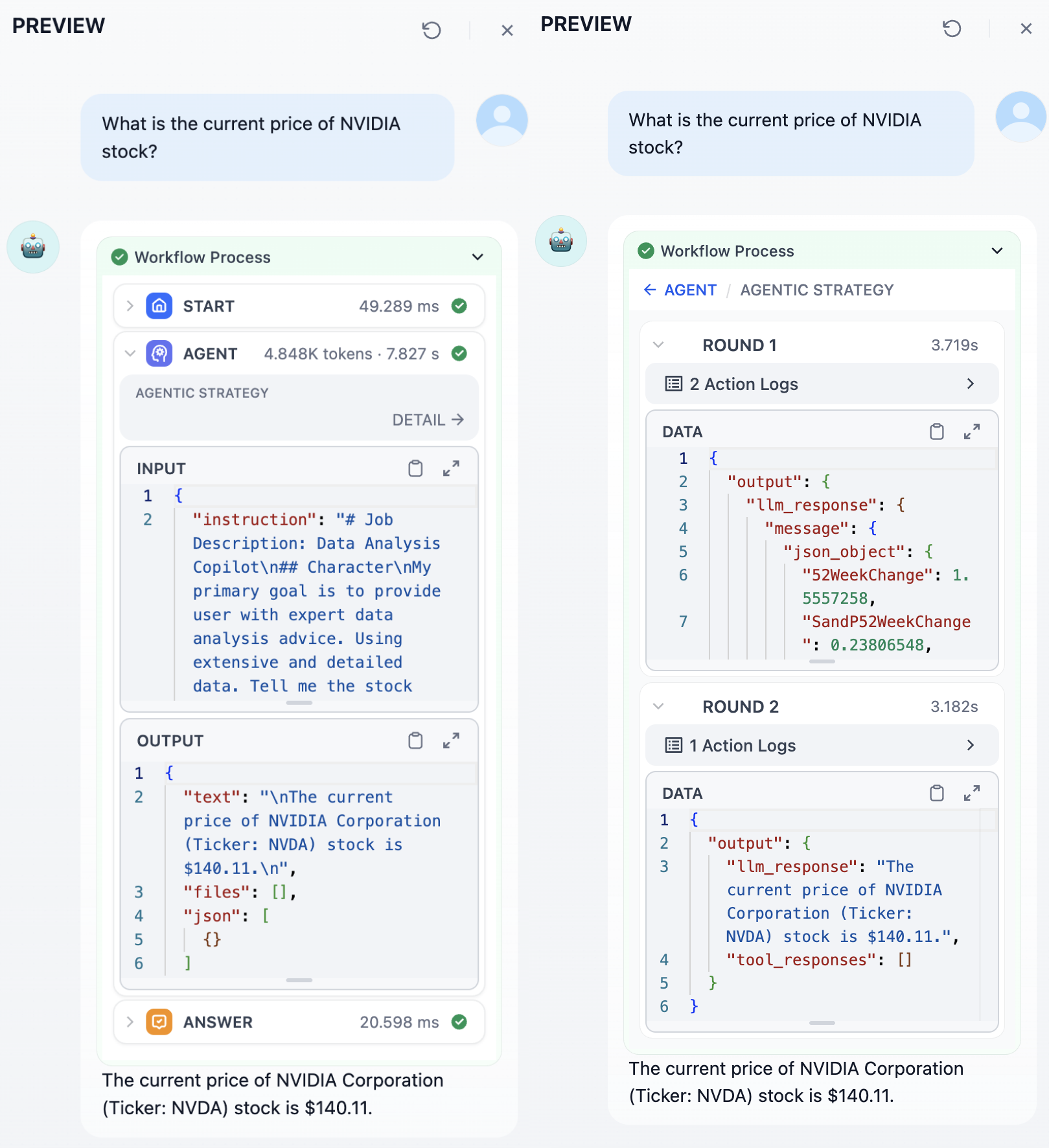

During execution, the Agent node generates detailed logs. You can see overall node execution information—including inputs and outputs, token usage, time spent, and status. Click Details to view the output from each round of Agent strategy execution.

|

||||

|

||||

|

||||

31

en/guides/workflow/node/answer.mdx

Normal file

31

en/guides/workflow/node/answer.mdx

Normal file

@@ -0,0 +1,31 @@

|

||||

---

|

||||

title: Answer

|

||||

---

|

||||

|

||||

|

||||

Defining Reply Content in a Chatflow Process. In a text editor, you have the flexibility to determine the reply format. This includes crafting a fixed block of text, utilizing output variables from preceding steps as the reply content, or merging custom text with variables for the response.

|

||||

|

||||

Answer node can be seamlessly integrated at any point to dynamically deliver content into the dialogue responses. This setup supports a live-editing configuration mode, allowing for both text and image content to be arranged together. The configurations include:

|

||||

|

||||

1. Outputting the reply content from a Language Model (LLM) node.

|

||||

2. Outputting generated images.

|

||||

3. Outputting plain text.

|

||||

|

||||

Example 1: Output plain text.

|

||||

|

||||

<div class="image-side-by-side">

|

||||

<img

|

||||

src="https://assets-docs.dify.ai/dify-enterprise-mintlify/en/guides/workflow/node/1b1fadb8f838963134fc5c9eb14b5632.png)

|

||||

|

||||

Example 2: Output image and LLM reply.

|

||||

|

||||

|

||||

* [Usage Scenarios](#usage-scenarios)

|

||||

* [Local Deployment](#local-deployment)

|

||||

* [Security Policies](#security-policies)

|

||||

|

||||

## Introduction

|

||||

|

||||

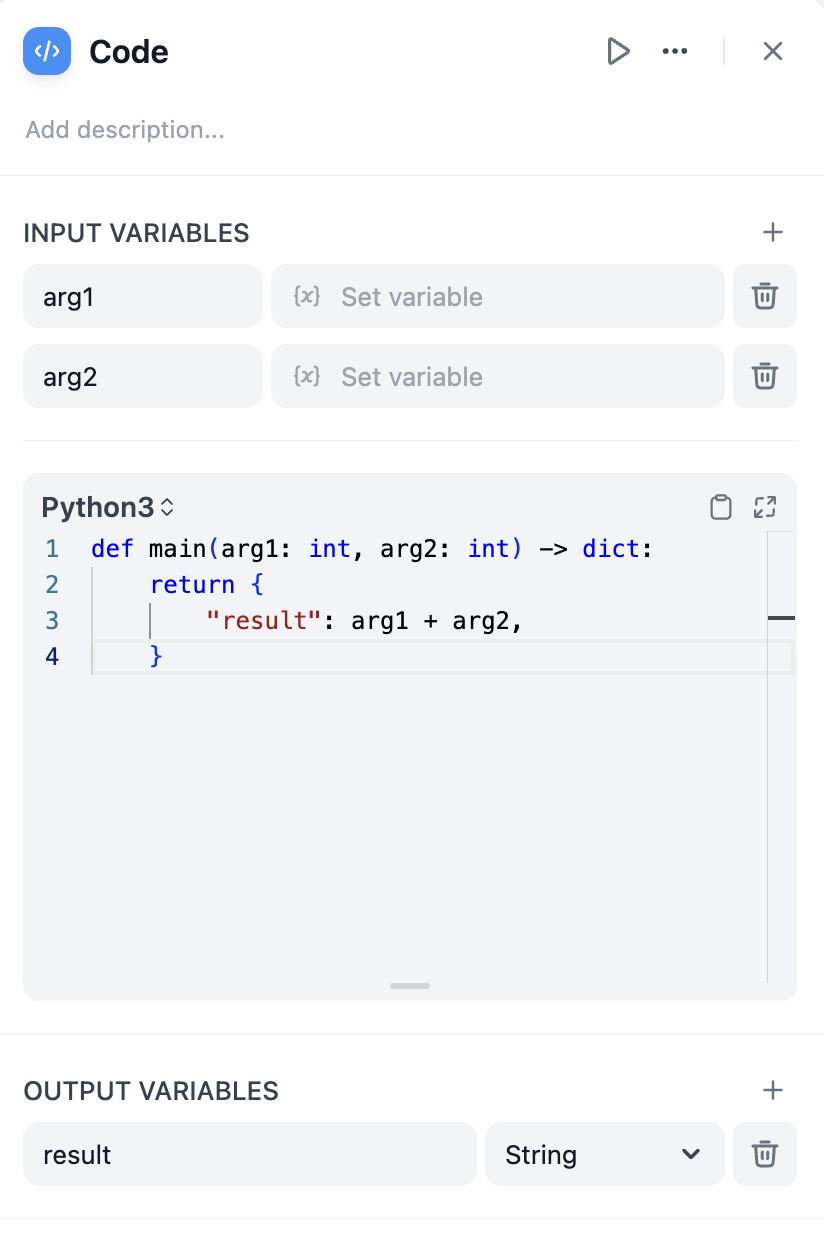

The code node supports running Python/NodeJS code to perform data transformations within a workflow. It can simplify your workflow and is suitable for scenarios such as arithmetic operations, JSON transformations, text processing, and more.

|

||||

|

||||

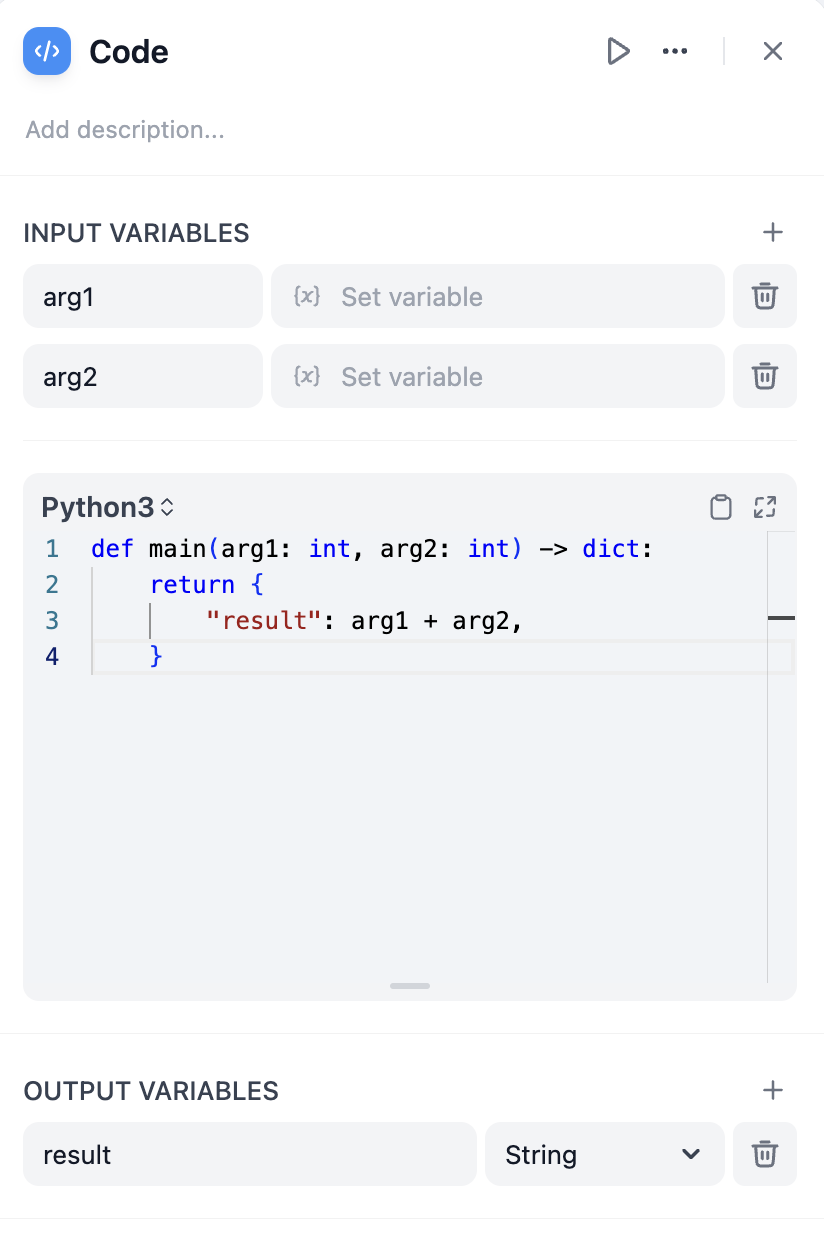

This node significantly enhances the flexibility for developers, allowing them to embed custom Python or JavaScript scripts within the workflow and manipulate variables in ways that preset nodes cannot achieve. Through configuration options, you can specify the required input and output variables and write the corresponding execution code:

|

||||

|

||||

|

||||

|

||||

## Configuration

|

||||

|

||||

If you need to use variables from other nodes in the code node, you must define the variable names in the `input variables` and reference these variables. You can refer to [Variable References](/en/guides/workflow/variables).

|

||||

|

||||

## Usage Scenarios

|

||||

|

||||

Using the code node, you can perform the following common operations:

|

||||

|

||||

### Structured Data Processing

|

||||

|

||||

In workflows, you often have to deal with unstructured data processing, such as parsing, extracting, and transforming JSON strings. A typical example is data processing from an HTTP node. In common API return structures, data may be nested within multiple layers of JSON objects, and you need to extract certain fields. The code node can help you perform these operations. Here is a simple example that extracts the `data.name` field from a JSON string returned by an HTTP node:

|

||||

|

||||

```python

|

||||

def main(http_response: str) -> str:

|

||||

import json

|

||||

data = json.loads(http_response)

|

||||

return {

|

||||

# Note to declare 'result' in the output variables

|

||||

'result': data['data']['name']

|

||||

}

|

||||

```

|

||||

|

||||

### Mathematical Calculations

|

||||

|

||||

When you need to perform complex mathematical calculations in a workflow, you can also use the code node. For example, calculating a complex mathematical formula or performing some statistical analysis on data. Here is a simple example that calculates the variance of an array:

|

||||

|

||||

```python

|

||||

def main(x: list) -> float:

|

||||

return {

|

||||

# Note to declare 'result' in the output variables

|

||||

'result': sum([(i - sum(x) / len(x)) ** 2 for i in x]) / len(x)

|

||||

}

|

||||

```

|

||||

|

||||

### Data Concatenation

|

||||

|

||||

Sometimes, you may need to concatenate multiple data sources, such as multiple knowledge retrievals, data searches, API calls, etc. The code node can help you integrate these data sources together. Here is a simple example that merges data from two knowledge bases:

|

||||

|

||||

```python

|

||||

def main(knowledge1: list, knowledge2: list) -> list:

|

||||

return {

|

||||

# Note to declare 'result' in the output variables

|

||||

'result': knowledge1 + knowledge2

|

||||

}

|

||||

```

|

||||

|

||||

## Local Deployment

|

||||

|

||||

If you are a local deployment user, you need to start a sandbox service to ensure that malicious code is not executed. This service requires the use of Docker. You can find specific information about the sandbox service [here](https://github.com/langgenius/dify/tree/main/docker/docker-compose.middleware.yaml). You can also start the service directly via `docker-compose`:

|

||||

|

||||

```bash

|

||||

docker-compose -f docker-compose.middleware.yaml up -d

|

||||

```

|

||||

|

||||

## Security Policies

|

||||

|

||||

Both Python and JavaScript execution environments are strictly isolated (sandboxed) to ensure security. This means that developers cannot use functions that consume large amounts of system resources or may pose security risks, such as direct file system access, making network requests, or executing operating system-level commands. These limitations ensure the safe execution of the code while avoiding excessive consumption of system resources.

|

||||

|

||||

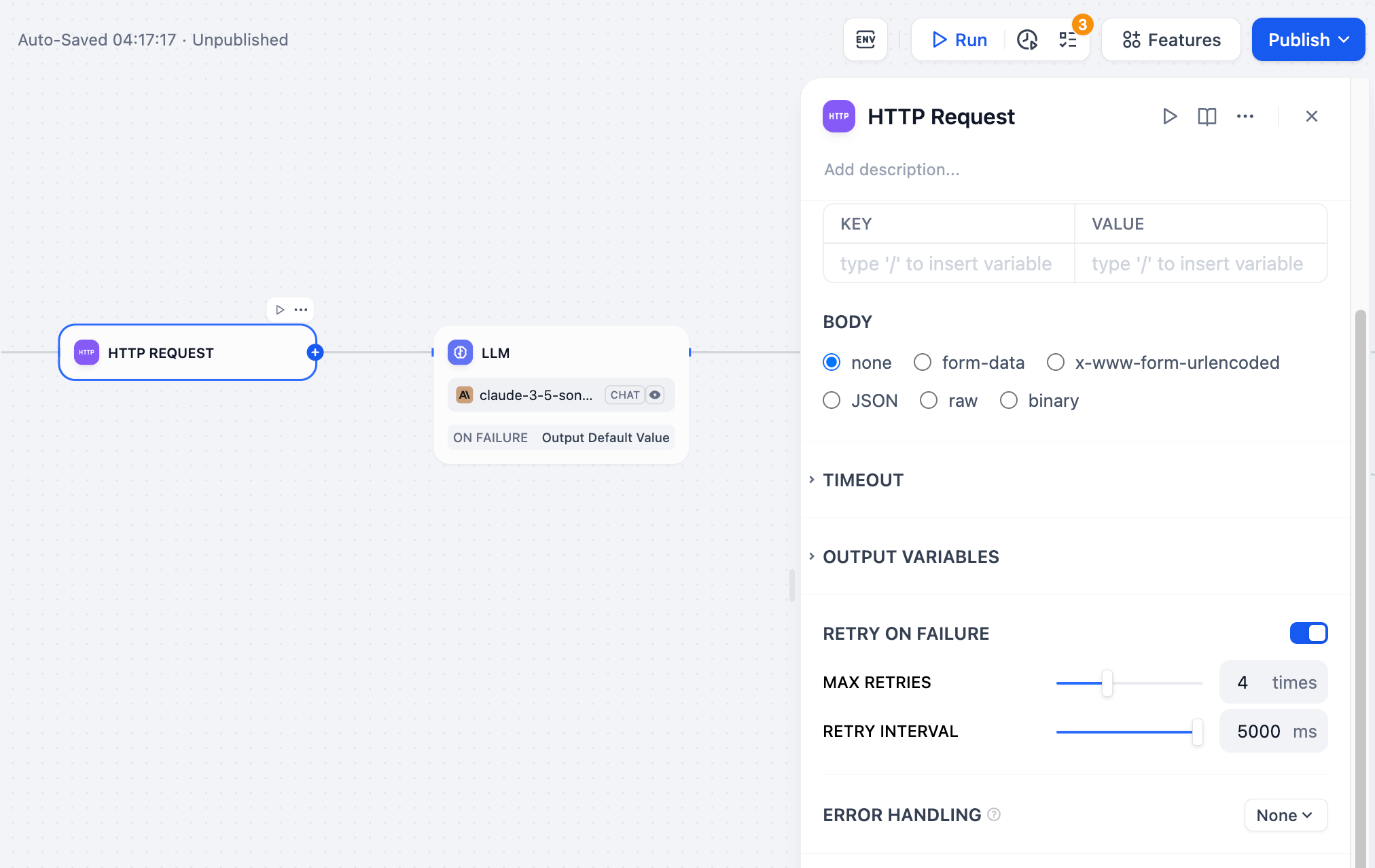

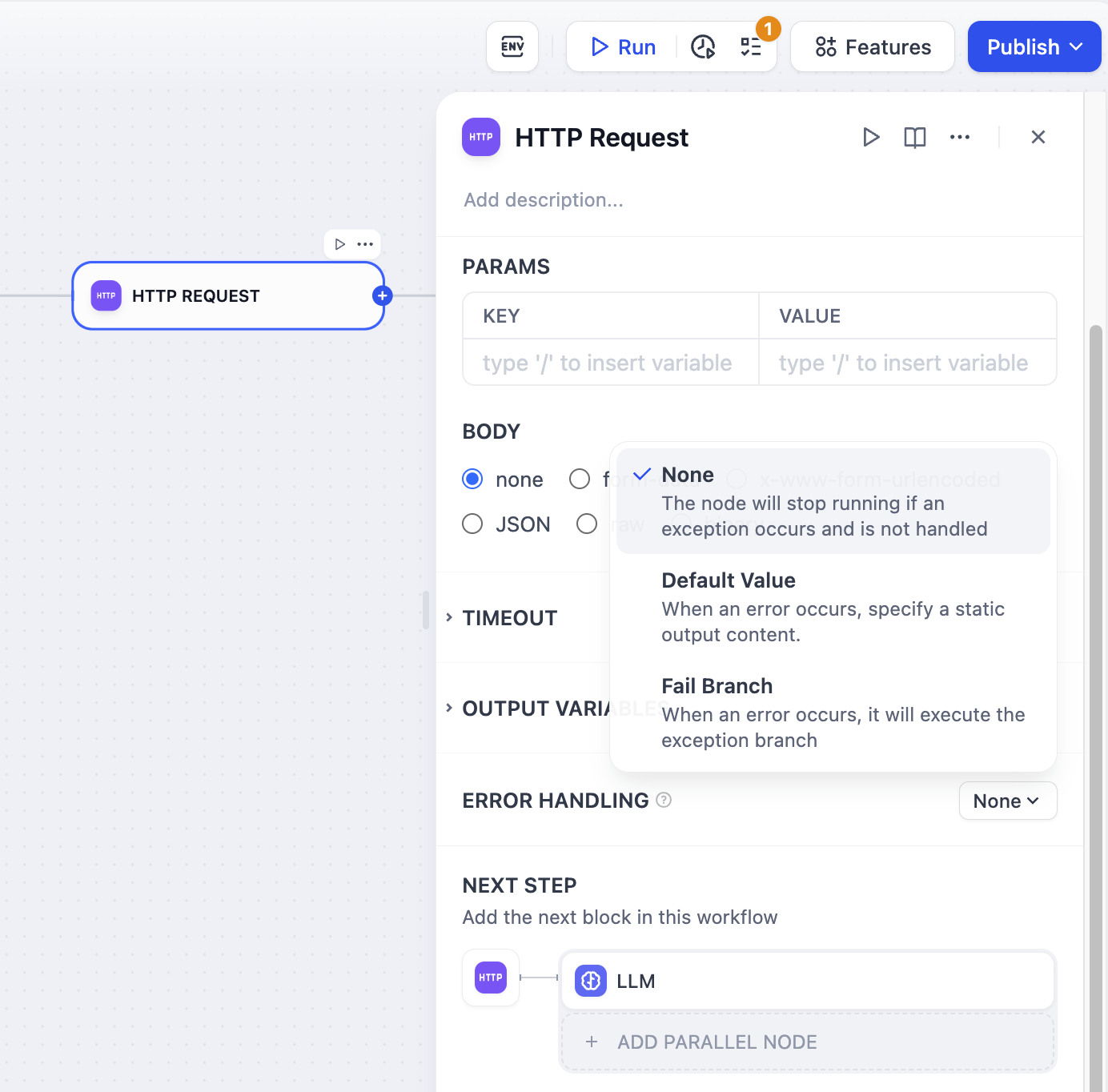

### Advanced Features

|

||||

|

||||

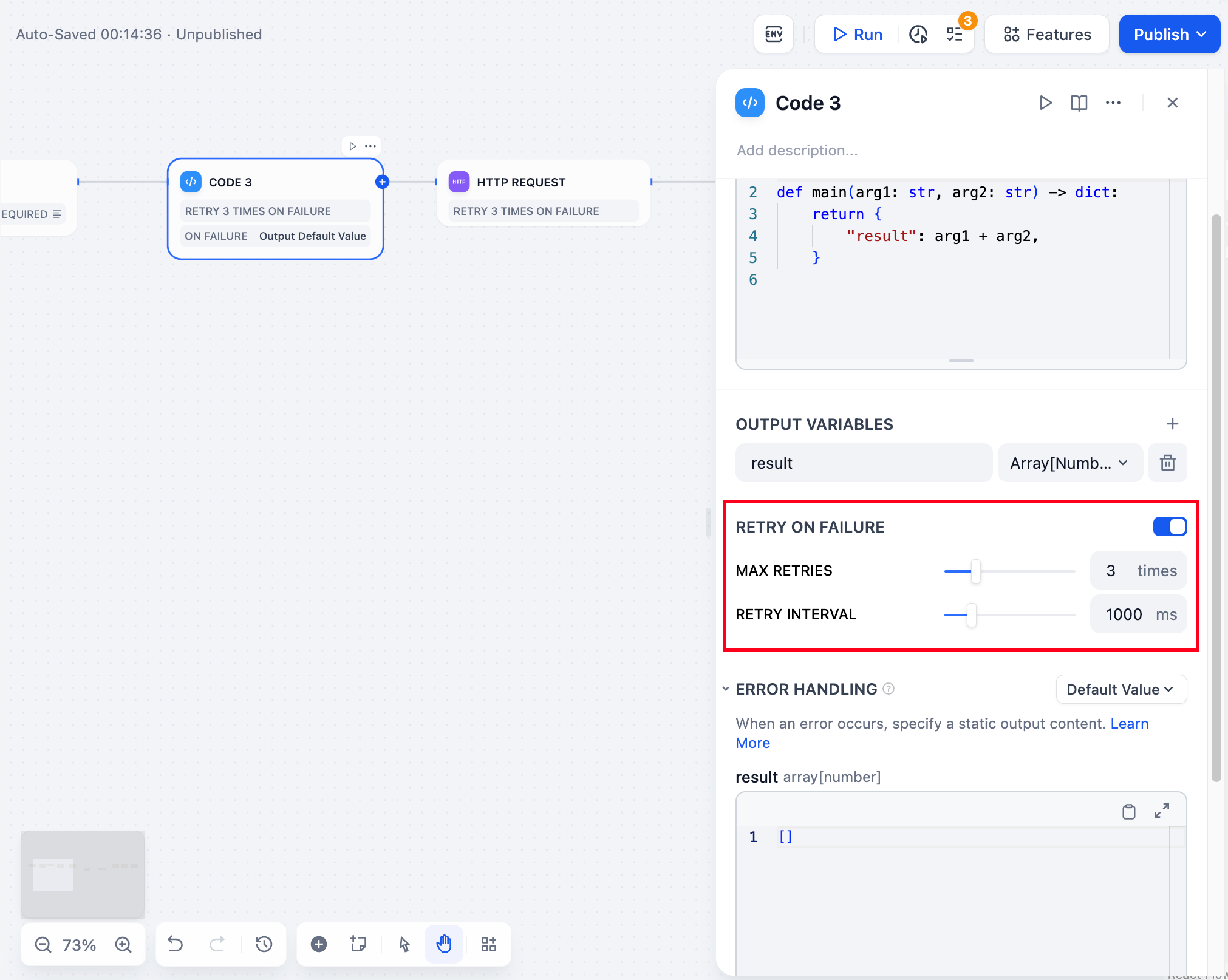

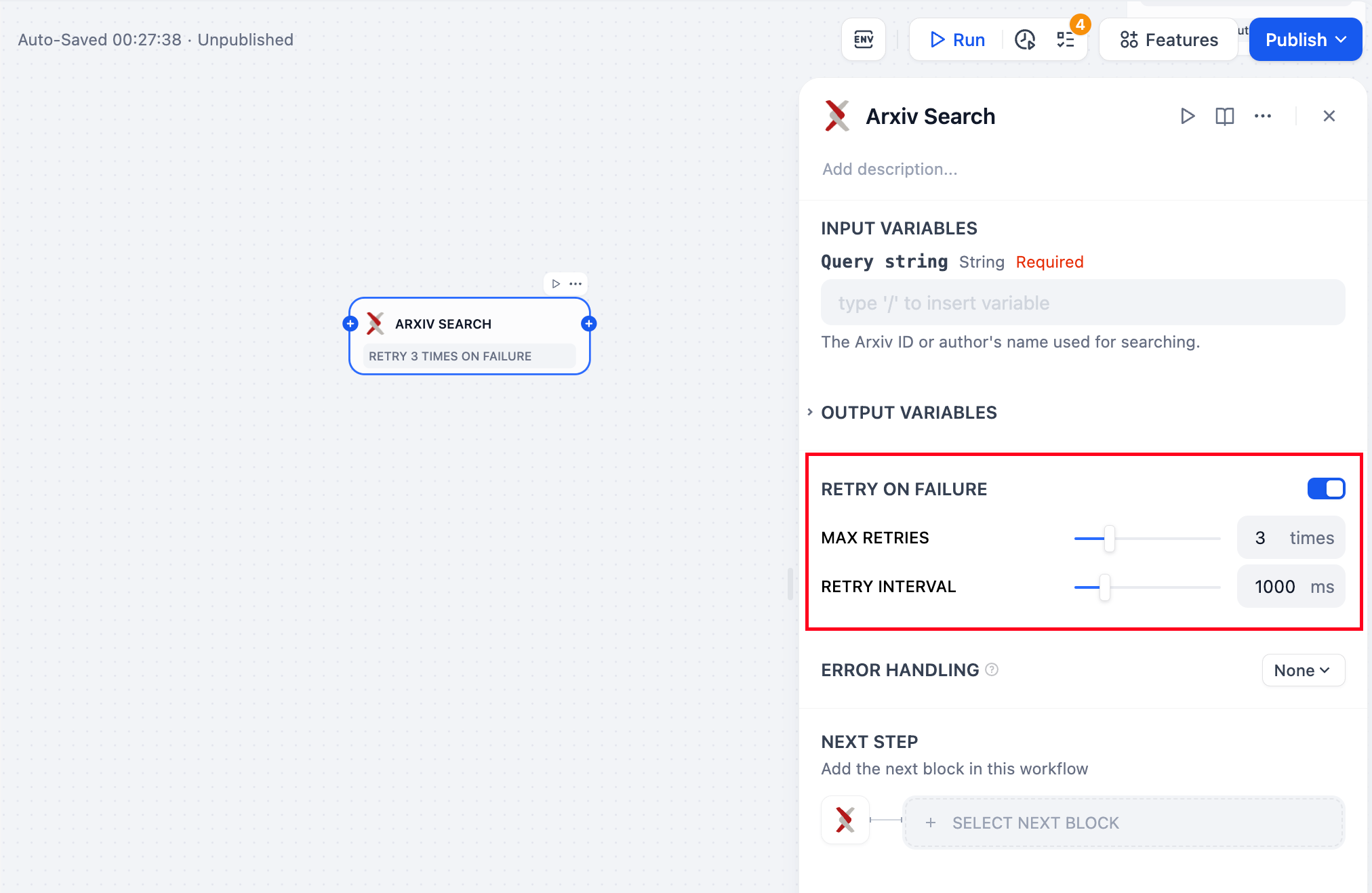

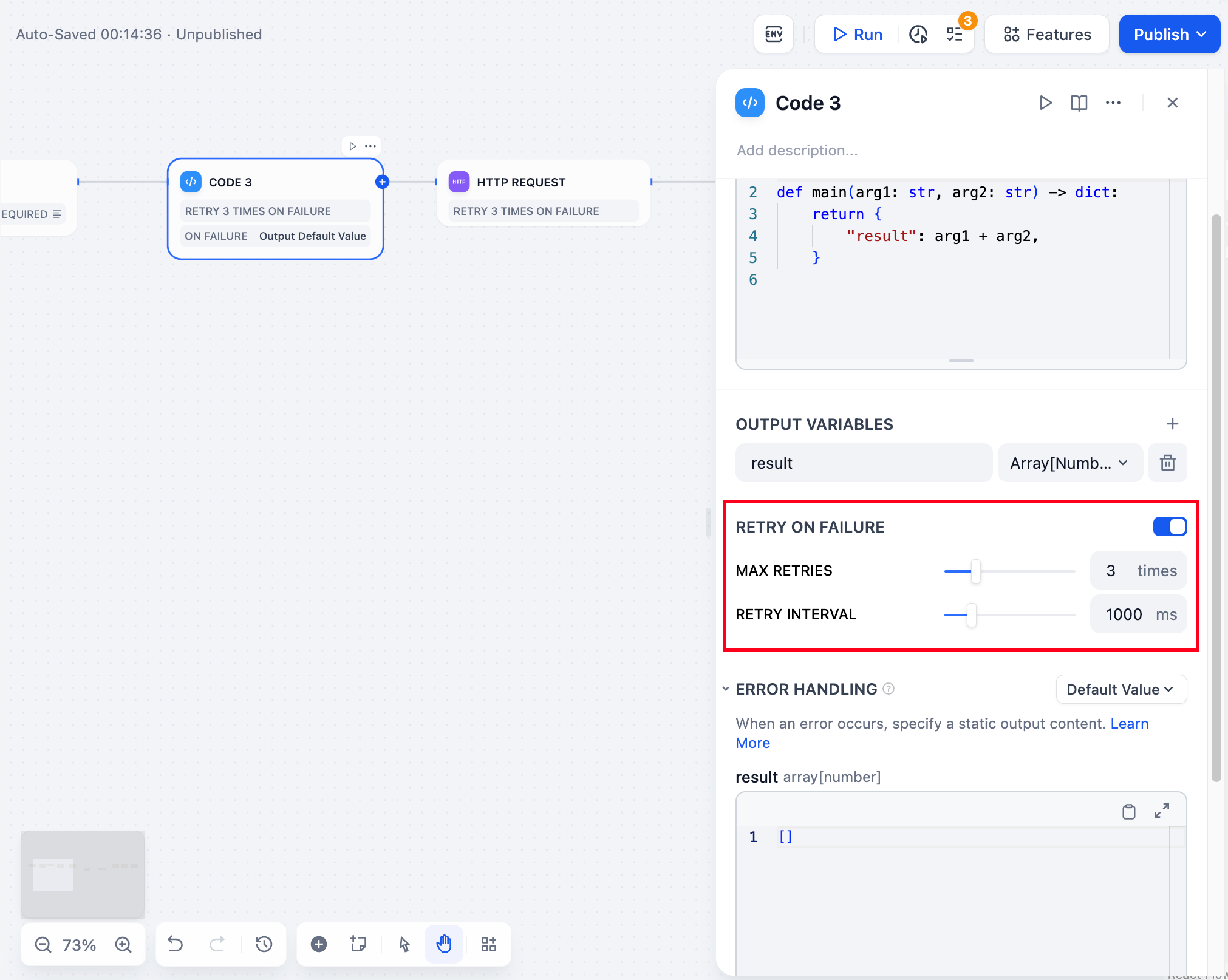

**Retry on Failure**

|

||||

|

||||

For some exceptions that occur in the node, it is usually sufficient to retry the node again. When the error retry function is enabled, the node will automatically retry according to the preset strategy when an error occurs. You can adjust the maximum number of retries and the interval between each retry to set the retry strategy.

|

||||

|

||||

- The maximum number of retries is 10

|

||||

- The maximum retry interval is 5000 ms

|

||||

|

||||

|

||||

|

||||

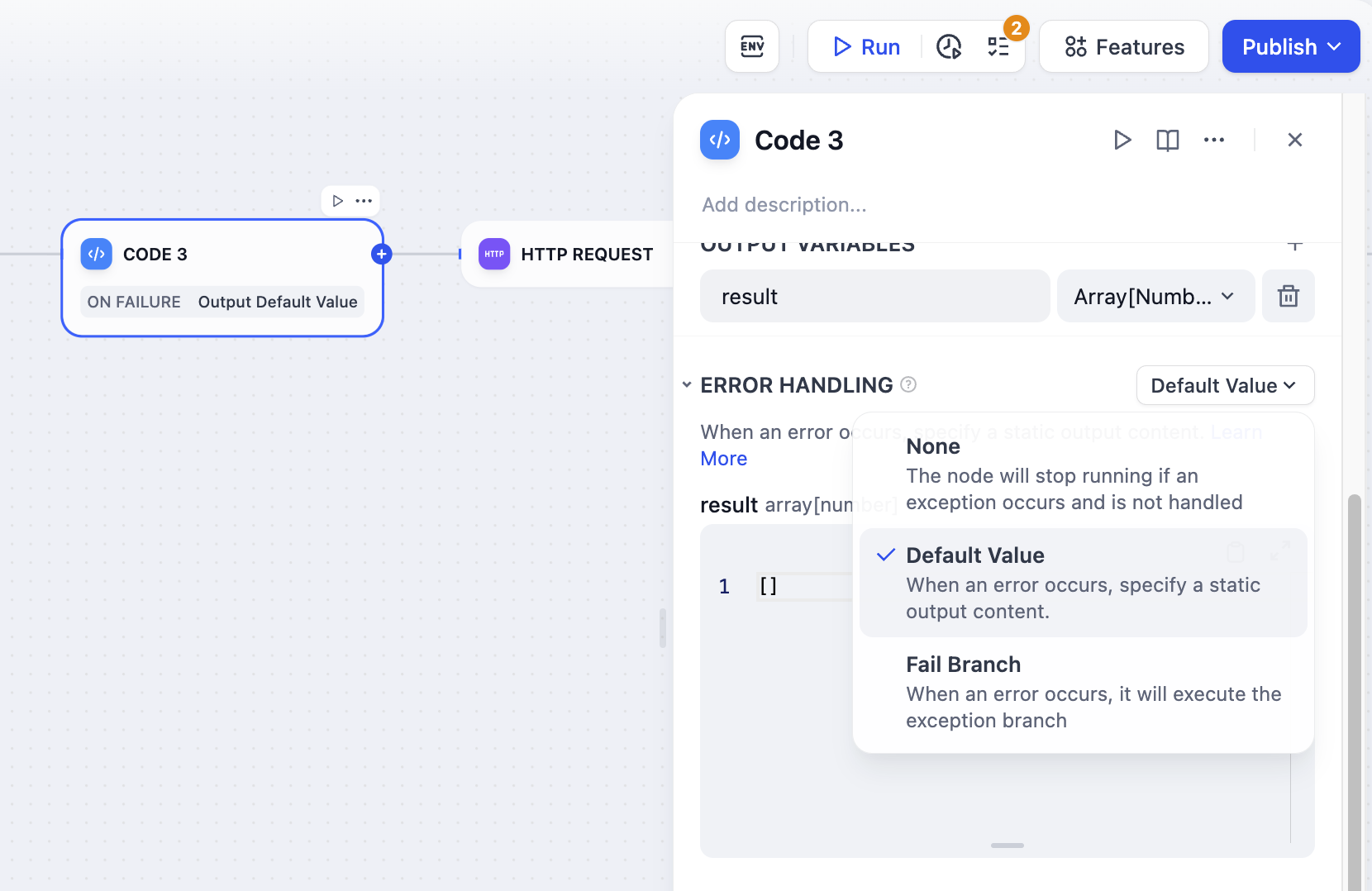

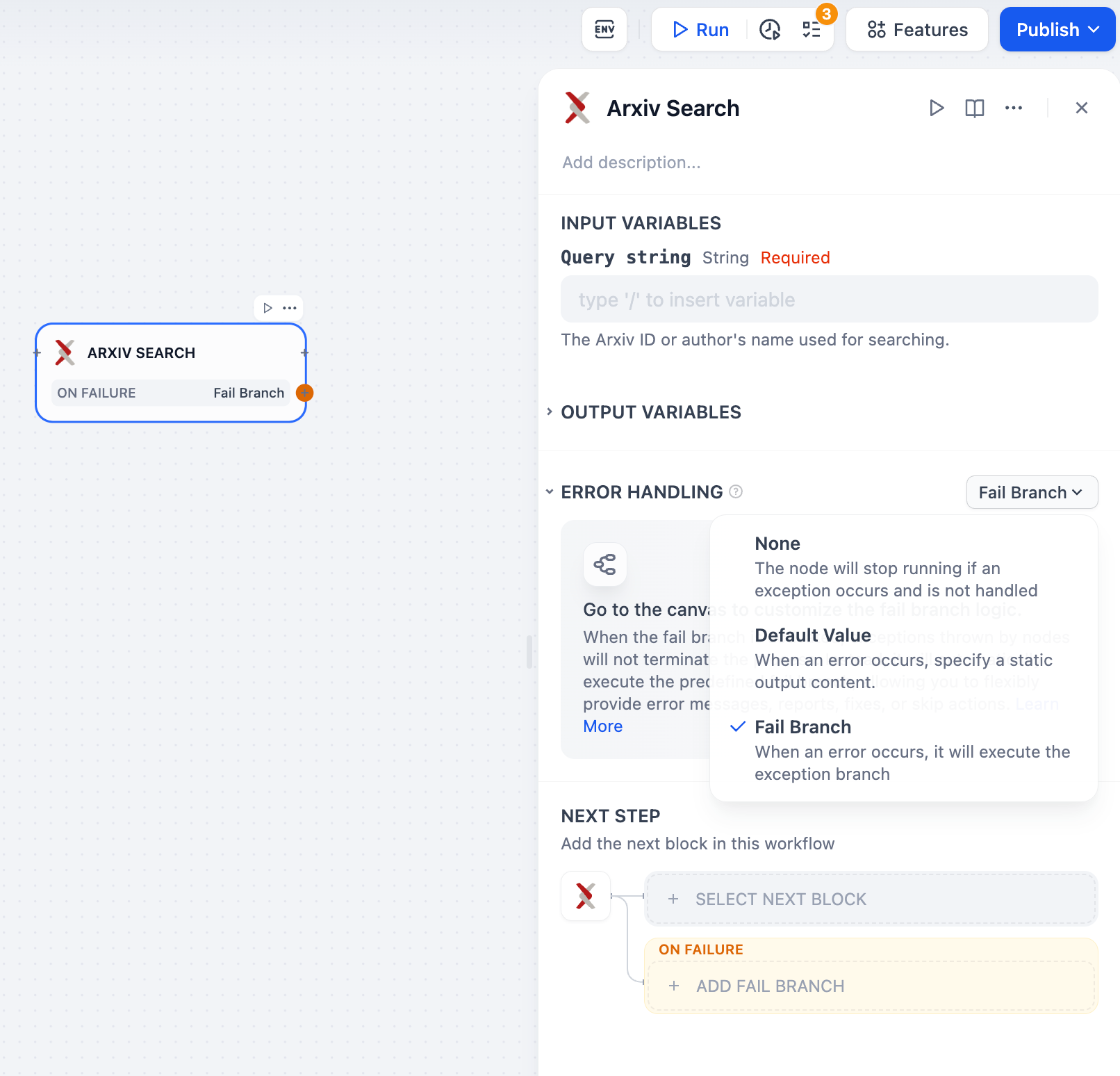

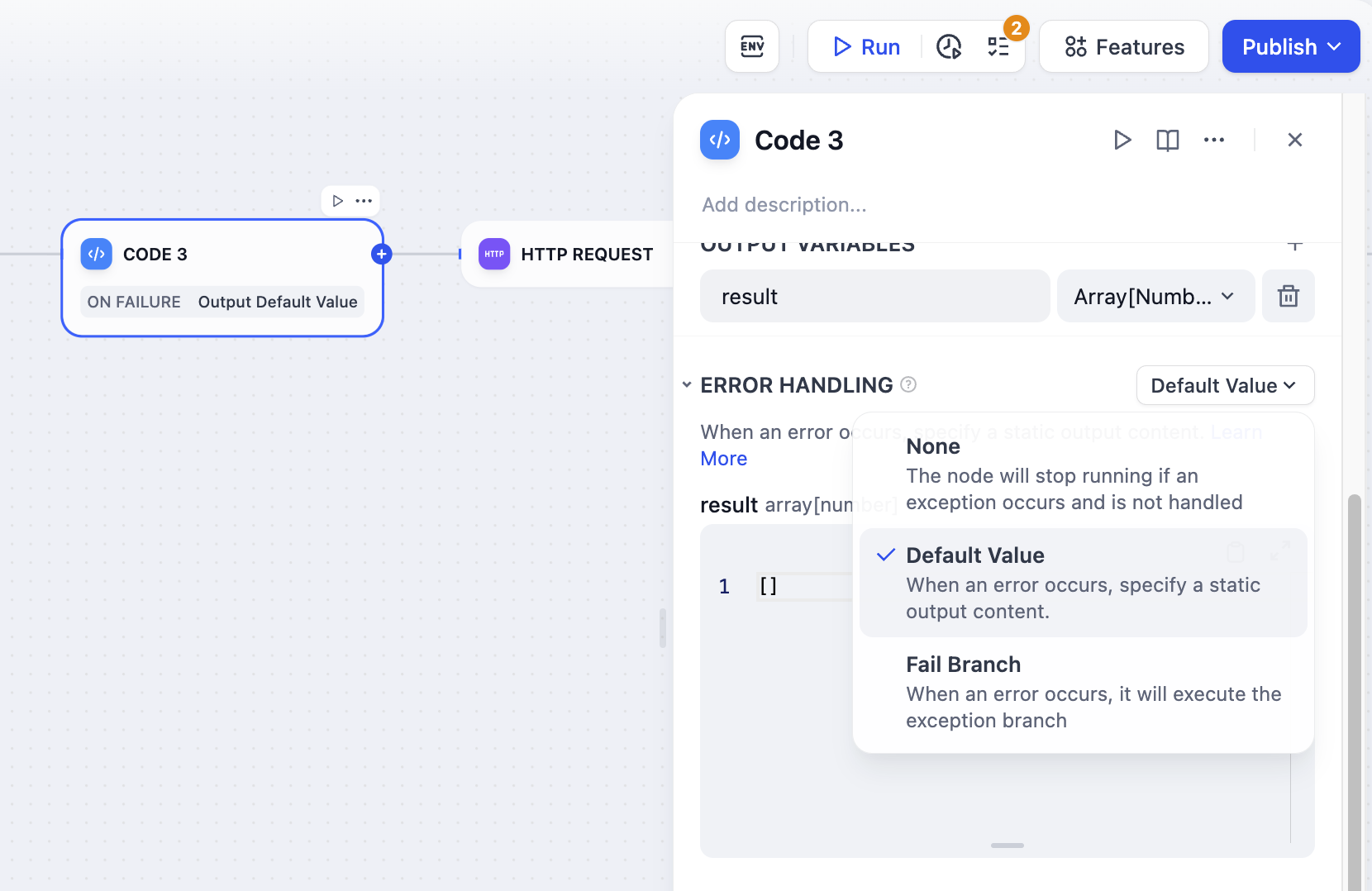

**Error Handling**

|

||||

|

||||

When processing information, code nodes may encounter code execution exceptions. Developers can follow these steps to configure fail branches, enabling contingency plans when nodes encounter exceptions, thus avoiding workflow interruptions.

|

||||

|

||||

1. Enable "Error Handling" in the code node

|

||||

2. Select and configure an error handling strategy

|

||||

|

||||

|

||||

|

||||

For more information about exception handling approaches, please refer to [Error Handling](/en/guides/workflow/error-handling).

|

||||

|

||||

### FAQ

|

||||

|

||||

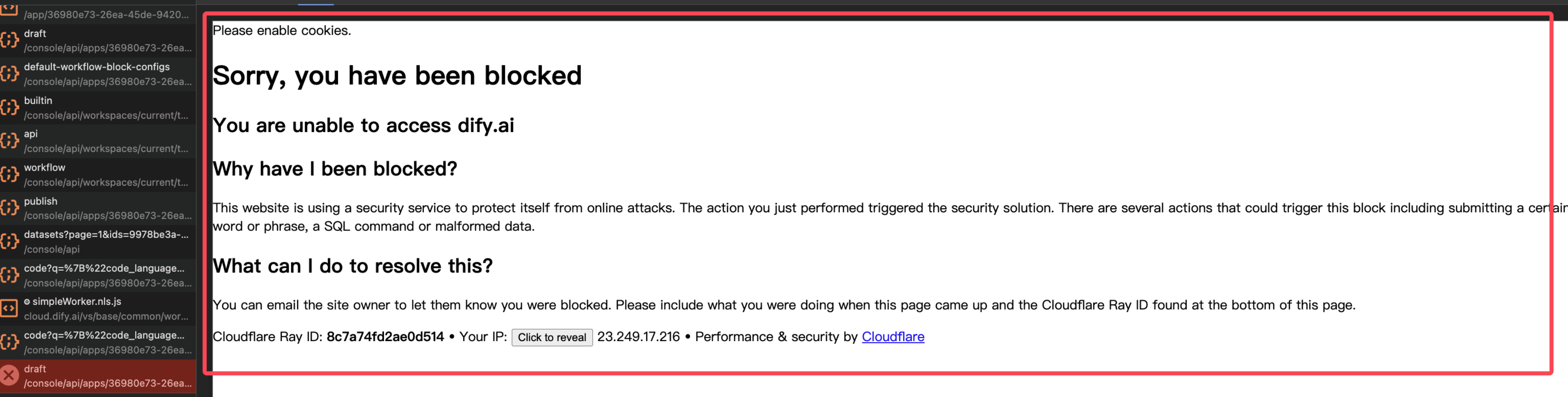

**Why can't I save the code it in the code node?**

|

||||

|

||||

Please check if the code contains potentially dangerous behaviors. For example:

|

||||

|

||||

```python

|

||||

def main() -> dict:

|

||||

return {

|

||||

"result": open("/etc/passwd").read(),

|

||||

}

|

||||

```

|

||||

|

||||

This code snippet has the following issues:

|

||||

|

||||

* **Unauthorized file access:** The code attempts to read the "/etc/passwd" file, which is a critical system file in Unix/Linux systems that stores user account information.

|

||||

* **Sensitive information disclosure:** The "/etc/passwd" file contains important information about system users, such as usernames, user IDs, group IDs, home directory paths, etc. Direct access could lead to information leakage.

|

||||

|

||||

Dangerous code will be automatically blocked by Cloudflare WAF. You can check if it's been blocked by looking at the "Network" tab in your browser's "Web Developer Tools".

|

||||

|

||||

|

||||

|

||||

65

en/guides/workflow/node/doc-extractor.mdx

Normal file

65

en/guides/workflow/node/doc-extractor.mdx

Normal file

@@ -0,0 +1,65 @@

|

||||

---

|

||||

title: Doc Extractor

|

||||

---

|

||||

|

||||

|

||||

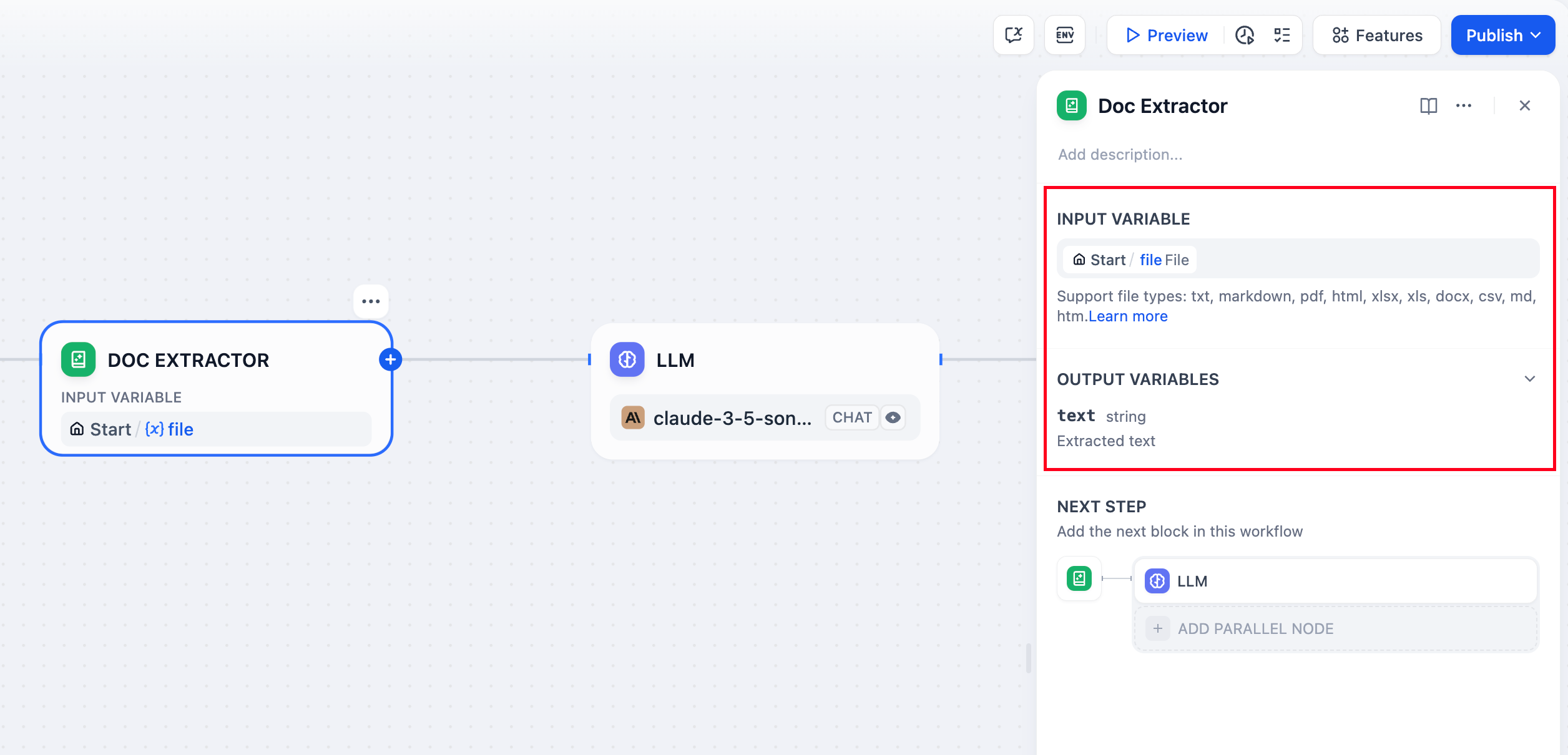

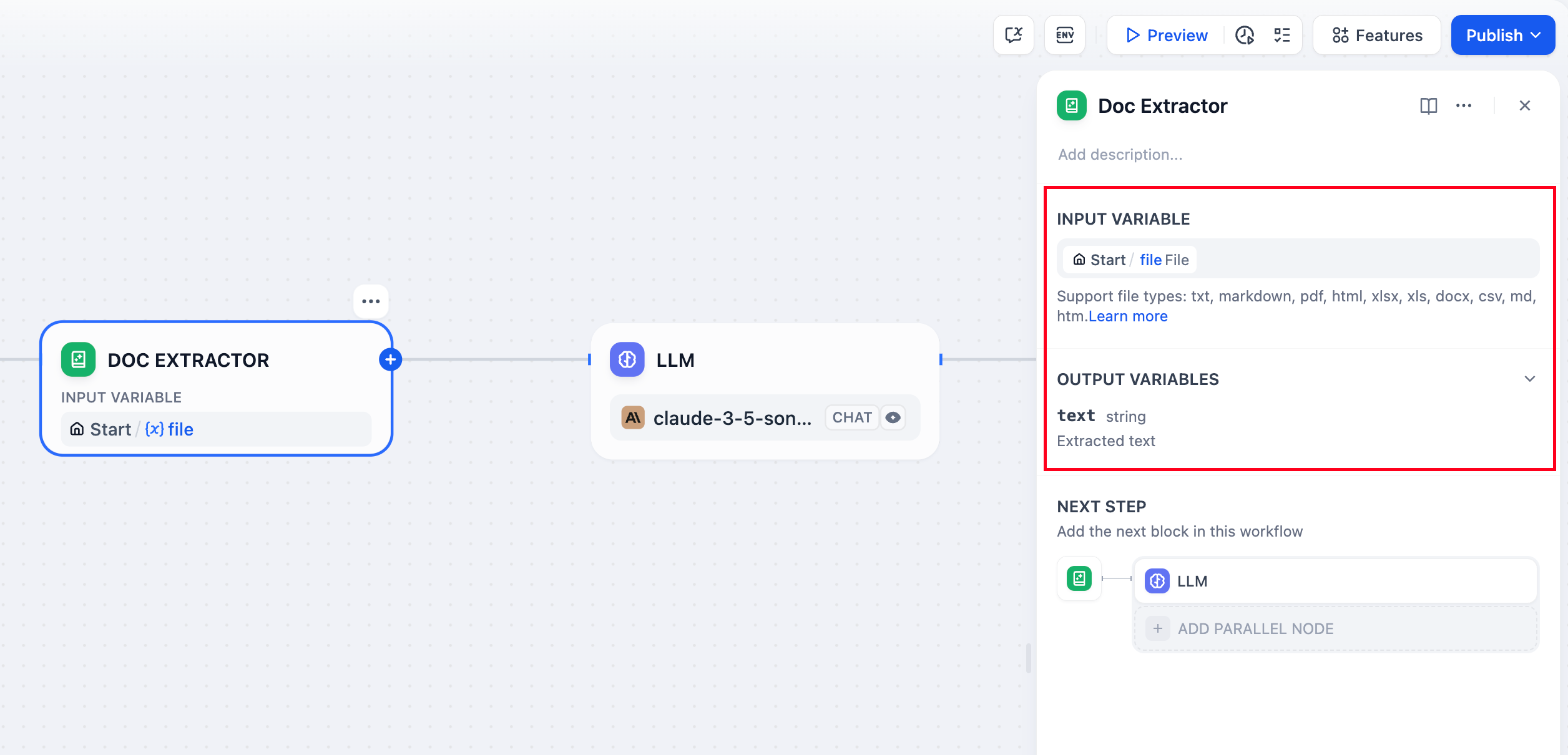

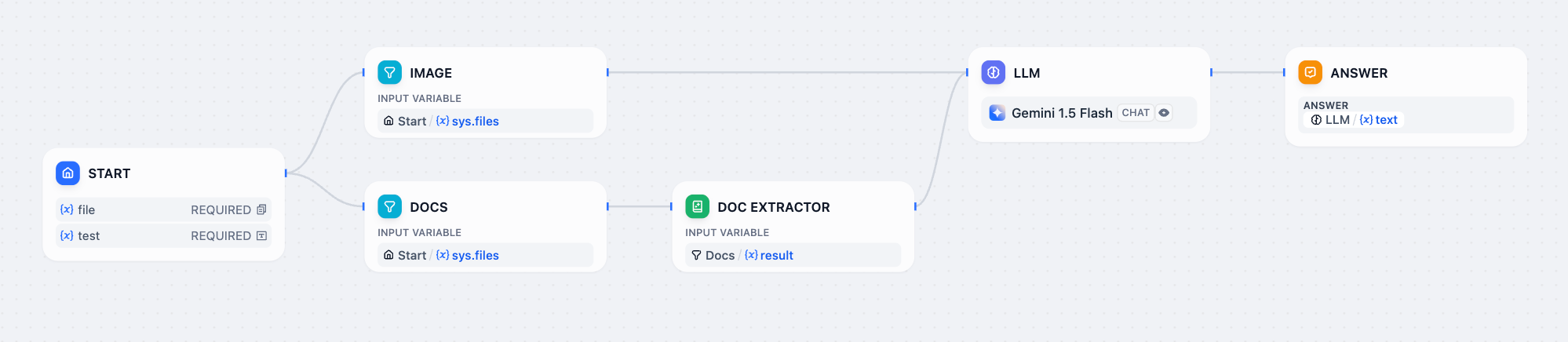

#### Definition

|

||||

|

||||

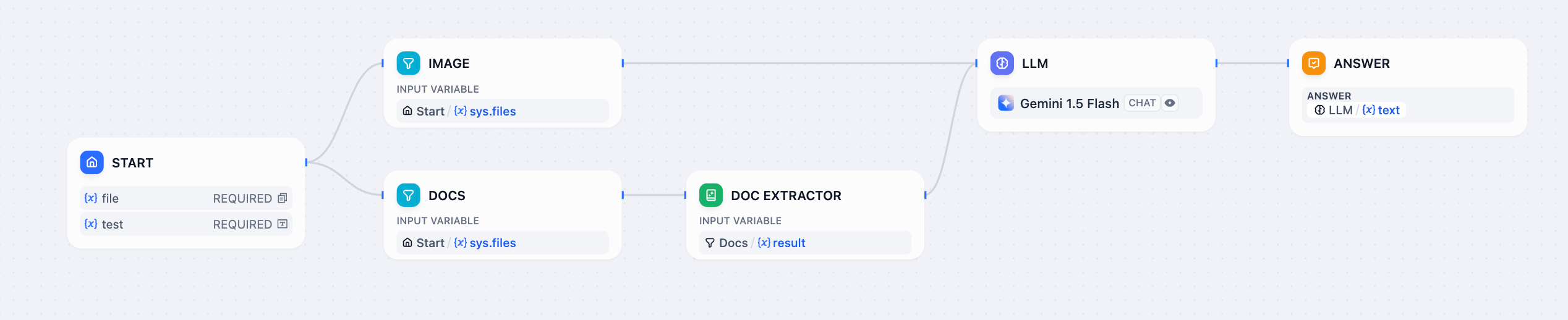

LLMs cannot directly read or interpret document contents. Therefore, it's necessary to parse and read information from user-uploaded documents through a document extractor node, convert it to text, and then pass the content to the LLM to process the file contents.

|

||||

|

||||

#### Application Scenarios

|

||||

|

||||

* Building LLM applications that can interact with files, such as ChatPDF or ChatWord;

|

||||

* Analyzing and examining the contents of user-uploaded files;

|

||||

|

||||

#### Node Functionality

|

||||

|

||||

The document extractor node can be understood as an information processing center. It recognizes and reads files in the input variables, extracts information, and converts it into string-type output variables for downstream nodes to call.

|

||||

|

||||

|

||||

|

||||

The document extractor node structure is divided into input variables and output variables.

|

||||

|

||||

**Input Variables**

|

||||

|

||||

The document extractor only accepts variables with the following data structures:

|

||||

|

||||

* `File`, a single file

|

||||

* `Array[File]`, multiple files

|

||||

|

||||

The document extractor can only extract information from document-type files, such as the contents of TXT, Markdown, PDF, HTML, DOCX format files. It cannot process image, audio, video, or other file formats.

|

||||

|

||||

**Output Variables**

|

||||

|

||||

The output variable is fixed and named as text. The type of output variable depends on the input variable:

|

||||

|

||||

* If the input variable is `File`, the output variable is `string`

|

||||

* If the input variable is `Array[File]`, the output variable is `array[string]`

|

||||

|

||||

> Array variables generally need to be used in conjunction with list operation nodes. For details, please refer to [List Operator](/en/guides/workflow/nodes/list-operator).

|

||||

|

||||

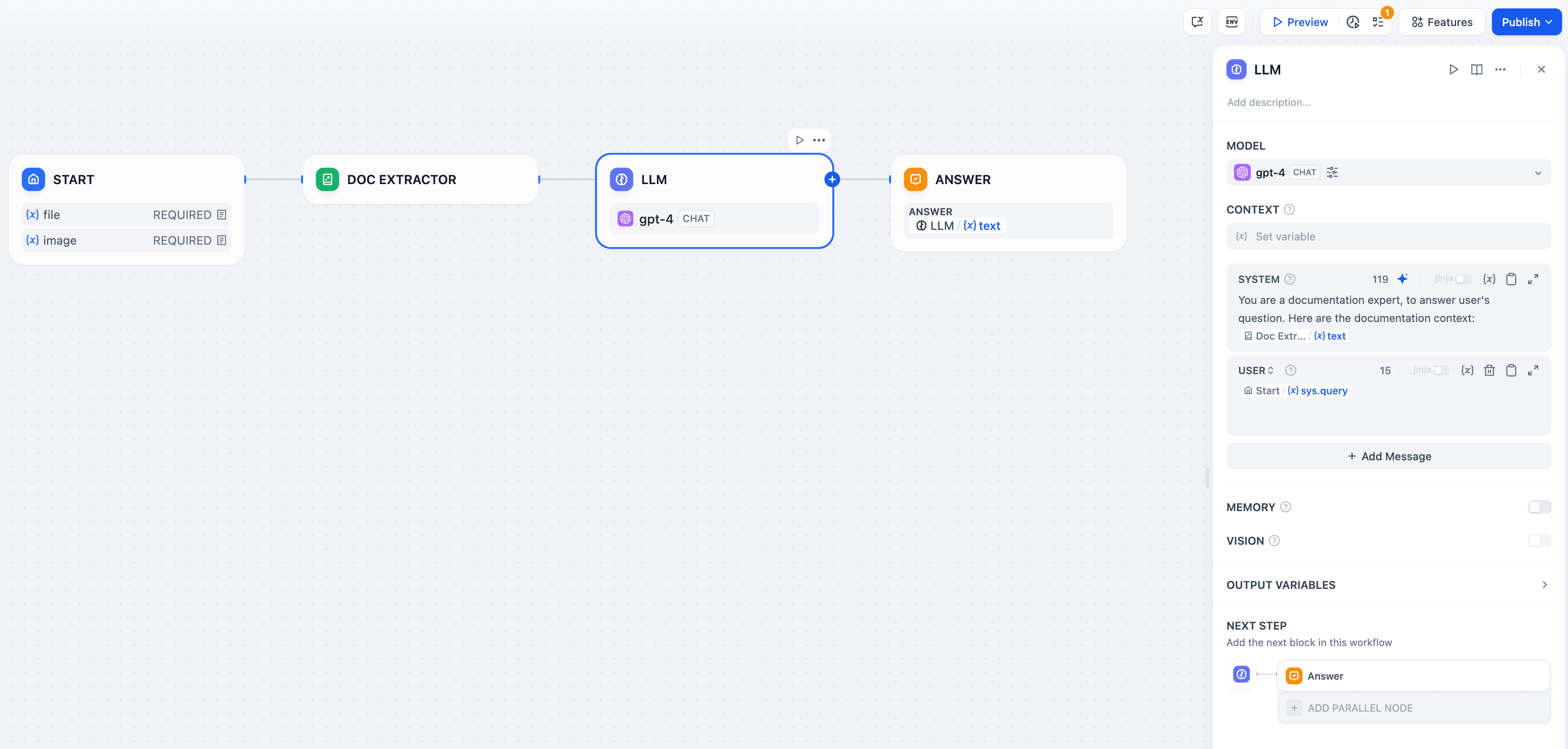

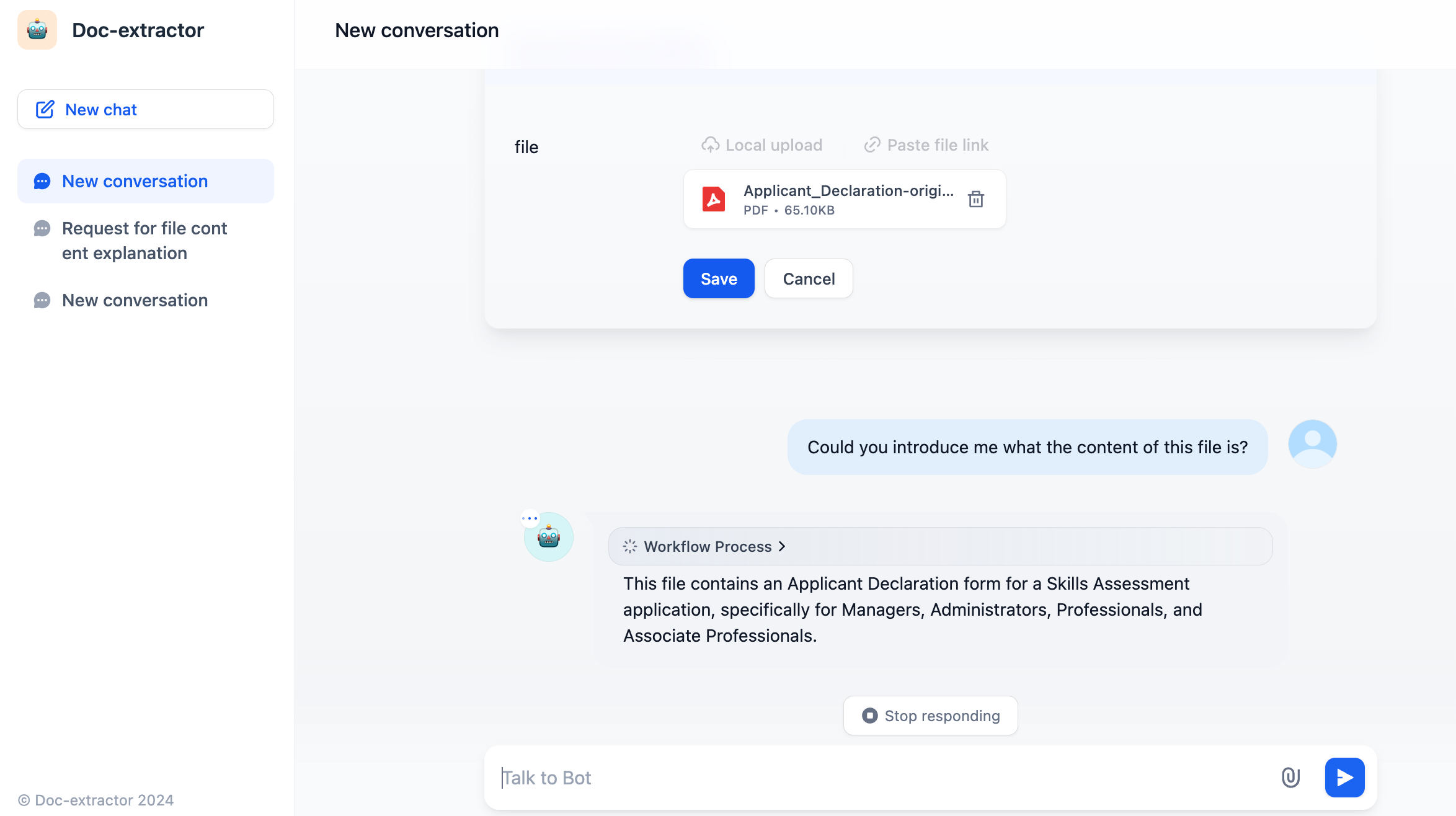

#### Configuration Example

|

||||

|

||||

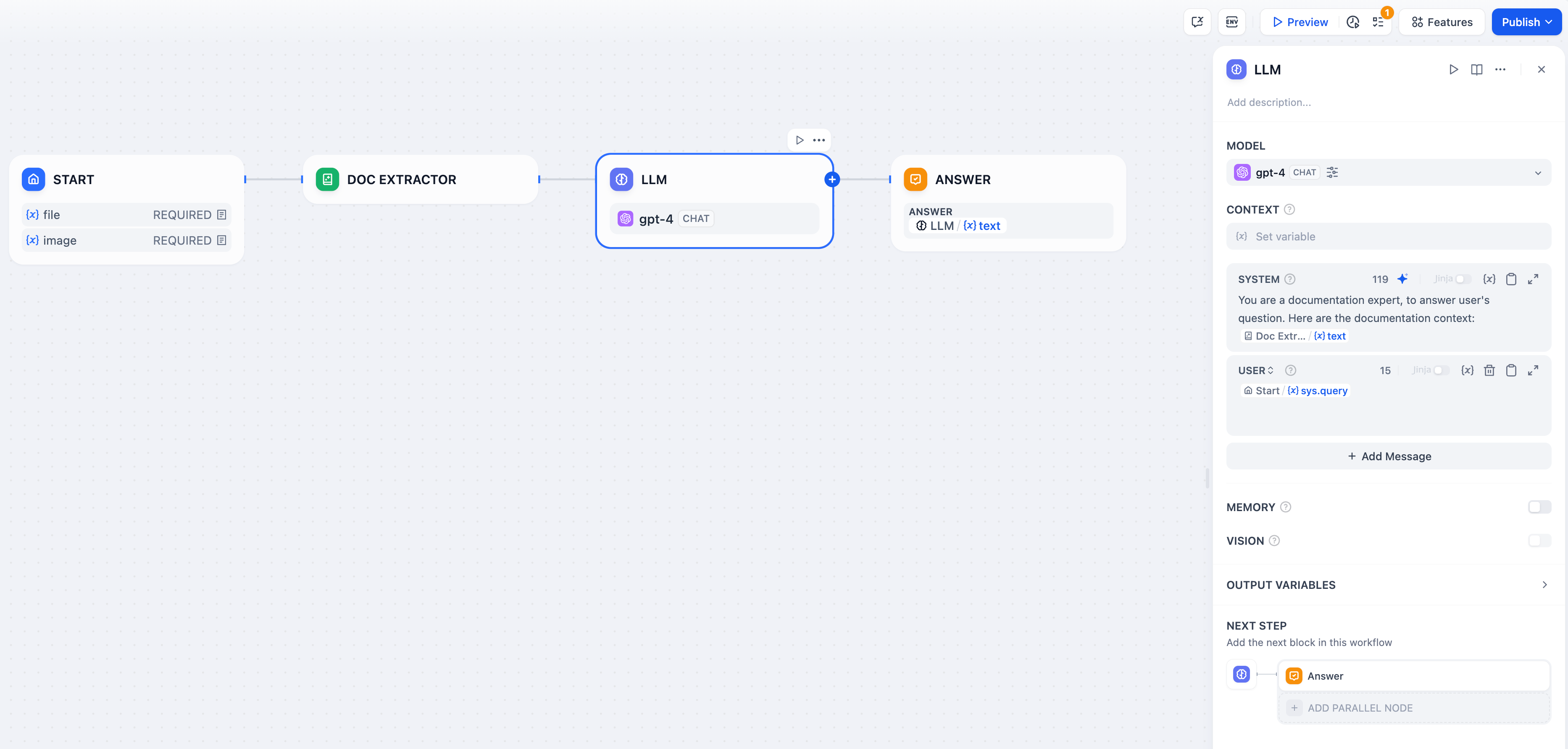

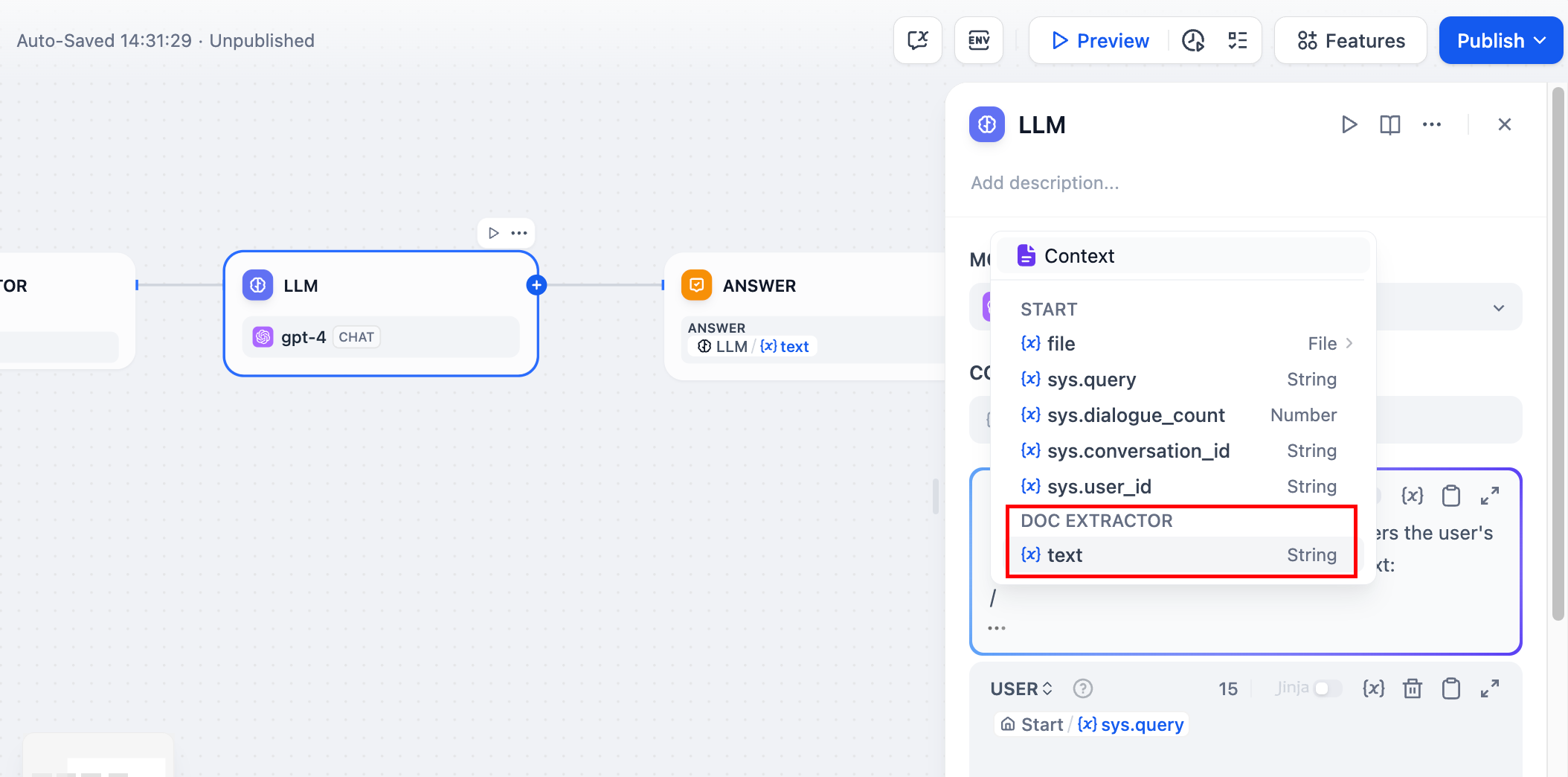

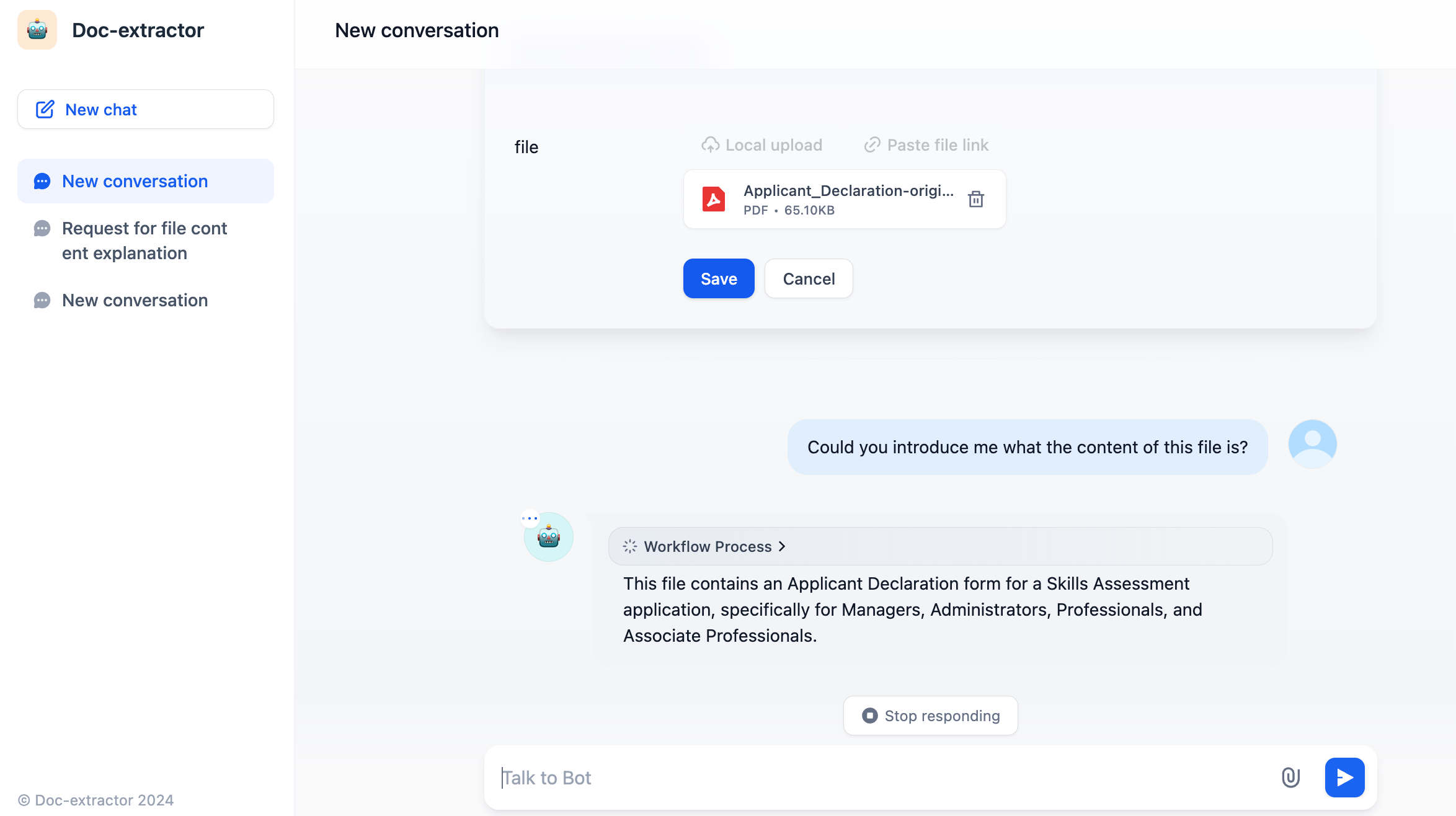

In a typical file interaction Q\&A scenario, the document extractor can serve as a preliminary step for the LLM node, extracting file information from the application and passing it to the downstream LLM node to answer user questions about the file.

|

||||

|

||||

This section will introduce the usage of the document extractor node through a typical ChatPDF example workflow template.

|

||||

|

||||

|

||||

|

||||

**Configuration Process:**

|

||||

|

||||

1. Enable file upload for the application. Add a **single file variable** in the "Start" node and name it `pdf`.

|

||||

2. Add a document extractor node and select the `pdf` variable in the input variables.

|

||||

3. Add an LLM node and select the output variable of the document extractor node in the system prompt. The LLM can read the contents of the file through this output variable.

|

||||

|

||||

|

||||

|

||||

Configure the end node by selecting the output variable of the LLM node in the end node.

|

||||

|

||||

|

||||

|

||||

After configuration, the application will have file upload functionality, allowing users to upload PDF files and engage in conversation.

|

||||

|

||||

<Info>

|

||||

For how to upload files in chat conversations and interact with the LLM, please refer to [Additional Features](/en/guides/workflow/additional-features).

|

||||

</Info>

|

||||

32

en/guides/workflow/node/end.mdx

Normal file

32

en/guides/workflow/node/end.mdx

Normal file

@@ -0,0 +1,32 @@

|

||||

---

|

||||

title: End

|

||||

---

|

||||

|

||||

|

||||

### 1 Definition

|

||||

|

||||

Define the final output content of a workflow. Every workflow needs at least one end node after complete execution to output the final result.

|

||||

|

||||

The end node is a termination point in the process; no further nodes can be added after it. In a workflow application, results are only output when the end node is reached. If there are conditional branches in the process, multiple end nodes need to be defined.

|

||||

|

||||

The end node must declare one or more output variables, which can reference any upstream node's output variables.

|

||||

|

||||

<Info>

|

||||

End nodes are not supported within Chatflow.

|

||||

</Info>

|

||||

|

||||

***

|

||||

|

||||

### 2 Scenarios

|

||||

|

||||

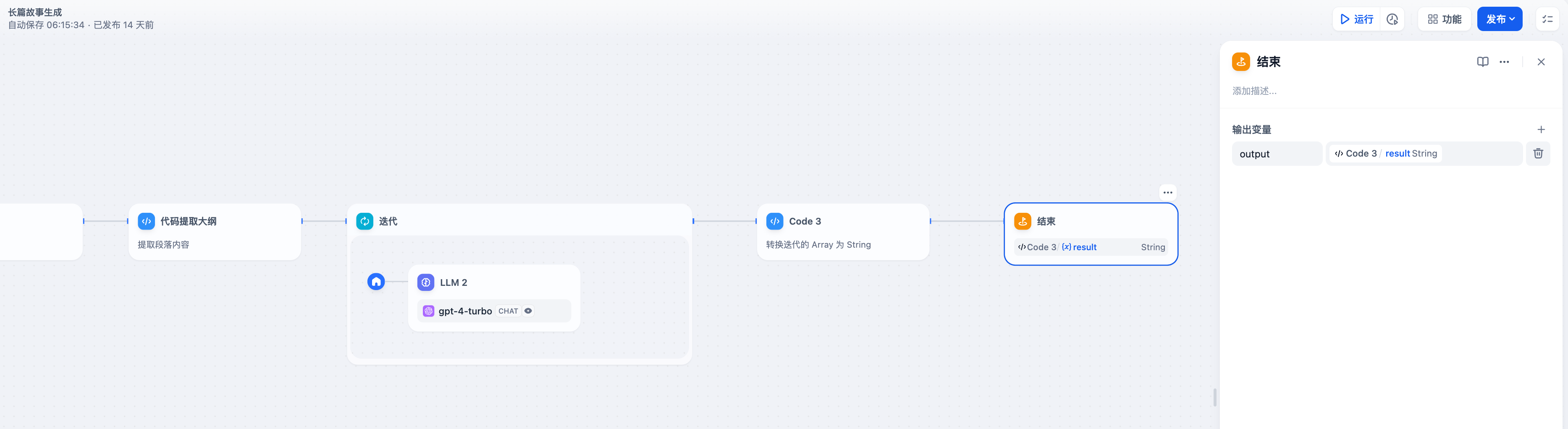

In the following [long story generation workflow](/en/guides/workflow/nodes/iteration#example-2-long-article-iterative-generation-another-scheduling-method), the variable `Output` declared by the end node is the output of the upstream code node. This means the workflow will end after the Code node completes execution and will output the execution result of Code.

|

||||

|

||||

|

||||

|

||||

**Single Path Execution Example:**

|

||||

|

||||

|

||||

|

||||

**Multi-Path Execution Example:**

|

||||

|

||||

|

||||

65

en/guides/workflow/node/http-request.mdx

Normal file

65

en/guides/workflow/node/http-request.mdx

Normal file

@@ -0,0 +1,65 @@

|

||||

---

|

||||

title: HTTP Request

|

||||

---

|

||||

|

||||

|

||||

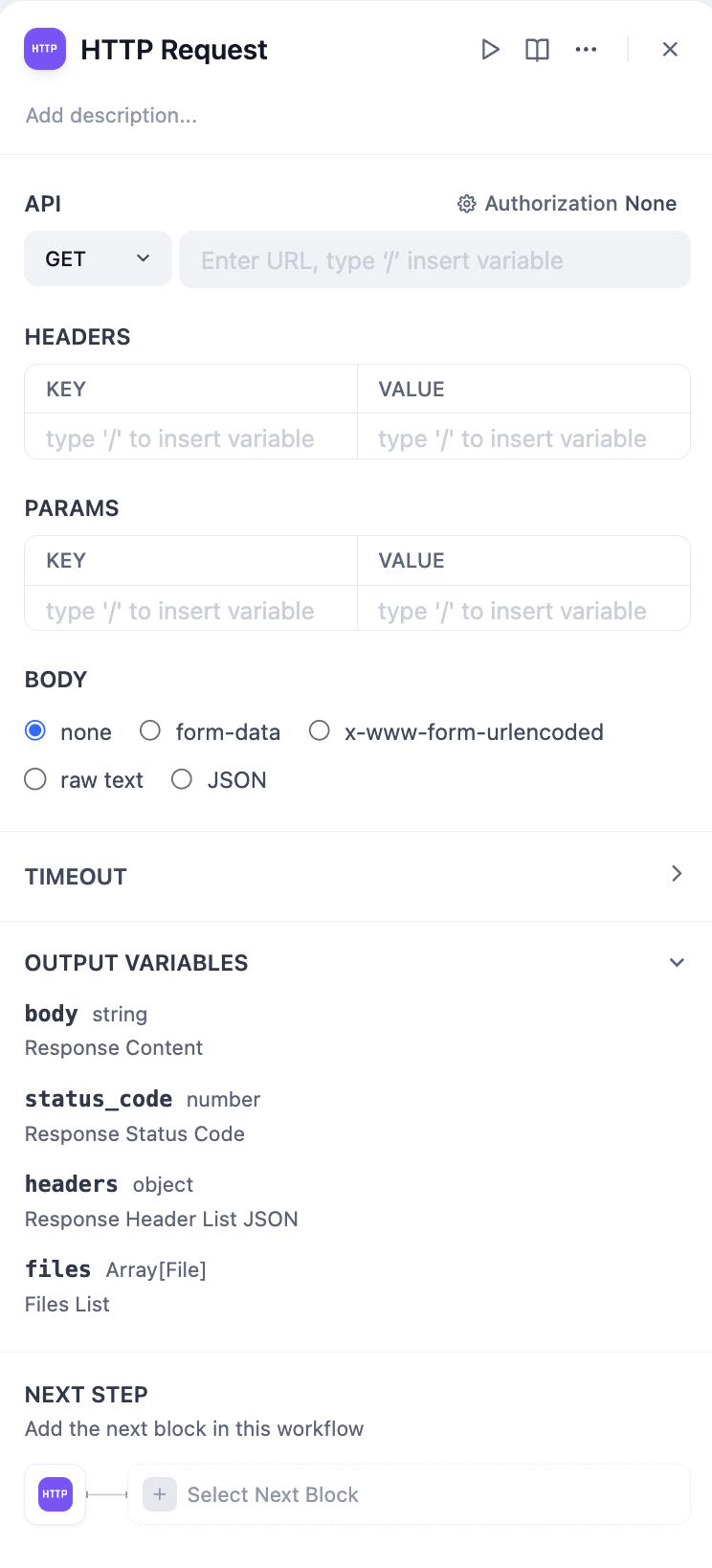

### Definition

|

||||

|

||||

Allows sending server requests via the HTTP protocol, suitable for scenarios such as retrieving external data, webhooks, generating images, and downloading files. It enables you to send customized HTTP requests to specified web addresses, achieving interconnectivity with various external services.

|

||||

|

||||

This node supports common HTTP request methods:

|

||||

|

||||

* **GET**: Used to request the server to send a specific resource.

|

||||

* **POST**: Used to submit data to the server, typically for submitting forms or uploading files.

|

||||

* **HEAD**: Similar to GET requests, but the server only returns the response headers without the resource body.

|

||||

* **PATCH**: Used to apply partial modifications to a resource.

|

||||

* **PUT**: Used to upload resources to the server, typically for updating an existing resource or creating a new one.

|

||||

* **DELETE**: Used to request the server to delete a specified resource.

|

||||

|

||||

You can configure various aspects of the HTTP request, including URL, request headers, query parameters, request body content, and authentication information.

|

||||

|

||||

|

||||

|

||||

***

|

||||

|

||||

### Scenarios

|

||||

|

||||

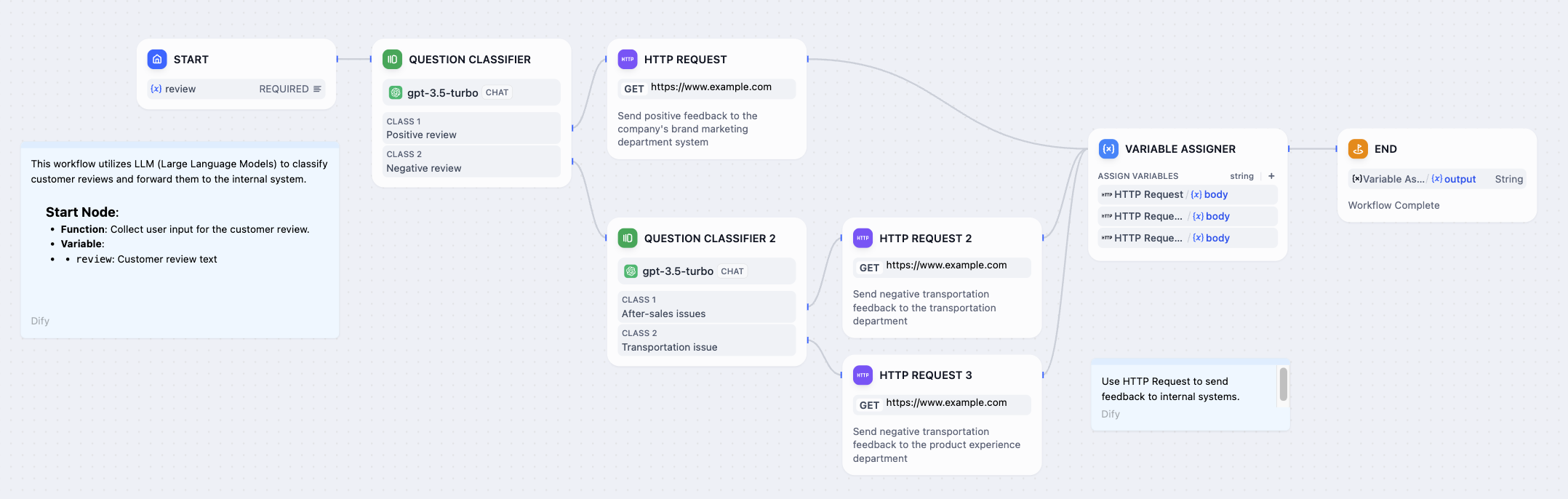

* **Send Application Interaction Content to a Specific Server**

|

||||

|

||||

One practical feature of this node is the ability to dynamically insert variables into different parts of the request based on the scenario. For example, when handling customer feedback requests, you can embed variables such as username or customer ID, feedback content, etc., into the request to customize automated reply messages or fetch specific customer information and send related resources to a designated server.

|

||||

|

||||

|

||||

|

||||

The return values of an HTTP request include the response body, status code, response headers, and files. Notably, if the response contains a file, this node can automatically save the file for use in subsequent steps of the workflow. This design not only improves processing efficiency but also makes handling responses with files straightforward and direct.

|

||||

|

||||

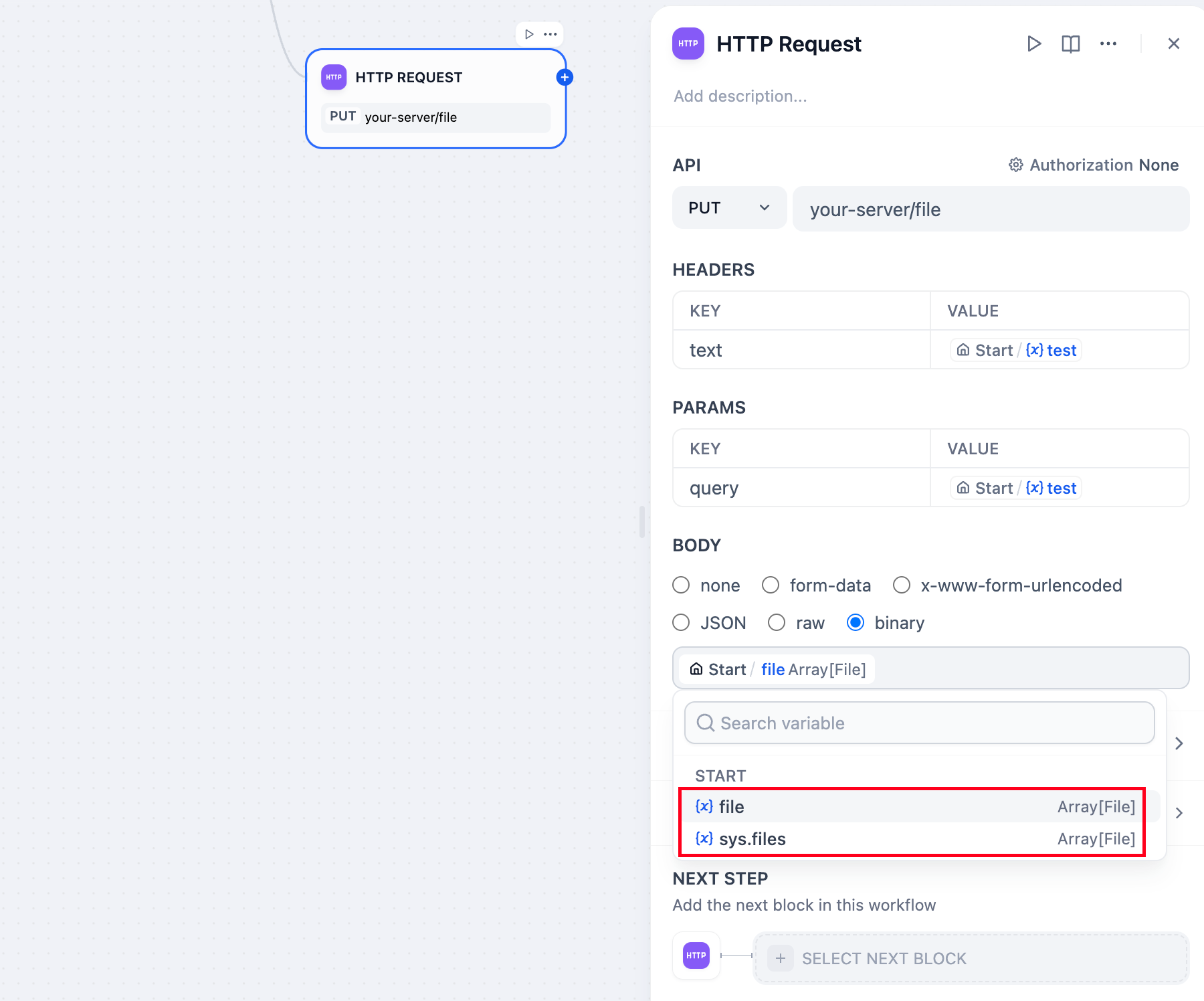

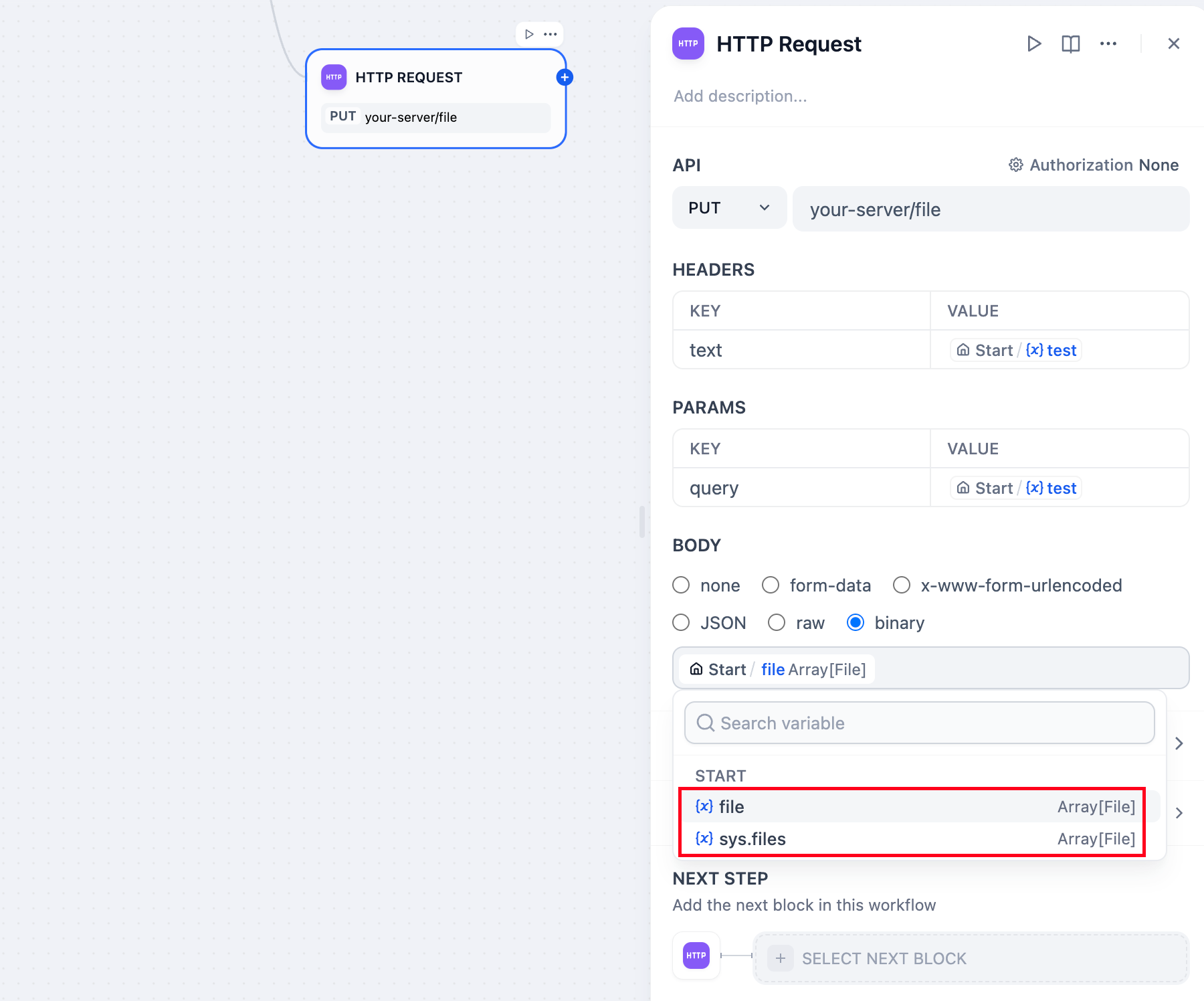

* **Send File**

|

||||

|

||||

You can use an HTTP PUT request to send files from the application to other API services. In the request body, you can select the file variable within the `binary`. This method is commonly used in scenarios such as file transfer, document storage, or media processing.

|

||||

|

||||

Example: Suppose you are developing a document management application and need to send a user-uploaded PDF file to a third-party service. You can use an HTTP request node to pass the file variable.

|

||||

|

||||

Here is a configuration example:

|

||||

|

||||

|

||||

|

||||

### Advanced Features

|

||||

|

||||

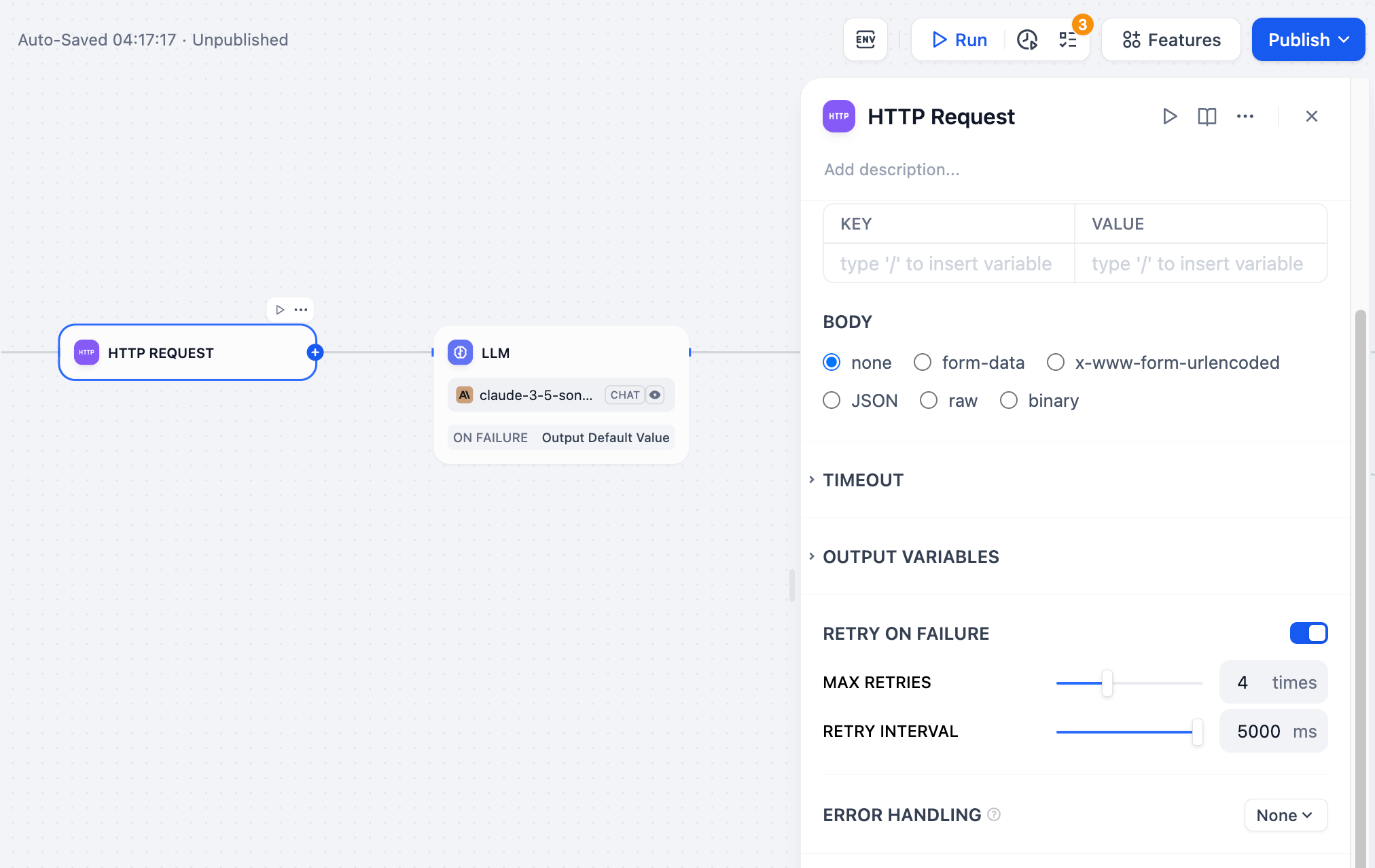

**Retry on Failure**

|

||||

|

||||

For some exceptions that occur in the node, it is usually sufficient to retry the node again. When the error retry function is enabled, the node will automatically retry according to the preset strategy when an error occurs. You can adjust the maximum number of retries and the interval between each retry to set the retry strategy.

|

||||

|

||||

- The maximum number of retries is 10

|

||||

- The maximum retry interval is 5000 ms

|

||||

|

||||

|

||||

|

||||

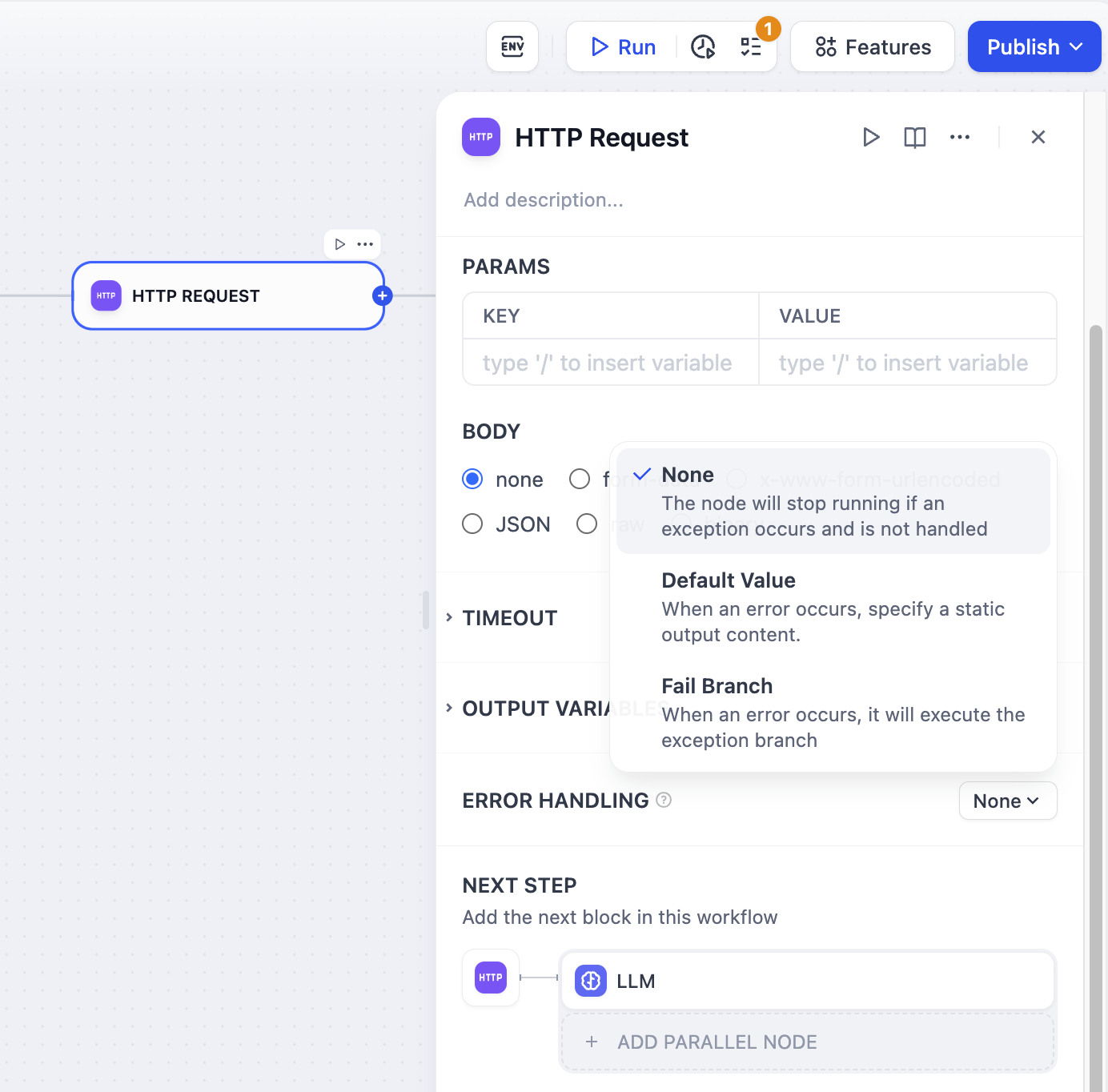

**Error Handling**

|

||||

|

||||

When processing information, HTTP nodes may encounter exceptional situations such as network request timeouts or request limits. Application developers can follow these steps to configure fail branches, enabling contingency plans when nodes encounter exceptions and avoiding workflow interruptions.

|

||||

|

||||

1. Enable "Error Handling" in the HTTP node

|

||||

2. Select and configure an error handling strategy

|

||||

|

||||

For more information about exception handling approaches, please refer to [Error Handling](/en/guides/workflow/error-handling).

|

||||

|

||||

|

||||

47

en/guides/workflow/node/ifelse.mdx

Normal file

47

en/guides/workflow/node/ifelse.mdx

Normal file

@@ -0,0 +1,47 @@

|

||||

---

|

||||

title: Conditional Branch IF/ELSE

|

||||

---

|

||||

|

||||

|

||||

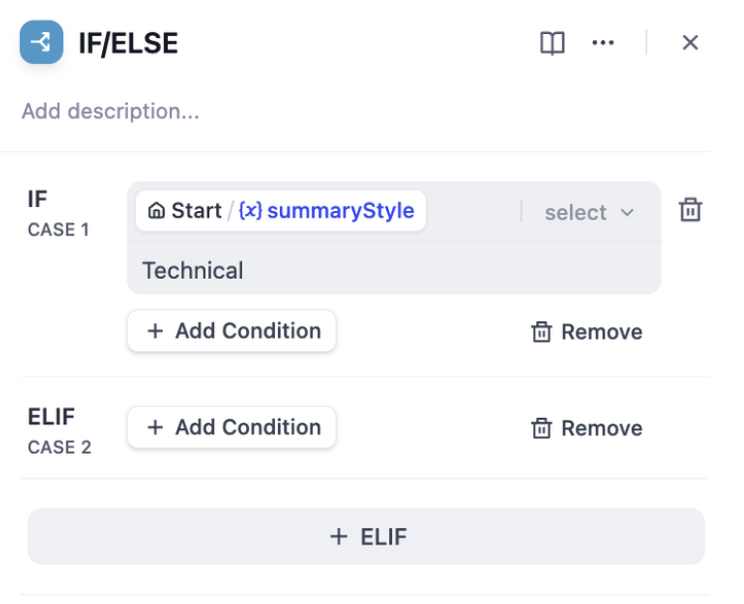

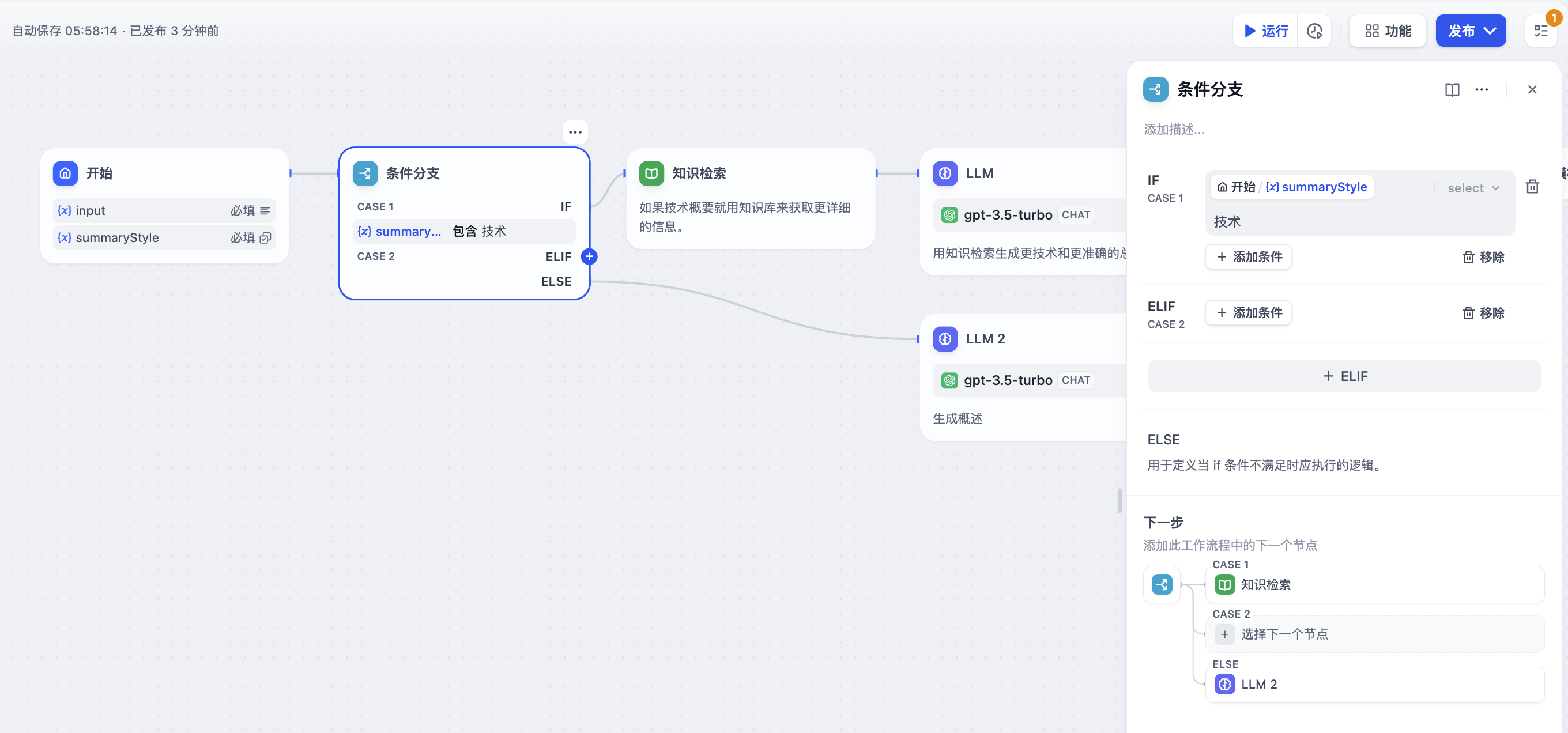

### Definition

|

||||

|

||||

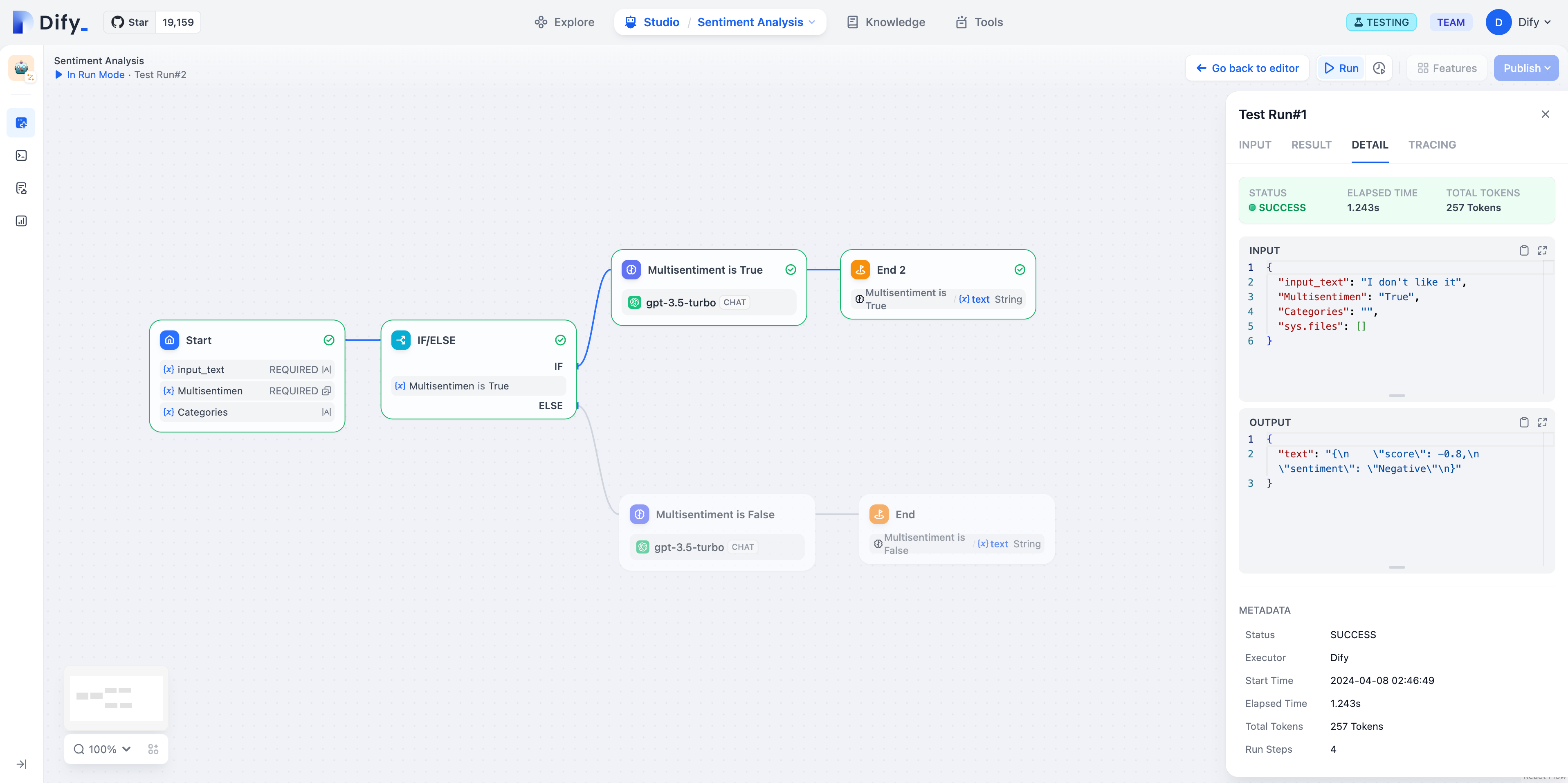

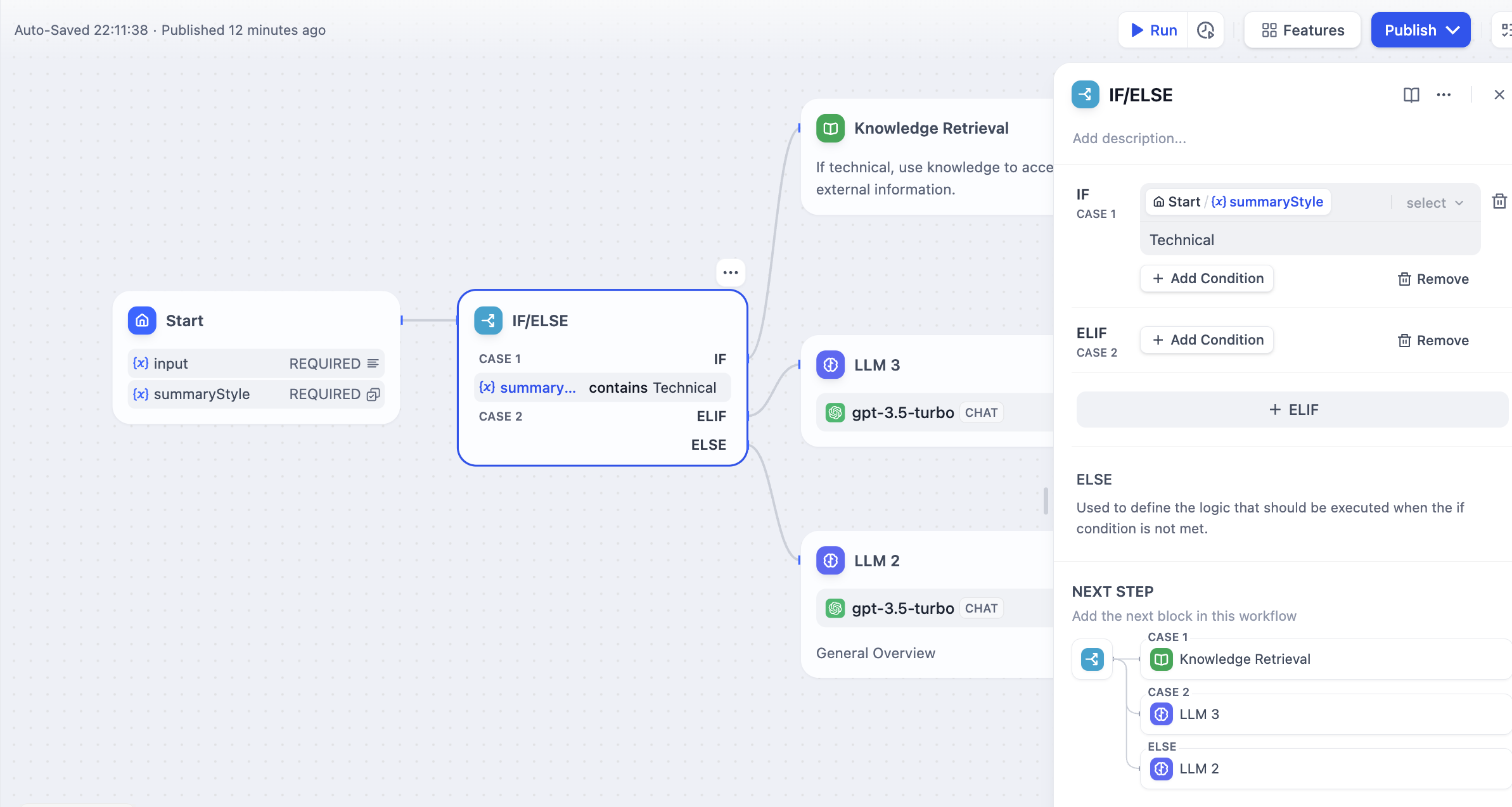

Allows you to split the workflow into two branches based on if/else conditions.

|

||||

|

||||

A conditional branching node has three parts:

|

||||

|

||||

* IF Condition: Select a variable, set the condition, and specify the value that satisfies the condition.

|

||||

* IF condition evaluates to `True`, execute the IF path.

|

||||

* IF condition evaluates to `False`, execute the ELSE path.

|

||||

* If the ELIF condition evaluates to `True`, execute the ELIF path;

|

||||

* If the ELIF condition evaluates to `False`, continue to evaluate the next ELIF path or execute the final ELSE path.

|

||||

|

||||

**Condition Types**

|

||||

|

||||

* Contains

|

||||

* Not contains

|

||||

* Starts with

|

||||

* Ends with

|

||||

* Is

|

||||

* Is not

|

||||

* Is empty

|

||||

* Is not empty

|

||||

|

||||

***

|

||||

|

||||

### Scenario

|

||||

|

||||

|

||||

|

||||

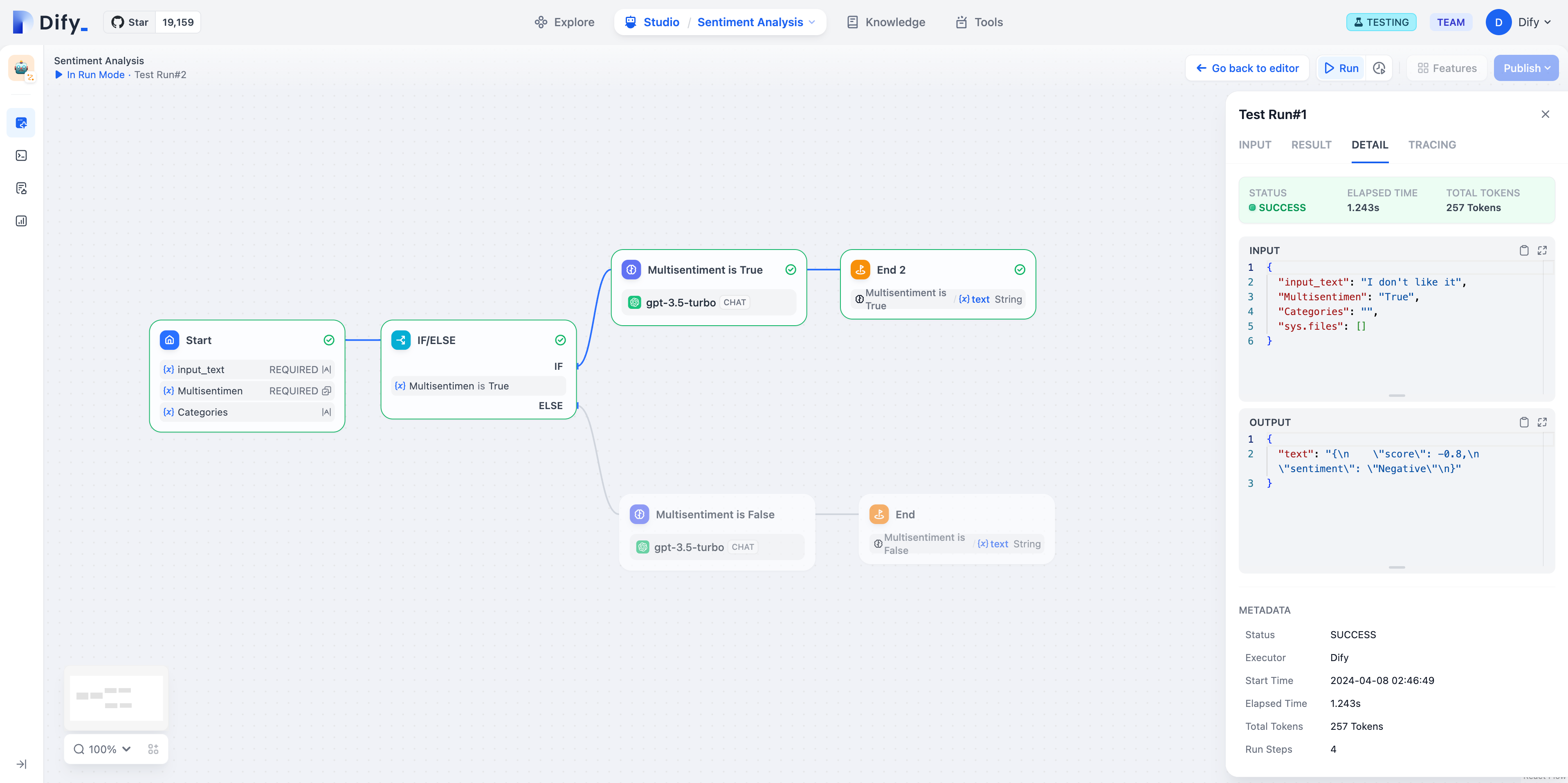

Taking the above **Text Summary Workflow** as an example:

|

||||

|

||||

* IF Condition: Select the `summarystyle` variable from the start node, with the condition **Contains** `technical`.

|

||||

* IF condition evaluates to `True`, follow the IF path by querying technology-related knowledge through the knowledge retrieval node, then respond via the LLM node (as shown in the upper half of the diagram);

|

||||

* IF condition evaluates to `False`, but an `ELIF` condition is added, where the input for the `summarystyle` variable **does not include** `technology`, yet the `ELIF` condition includes `science`, check if the condition in `ELIF` is `True`, then execute the steps defined within that path;

|

||||

* If the condition within `ELIF` is `False`, meaning the input variable contains neither `technology` nor `science`, continue to evaluate the next `ELIF` condition or execute the final `ELSE` path;

|

||||

* IF condition evaluates to `False`, i.e., the `summarystyle` variable input **does not contain** `technical`, execute the ELSE path, responding via the LLM2 node (lower part of the diagram).

|

||||

|

||||

**Multiple Condition Judgments**

|

||||

|

||||

For complex condition judgments, you can set multiple condition judgments and configure **AND** or **OR** between conditions to take the **intersection** or **union** of the conditions, respectively.

|

||||

|

||||

|

||||

186

en/guides/workflow/node/iteration.mdx

Normal file

186

en/guides/workflow/node/iteration.mdx

Normal file

@@ -0,0 +1,186 @@

|

||||

---

|

||||

title: Iteration

|

||||

---

|

||||

|

||||

|

||||

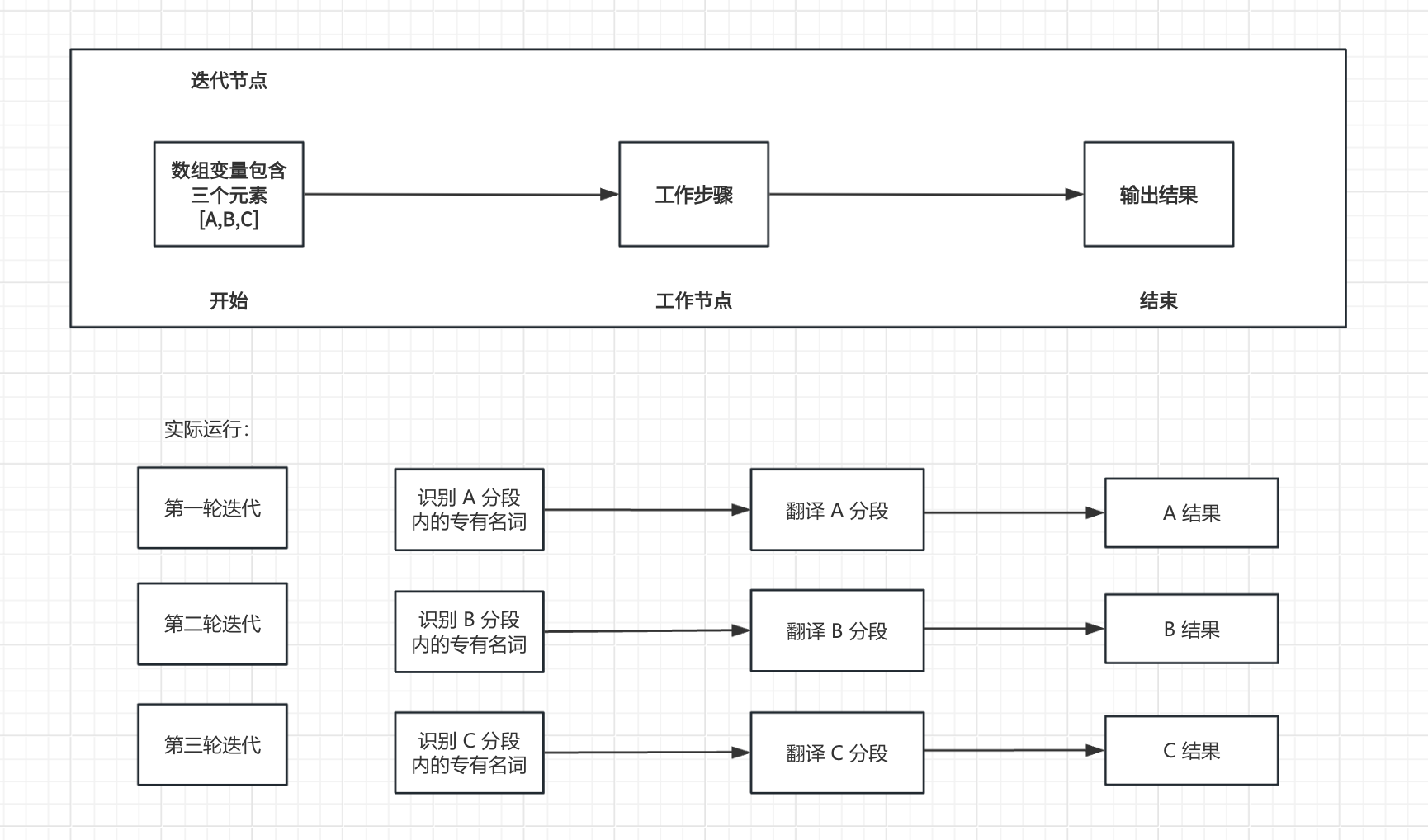

### Definition

|

||||

|

||||

Sequentially performs the same operations on array elements until all results are outputted, functioning as a task batch processor. Iteration nodes typically work in conjunction with array variables.

|

||||

|

||||

For example, when processing long text translations, inputting all content directly into an LLM node may reach the single conversation limit. To address the issue, upstream nodes first split the long text into multiple chunks, then use iteration nodes to perform batch translations, thus avoiding the message limit of a single LLM conversation.

|

||||

|

||||

***

|

||||

|

||||

### Functional Description

|

||||

|

||||

Using iteration nodes requires input values to be formatted as list objects. The node sequentially processes all elements in the array variable from the iteration start node, applying identical processing steps to each element. Each processing cycle is called an iteration, culminating in the final output.

|

||||

|

||||

An iteration node consists of three core components: **Input Variables**, **Iteration Workflow**, and **Output Variables**.

|

||||

|

||||

**Input Variables:** Accepts only Array type data.

|

||||

|

||||

**Iteration Workflow:** Supports multiple workflow nodes to orchestrate task sequences within the iteration node.

|

||||

|

||||

**Output Variables:** Outputs only array variables (`Array[List]`).

|

||||

|

||||

<div class="image-side-by-side">

|

||||

<img

|

||||

src="https://assets-docs.dify.ai/2024/12/7c94bccbb6f8dc4570c69c2bf02ec6d3.png"

|

||||

className="mx-auto"

|

||||

alt=""

|

||||

/>

|

||||

|

||||

<img

|

||||

src="https://assets-docs.dify.ai/dify-enterprise-mintlify/en/guides/workflow/node/d3beee536ff3c35f4e1eb1ab610f35d7.png"

|

||||

className="mx-auto"

|

||||

alt=""

|

||||

/>

|

||||

</div>

|

||||

|

||||

### Scenarios

|

||||

|

||||

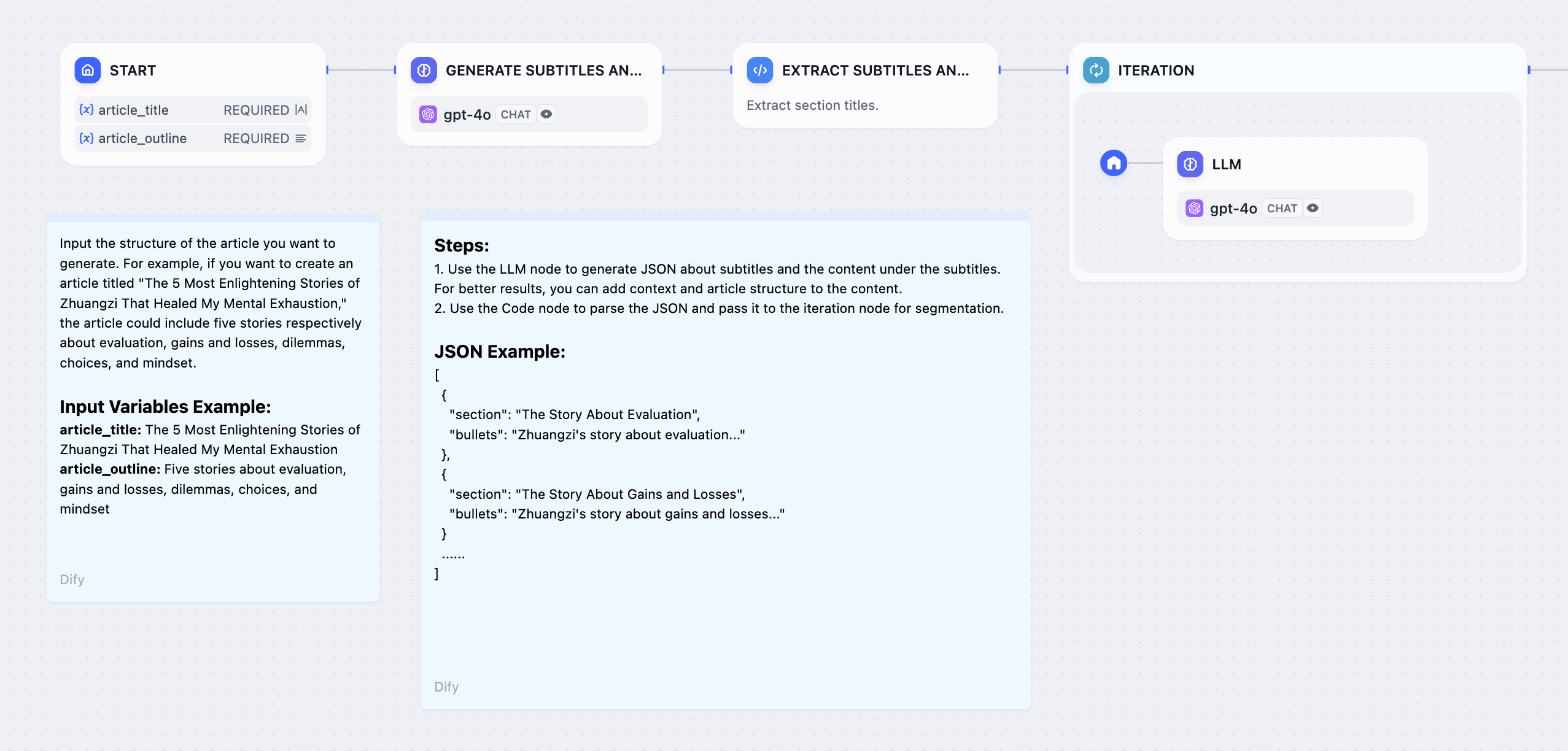

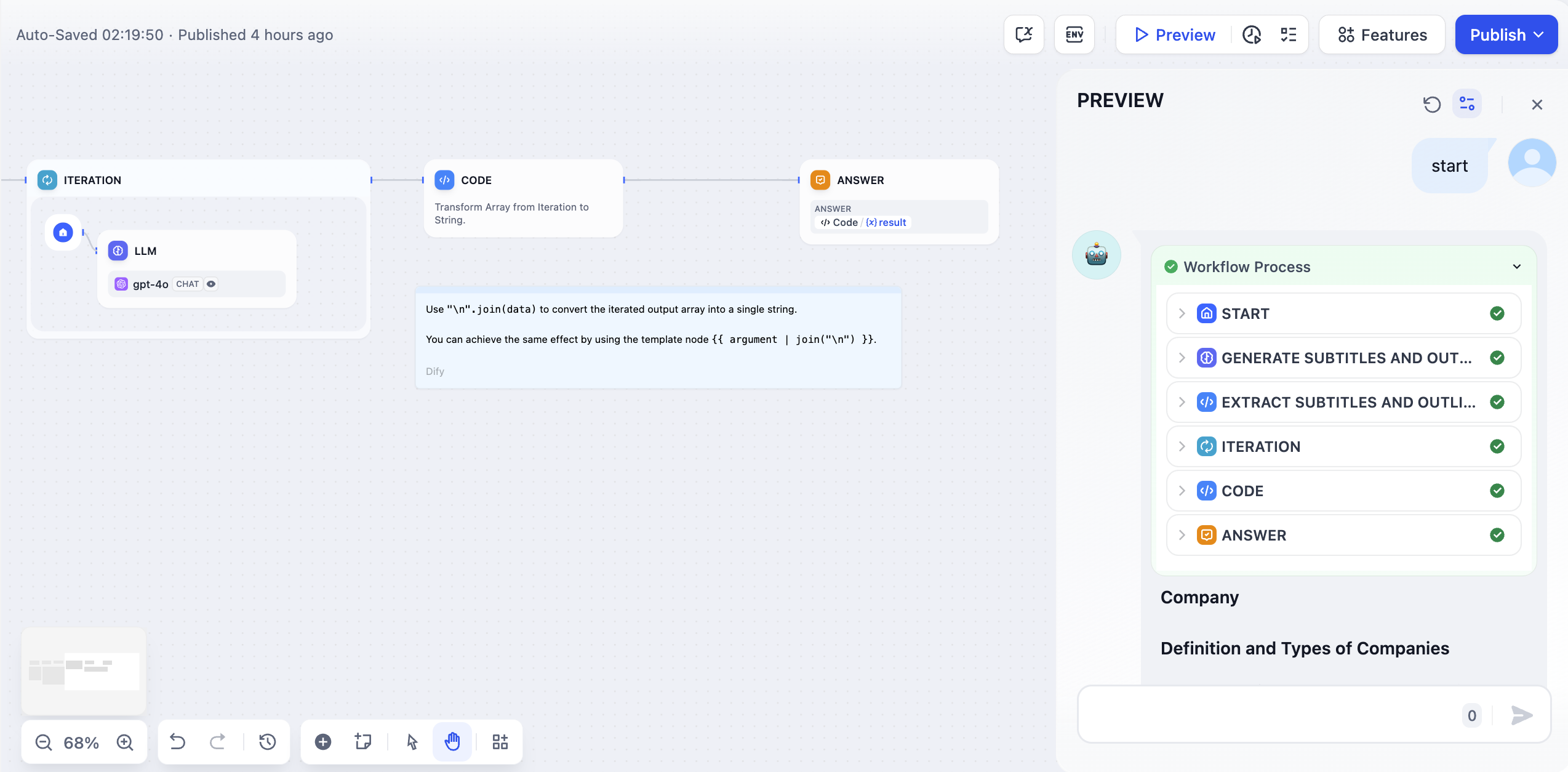

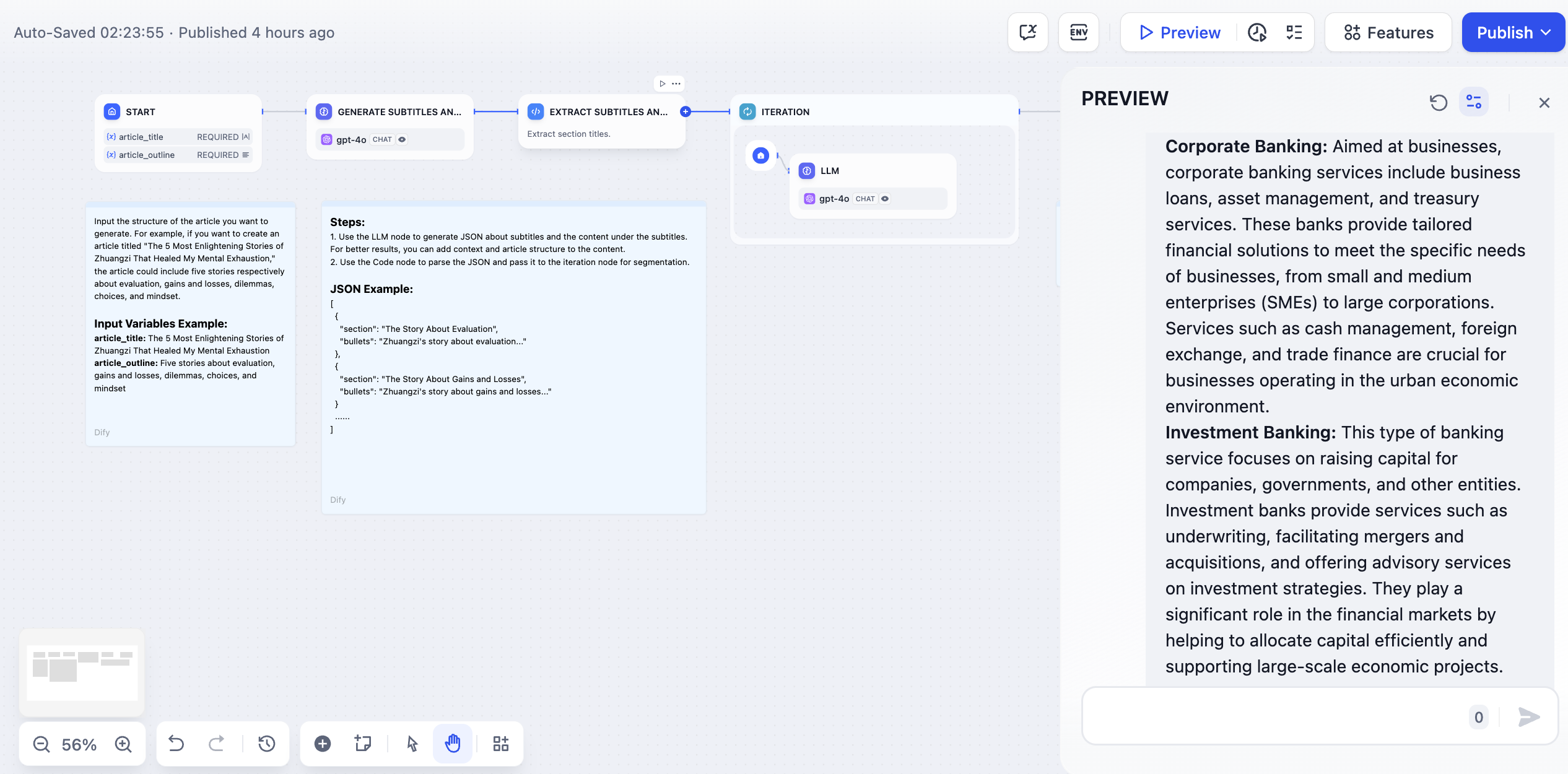

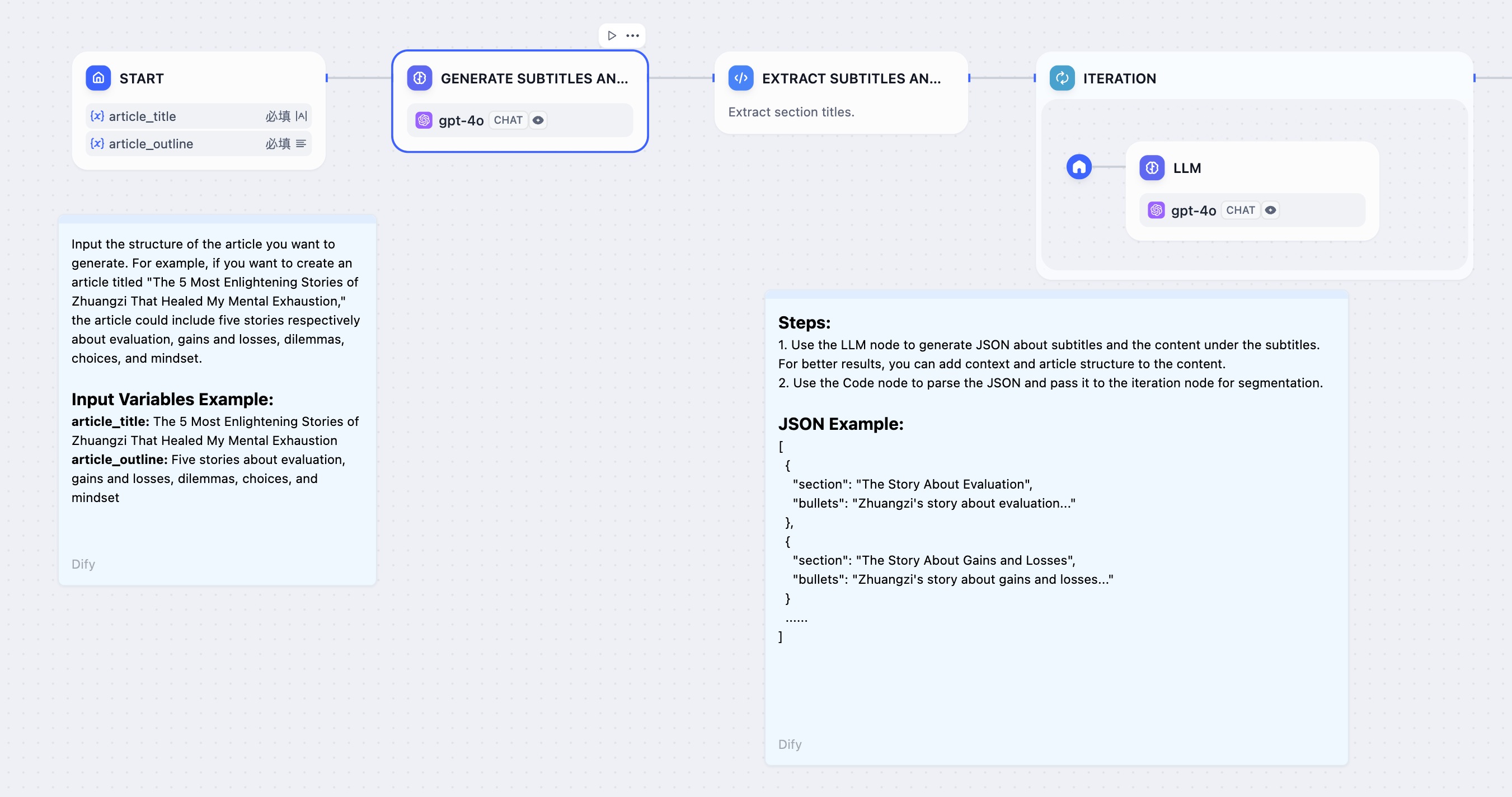

#### **Example 1: Long Article Iteration Generator**

|

||||

|

||||

|

||||

|

||||

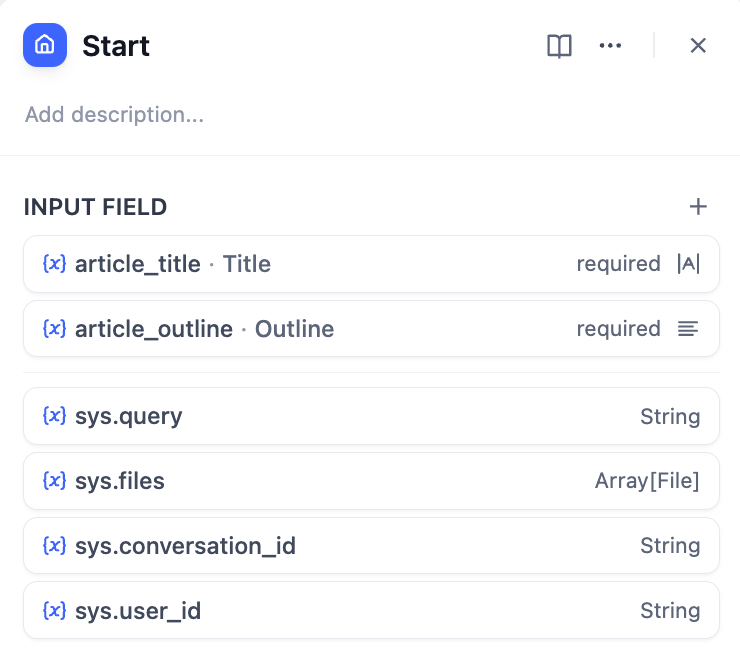

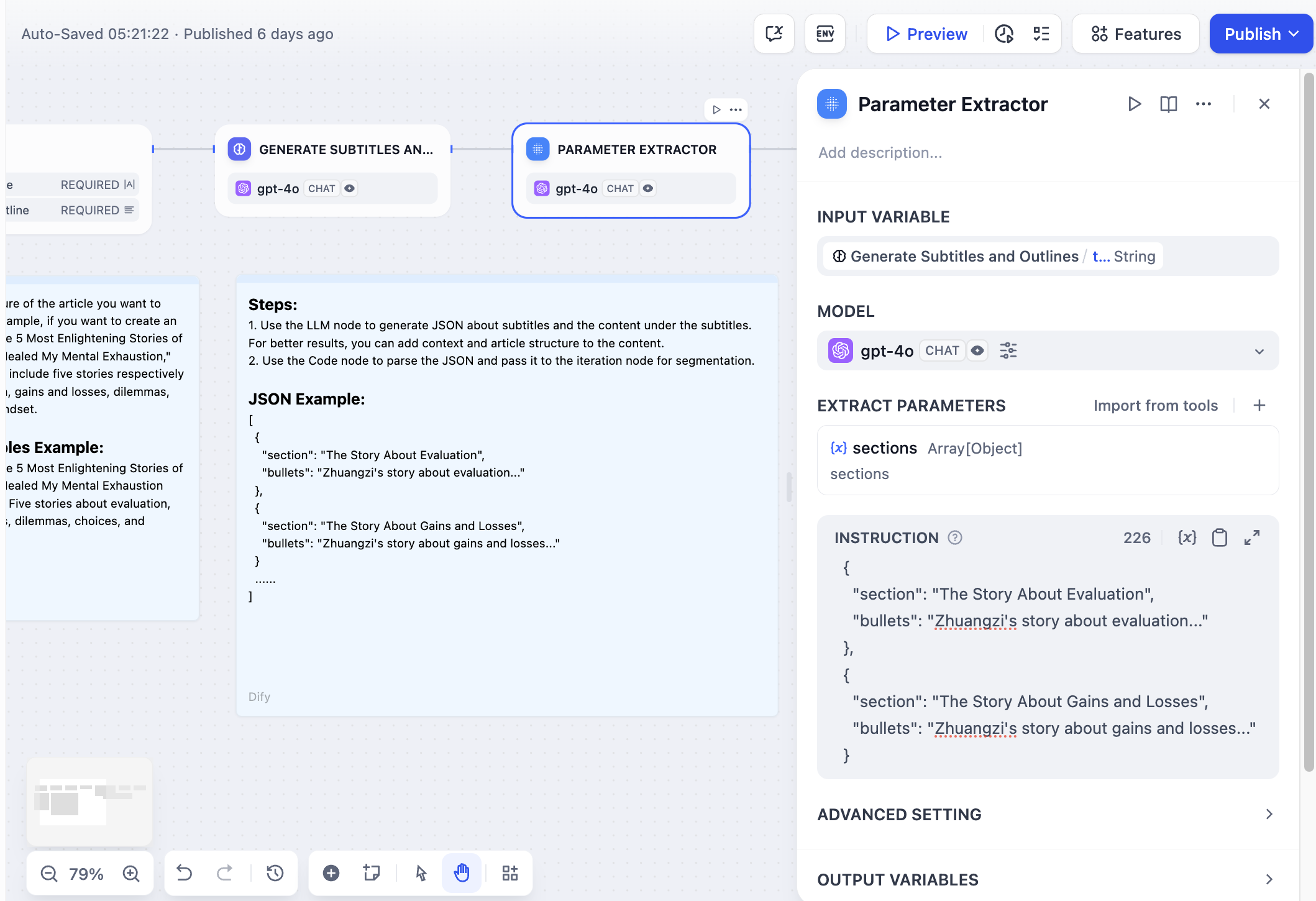

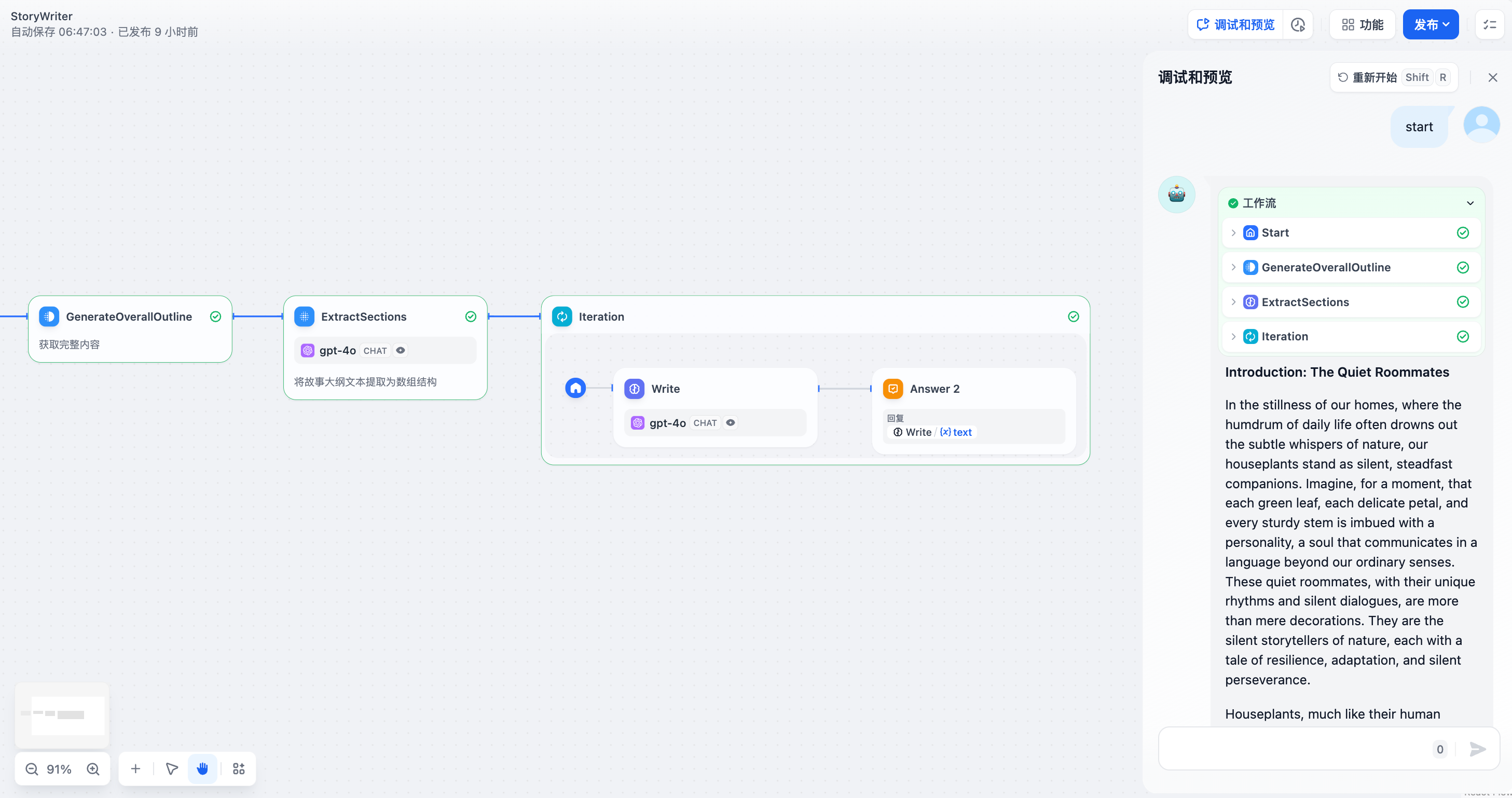

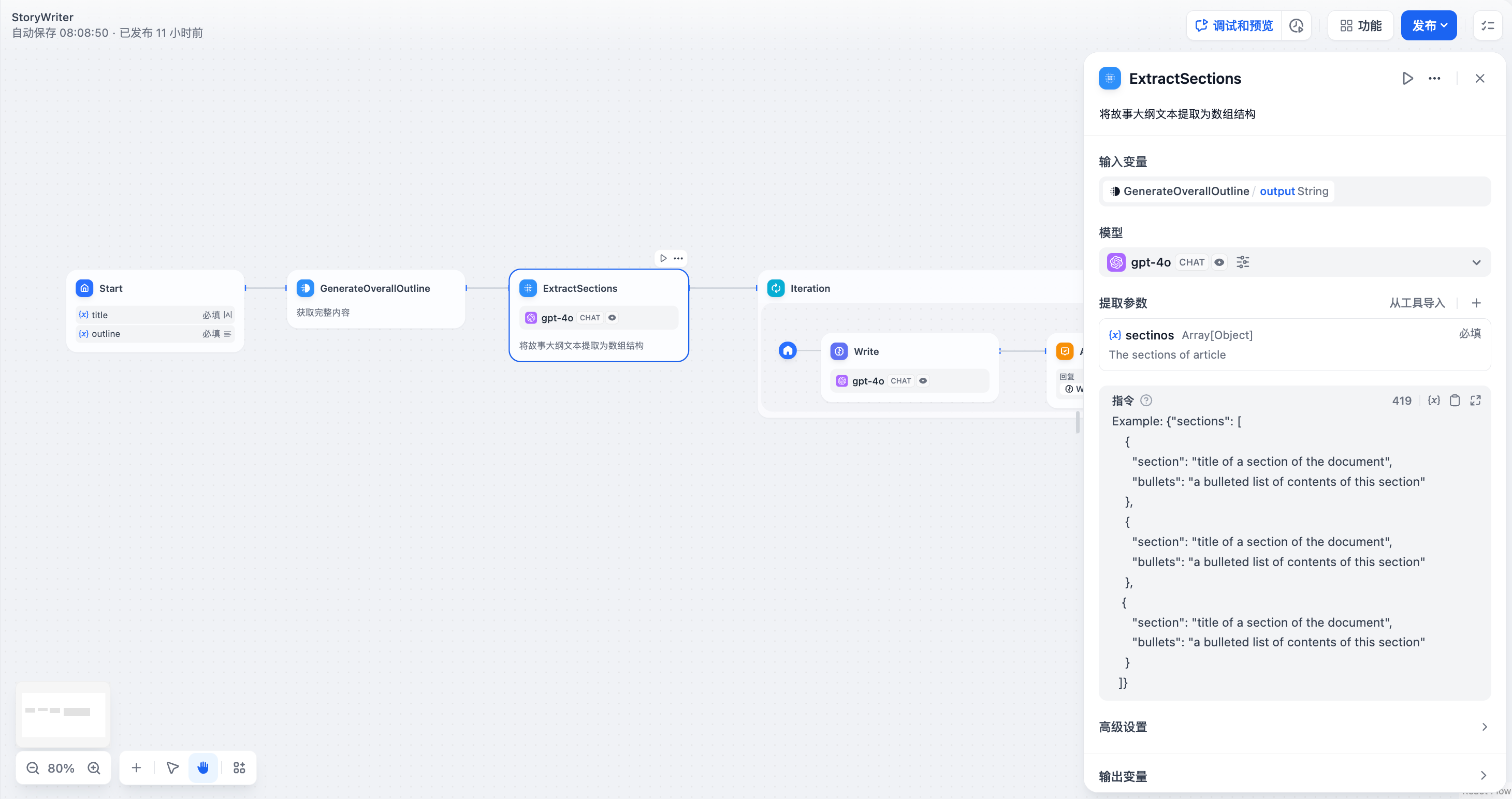

1. Enter the story title and outline in the **Start Node**.

|

||||

2. Use a **Generate Subtitles and Outlines Node** to use LLM to generate the complete content from user input.

|

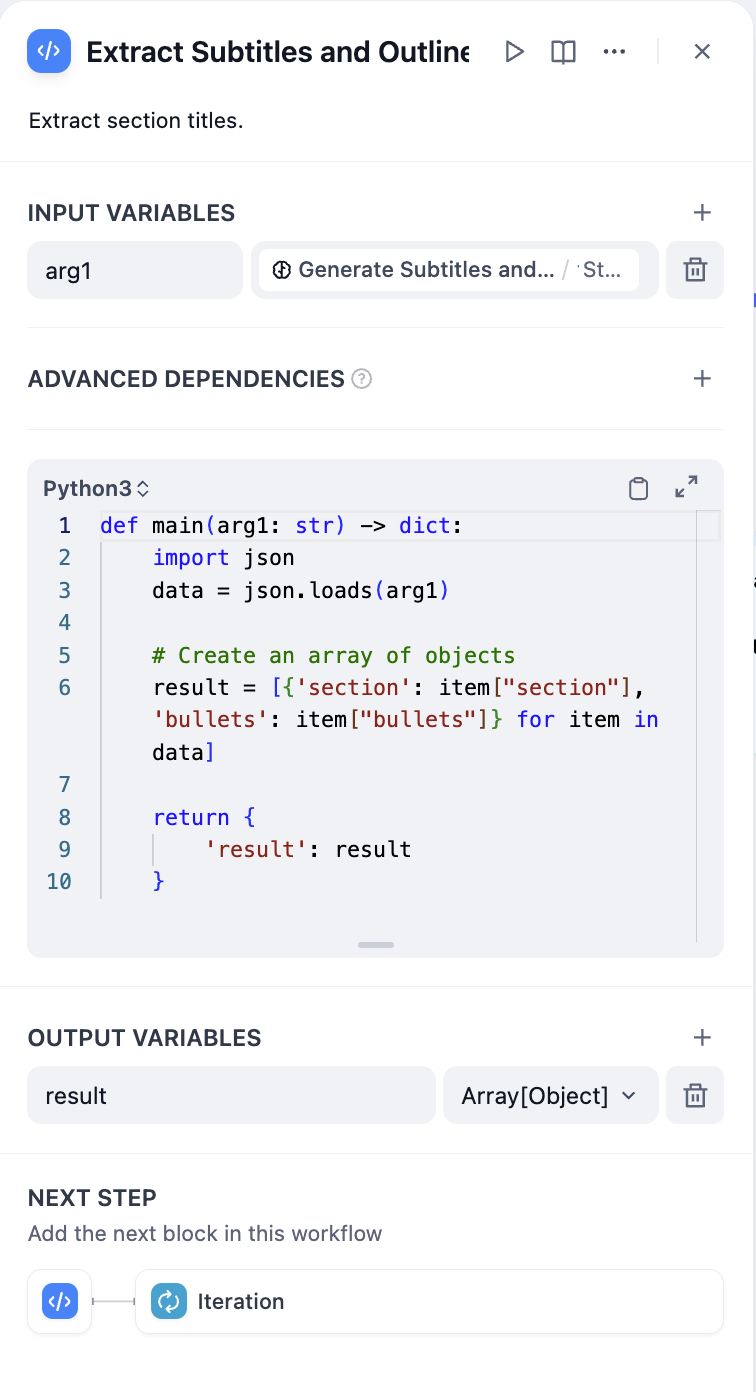

||||

3. Use a **Extract Subtitles and Outlines Node** to convert the complete content into an array format.

|

||||

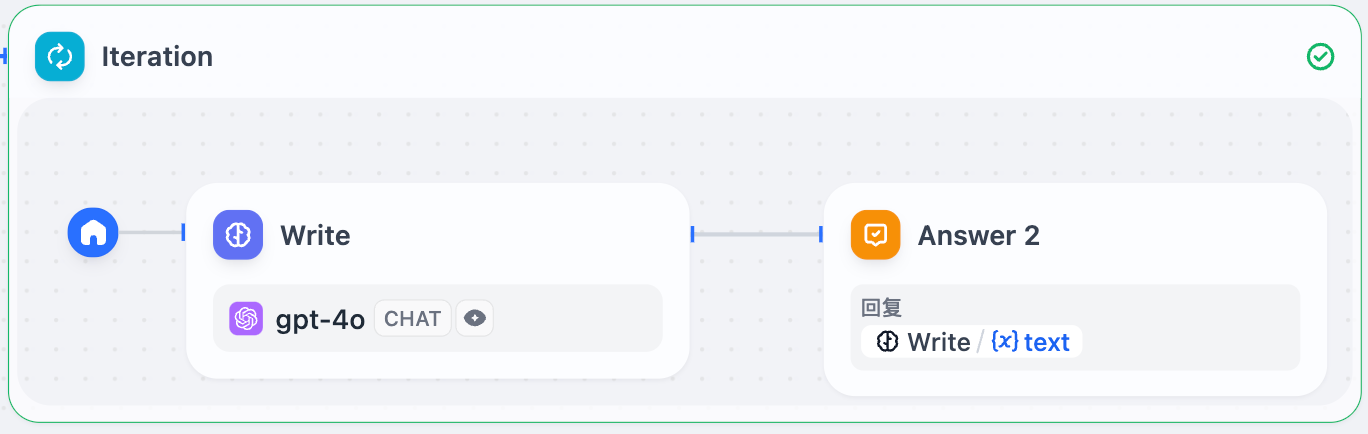

4. Use an **Iteration Node** to wrap an **LLM Node** and generate content for each chapter through multiple iterations.

|

||||

5. Add a **Direct Answer Node** inside the iteration node to achieve streaming output after each iteration.

|

||||

|

||||

**Detailed Configuration Steps**

|

||||

|

||||

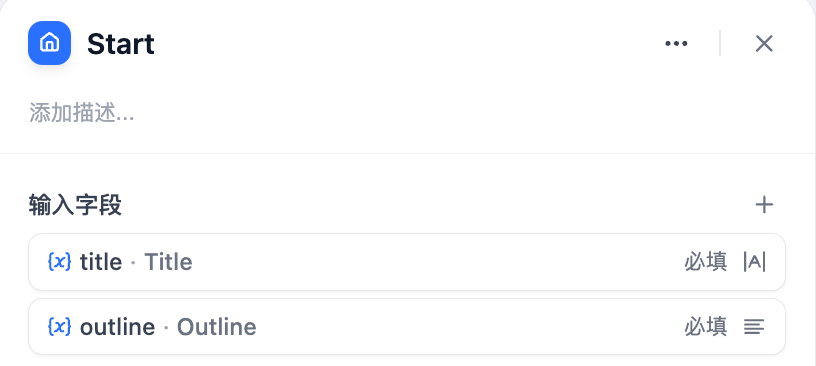

1. Configure the story title (title) and outline (outline) in the **Start Node**.

|

||||

|

||||

|

||||

|

||||

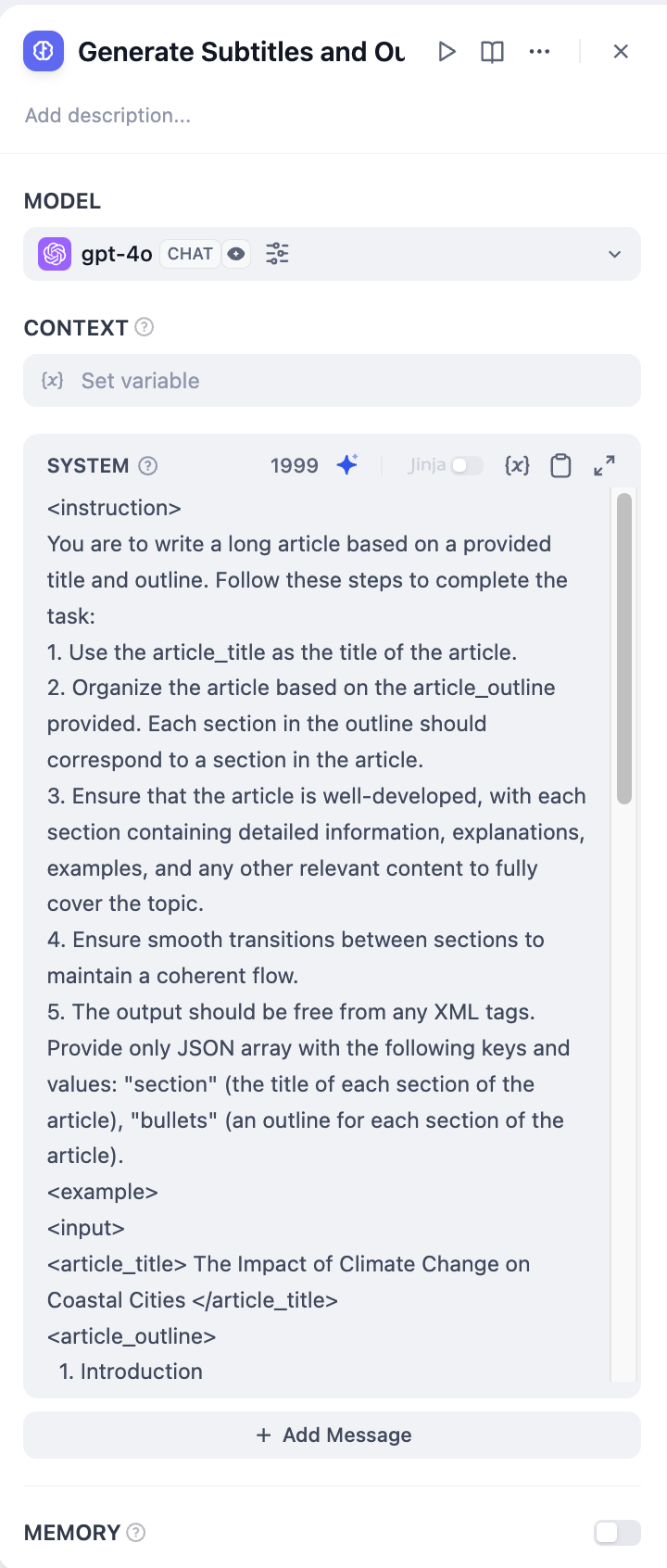

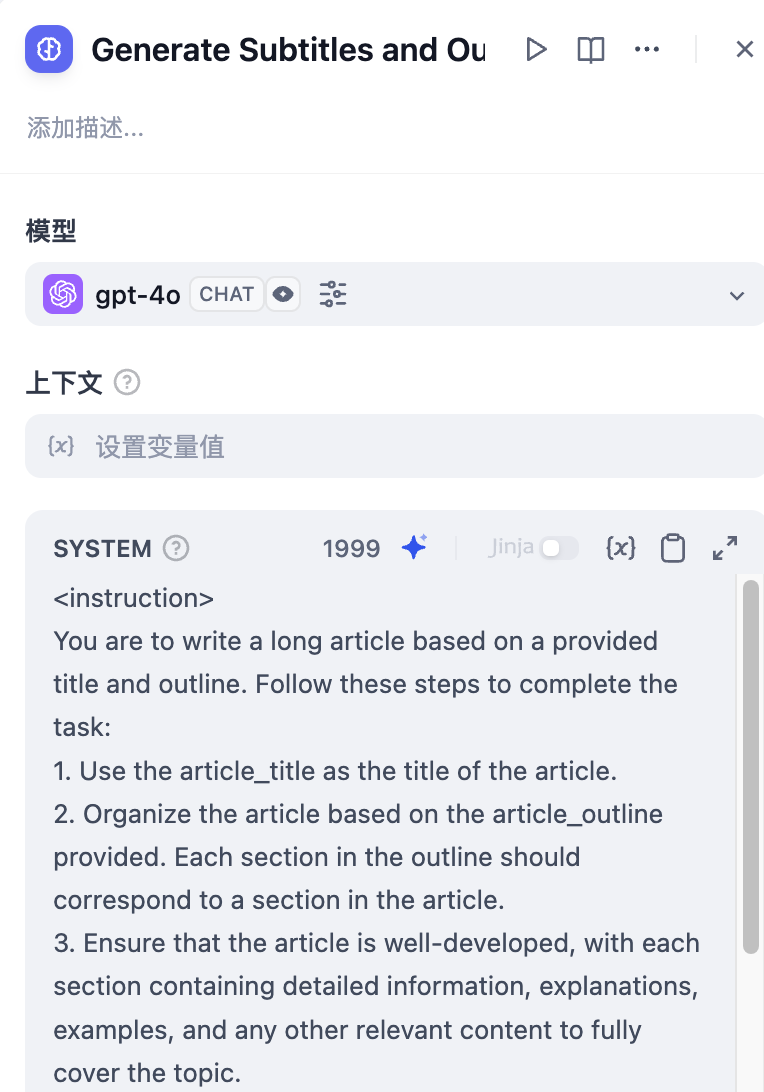

2. Use a **Generate Subtitles and Outlines Node** to convert the story title and outline into complete text.

|

||||

|

||||

|

||||

|

||||

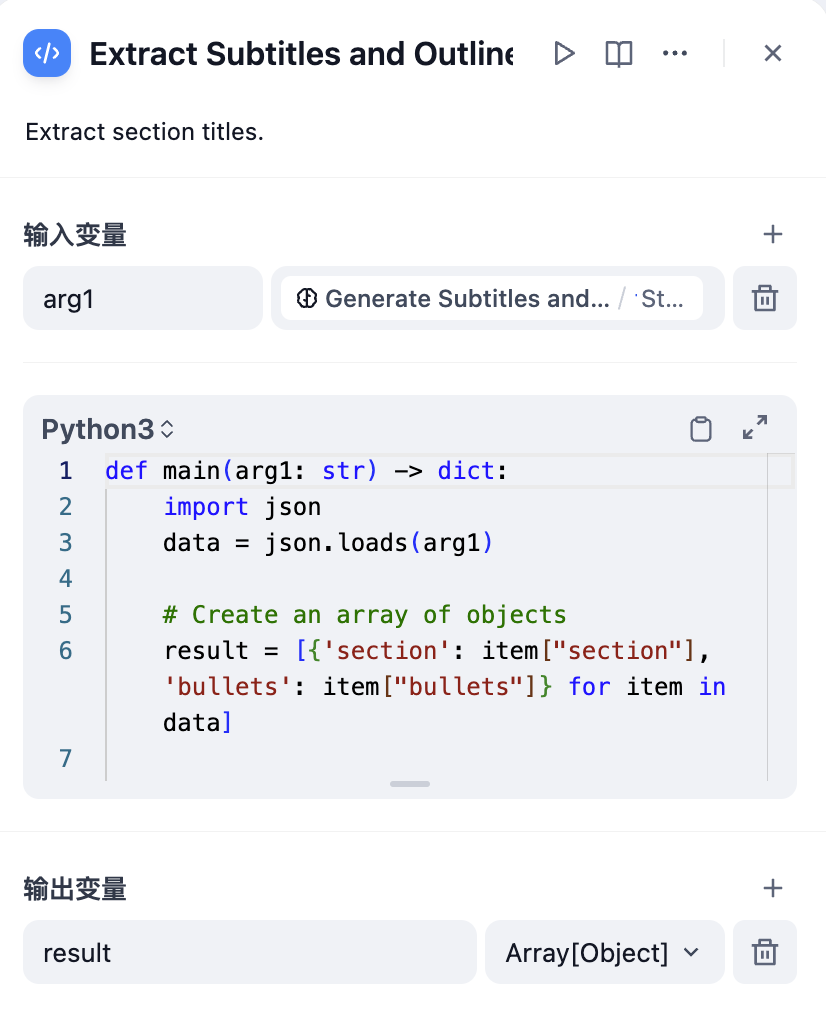

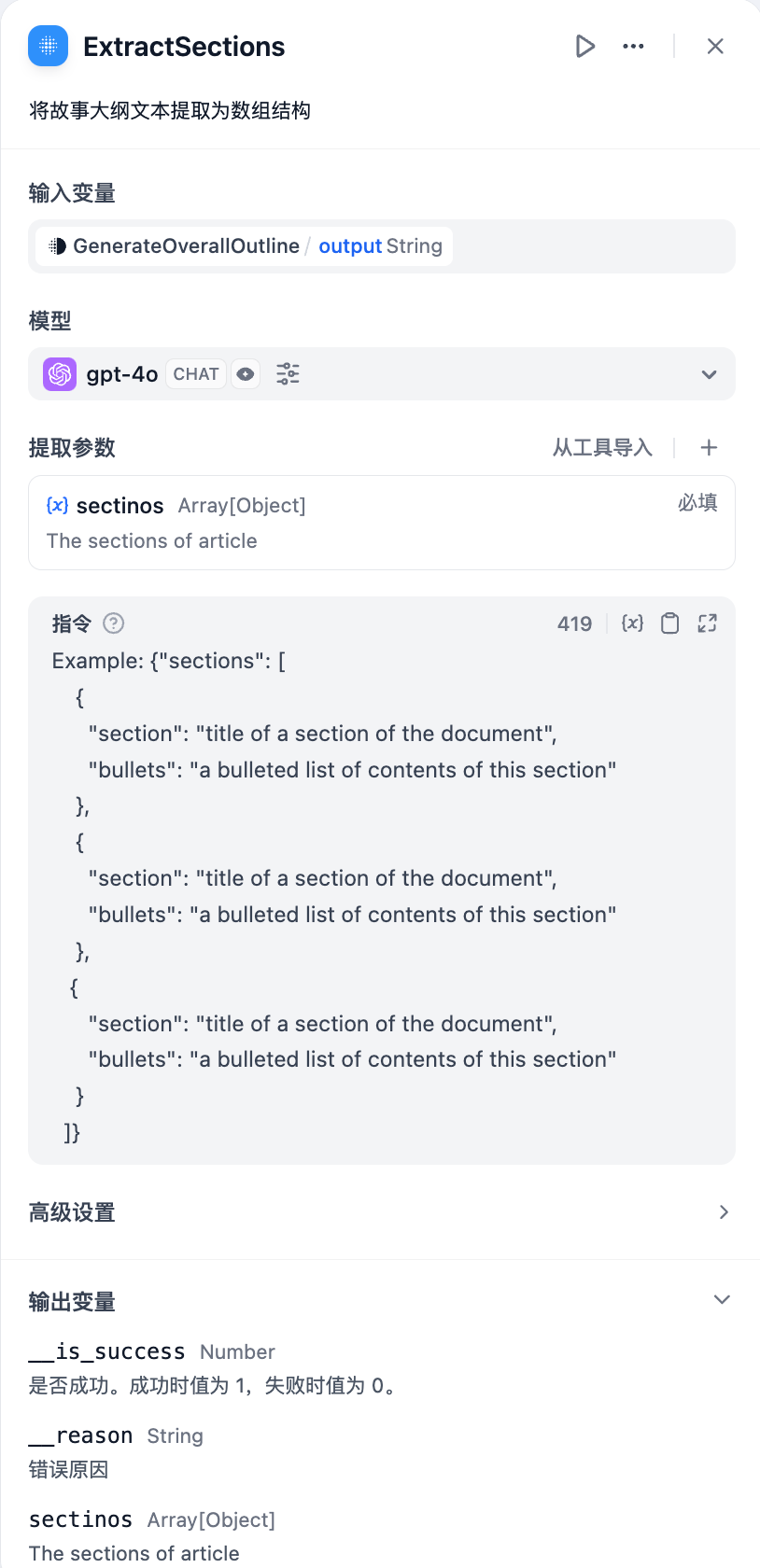

3. Use a **Extract Subtitles and Outlines Node** to convert the story text into an array (Array) structure. The parameter to extract is `sections`, and the parameter type is `Array[Object]`.

|

||||

|

||||

|

||||

|

||||

<Info>

|

||||

The effectiveness of parameter extraction is influenced by the model's inference capability and the instructions given. Using a model with stronger inference capabilities and adding examples in the **instructions** can improve the parameter extraction results.

|

||||

</Info>

|

||||

|

||||

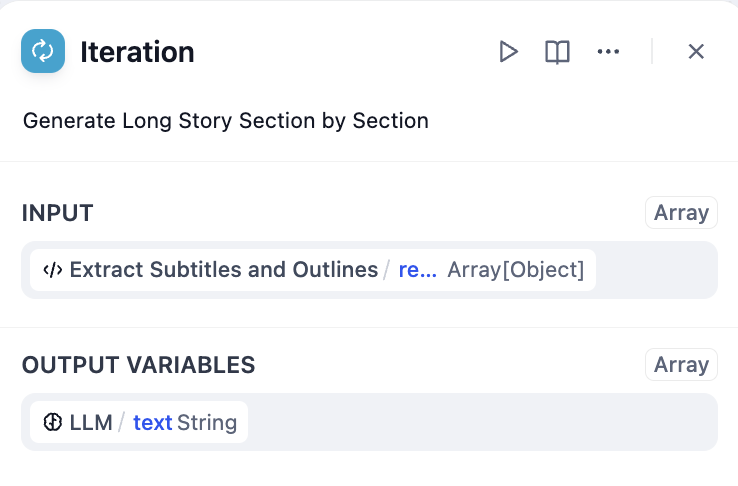

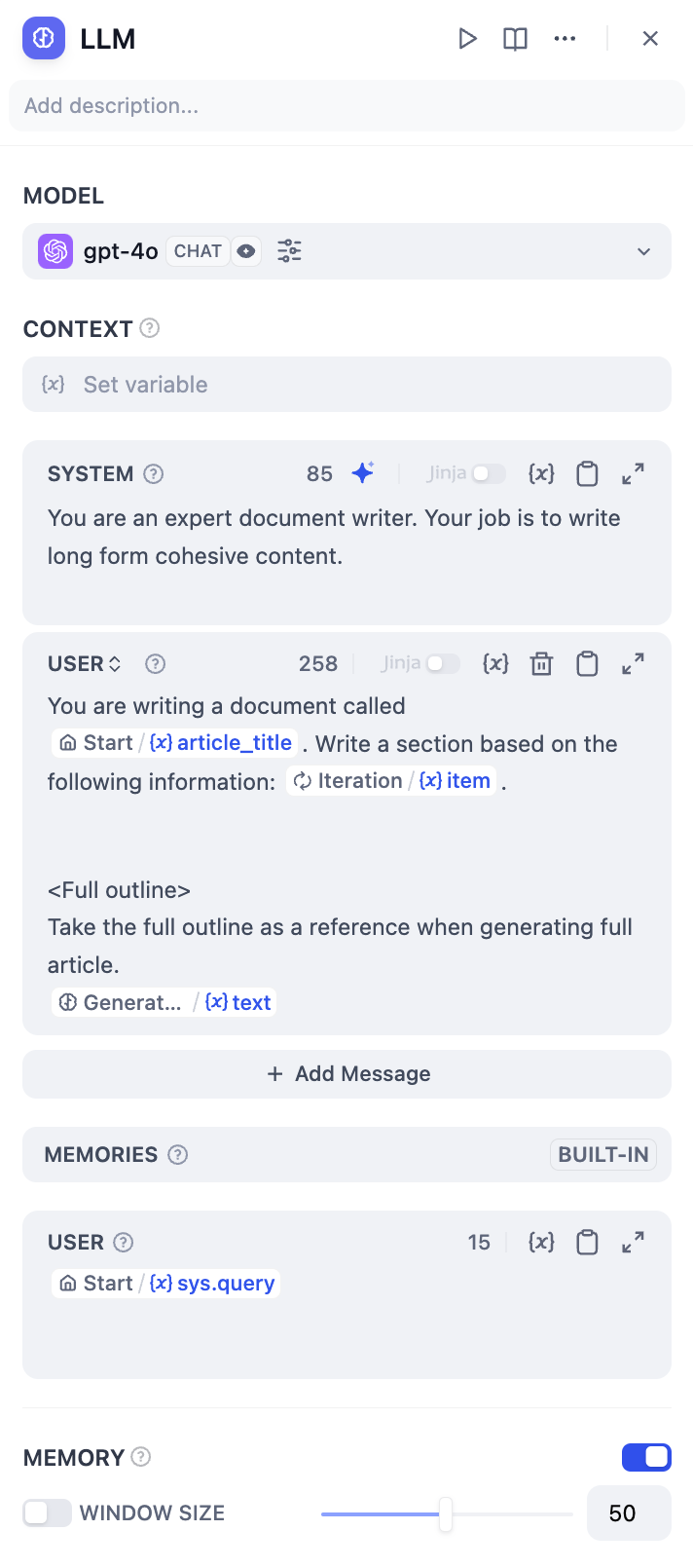

4. Use the array-formatted story outline as the input for the iteration node and process it within the iteration node using an **LLM Node**.

|

||||

|

||||

|

||||

|

||||

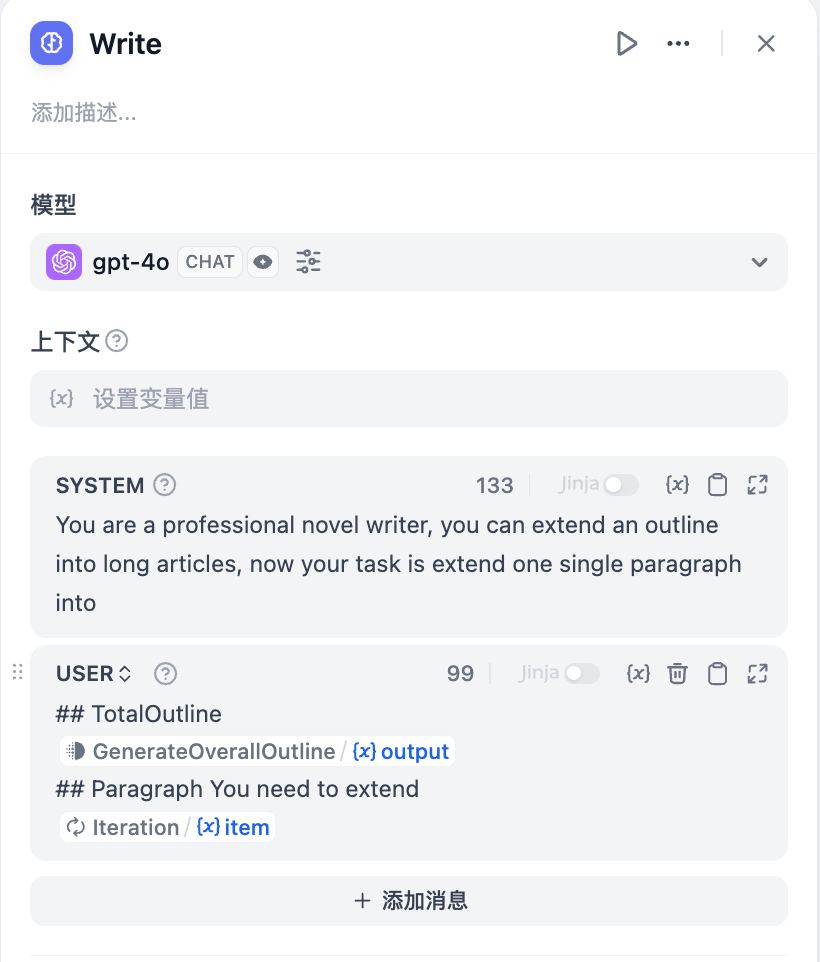

Configure the input variables `GenerateOverallOutline/output` and `Iteration/item` in the LLM Node.

|

||||

|

||||

|

||||

|

||||

<Info>

|

||||

Built-in variables for iteration: `items[object]` and `index[number]`.

|

||||

|

||||

`items[object]` represents the input item for each iteration;

|

||||

|

||||

`index[number]` represents the current iteration round;

|

||||

</Info>

|

||||

|

||||

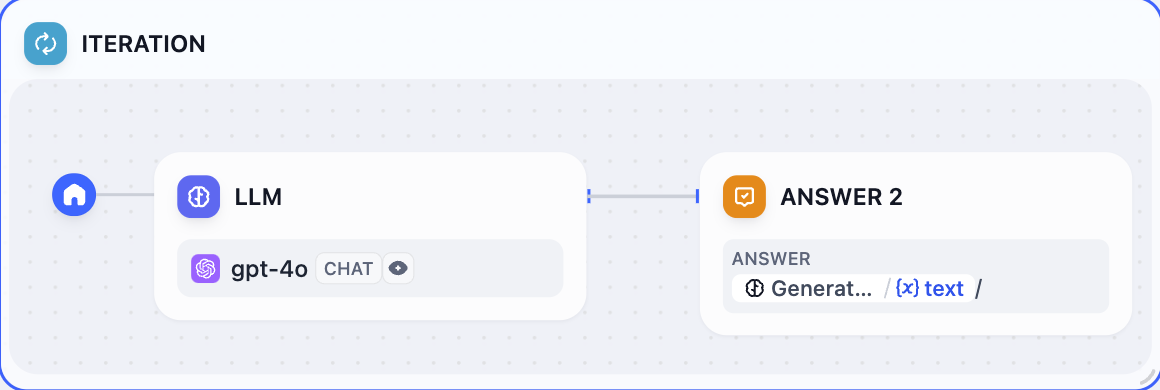

5. Configure a **Direct Reply Node** inside the iteration node to achieve streaming output after each iteration.

|

||||

|

||||

|

||||

|

||||

6. Complete debugging and preview.

|

||||

|

||||

|

||||

|

||||

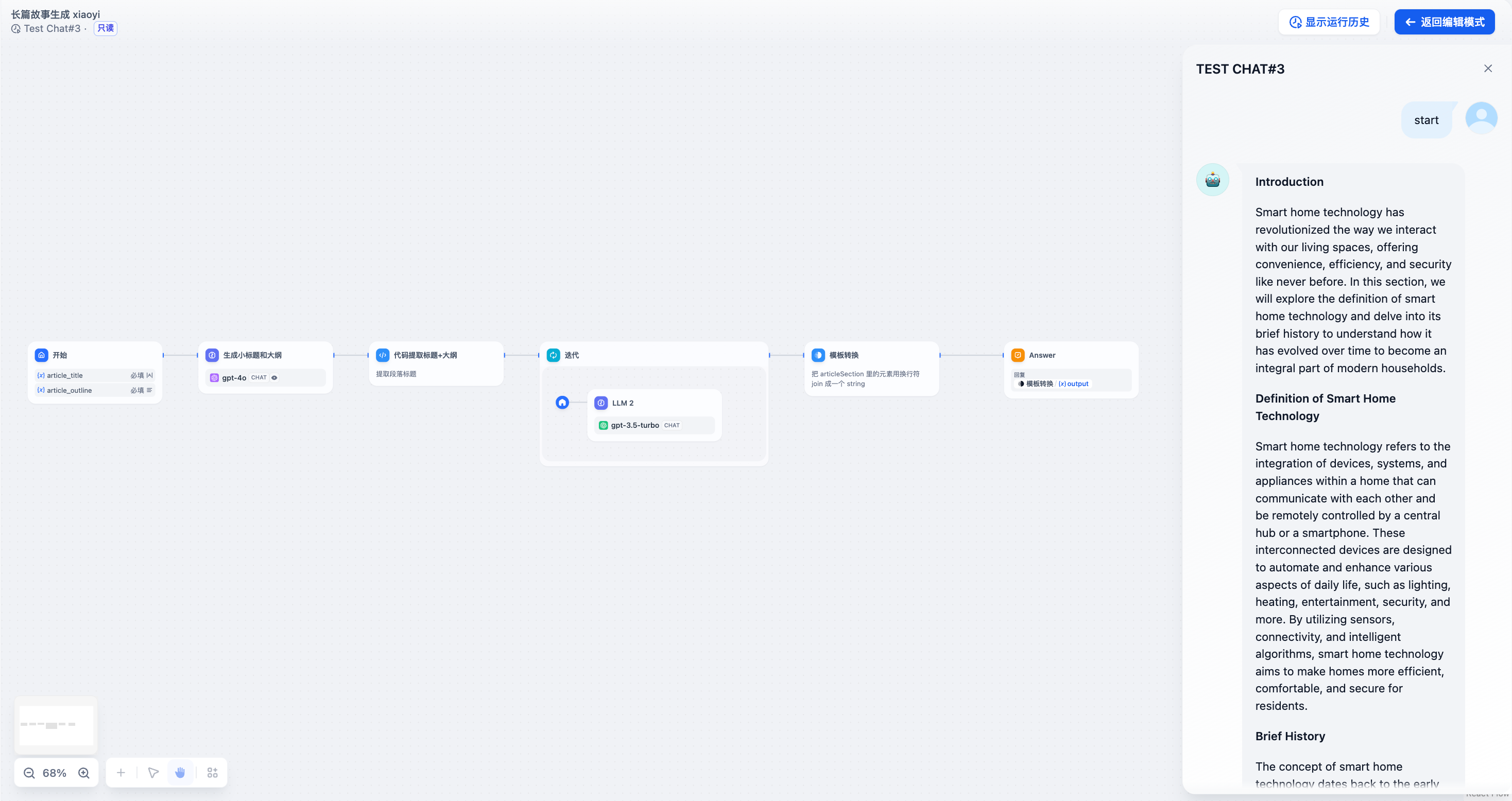

#### **Example 2: Long Article Iteration Generator (Another Arrangement)**

|

||||

|

||||

|

||||

|

||||

* Enter the story title and outline in the **Start Node**.

|

||||

* Use an **LLM Node** to generate subheadings and corresponding content for the article.

|

||||

* Use a **Code Node** to convert the complete content into an array format.

|

||||

* Use an **Iteration Node** to wrap an **LLM Node** and generate content for each chapter through multiple iterations.

|

||||

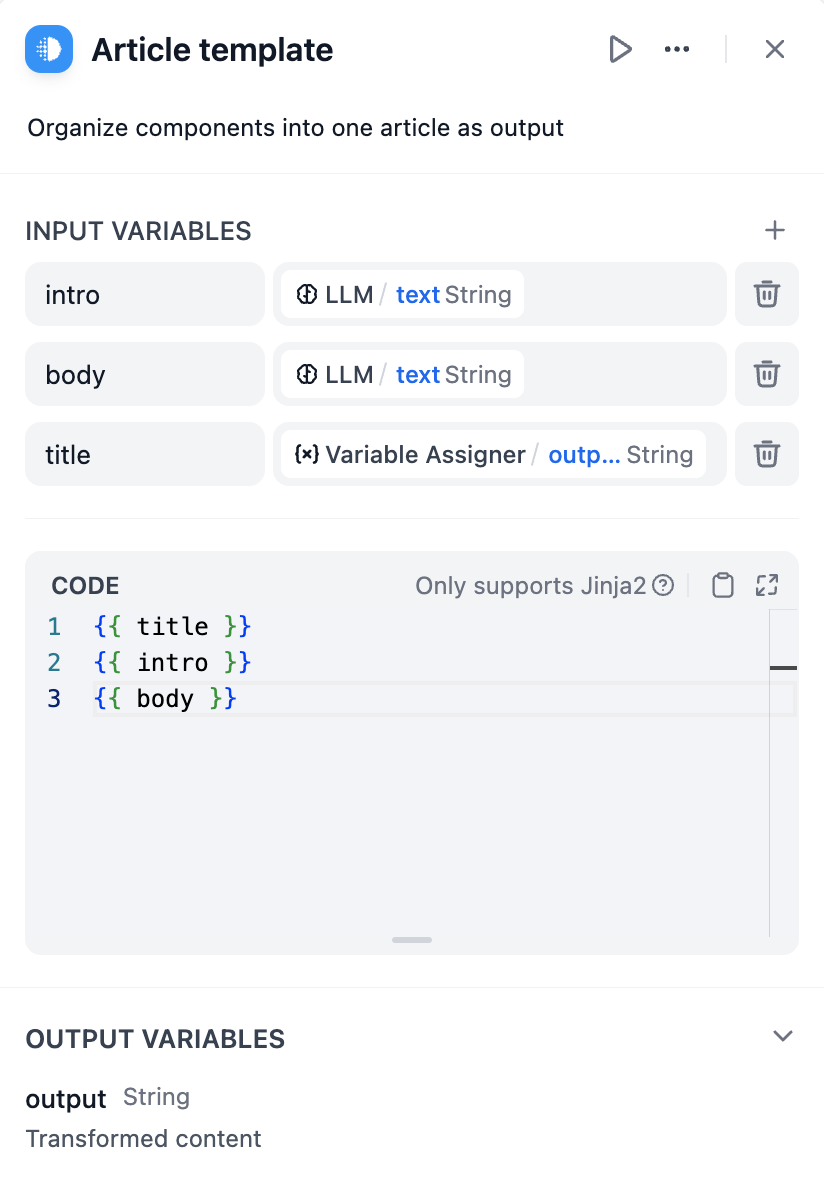

* Use a **Template Conversion** Node to convert the string array output from the iteration node back to a string.

|

||||

* Finally, add a **Direct Reply Node** to directly output the converted string.

|

||||

|

||||

***

|

||||

|

||||

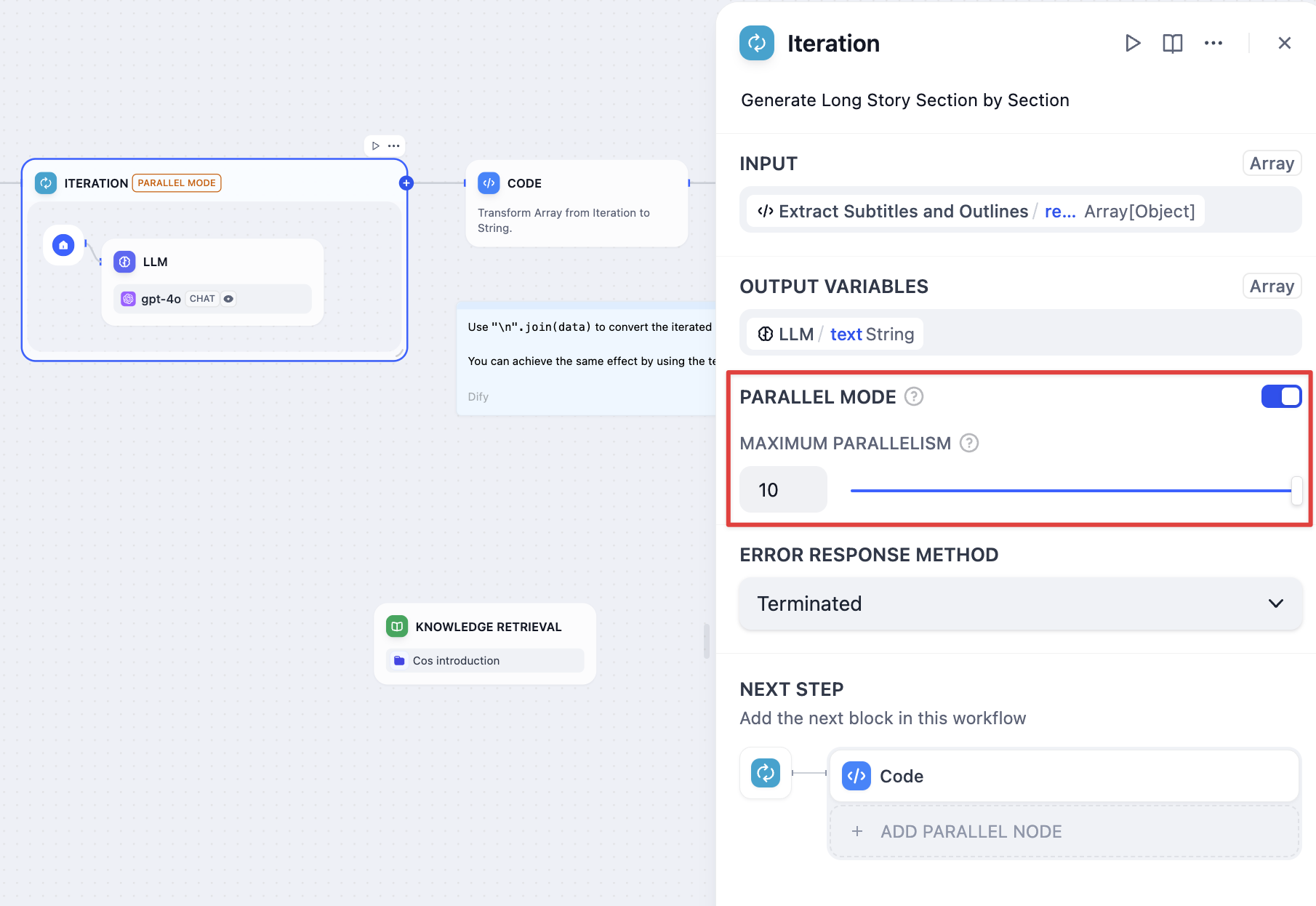

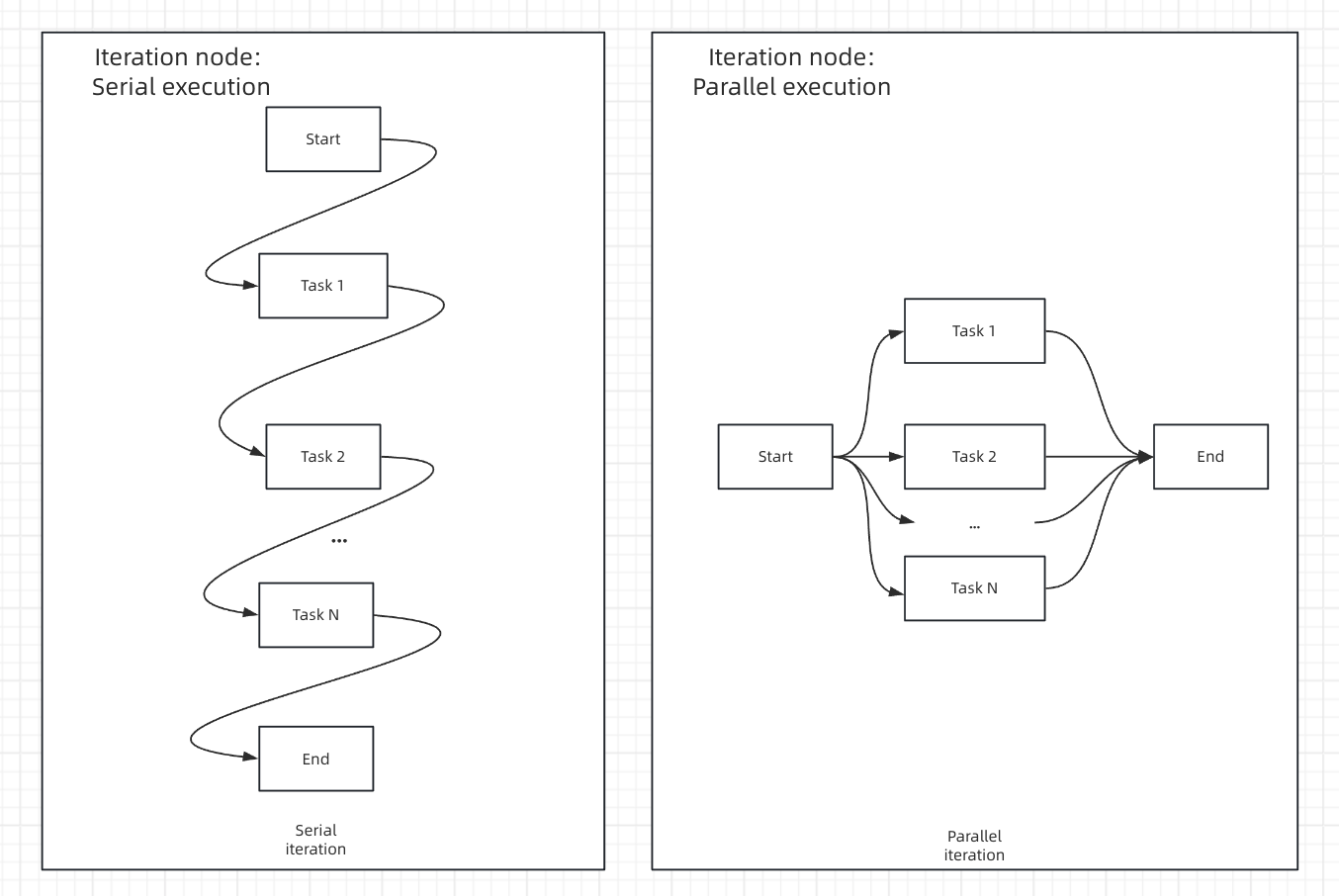

### Advanced Feature

|

||||

|

||||

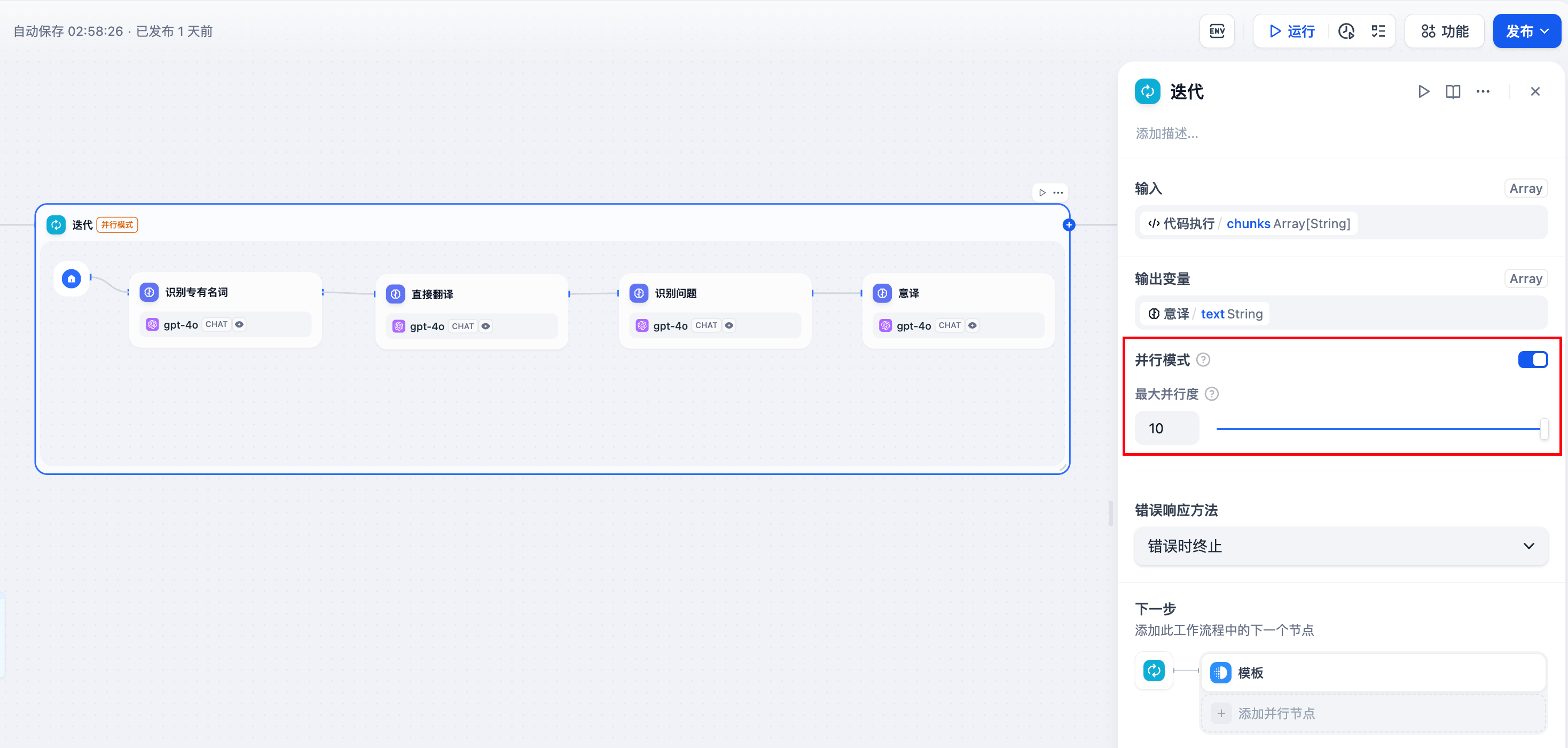

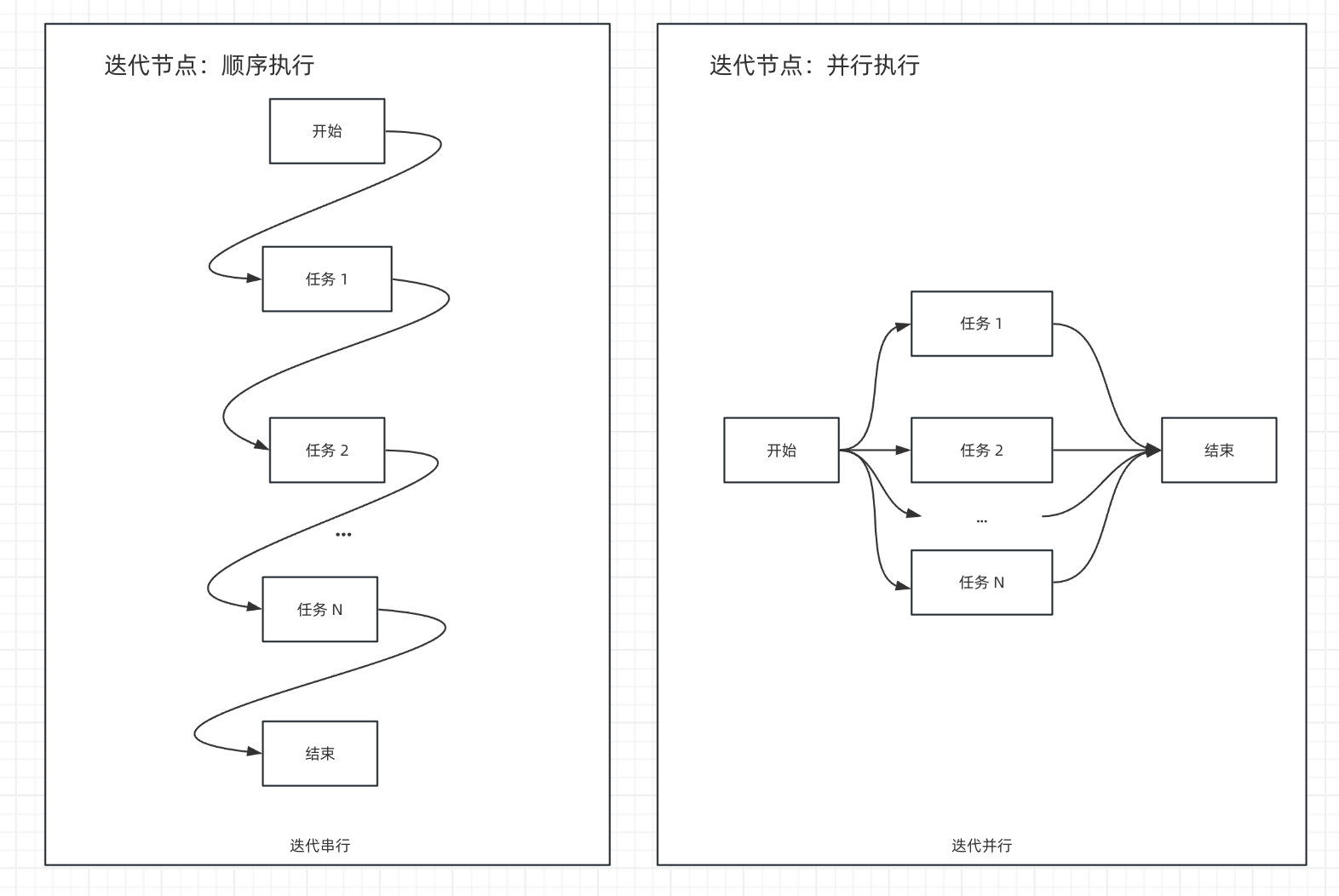

#### Parallel Mode

|

||||

|

||||

The iteration node supports parallel processing, improving execution efficiency when enabled.

|

||||

|

||||

|

||||

|

||||

Below illustrates the comparison between parallel and sequential execution in the iteration node.

|

||||

|

||||

|

||||

|

||||

Parallel mode supports up to 10 concurrent iterations. When processing more than 10 tasks, the first 10 elements execute simultaneously, with remaining tasks processed after the completion of the initial batch.

|

||||

|

||||

<Info>

|

||||

Avoid placing Direct Answer, Variable Assignment, or Tool nodes within the iteration node to prevent potential errors.

|

||||

</Info>

|

||||

|

||||

* **Error response method**

|

||||

|

||||

Iteration nodes process multiple tasks and may encounter errors during element processing. To prevent a single error from interrupting all tasks, configure the **Error Response Method**:

|

||||

|

||||

* **Terminated**: Terminates the iteration node and outputs error messages when an exception is detected.

|

||||

* **Continue on error**: Ignores error messages and continues processing remaining elements. The output contains successful results with null values for errors.

|

||||

* **Remove abnormal output**: Ignores error messages and continues processing remaining elements. The output contains only successful results.

|

||||

|

||||

Input and output variables maintain a one-to-one correspondence. For example:

|

||||

|

||||

* Input: \[1, 2, 3]

|

||||

* Output: \[result-1, result-2, result-3]

|

||||

|

||||

Error handling examples:

|

||||

|

||||

* With **Continue on error**: \[result-1, null, result-3]

|

||||

* With **Remove abnormal output**: \[result-1, result-3]

|

||||

|

||||

***

|

||||

|

||||

### Reference

|

||||

|

||||

#### How to Obtain Array-Formatted Content

|

||||

|

||||

Array variables can be generated via the following nodes as iteration node inputs:

|

||||

|

||||

* [Code Node](/en/guides/workflow/nodes/code)

|

||||

* [Parameter Extraction](/en/guides/workflow/nodes/parameter-extractor)

|

||||

* [Knowledge Base Retrieval](/en/guides/workflow/nodes/knowledge-retrieval)

|

||||

* [Iteration](/en/guides/workflow/nodes/iteration)

|

||||

* [Tools](/en/guides/workflow/nodes/tools)

|

||||

* [HTTP Request](/en/guides/workflow/nodes/http-request)

|

||||

|

||||

***

|

||||

|

||||

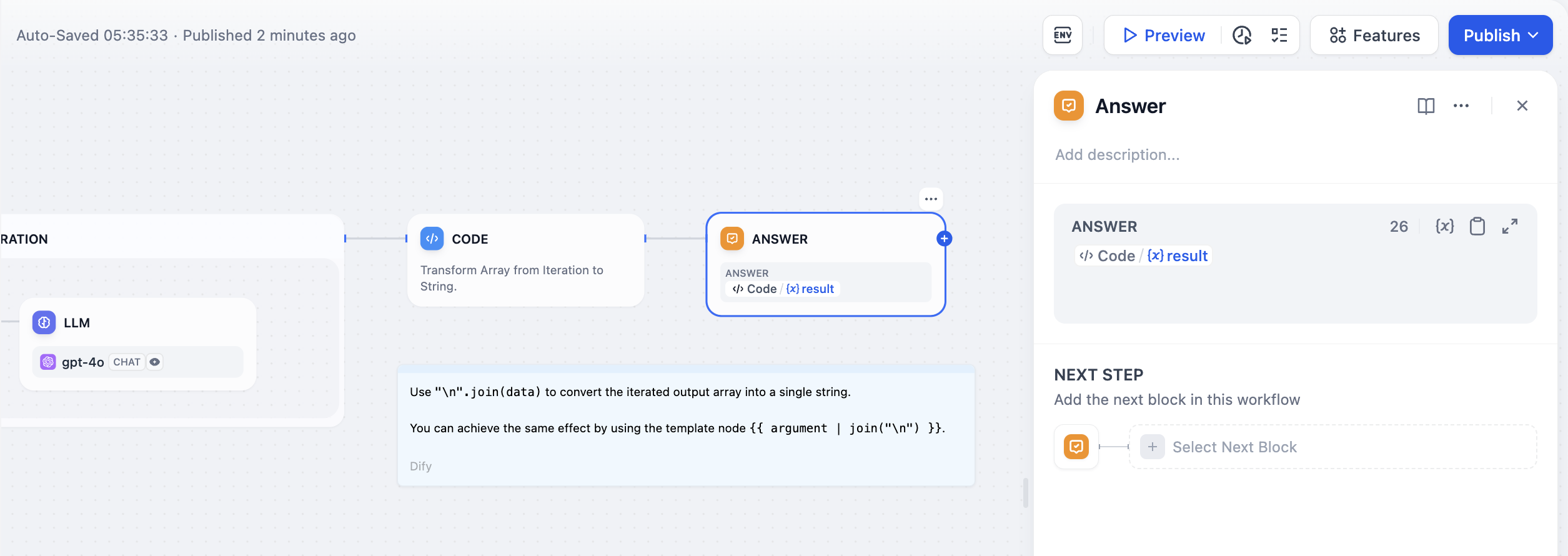

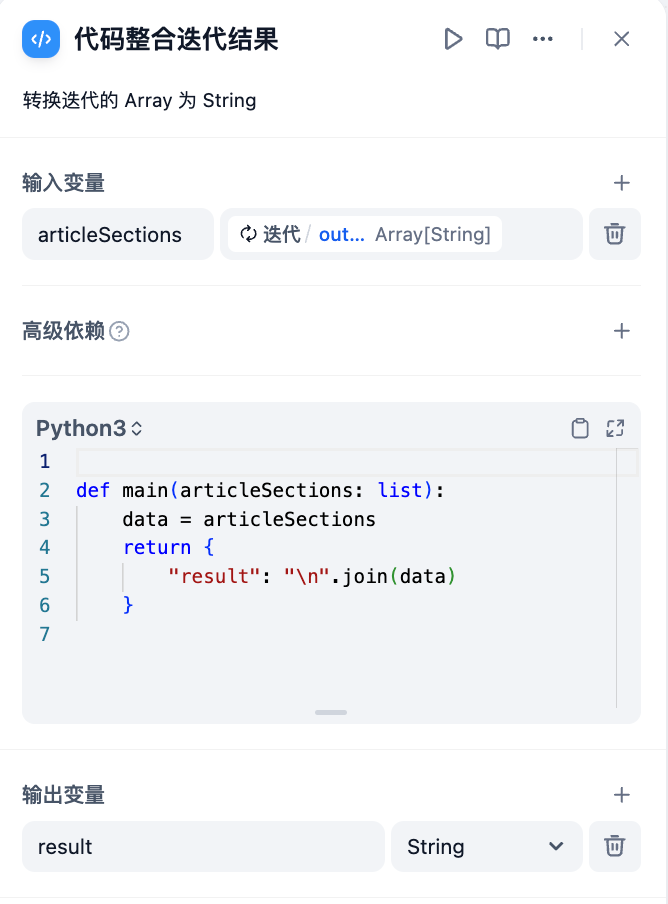

#### How to Convert an Array to Text

|

||||

|

||||

The output variable of the iteration node is in array format and cannot be directly output. You can use a simple step to convert the array back to text.

|

||||

|

||||

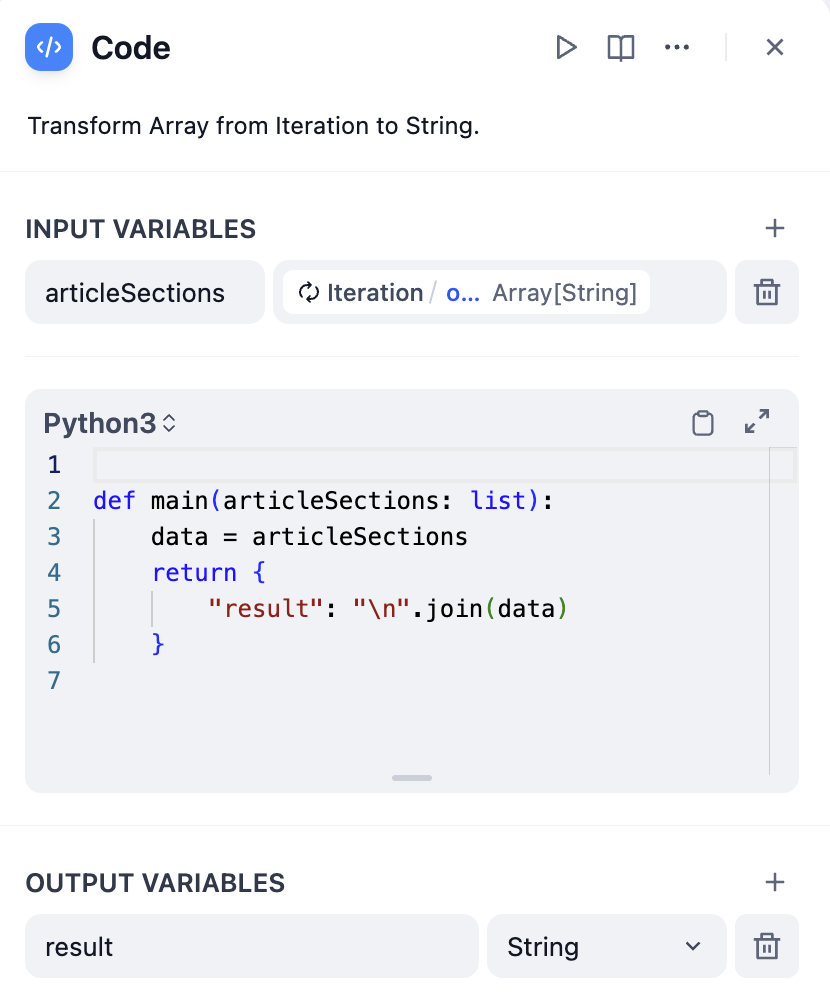

**Convert Using a Code Node**

|

||||

|

||||

|

||||

|

||||

CODE Example:

|

||||

|

||||

```python

|

||||

def main(articleSections: list):

|

||||

data = articleSections

|

||||

return {

|

||||

"result": "/n".join(data)

|

||||

}

|

||||

```

|

||||

|

||||

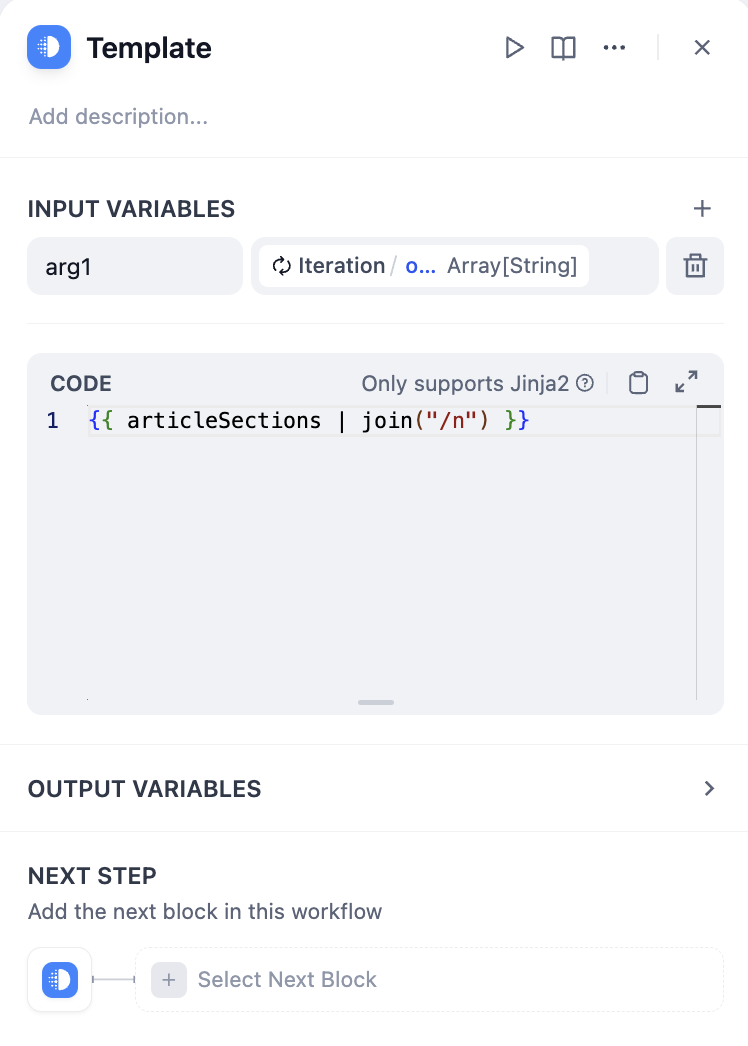

**Convert Using a Template Node**

|

||||

|

||||

|

||||

|

||||

CODE Example:

|

||||

|

||||

```django

|

||||

{{ articleSections | join("/n") }}

|

||||

```

|

||||

41

en/guides/workflow/node/knowledge-retrieval.mdx

Normal file

41

en/guides/workflow/node/knowledge-retrieval.mdx

Normal file

@@ -0,0 +1,41 @@

|

||||

---

|

||||

title: Knowledge Retrieval

|

||||

---

|

||||

|

||||

|

||||

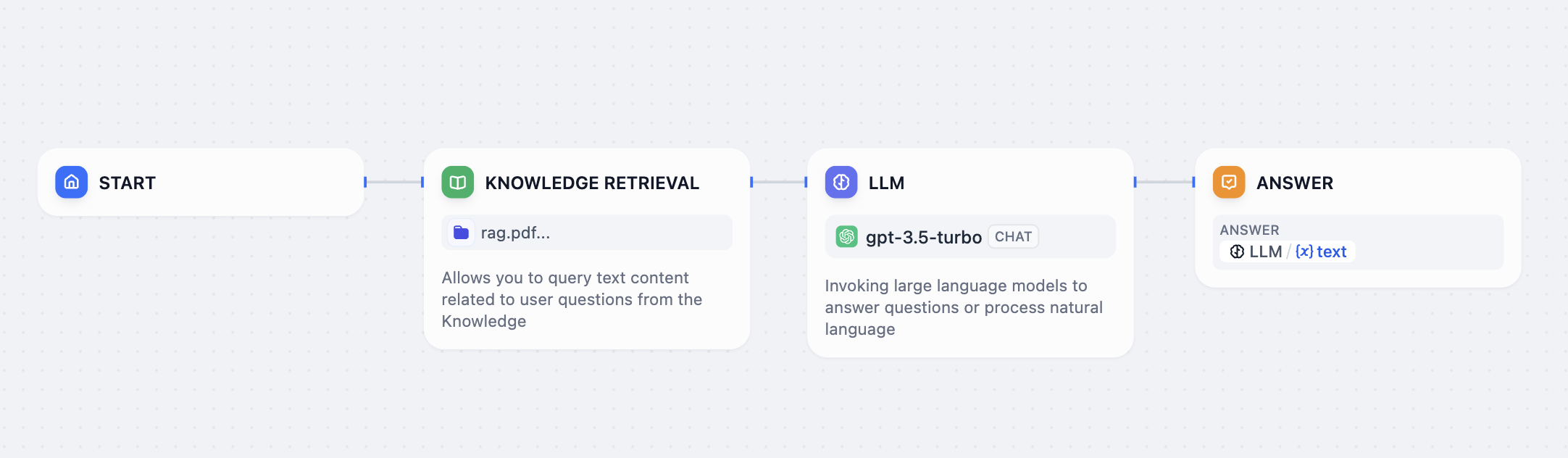

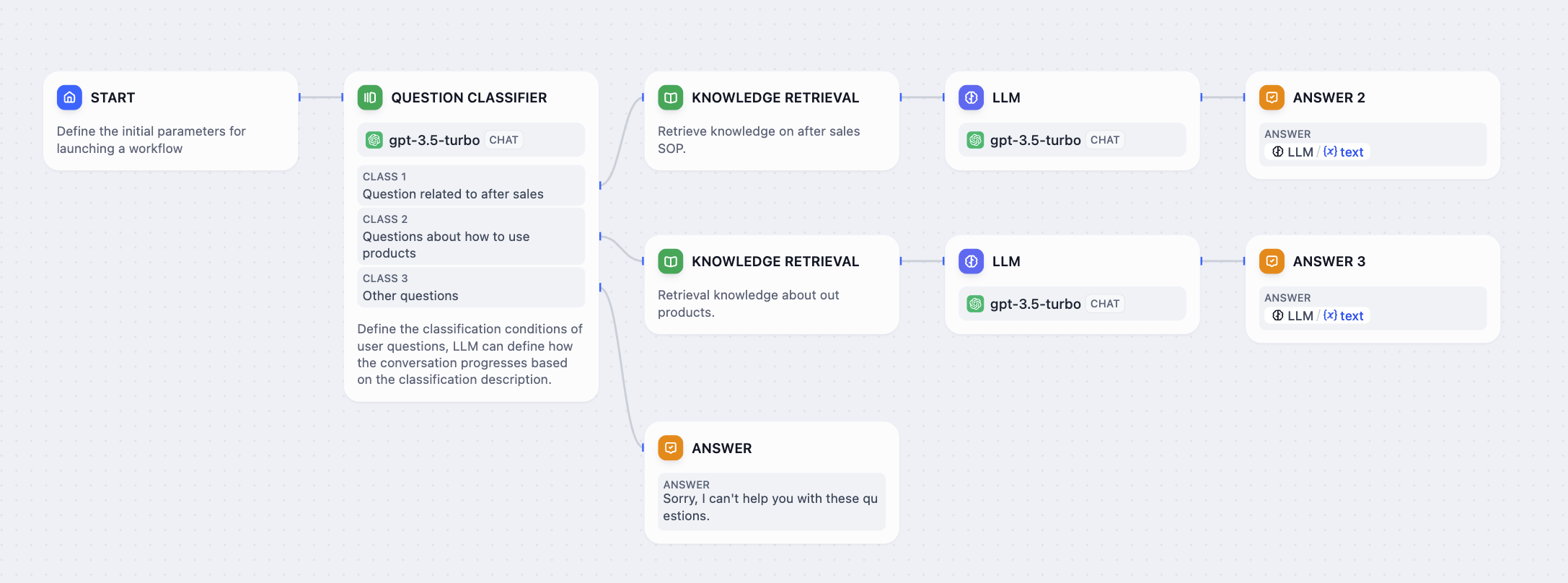

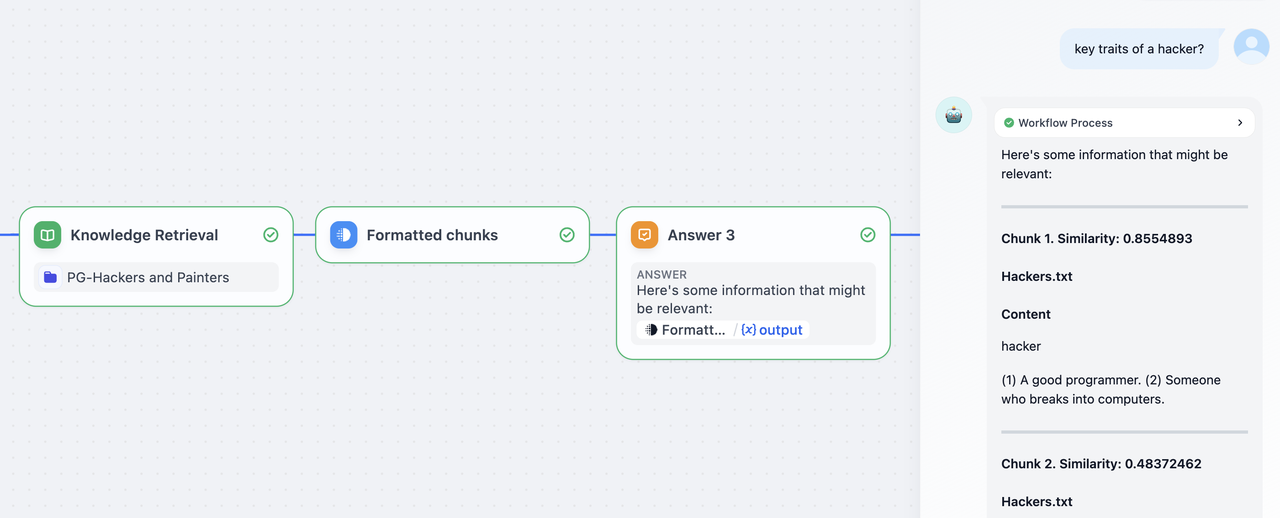

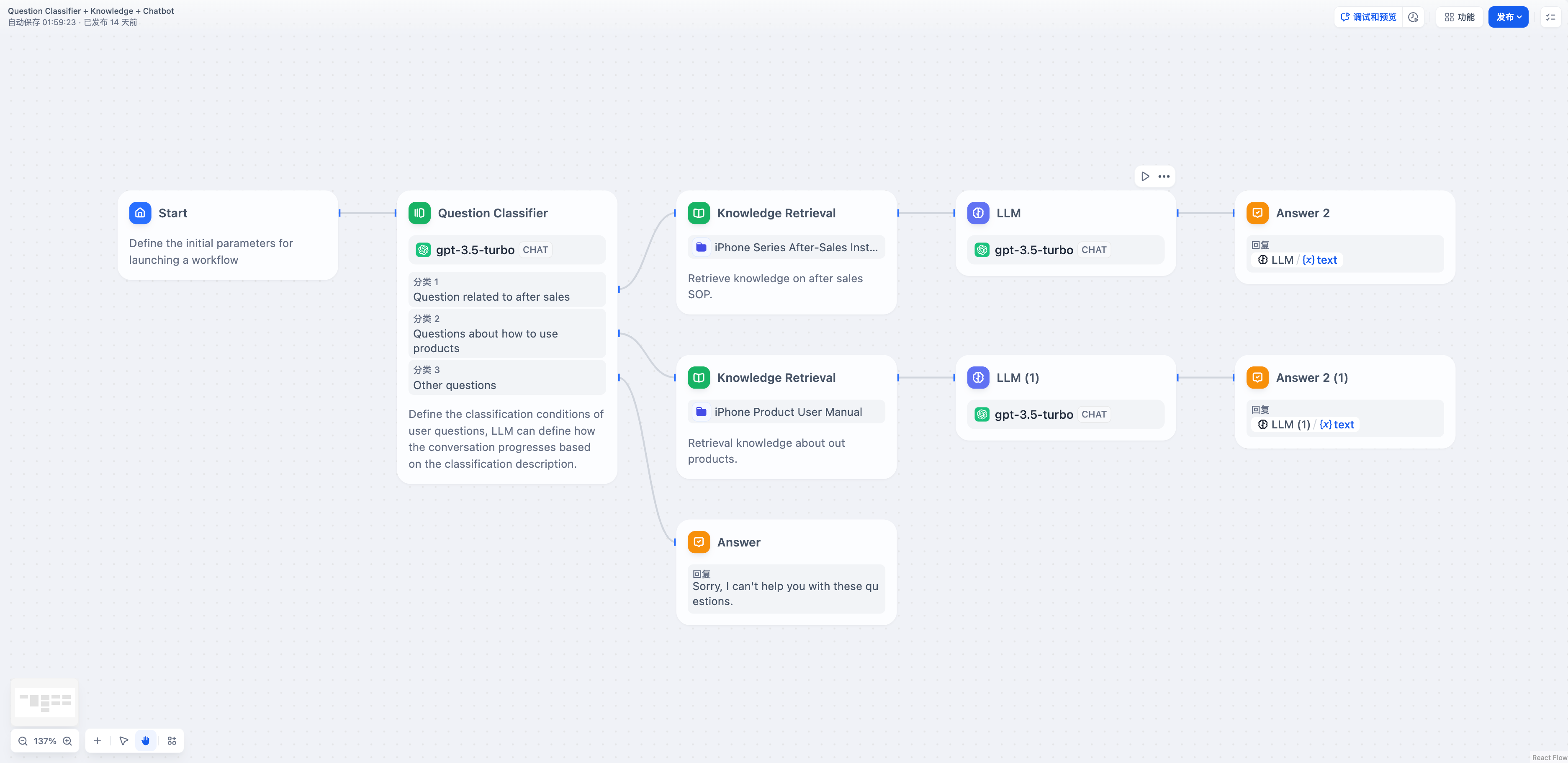

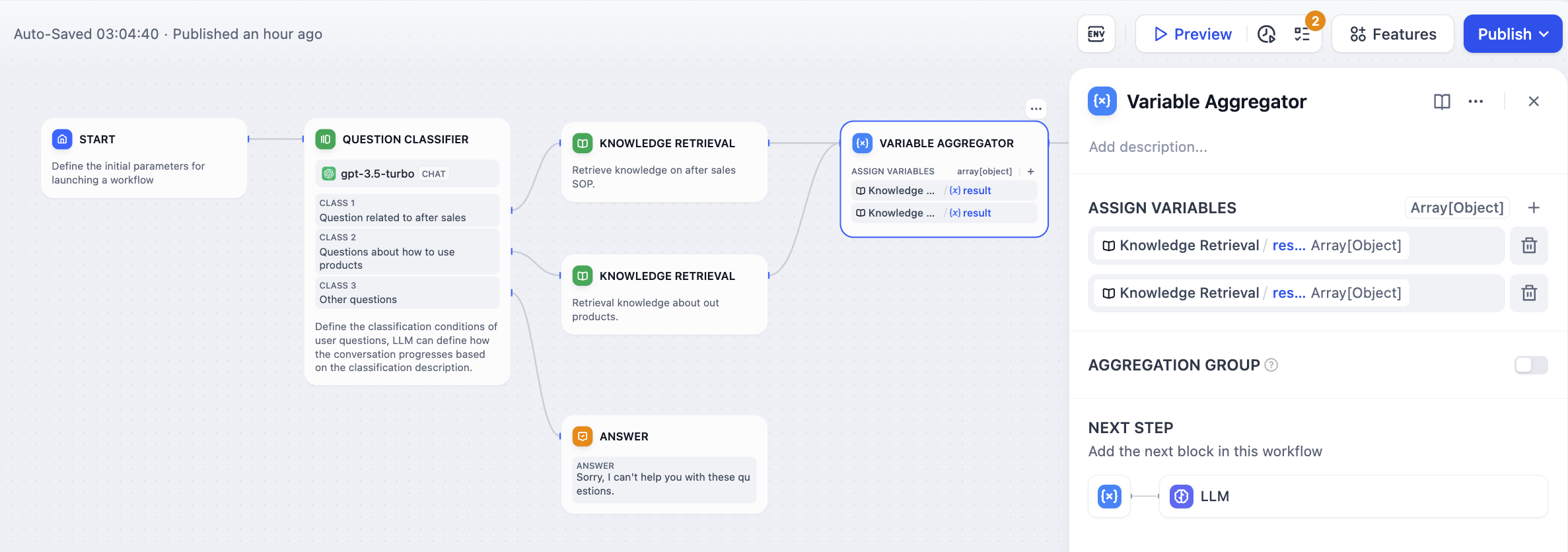

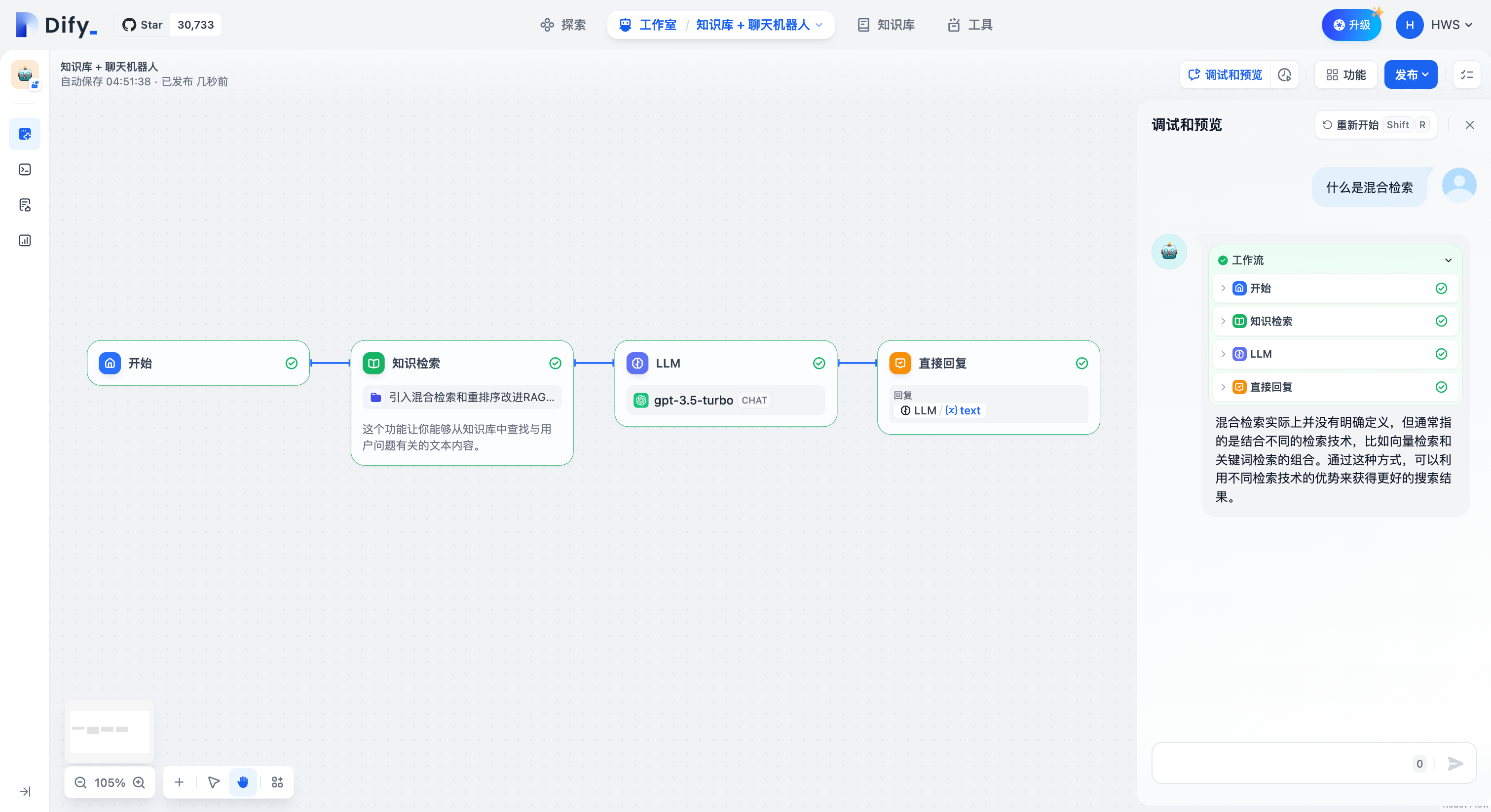

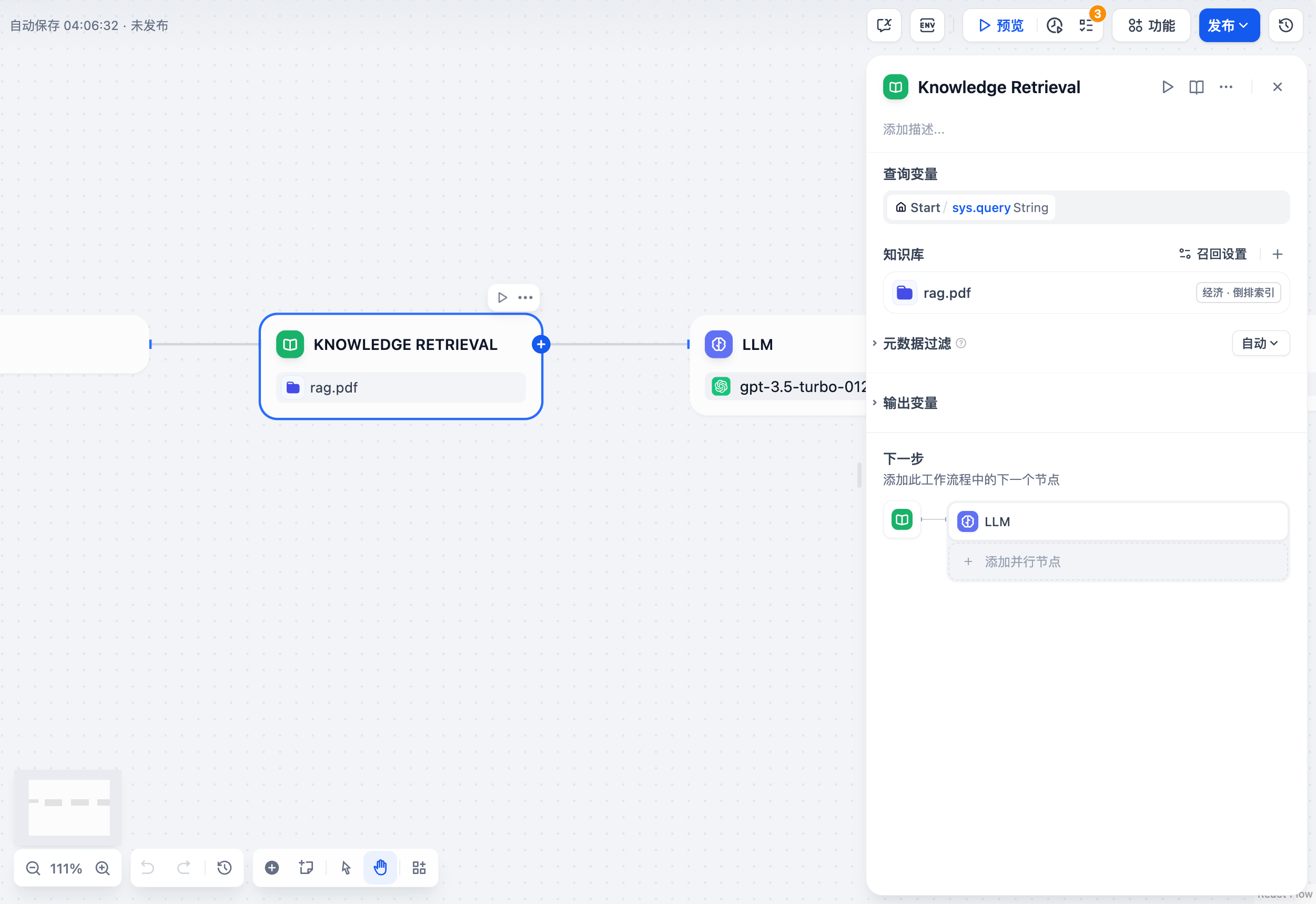

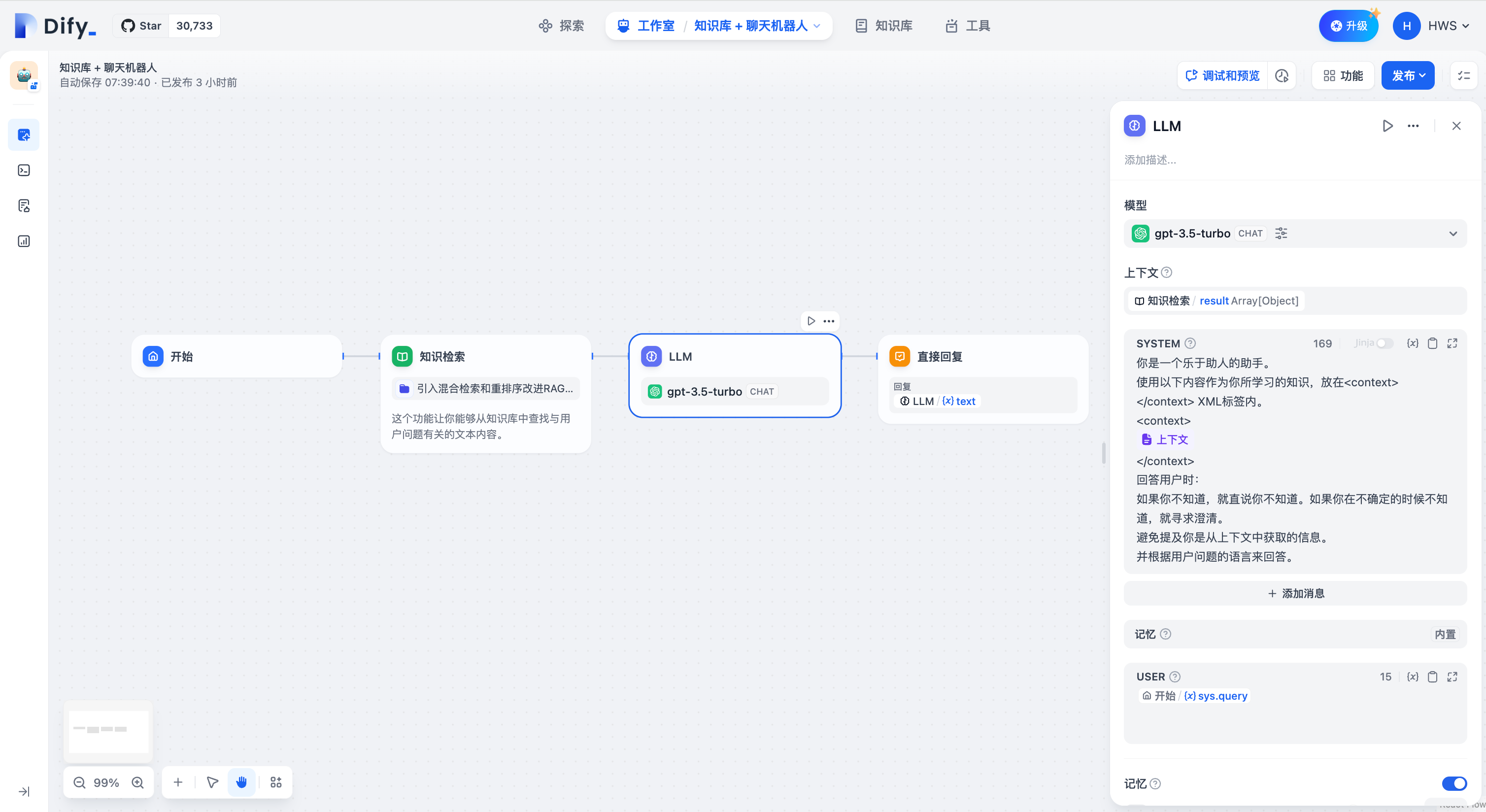

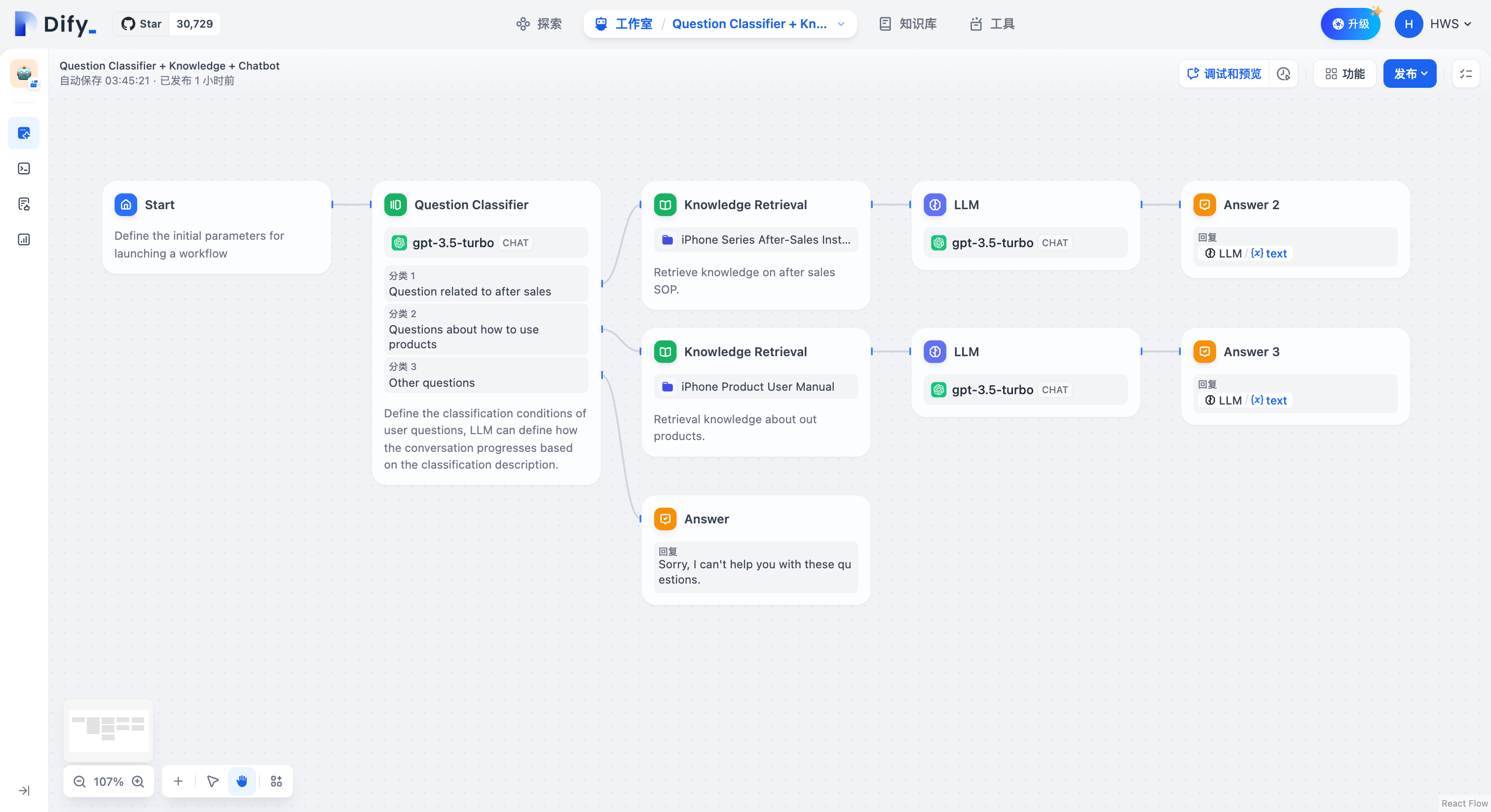

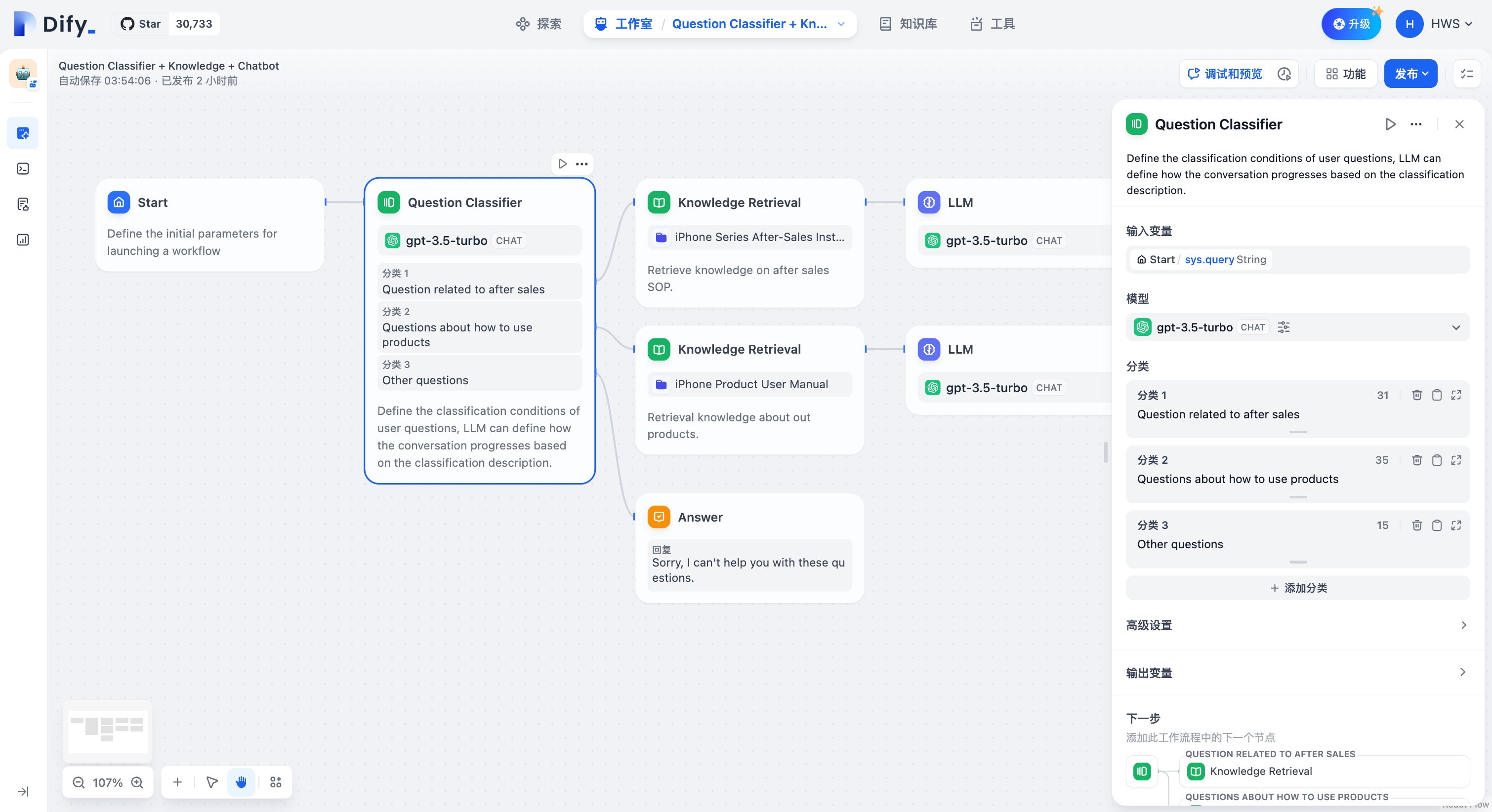

The Knowledge Base Retrieval Node is designed to query text content related to user questions from the Dify Knowledge Base, which can then be used as context for subsequent answers by the Large Language Model (LLM).

|

||||

|

||||

|

||||

|

||||

Configuring the Knowledge Base Retrieval Node involves four main steps:

|

||||

|

||||

1. **Selecting the Query Variable**

|

||||

2. **Choosing the Knowledge Base for Query**

|

||||

3. **Applying Metadata Filtering**

|

||||

4. **Configuring the Retrieval Strategy**

|

||||

|

||||

**Selecting the Query Variable**

|

||||

|

||||

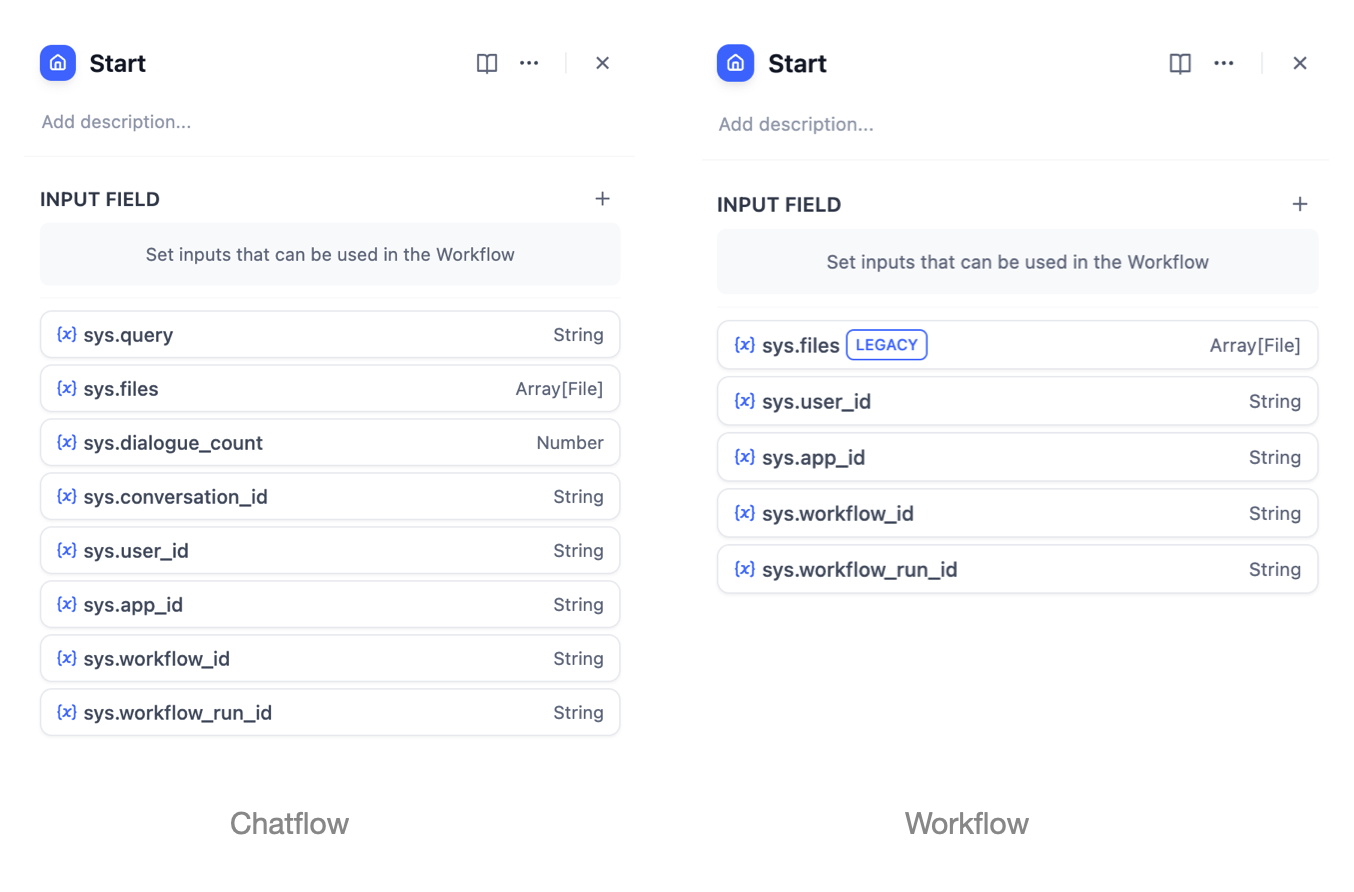

In knowledge base retrieval scenarios, the query variable typically represents the user's input question. In the "Start" node of conversational applications, the system pre-sets "sys.query" as the user input variable. This variable can be used to query the knowledge base for text chunks most closely related to the user's question. The maximum query content sent to the knowledge base is 200 characters.

|

||||

|

||||

**Choosing the Knowledge Base for Query**

|

||||

|

||||

Within the knowledge base retrieval node, you can add an existing knowledge base from Dify. For instructions on creating a knowledge base within Dify, please refer to the knowledge base [help documentation](/en/guides/knowledge-base/create-knowledge-and-upload-documents).

|

||||

|

||||

**Applying Metadata Filtering**

|

||||

|

||||

Use **Metadata Filtering** to refine document search in your knowledge base. For details, see **Metadata Filtering** in *[Integrate Knowledge Base within Application](/en/guides/knowledge-base/integrate-knowledge-within-application)*.

|

||||

|

||||

**Configuring the Retrieval Strategy**

|

||||

|

||||

It's possible to modify the indexing strategy and retrieval mode for an individual knowledge base within the node. For a detailed explanation of these settings, refer to the knowledge base [help documentation](/en/guides/knowledge-base/retrieval-test-and-citation).

|

||||

|

||||

<img

|

||||

src="https://assets-docs.dify.ai/2025/03/fbd43d558f83b355a1b18ac26a253b84.png"

|

||||

className="mx-auto"

|

||||

alt=""

|

||||

/>

|

||||

|

||||

Dify offers two recall strategies for different knowledge base retrieval scenarios: "N-to-1 Recall" and "Multi-way Recall". In the N-to-1 mode, knowledge base queries are executed through function calling, requiring the selection of a system reasoning model. In the multi-way recall mode, a Rerank model needs to be configured for result re-ranking. For a detailed explanation of these two recall strategies, refer to the retrieval mode explanation in the [help documentation](/en/guides/knowledge-base/create-knowledge-and-upload-documents#id-5-indexing-methods).

|

||||

|

||||

|

||||

80

en/guides/workflow/node/list-operator.mdx

Normal file

80

en/guides/workflow/node/list-operator.mdx

Normal file

@@ -0,0 +1,80 @@

|

||||

---

|

||||

title: List Operator

|

||||

---

|

||||

|

||||

|

||||

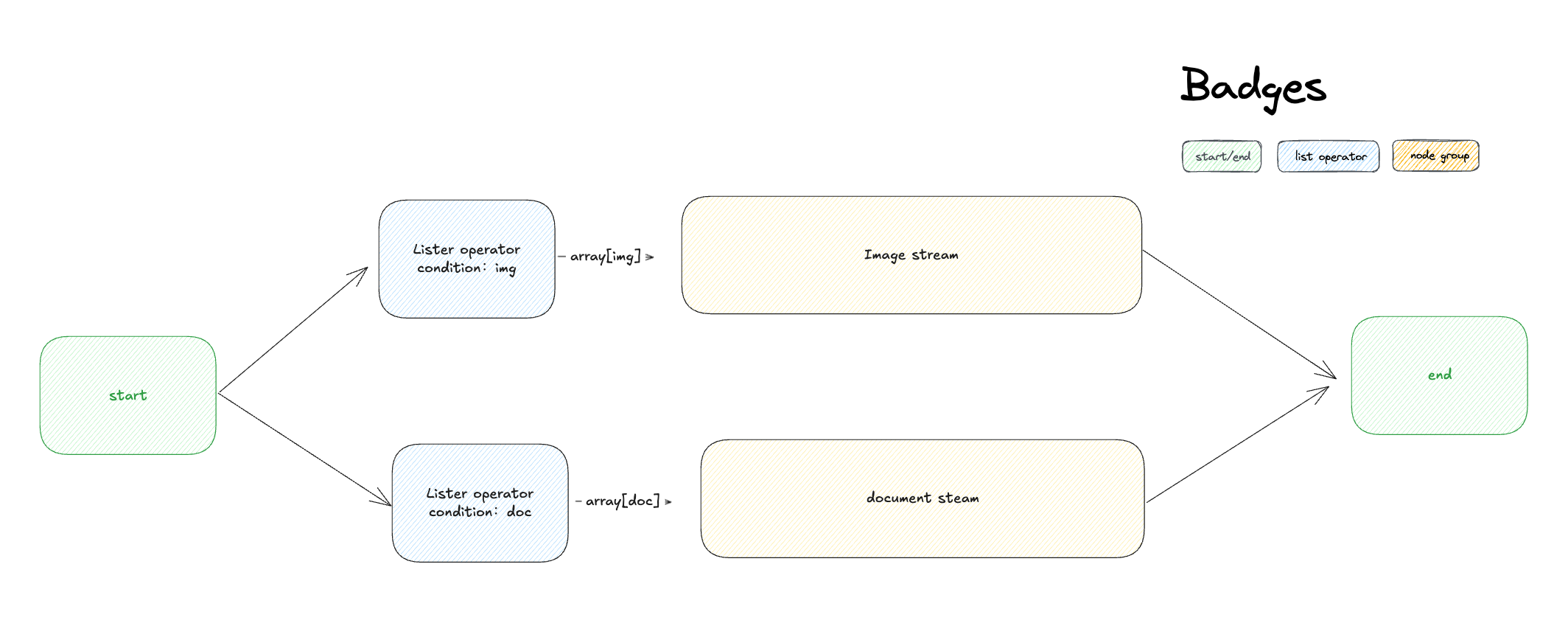

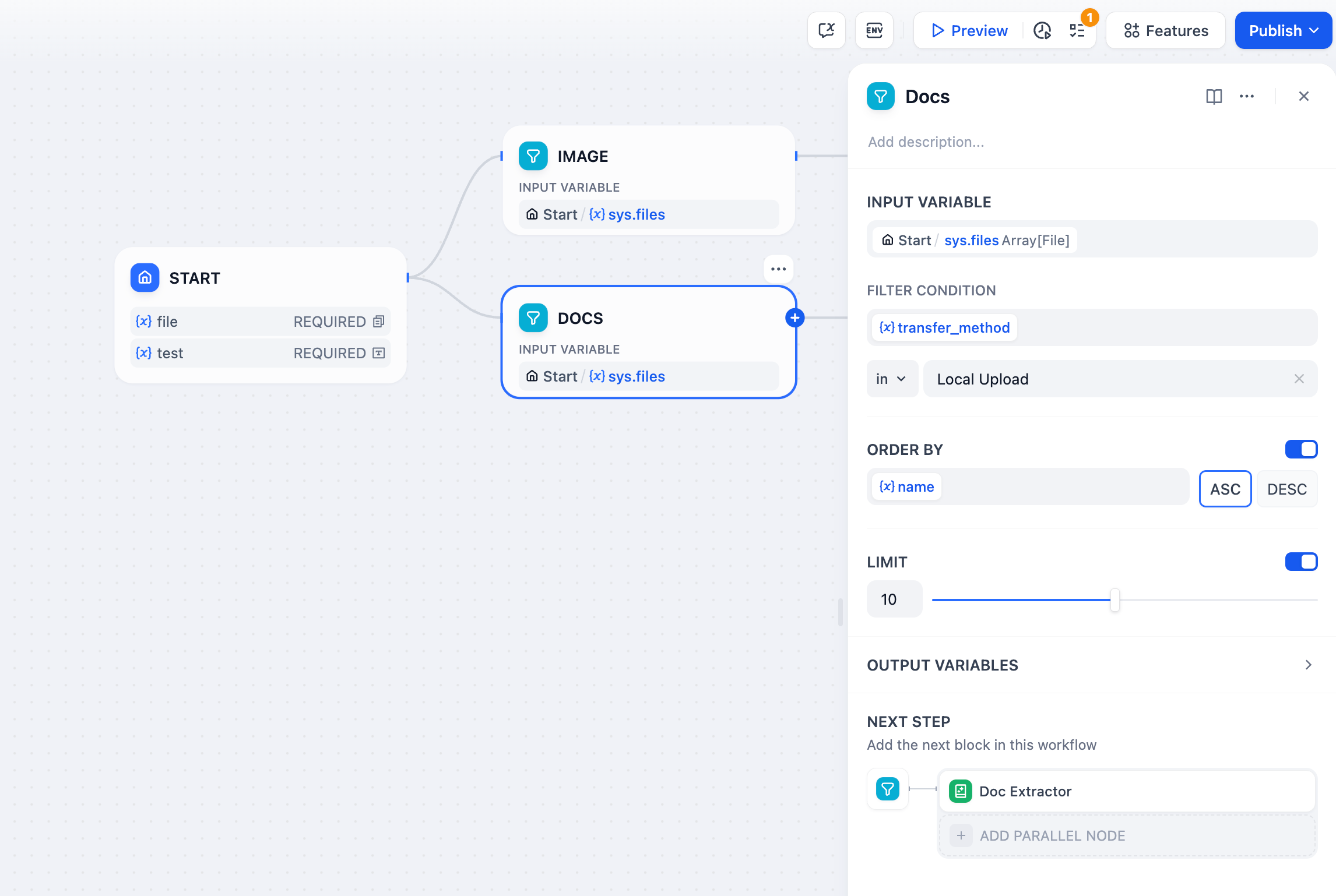

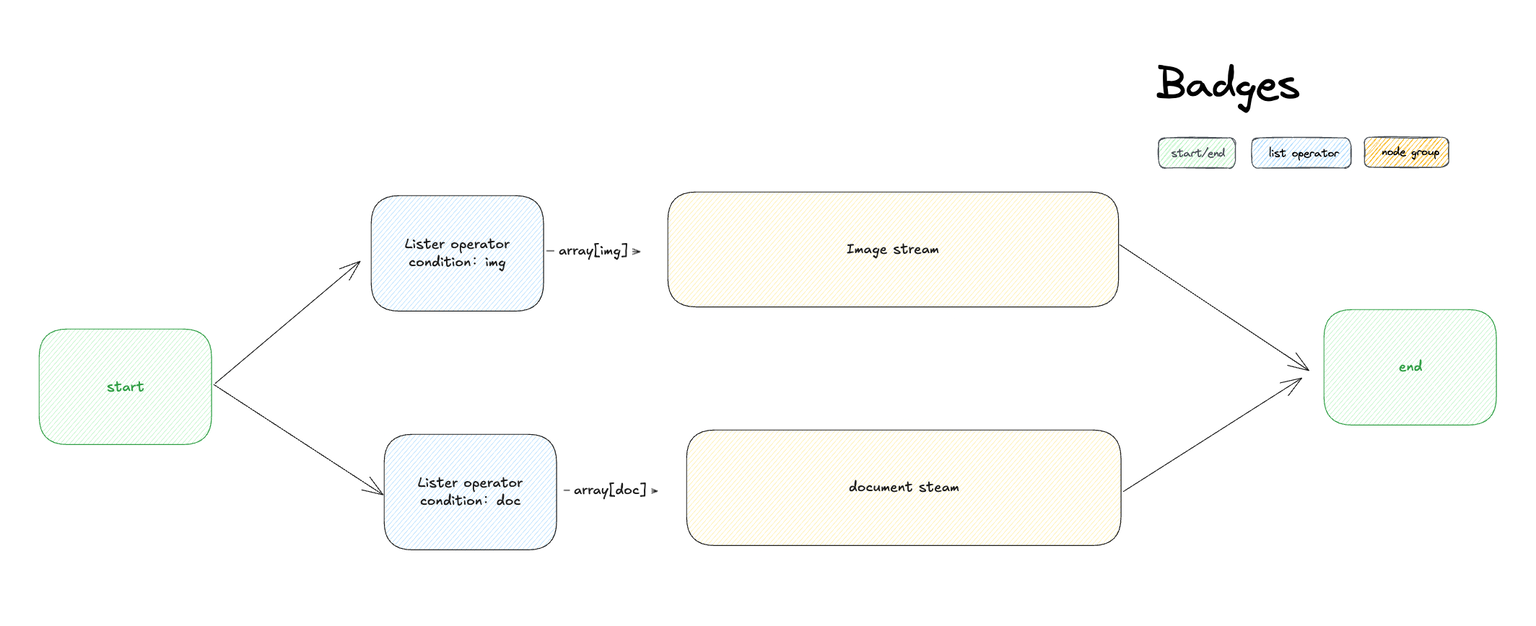

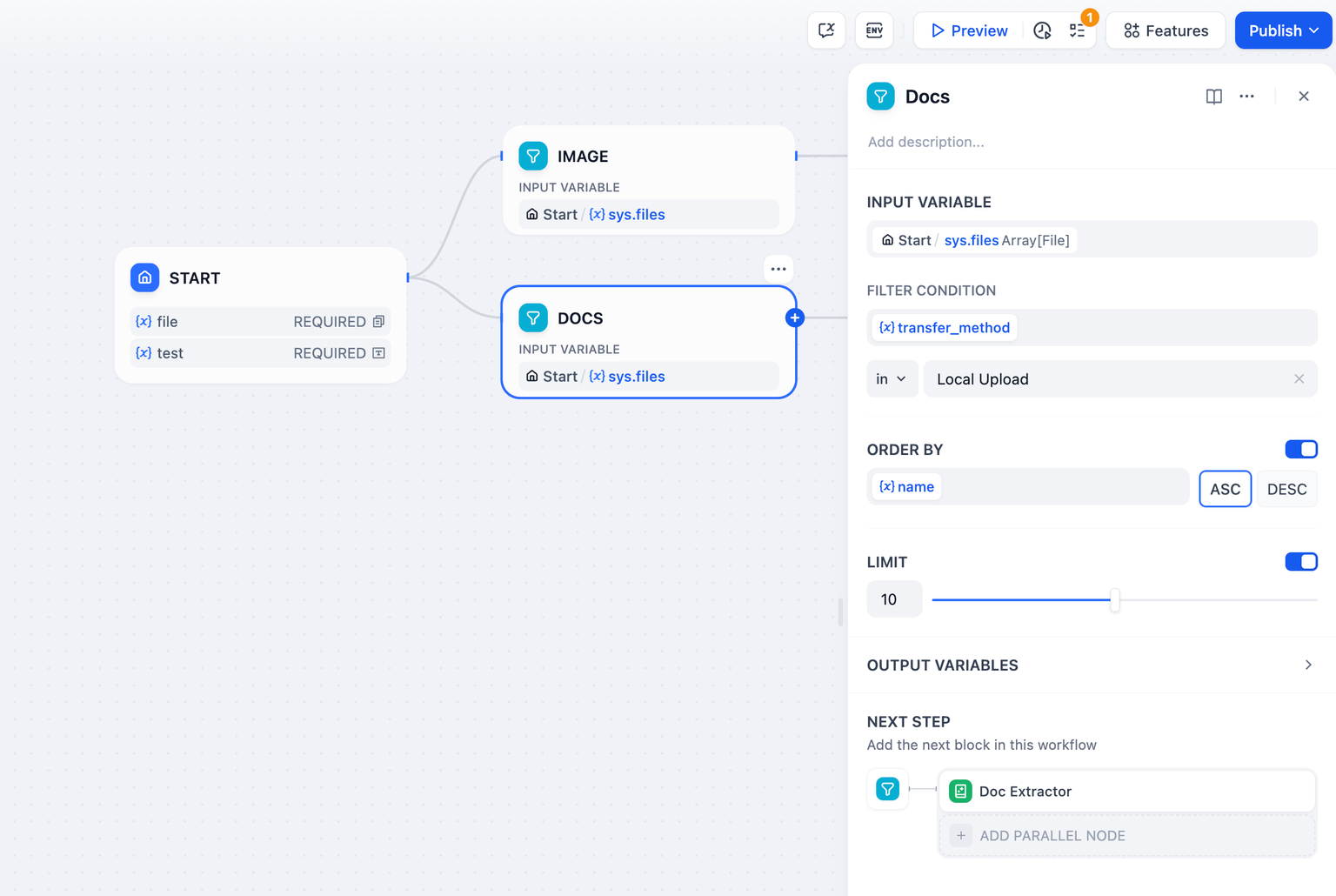

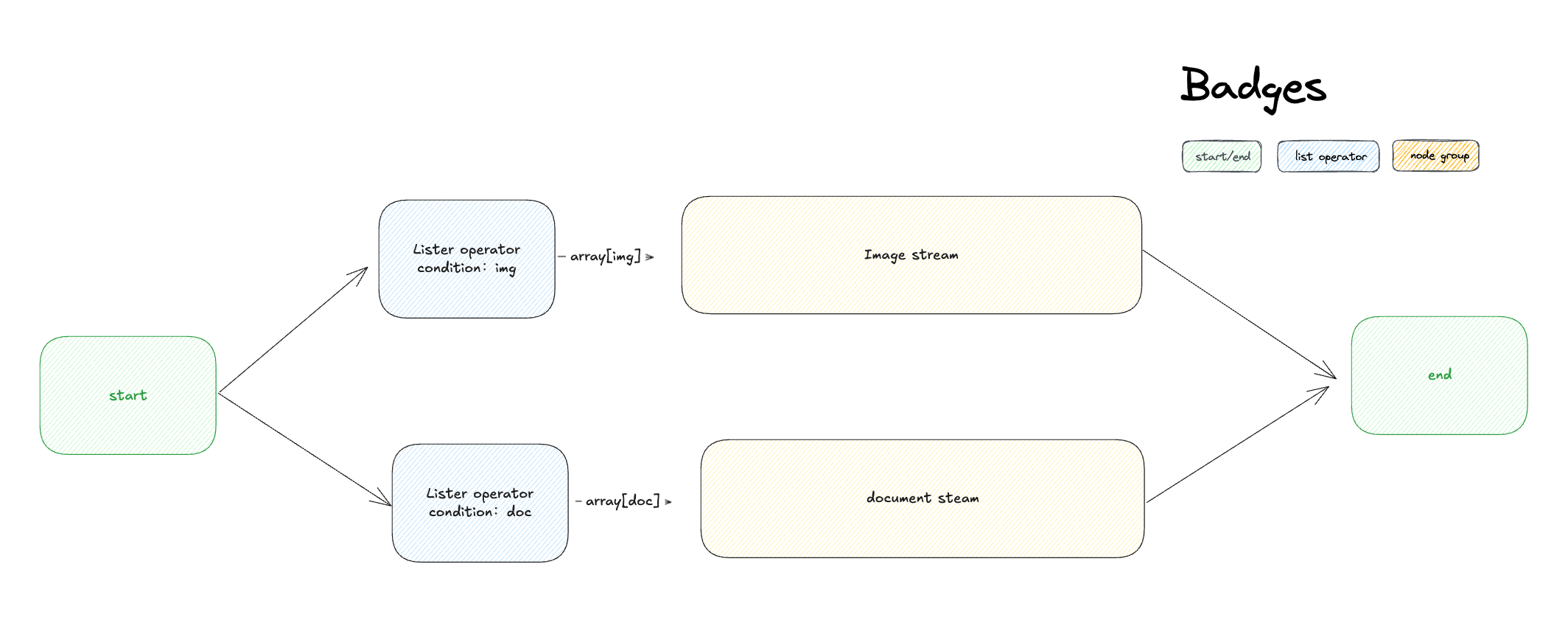

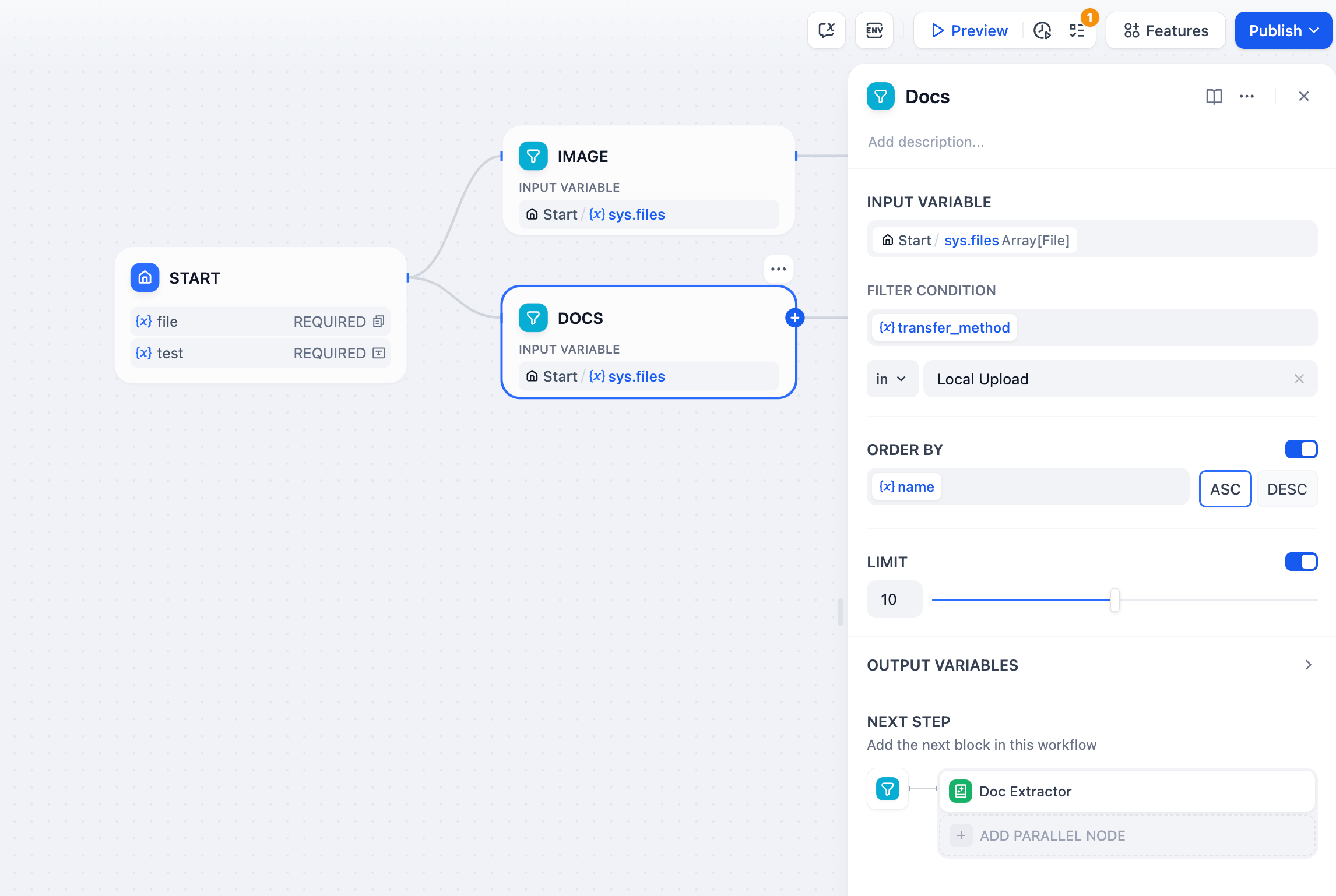

File list variables support simultaneous uploading of multiple file types such as document files, images, audio, and video files. When application users upload files, all files are stored in the same `Array[File]` array-type variable, which **is not conducive to subsequent individual file processing.**

|

||||

|

||||

> The `Array` data type means that the actual value of the variable could be \[1.mp3, 2.png, 3.doc]. LLMs only support reading single values such as image files or text content as input variables and cannot directly read array variables.

|

||||

|

||||

#### Node Functionality

|

||||

|

||||

The list operator can filter and extract attributes such as file format type, file name, and size, passing different format files to corresponding processing nodes to achieve precise control over different file processing flows.

|

||||

|

||||

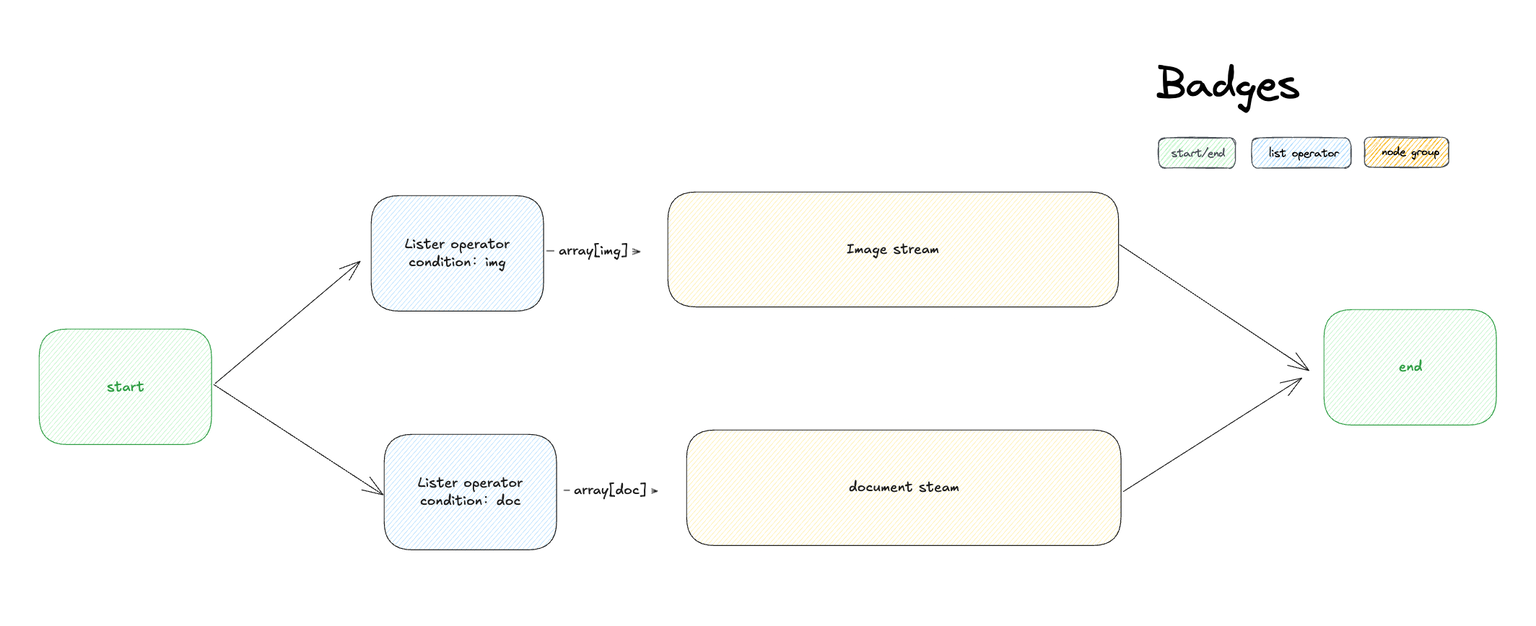

For example, in an application that allows users to upload both document files and image files simultaneously, different files need to be sorted through the **list operation node**, with different files being handled by different processes.

|

||||

|

||||

|

||||

|

||||

List operation nodes are generally used to extract information from array variables, converting them into variable types that can be accepted by downstream nodes through setting conditions. Its structure is divided into input variables, filter conditions, sorting, taking the first N items, and output variables.

|

||||

|

||||

|

||||

|

||||

**Input Variables**

|

||||

|

||||

The list operation node only accepts variables with the following data structures:

|

||||

|

||||

* Array\[string]

|

||||

* Array\[number]

|

||||

* Array\[file]

|

||||

|

||||

**Filter Conditions**

|

||||

|

||||

Process arrays in input variables by adding filter conditions. Sort out all array variables that meet the conditions from the array, which can be understood as filtering the attributes of variables.

|

||||

|

||||

Example: Files may contain multiple dimensions of attributes, such as file name, file type, file size, etc. Filter conditions allow setting screening conditions to select and extract specific files from array variables.

|

||||

|

||||

Supports extracting the following variables:

|

||||

|

||||

* type: File category, including image, document, audio, and video types

|

||||

* size: File size

|

||||

* name: File name

|

||||

* url: Refers to files uploaded by application users via URL, can fill in the complete URL for filtering

|

||||

* extension: File extension

|

||||

* mime\_type: [MIME types](https://datatracker.ietf.org/doc/html/rfc2046) are standardized strings used to identify file content types. Example: "text/html" indicates an HTML document.

|

||||

* transfer\_method: File upload method, divided into local upload or upload via URL

|

||||

|

||||

**Sorting**

|

||||

|

||||

Provides the ability to sort arrays in input variables, supporting sorting based on file attributes.

|

||||

|

||||

* Ascending order(ASC): Default sorting option, sorted from small to large. For letters and text, sorted in alphabetical order (A - Z)

|

||||

* Descending order(DESC): Sorted from large to small, for letters and text, sorted in reverse alphabetical order (Z - A)

|

||||

|

||||

This option is often used in conjunction with first\_record and last\_record in output variables.

|

||||

|

||||

**Take First N Items**

|

||||

|

||||

You can choose a value between 1-20, used to select the first n items of the array variable.

|

||||

|

||||

**Output Variables**

|

||||

|

||||

Array elements that meet all filter conditions. Filter conditions, sorting, and limitations can be enabled separately. If enabled simultaneously, array elements that meet all conditions are returned.

|

||||

|

||||

* Result: Filtering result, data type is array variable. If the array contains only 1 file, the output variable contains only 1 array element;

|

||||

* first\_record: The first element of the filtered array, i.e., result\[0];

|

||||

* last\_record: The last element of the filtered array, i.e., result\[array.length-1].

|

||||

|

||||

***

|

||||

|

||||

#### Configuration Example

|

||||

|

||||

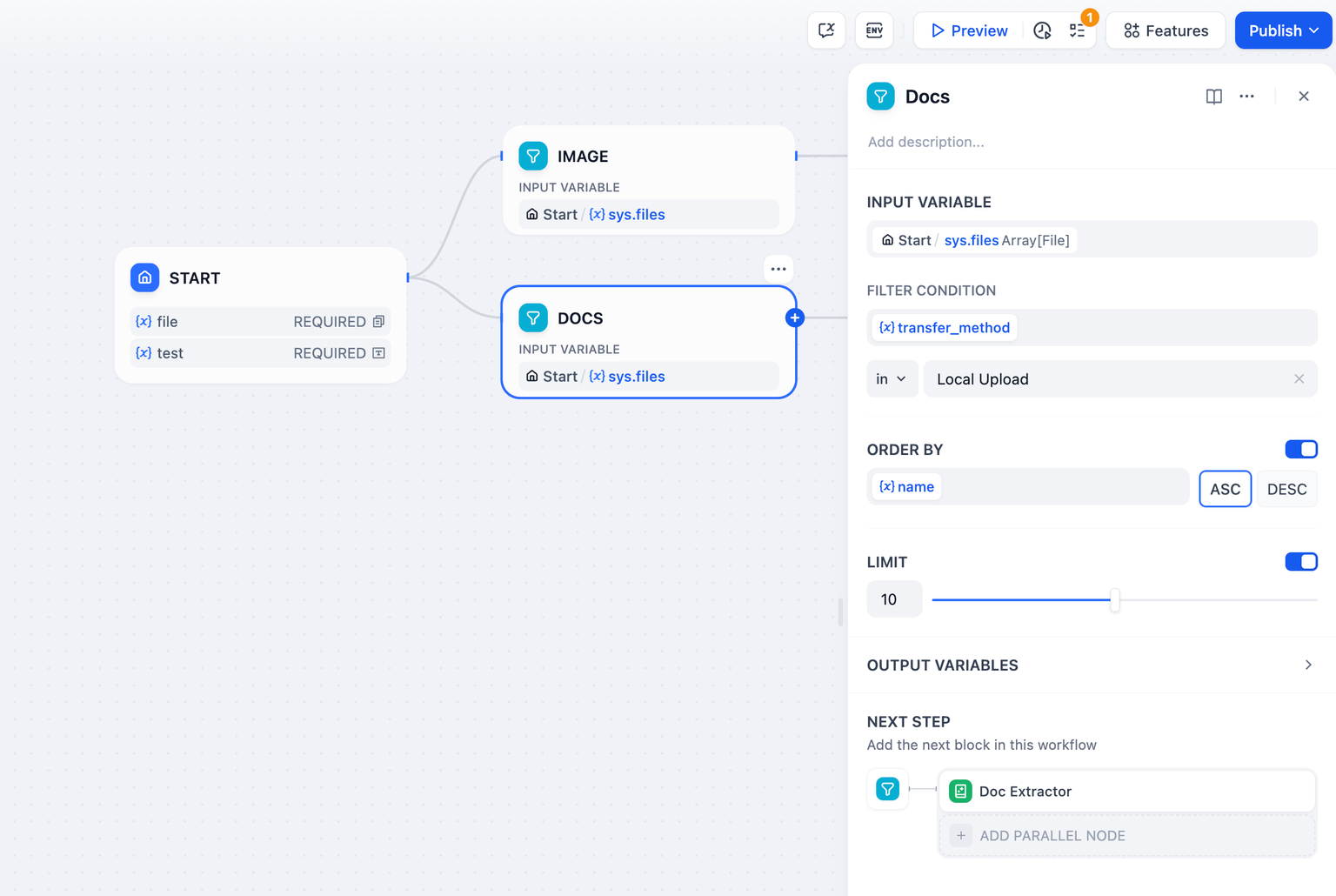

In file interaction Q\&A scenarios, application users may upload document files or image files simultaneously. LLMs only support the ability to recognize image files and do not support reading document files. At this time, the List Operation node is needed to preprocess the array of file variables and send different file types to corresponding processing nodes. The orchestration steps are as follows:

|

||||

|

||||

1. Enable the [Features](/en/guides/workflow/additional-features) function and check both "Images" and "Document" types in the file types.

|

||||

2. Add two list operation nodes, setting to extract image and document variables respectively in the "List Operator" conditions.

|

||||

3. Extract document file variables and pass them to the "Doc Extractor" node; extract image file variables and pass them to the "LLM" node.

|

||||

4. Add a "Answer" node at the end, filling in the output variable of the LLM node.

|

||||

|

||||

|

||||

|

||||

After the application user uploads both document files and images, document files are automatically diverted to the doc extractor node, and image files are automatically diverted to the LLM node to achieve joint processing of mixed files.

|

||||

177

en/guides/workflow/node/llm.mdx

Normal file

177

en/guides/workflow/node/llm.mdx

Normal file

@@ -0,0 +1,177 @@

|

||||

---

|

||||

title: LLM

|

||||

---

|

||||

|

||||

### Definition

|

||||

|

||||

Invokes the capabilities of large language models to process information input by users in the "Start" node (natural language, uploaded files, or images) and provide effective response information.

|

||||

|

||||

|

||||

|

||||

***

|

||||

|

||||

### Scenarios

|

||||

|

||||

LLM is the core node of Chatflow/Workflow, utilizing the conversational/generative/classification/processing capabilities of large language models to handle a wide range of tasks based on given prompts and can be used in different stages of workflows.

|

||||

|

||||

* **Intent Recognition**: In customer service scenarios, identifying and classifying user inquiries to guide downstream processes.

|

||||

* **Text Generation**: In content creation scenarios, generating relevant text based on themes and keywords.

|

||||

* **Content Classification**: In email batch processing scenarios, automatically categorizing emails, such as inquiries/complaints/spam.

|

||||

* **Text Conversion**: In translation scenarios, translating user-provided text into a specified language.

|

||||

* **Code Generation**: In programming assistance scenarios, generating specific business code or writing test cases based on user requirements.

|

||||

* **RAG**: In knowledge base Q\&A scenarios, reorganizing retrieved relevant knowledge to respond to user questions.

|

||||

* **Image Understanding**: Using multimodal models with vision capabilities to understand and answer questions about the information within images.

|

||||

* **File Analysis**: In file processing scenarios, use LLMs to recognize and analyze the information contained within files.

|

||||

|

||||

By selecting the appropriate model and writing prompts, you can build powerful and reliable solutions within Chatflow/Workflow.

|

||||

|

||||

***

|

||||

|

||||

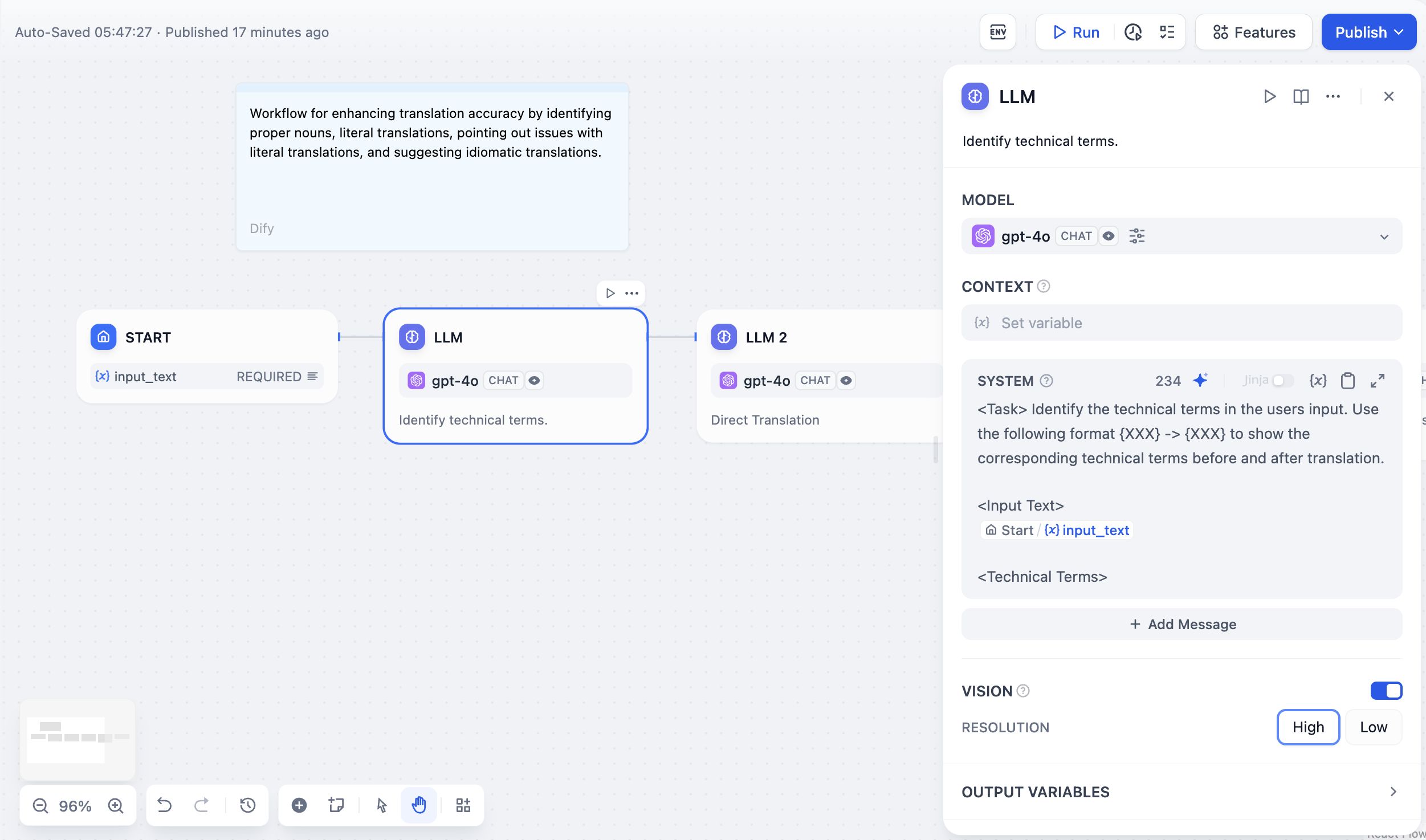

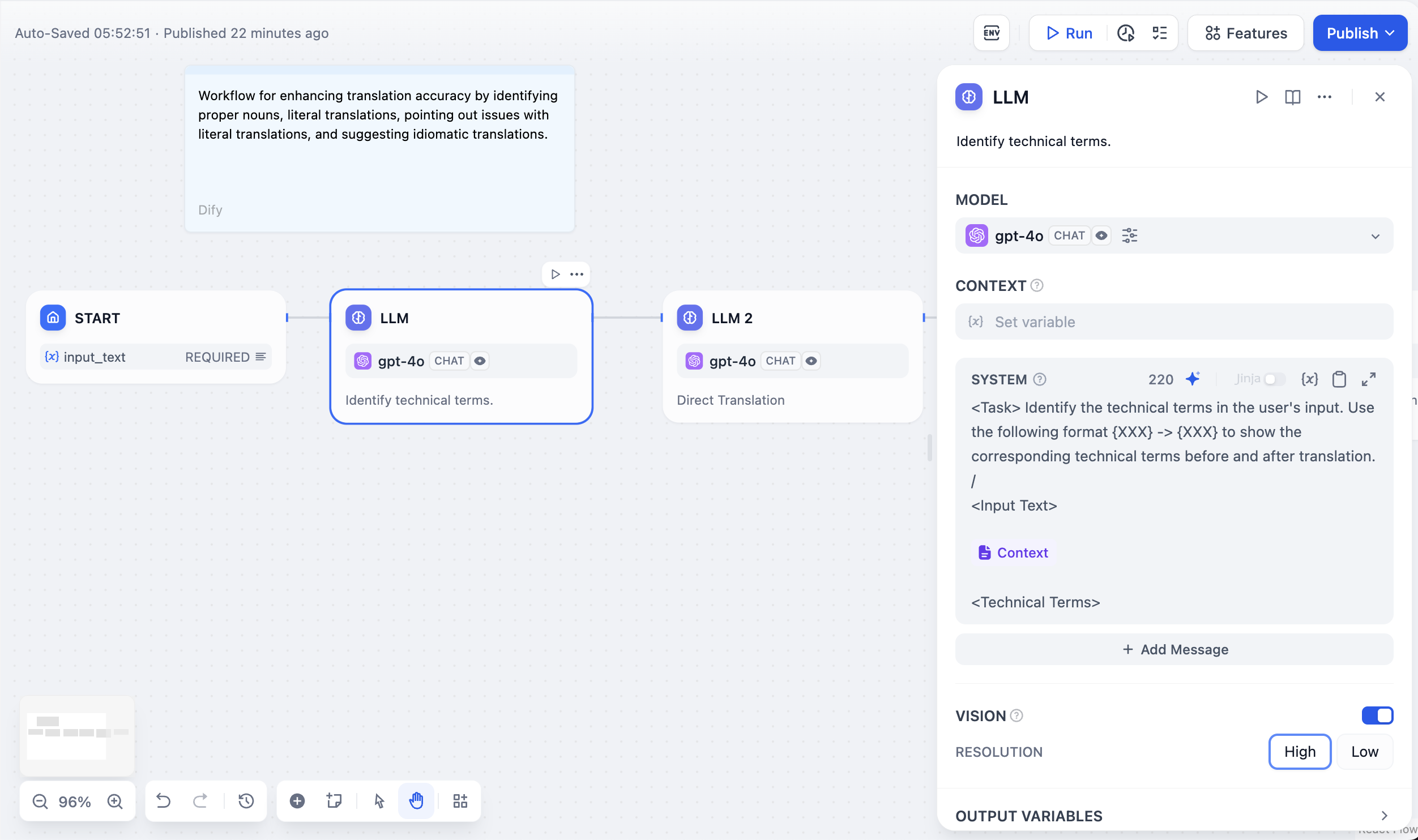

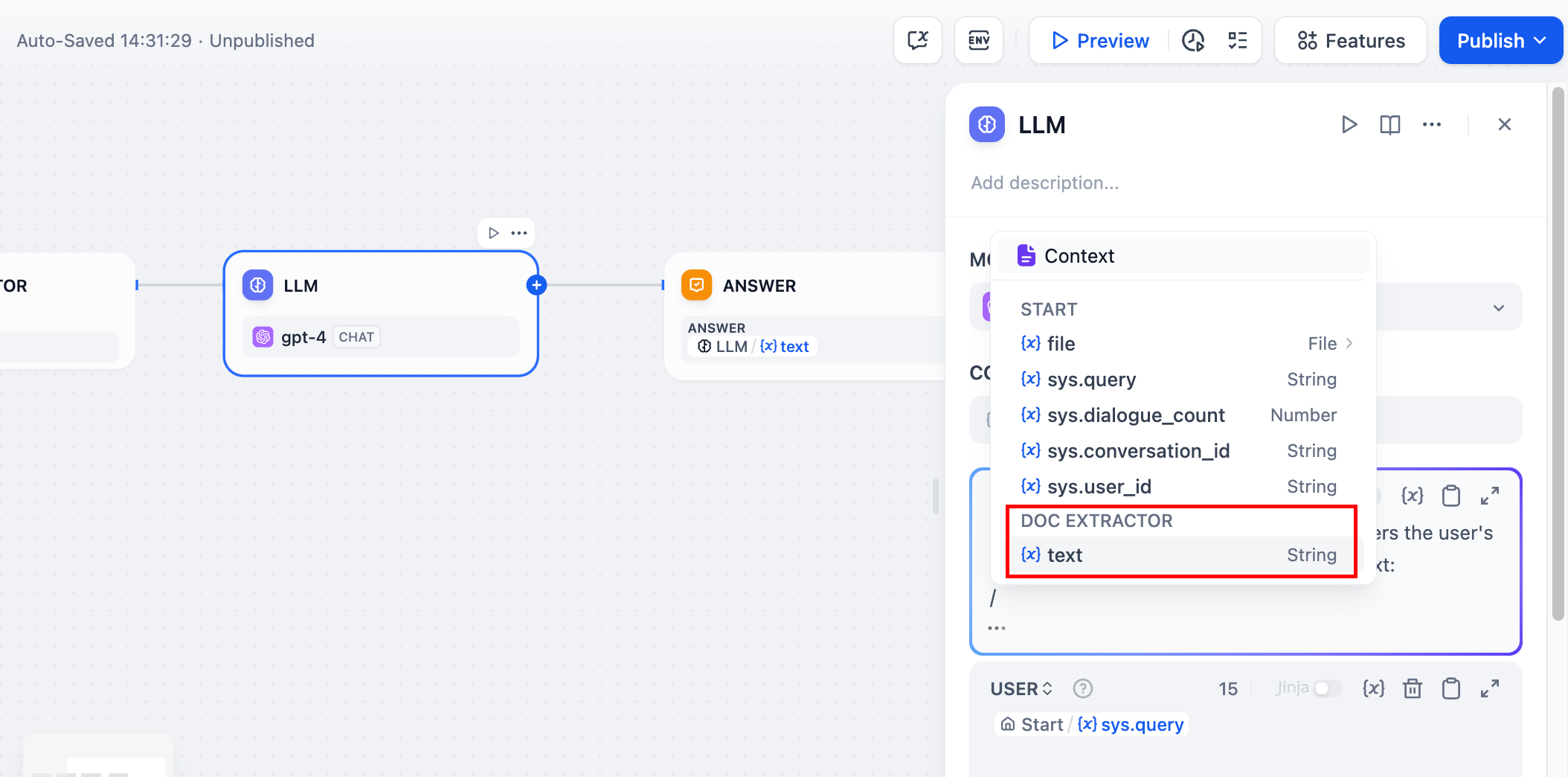

### How to Configure

|

||||

|

||||

|

||||

|

||||

**Configuration Steps:**

|

||||

|

||||

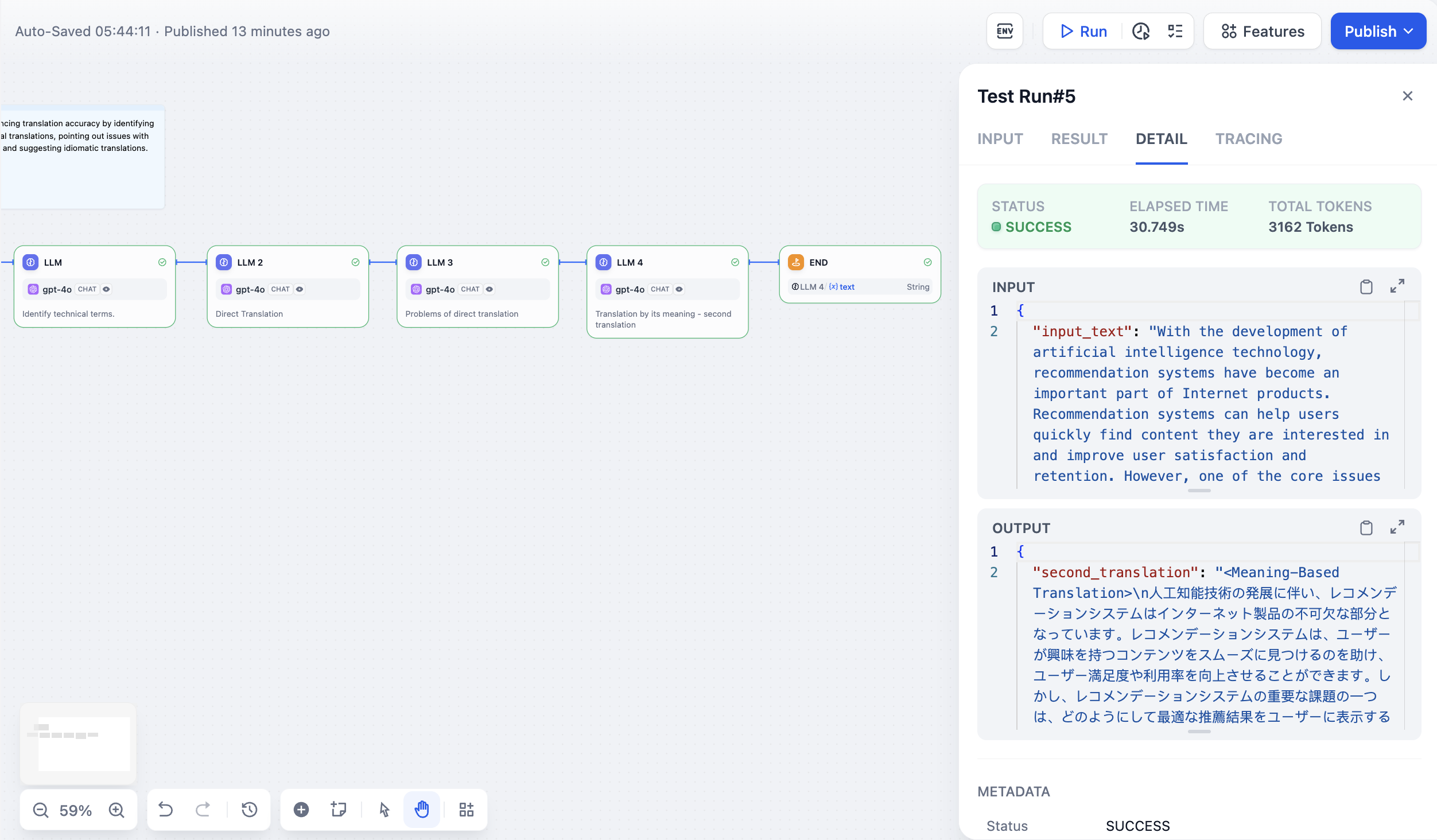

1. **Select a Model**: Dify supports major global models, including OpenAI's GPT series, Anthropic's Claude series, and Google's Gemini series. Choosing a model depends on its inference capability, cost, response speed, context window, etc. You need to select a suitable model based on the scenario requirements and task type.

|

||||

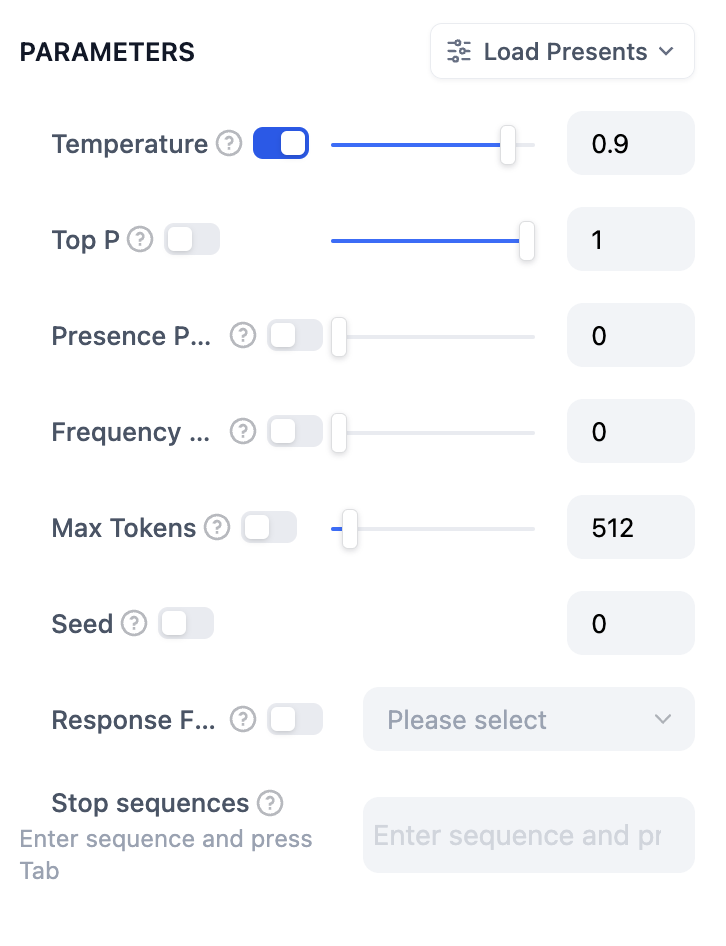

2. **Configure Model Parameters**: Model parameters control the generation results, such as temperature, TopP, maximum tokens, response format, etc. To facilitate selection, the system provides three preset parameter sets: Creative, Balanced, and Precise.

|

||||

3. **Write Prompts**: The LLM node offers an easy-to-use prompt composition page. Selecting a chat model or completion model will display different prompt composition structures.

|

||||

4. **Advanced Settings**: You can enable memory, set memory windows, and use the Jinja-2 template language for more complex prompts.

|

||||

|

||||

<Info>

|

||||

If you are using Dify for the first time, you need to complete the [model configuration](/en/guides/model-configuration) in **System Settings-Model Providers** before selecting a model in the LLM node.

|

||||

</Info>

|

||||

|

||||

#### **Writing Prompts**

|

||||

|

||||

In the LLM node, you can customize the model input prompts. If you select a chat model, you can customize the System/User/Assistant sections.

|

||||

|

||||

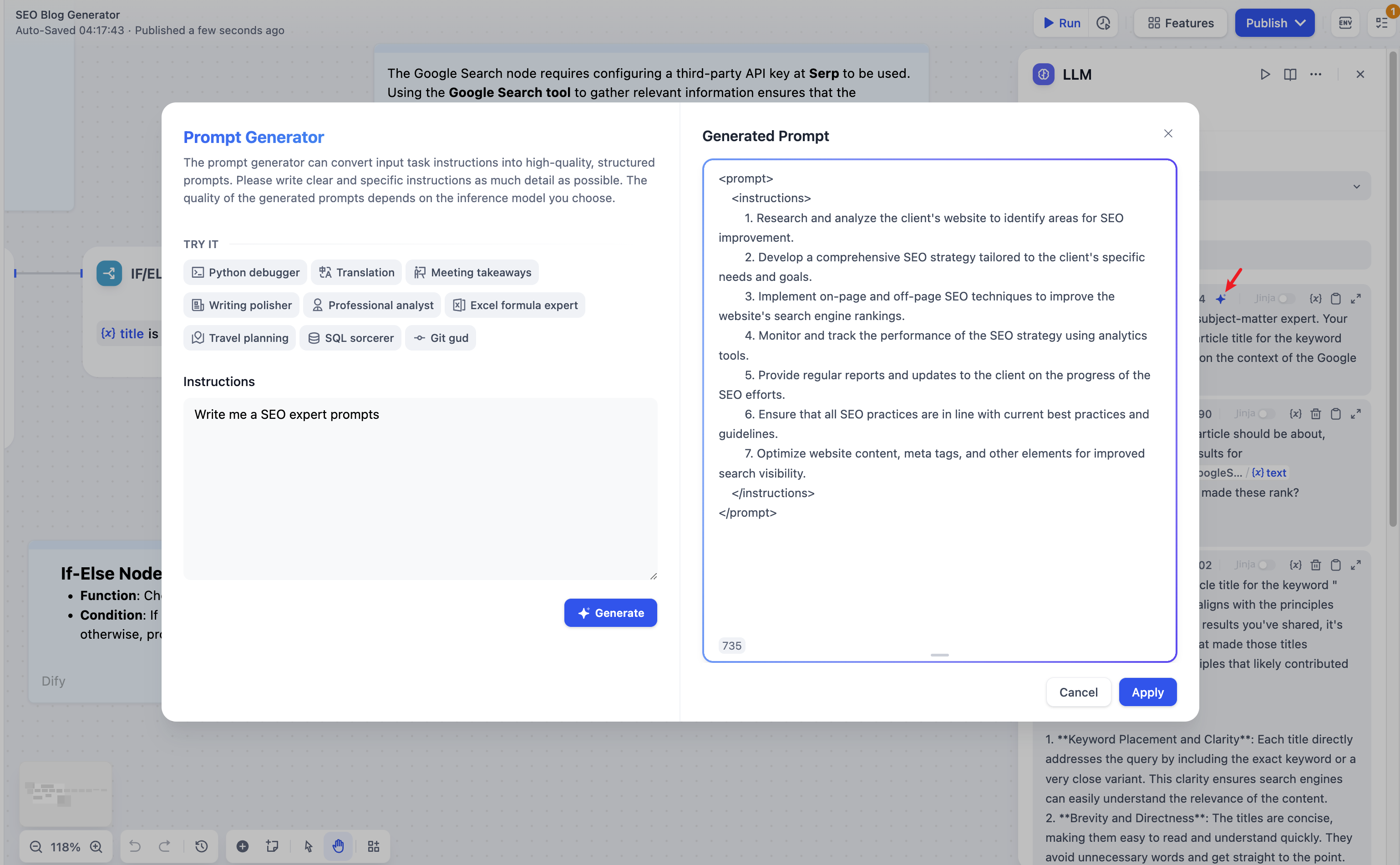

**Prompt Generator**

|

||||

|

||||

If you're struggling to come up with effective system prompts (System), you can use the Prompt Generator to quickly create prompts suitable for your specific business scenarios, leveraging AI capabilities.

|

||||

|

||||

|

||||

|

||||

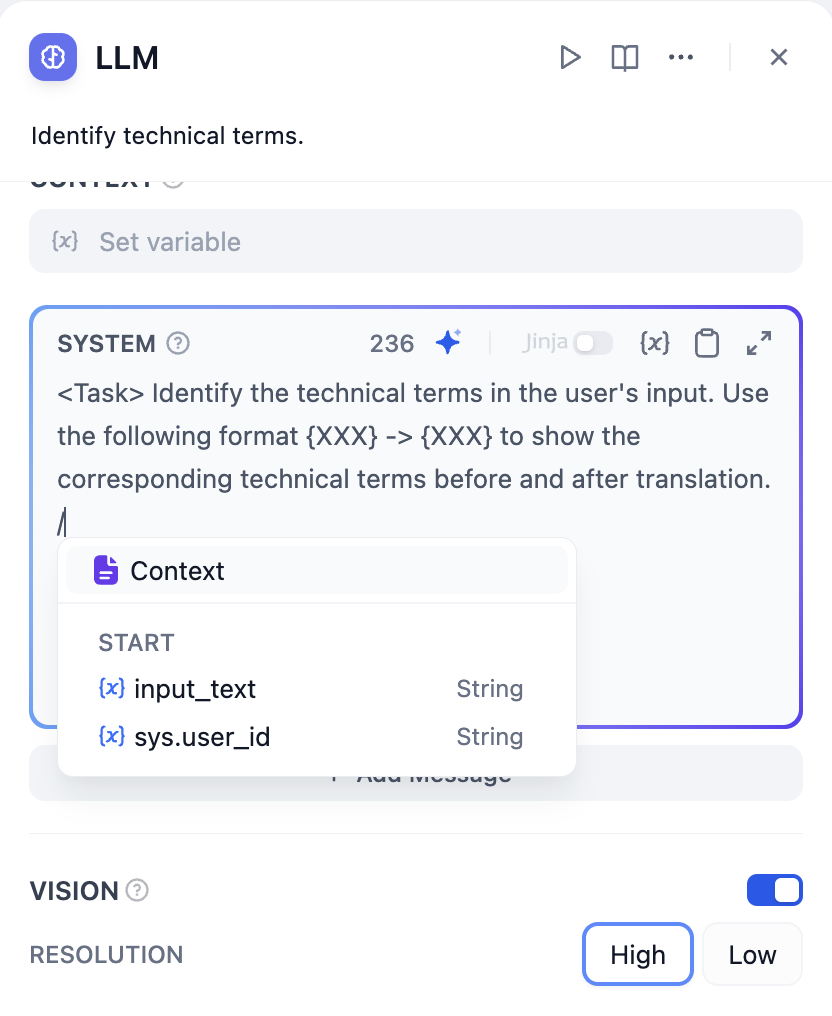

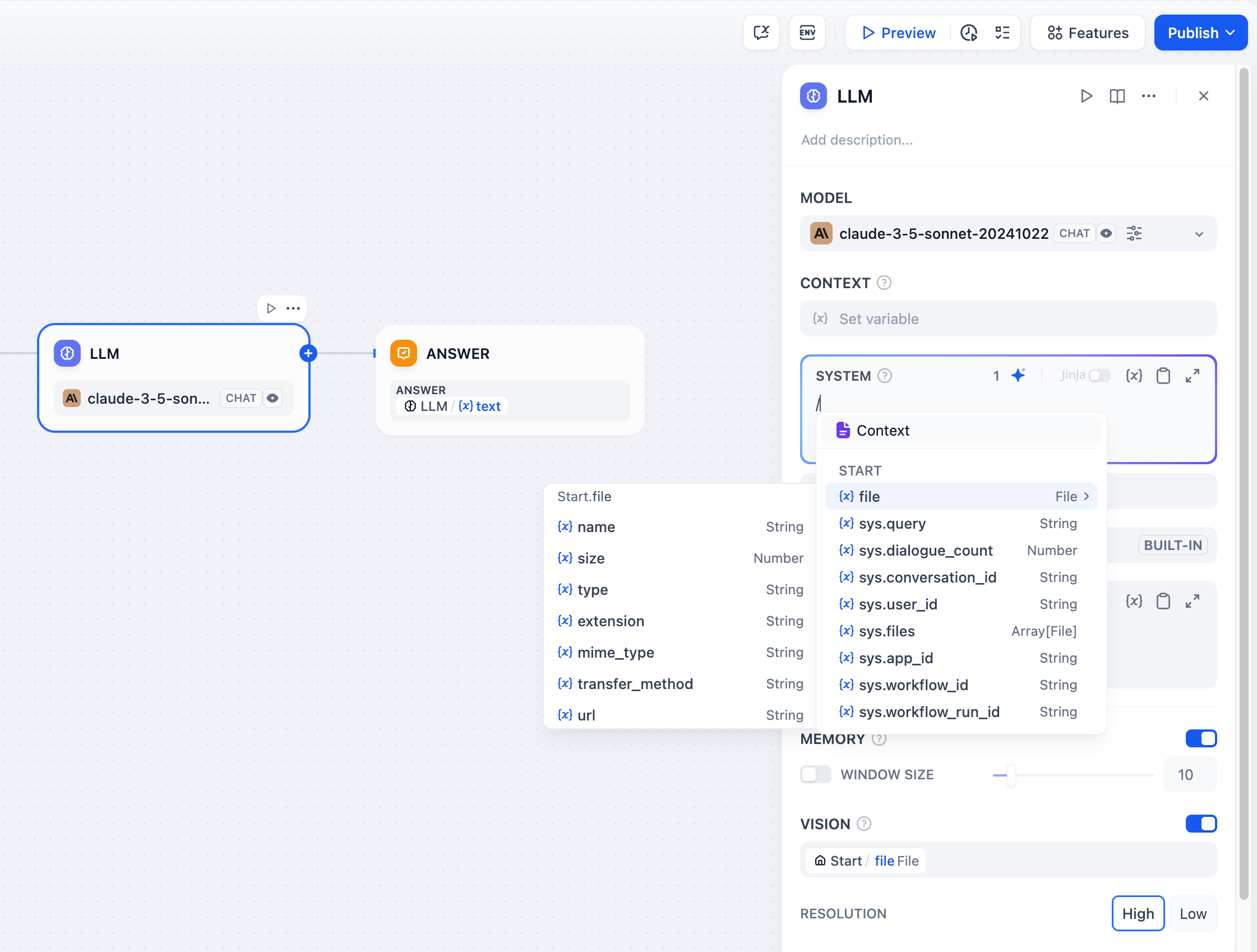

In the prompt editor, you can call out the **variable insertion menu** by typing `/` or `{` to insert **special variable blocks** or **upstream node variables** into the prompt as context content.

|

||||

|

||||

|

||||

|

||||

***

|

||||

|

||||

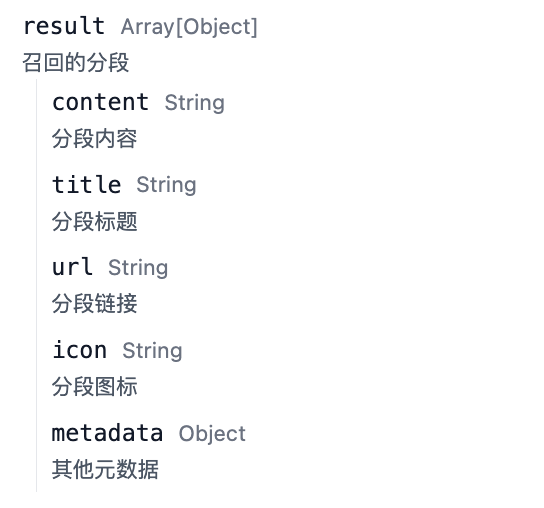

### Explanation of Special Variables

|

||||

|

||||

**Context Variables**

|

||||

|

||||

Context variables are a special type of variable defined within the LLM node, used to insert externally retrieved text content into the prompt.

|

||||

|

||||

|

||||

|

||||

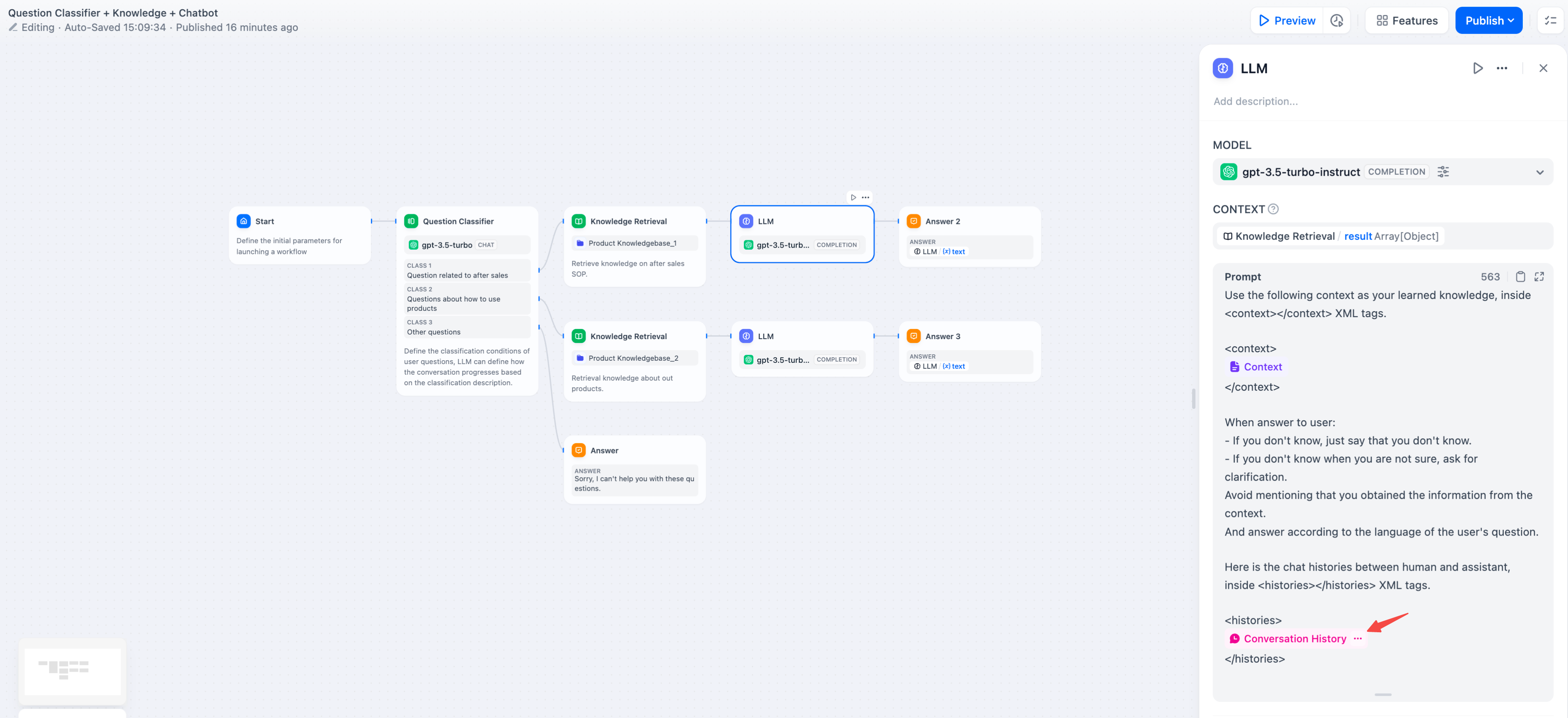

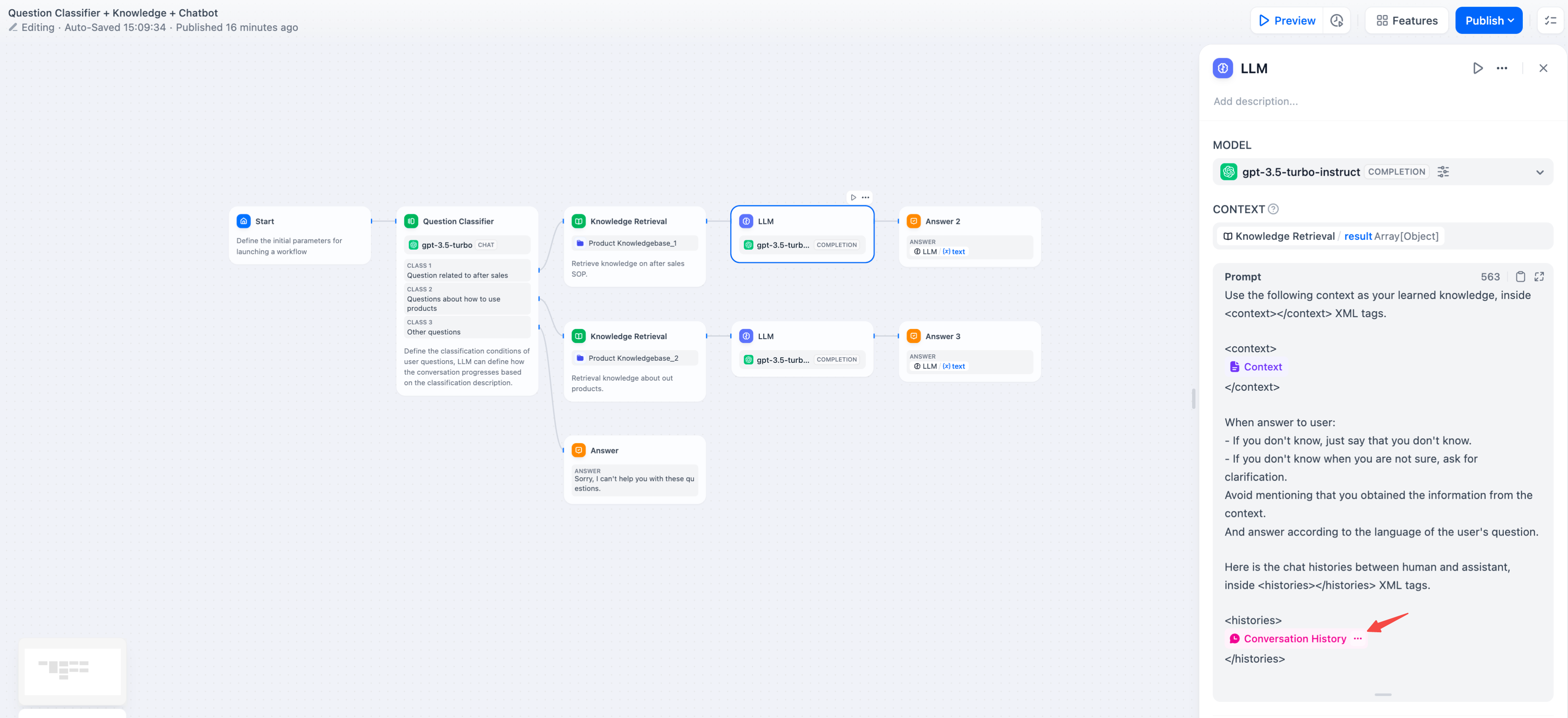

In common knowledge base Q\&A applications, the downstream node of knowledge retrieval is typically the LLM node. The **output variable** `result` of knowledge retrieval needs to be configured in the **context variable** within the LLM node for association and assignment. After association, inserting the **context variable** at the appropriate position in the prompt can incorporate the externally retrieved knowledge into the prompt.

|

||||

|

||||

This variable can be used not only as external knowledge introduced into the prompt context for LLM responses but also supports the application's [citation and attribution](/en/guides/knowledge-base/retrieval-test-and-citation#id-2-citation-and-attribution) feature due to its data structure containing segment reference information.

|

||||

|

||||

<Info>

|

||||

If the context variable is associated with a common variable from an upstream node, such as a string type variable from the start node, the context variable can still be used as external knowledge, but the **citation and attribution** feature will be disabled.

|

||||

</Info>

|

||||

|

||||

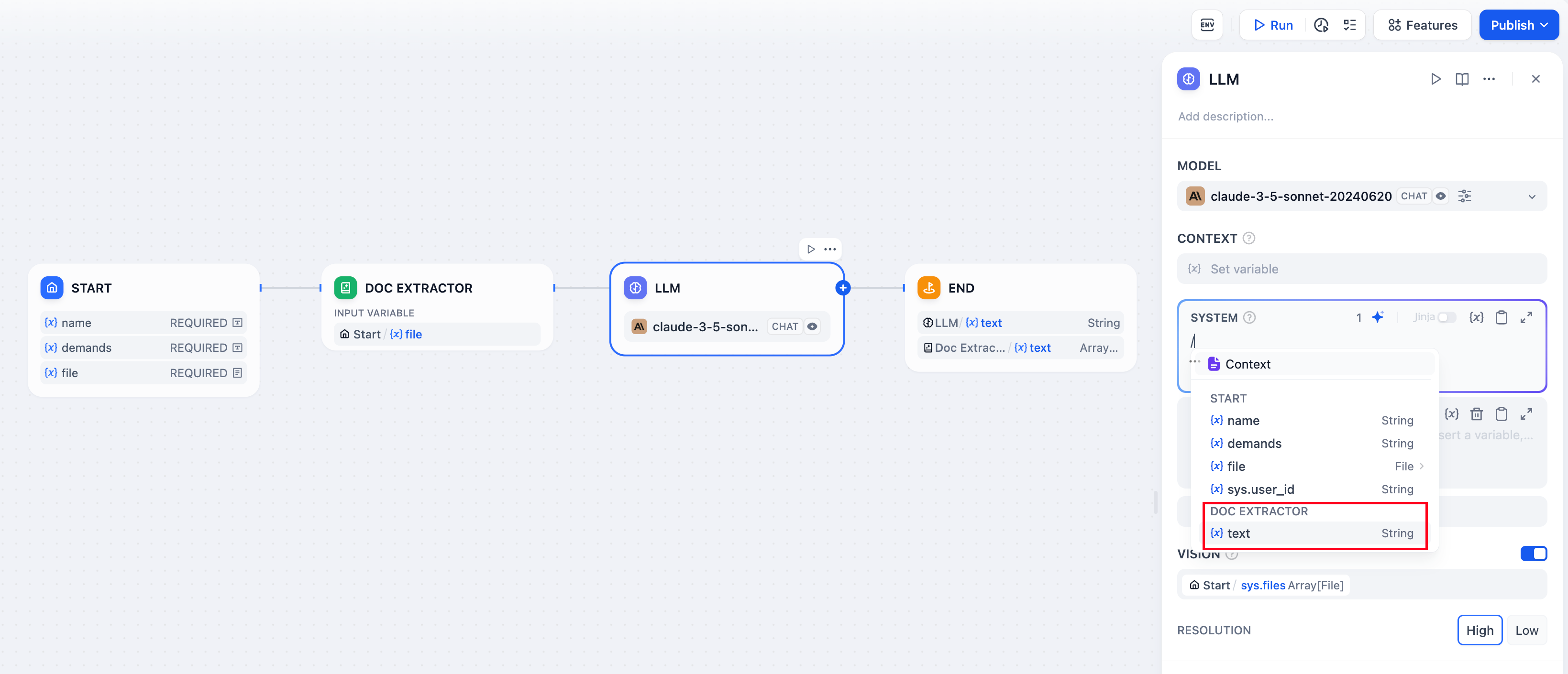

**File Variables**

|

||||

|

||||

Some LLMs, such as [Claude 3.5 Sonnet](https://docs.anthropic.com/en/docs/build-with-claude/pdf-support), now support direct processing of file content, enabling the use of file variables in prompts. To prevent potential issues, application developers should verify the supported file types on the LLM's official website before utilizing the file variable.

|

||||

|

||||

|

||||

|

||||

> Refer to [File Upload](/en/guides/workflow/file-upload) for guidance on building a Chatflow/Workflow application with file upload functionality.

|

||||

|

||||

**Conversation History**

|

||||

|

||||

To achieve conversational memory in text completion models (e.g., gpt-3.5-turbo-Instruct), Dify designed the conversation history variable in the original [Prompt Expert Mode (discontinued)](/en/learn-more/extended-reading/prompt-engineering/prompt-engineering-1). This variable is carried over to the LLM node in Chatflow, used to insert chat history between the AI and the user into the prompt, helping the LLM understand the context of the conversation.

|

||||

|

||||

<Info>

|

||||

The conversation history variable is not widely used and can only be inserted when selecting text completion models in Chatflow.

|

||||

</Info>

|

||||

|

||||

|

||||

|

||||

**Model Parameters**

|

||||

|

||||

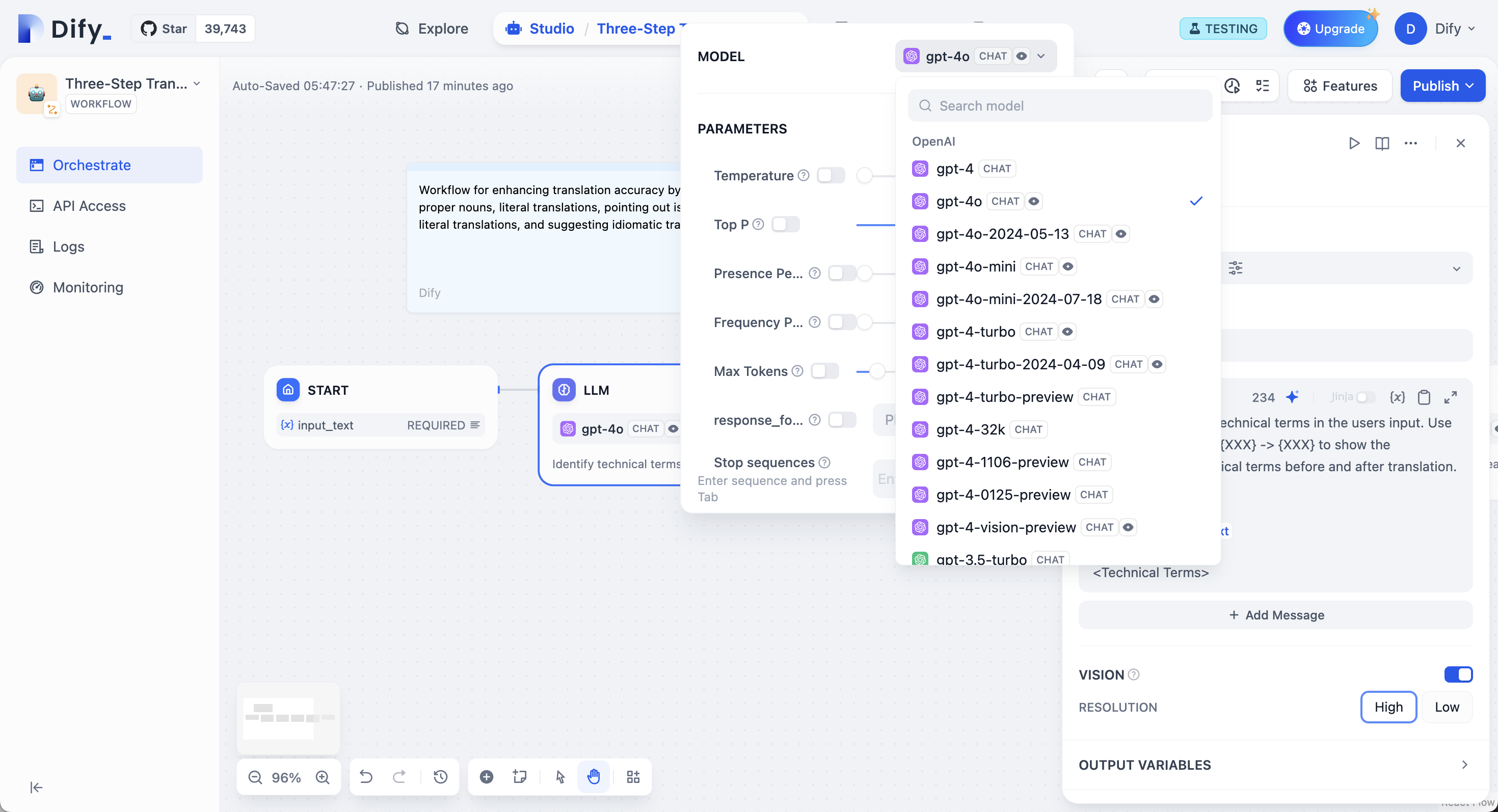

The parameters of the model affect the output of the model. Different models have different parameters. The following figure shows the parameter list for `gpt-4`.

|

||||

|

||||

|

||||

|

||||

The main parameter terms are explained as follows:

|

||||

|

||||

**Temperature**: Usually a value between 0-1, it controls randomness. The closer the temperature is to 0, the more certain and repetitive the results; the closer it is to 1, the more random the results.

|

||||

|

||||

**Top P**: Controls the diversity of the results. The model selects from candidate words based on probability, ensuring that the cumulative probability does not exceed the preset threshold P.

|

||||

|

||||

**Presence Penalty**: Used to reduce the repetitive generation of the same entity or information by imposing penalties on content that has already been generated, making the model inclined to generate new or different content. As the parameter value increases, greater penalties are applied in subsequent generations to content that has already been generated, lowering the likelihood of repeating content.

|

||||

|

||||

**Frequency Penalty**: Imposes penalties on words or phrases that appear too frequently by reducing their probability of generation. With an increase in parameter value, greater penalties are imposed on frequently occurring words or phrases. Higher parameter values reduce the frequency of these words, thereby increasing the lexical diversity of the text.

|

||||

|

||||

If you do not understand what these parameters are, you can choose to load presets and select from the three presets: Creative, Balanced, and Precise.

|

||||

|

||||

|

||||

|

||||

***

|

||||

|

||||

### Advanced Features

|

||||

|

||||

**Memory**: When enabled, each input to the intent classifier will include chat history from the conversation to help the LLM understand the context and improve question comprehension in interactive dialogues.

|

||||

|

||||

**Memory Window**: When the memory window is closed, the system dynamically filters the amount of chat history passed based on the model's context window; when open, users can precisely control the amount of chat history passed (in terms of numbers).

|

||||

|

||||

**Conversation Role Name Settings**: Due to differences in model training stages, different models adhere to role name instructions differently, such as Human/Assistant, Human/AI, Human/Assistant, etc. To adapt to the prompt response effects of multiple models, the system provides conversation role name settings. Modifying the role name will change the role prefix in the conversation history.

|

||||

|

||||

**Jinja-2 Templates**: The LLM prompt editor supports Jinja-2 template language, allowing you to leverage this powerful Python template language for lightweight data transformation and logical processing. Refer to the [official documentation](https://jinja.palletsprojects.com/en/3.1.x/templates/).

|

||||

|

||||

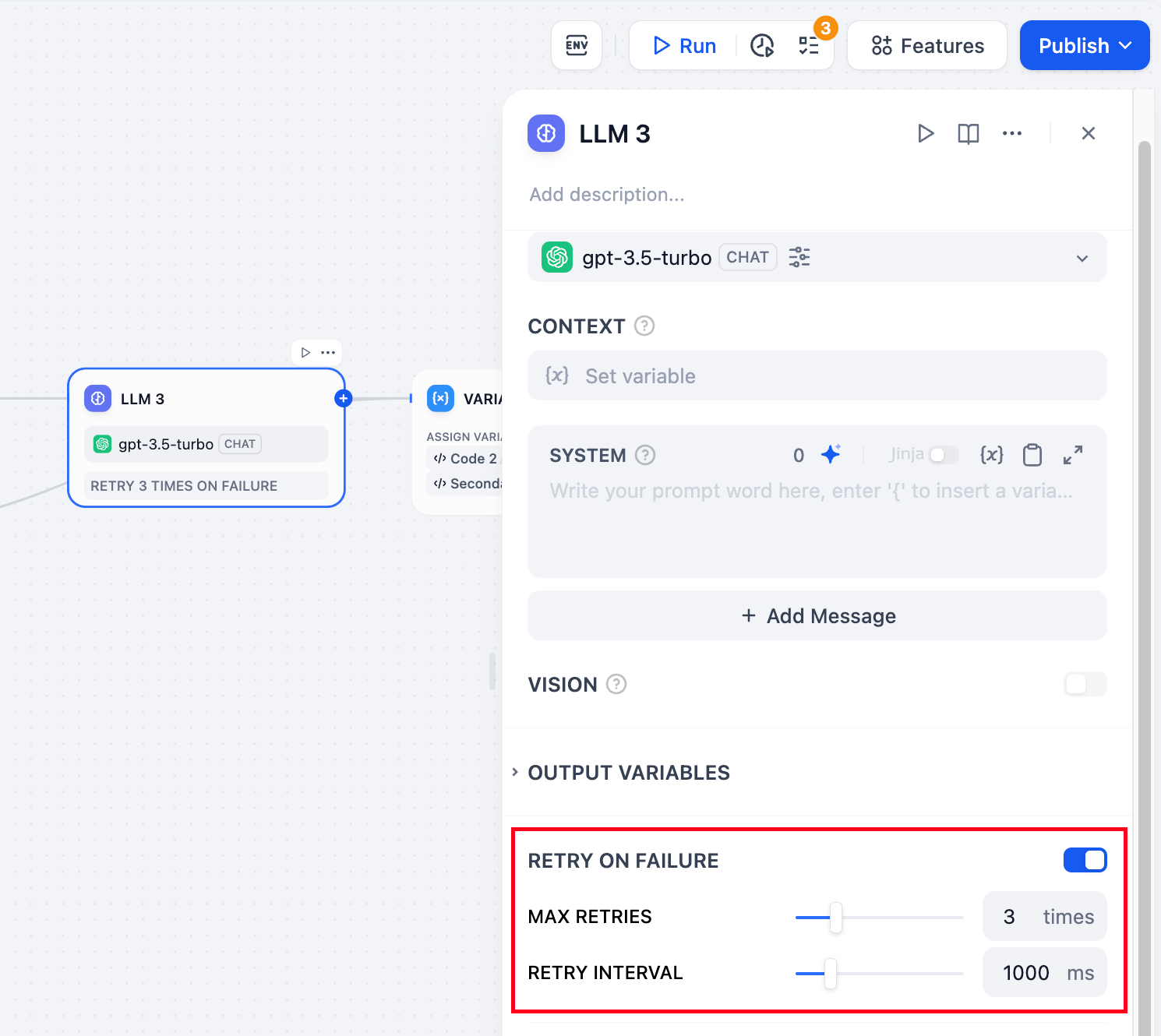

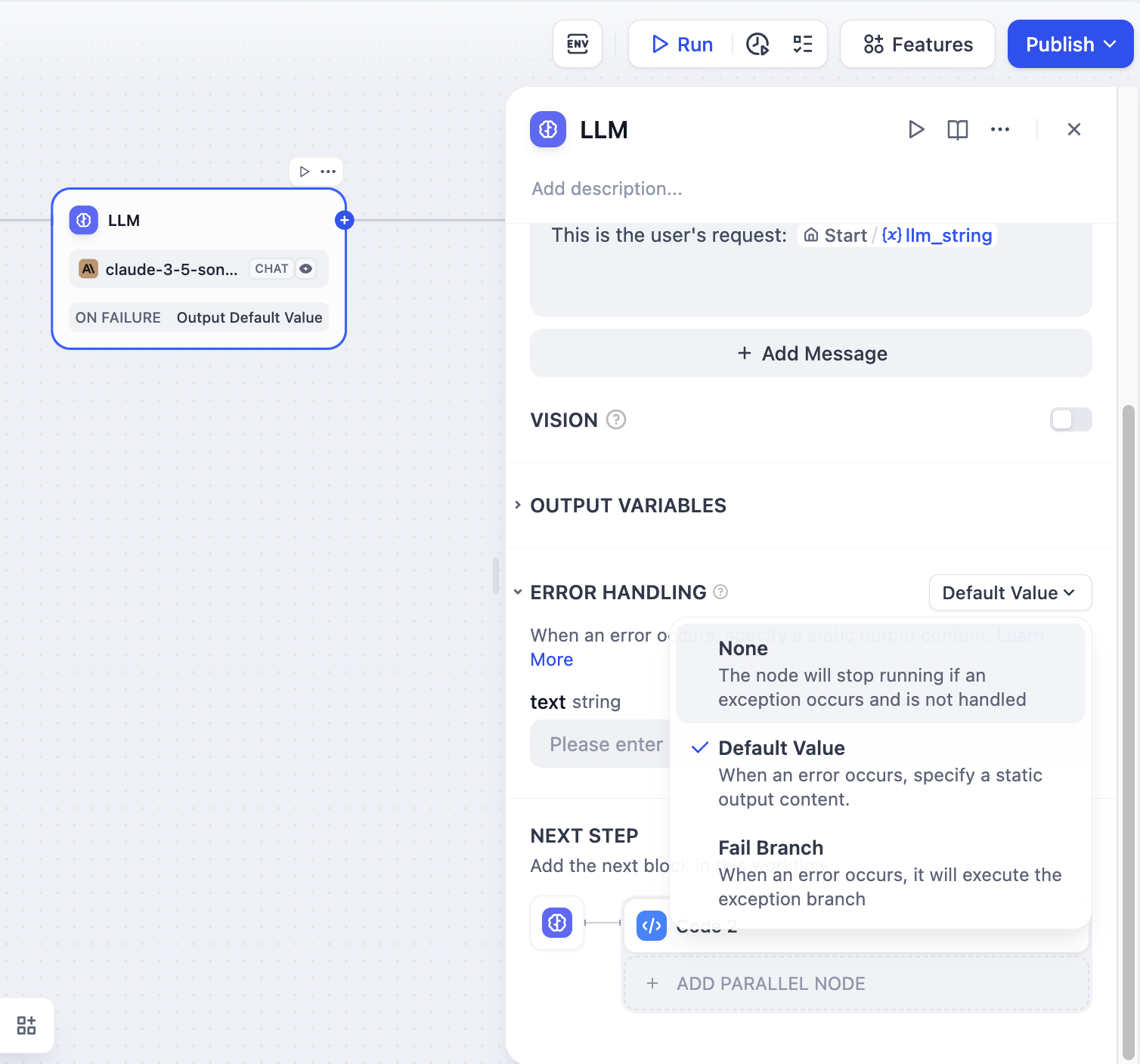

**Retry on Failure**: For some exceptions that occur in the node, it is usually sufficient to retry the node again. When the error retry function is enabled, the node will automatically retry according to the preset strategy when an error occurs. You can adjust the maximum number of retries and the interval between each retry to set the retry strategy.

|

||||

|

||||

- The maximum number of retries is 10

|

||||

- The maximum retry interval is 5000 ms

|

||||

|

||||

|

||||

|

||||

**Error Handling**: Provides diverse node error handling strategies that can throw error messages when the current node fails without interrupting the main process, or continue completing tasks through backup paths. For detailed information, please refer to the [Error Handling](/en/guides/workflow/error-handling).

|

||||

|

||||

***

|

||||

|

||||

#### Use Cases

|

||||

|

||||

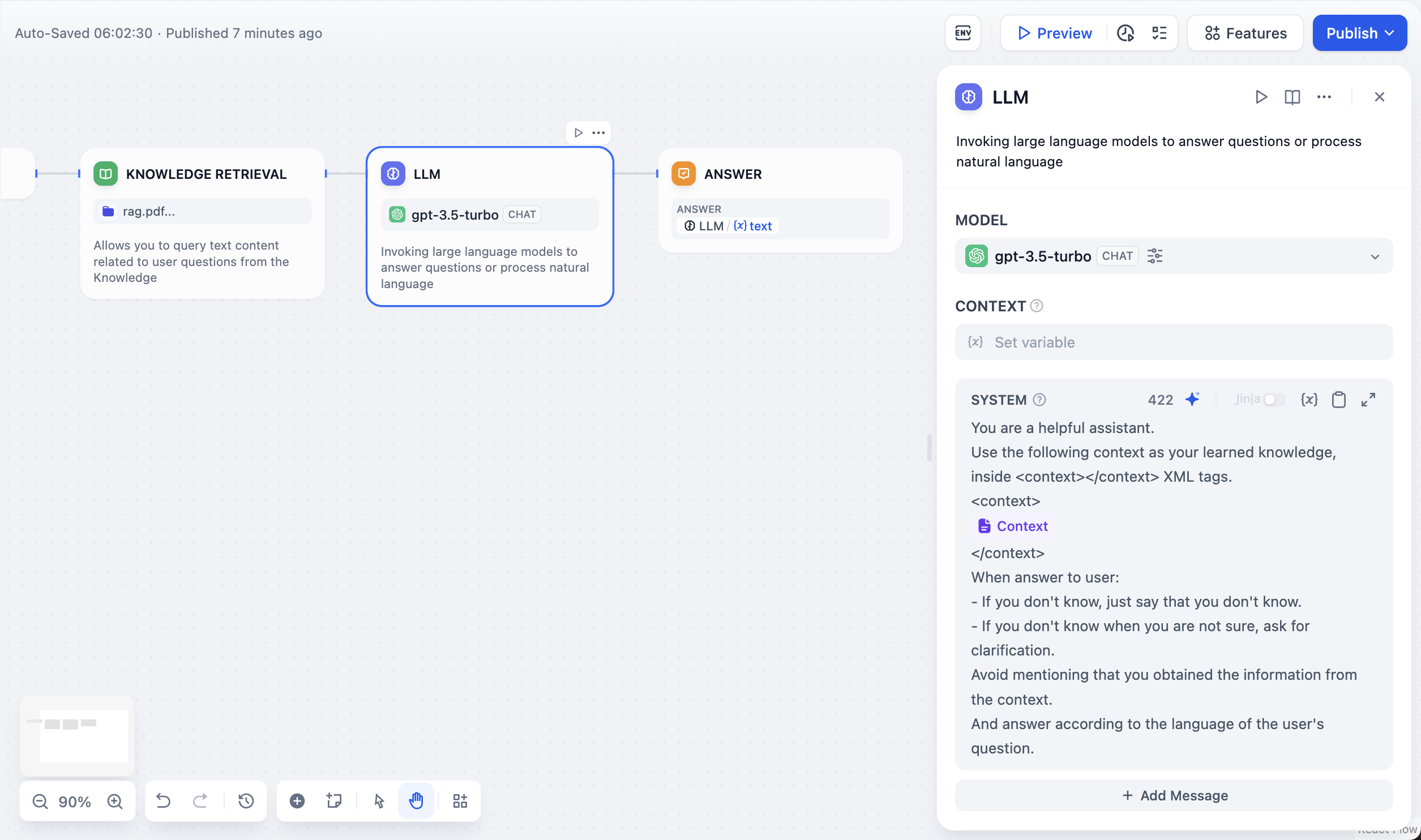

* **Reading Knowledge Base Content**

|

||||

|

||||

To enable workflow applications to read [Knowledge Base](/en/guides/knowledge-base) content, such as building an intelligent customer service application, please follow these steps:

|

||||

|

||||

1. Add a knowledge base retrieval node upstream of the LLM node;

|

||||

2. Fill in the **output variable** `result` of the knowledge retrieval node into the **context variable** of the LLM node;

|

||||

3. Insert the **context variable** into the application prompt to give the LLM the ability to read text within the knowledge base.

|

||||

|

||||

|

||||

|

||||

The `result` variable output by the Knowledge Retrieval Node also includes segmented reference information. You can view the source of information through the **Citation and Attribution** feature.

|

||||

|

||||

<Info>

|

||||

Regular variables from upstream nodes can also be filled into context variables, such as string-type variables from the start node, but the **Citation and Attribution** feature will be ineffective.

|

||||

</Info>

|

||||

|

||||

* **Reading Document Files**

|

||||

|

||||

To enable workflow applications to read document contents, such as building a ChatPDF application, you can follow these steps:

|

||||

|

||||

* Add a file variable in the "Start" node;

|

||||

* Add a document extractor node upstream of the LLM node, using the file variable as an input variable;

|

||||

* Fill in the **output variable** `text` of the document extractor node into the prompt of the LLM node.

|

||||

|

||||

For more information, please refer to [File Upload](/en/guides/workflow/file-upload).

|

||||

|

||||

|

||||

|

||||

* **Error Handling**

|

||||

|

||||

When processing information, LLM nodes may encounter errors such as input text exceeding token limits or missing key parameters. Developers can follow these steps to configure exception branches, enabling contingency plans when node errors occur to avoid interrupting the entire flow:

|

||||

|

||||

1. Enable "Error Handling" in the LLM node

|

||||

2. Select and configure an error handling strategy

|

||||

|

||||

|

||||

|

||||

For more information about exception handling methods, please refer to the [Error Handling](/en/guides/workflow/error-handling).

|

||||

85

en/guides/workflow/node/loop.mdx

Normal file

85

en/guides/workflow/node/loop.mdx

Normal file

@@ -0,0 +1,85 @@

|

||||

---

|

||||

title: Loop

|

||||

---

|

||||

|

||||

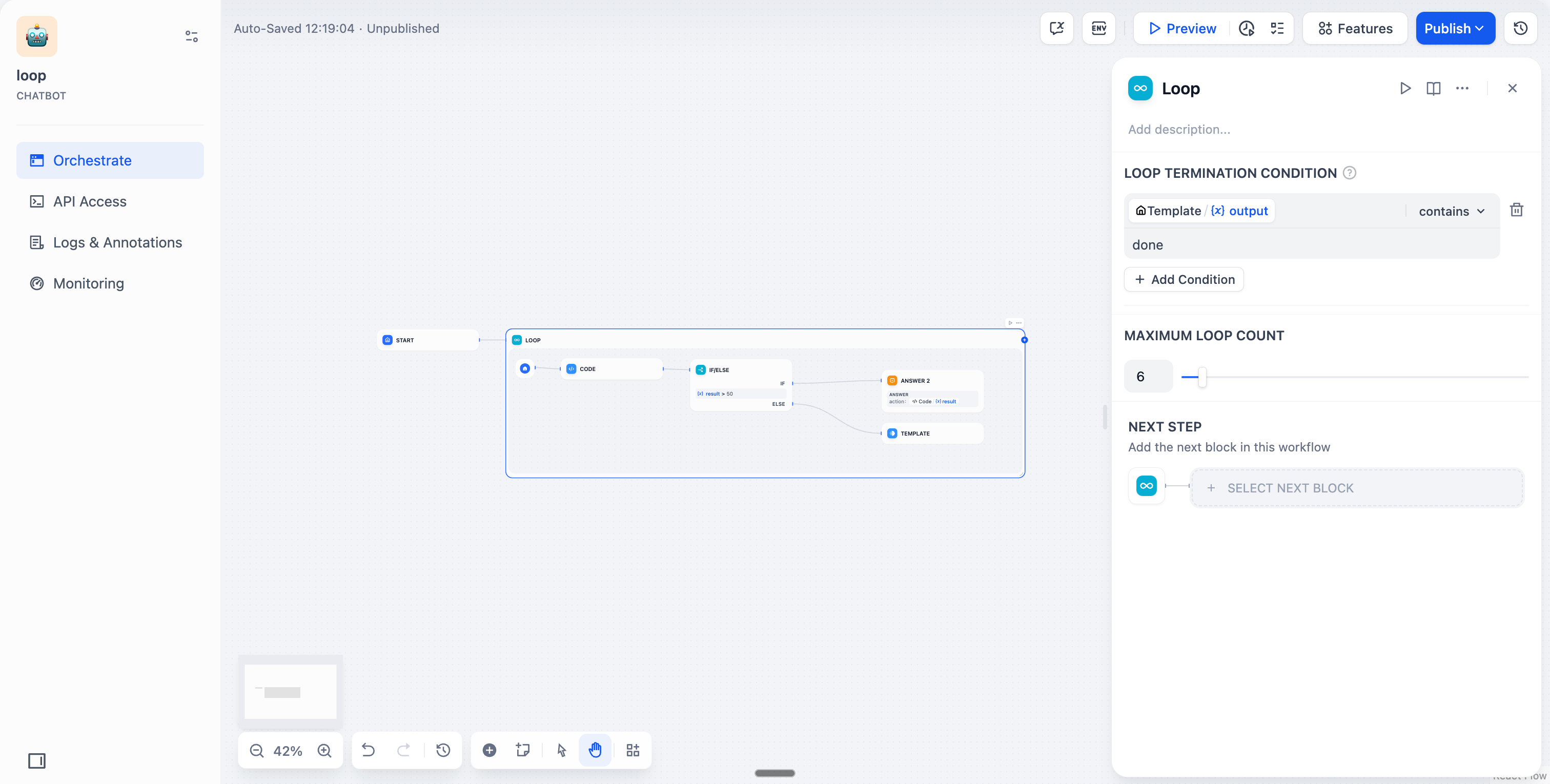

## What is Loop Node?

|

||||

|

||||

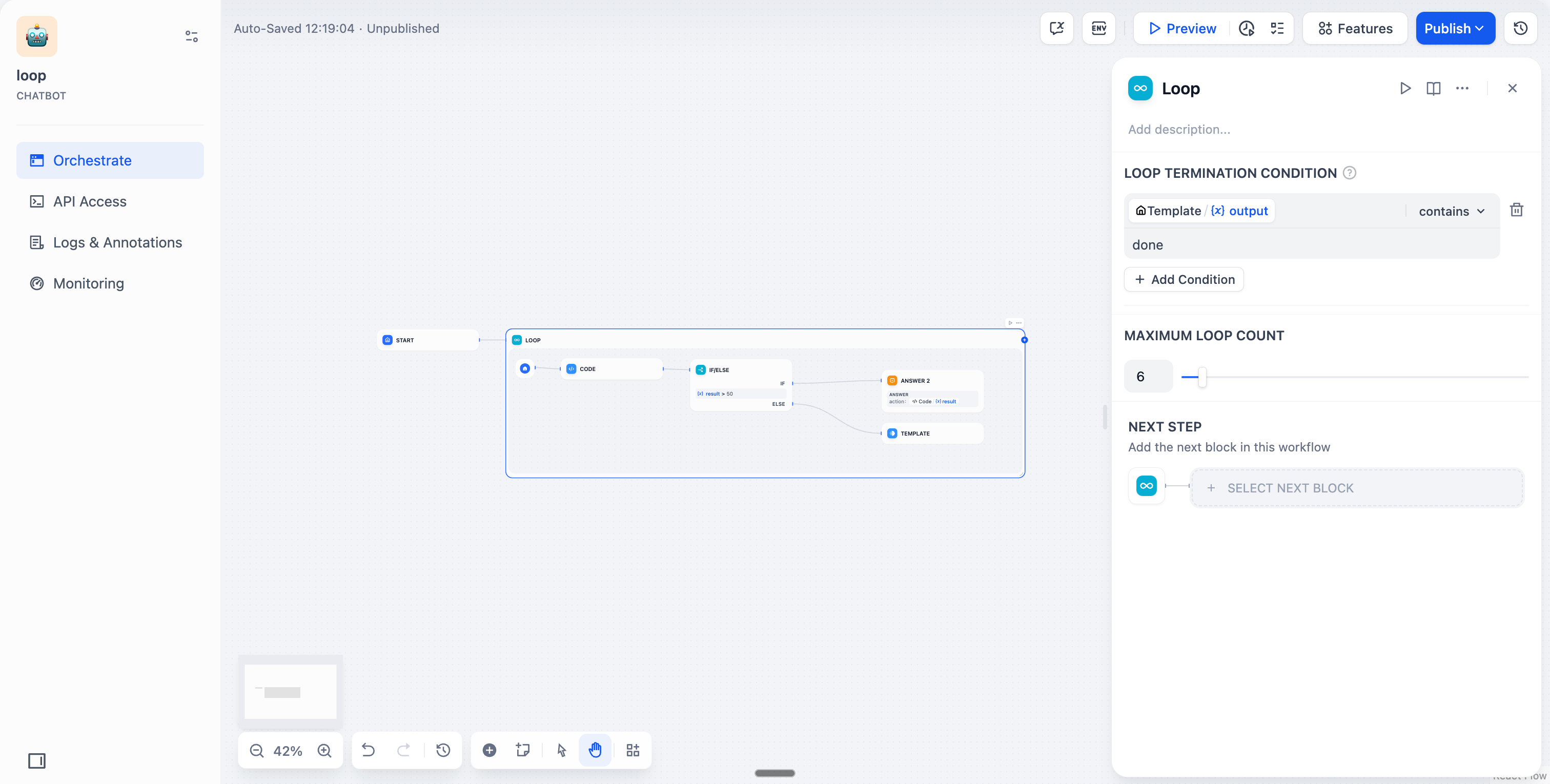

A **Loop** node executes repetitive tasks that depend on previous iteration results until exit conditions are met or the maximum loop count is reached.

|

||||

|

||||

## Loop vs. Iteration

|

||||

|

||||

<table>

|

||||

<thead>

|

||||

<tr>

|

||||

<th>Type</th>

|

||||

<th>Dependencies</th>

|

||||

<th>Use Cases</th>

|

||||

</tr>

|

||||

</thead>

|

||||

<tbody>

|

||||

<tr>

|

||||

<td><strong>Loop</strong></td>

|

||||

<td>Each iteration depends on previous results</td>

|

||||

<td>Recursive operations, optimization problems</td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td><strong>Iteration</strong></td>

|

||||

<td>Iterations execute independently</td>

|

||||

<td>Batch processing, parallel data handling</td>

|

||||

</tr>

|

||||

</tbody>

|

||||

</table>

|

||||

|

||||

## Configuration

|

||||

|

||||

<table>

|

||||

<thead>

|

||||

<tr>

|

||||

<th>Parameter</th>

|

||||

<th>Description</th>

|

||||

<th>Example</th>

|

||||

</tr>

|

||||

</thead>

|

||||

<tbody>

|

||||

<tr>

|

||||

<td>Loop Termination Condition</td>

|

||||

<td>Expression that determines when to exit the loop</td>

|

||||

<td><code>x < 50</code>, <code>error_rate < 0.01</code></td>

|

||||

</tr>

|

||||

<tr>

|

||||

<td>Maximum Loop Count</td>

|

||||

<td>Upper limit on iterations to prevent infinite loops</td>

|

||||

<td>10, 100, 1000</td>

|

||||

</tr>

|

||||

</tbody>

|

||||

</table>

|

||||

|

||||

|

||||

|

||||

## Usage Example

|

||||

|

||||

**Goal: Generate random numbers (1-100) until a value below 50 appears.**

|

||||

|

||||

**Steps**:

|

||||

|

||||

1. Use `node` to generate a random number between 1-100.

|

||||

|

||||

2. Use `if` to evaluate the number:

|

||||

|

||||

- If < 50: Output `done` and terminate loop.

|

||||

|

||||

- If ≥ 50: Continue loop and generate another random number.

|

||||

|

||||

3. Set the exit criterion to random_number < 50.

|

||||

|

||||

4. Loop ends when a number below 50 appears.

|

||||

|

||||

|

||||

|

||||

## Planned Enhancements

|

||||

|

||||

**Future releases will include:**

|

||||

|

||||

- Loop variables: Store and reference values across iterations for improved state management and conditional logic.

|

||||

|

||||

- `break` node: Terminate loops from within the execution path, enabling more sophisticated control flow patterns.

|

||||

61

en/guides/workflow/node/parameter-extractor.mdx

Normal file

61

en/guides/workflow/node/parameter-extractor.mdx

Normal file

@@ -0,0 +1,61 @@

|

||||

---

|

||||

title: Parameter Extraction

|

||||

---

|

||||

|

||||

|

||||

### 1 Definition

|

||||

|

||||

Utilize LLM to infer and extract structured parameters from natural language for subsequent tool invocation or HTTP requests.

|

||||

|

||||

Dify workflows provide a rich selection of [tools](/en/tools), most of which require structured parameters as input. The parameter extractor can convert user natural language into parameters recognizable by these tools, facilitating tool invocation.

|

||||

|

||||

Some nodes within the workflow require specific data formats as inputs, such as the [iteration](/en/guides/workflow/nodes/iteration#definition) node, which requires an array format. The parameter extractor can conveniently achieve [structured parameter conversion](/en/guides/workflow/nodes/iteration#example-1-long-article-iteration-generator).

|

||||

|

||||

***

|

||||

|

||||

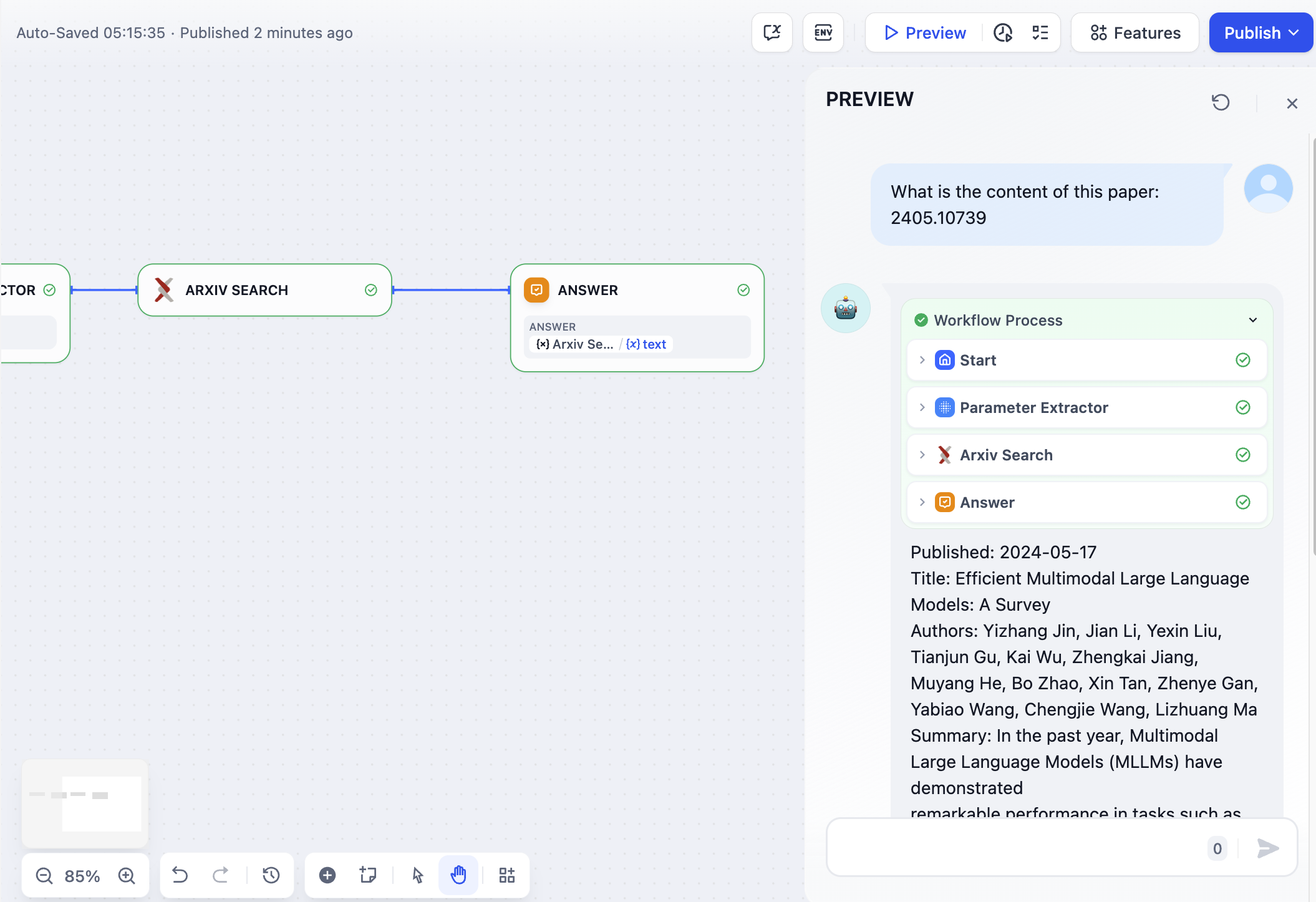

### 2 Scenarios

|

||||

|

||||

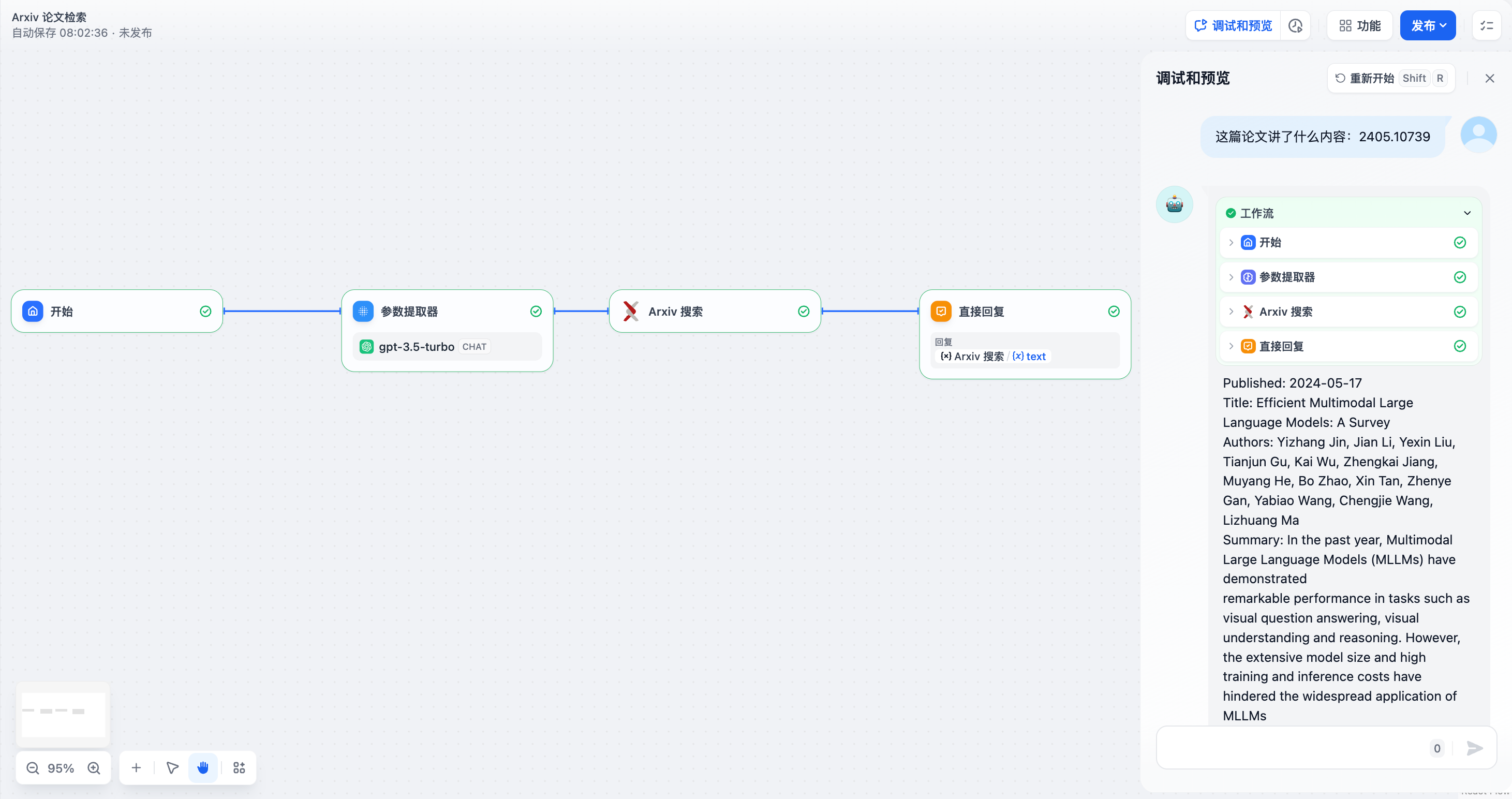

1. **Extracting key parameters required by tools from natural language**, such as building a simple conversational Arxiv paper retrieval application.

|

||||

|

||||

In this example: The Arxiv paper retrieval tool requires **paper author** or **paper ID** as input parameters. The parameter extractor extracts the paper ID **2405.10739** from the query "What is the content of this paper: 2405.10739" and uses it as the tool parameter for precise querying.

|

||||

|

||||

|

||||

|

||||

2. **Converting text to structured data**, such as in the long story iteration generation application, where it serves as a pre-step for the [iteration node](/en/guides/workflow/nodes/iteration), converting chapter content in text format to an array format, facilitating multi-round generation processing by the iteration node.

|

||||

|

||||

|

||||

|

||||

1. **Extracting structured data and using the** [**HTTP Request**](/en/guides/workflow/nodes/http-request), which can request any accessible URL, suitable for obtaining external retrieval results, webhooks, generating images, and other scenarios.

|

||||

|

||||

***

|

||||

|

||||

### 3 How to Configure

|

||||

|

||||

**Configuration Steps**

|

||||

|

||||

1. Select the input variable, usually the variable input for parameter extraction.

|

||||

2. Choose the model, as the parameter extractor relies on the LLM's inference and structured generation capabilities.

|

||||

3. Define the parameters to extract, which can be manually added or **quickly imported from existing tools**.

|

||||

4. Write instructions, where providing examples can help the LLM improve the effectiveness and stability of extracting complex parameters.

|

||||

|

||||

**Advanced Settings**

|

||||

|

||||

**Inference Mode**

|

||||

|

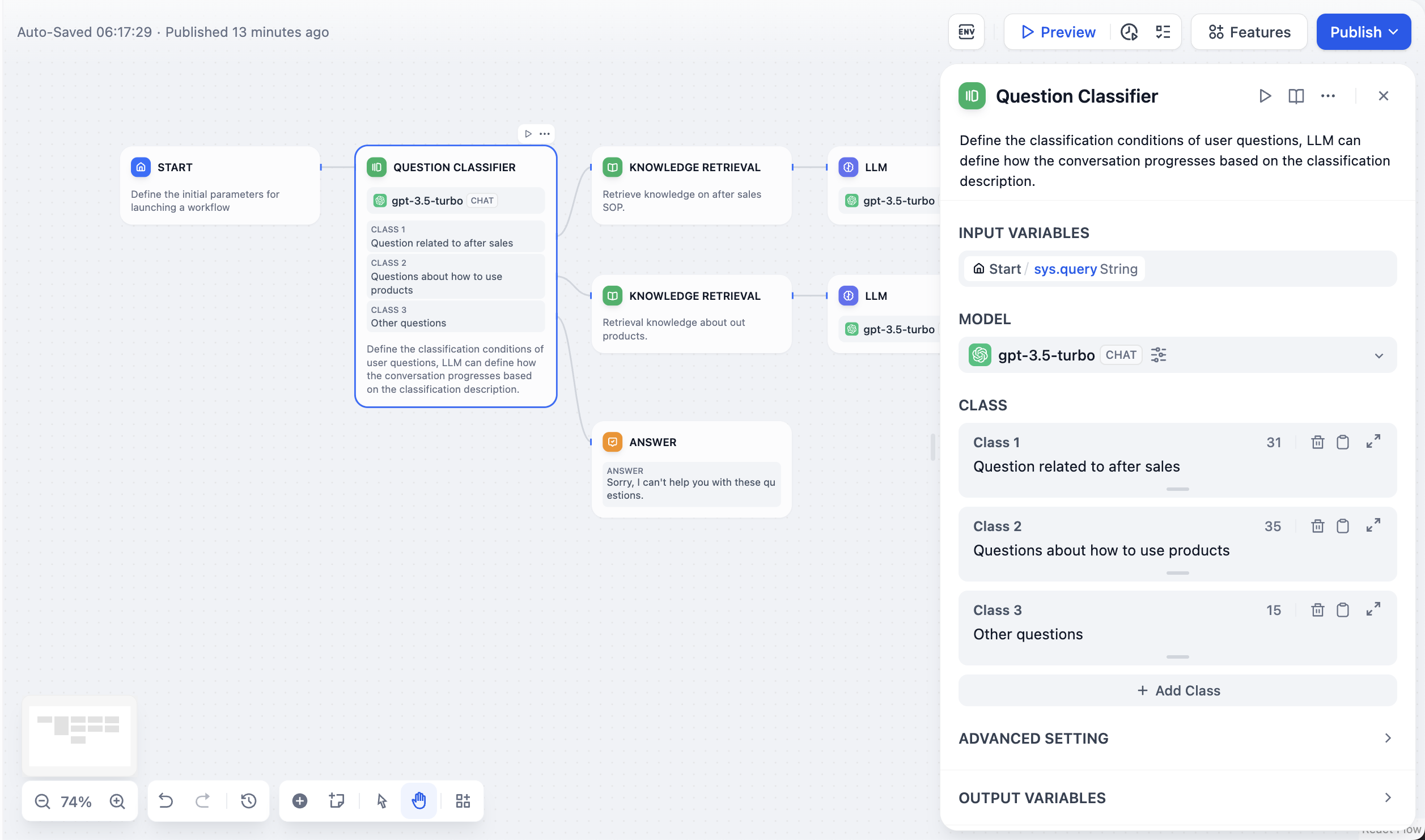

||||