diff --git a/docs.json b/docs.json

index b3571fce..1df82dae 100644

--- a/docs.json

+++ b/docs.json

@@ -840,11 +840,11 @@

"ja/use-dify/nodes/trigger/webhook-trigger"

]

},

+ "ja/use-dify/nodes/agent",

"ja/use-dify/nodes/llm",

"ja/use-dify/nodes/knowledge-retrieval",

"ja/use-dify/nodes/answer",

"ja/use-dify/nodes/output",

- "ja/use-dify/nodes/agent",

"ja/use-dify/nodes/question-classifier",

"ja/use-dify/nodes/ifelse",

"ja/use-dify/nodes/human-input",

@@ -857,7 +857,9 @@

"ja/use-dify/nodes/variable-assigner",

"ja/use-dify/nodes/parameter-extractor",

"ja/use-dify/nodes/http-request",

+ "ja/use-dify/nodes/command",

"ja/use-dify/nodes/list-operator",

+ "ja/use-dify/nodes/upload-file-to-sandbox",

"ja/use-dify/nodes/tools"

]

},

@@ -865,13 +867,16 @@

"group": "ビルド",

"expanded": false,

"pages": [

- "ja/use-dify/build/shortcut-key",

- "ja/use-dify/build/goto-anything",

+ "ja/use-dify/build/runtime",

"ja/use-dify/build/orchestrate-node",

+ "ja/use-dify/build/file-system",

+ "ja/use-dify/build/collaboration",

+ "ja/use-dify/build/goto-anything",

"ja/use-dify/build/predefined-error-handling-logic",

"ja/use-dify/build/mcp",

"ja/use-dify/build/version-control",

- "ja/use-dify/build/additional-features"

+ "ja/use-dify/build/additional-features",

+ "ja/use-dify/build/shortcut-key"

]

},

{

@@ -901,7 +906,8 @@

]

},

"ja/use-dify/publish/publish-mcp",

- "ja/use-dify/publish/developing-with-apis"

+ "ja/use-dify/publish/developing-with-apis",

+ "ja/use-dify/publish/publish-to-marketplace"

]

},

{

@@ -994,6 +1000,7 @@

"ja/use-dify/workspace/readme",

"ja/use-dify/workspace/model-providers",

"ja/use-dify/workspace/plugins",

+ "ja/use-dify/workspace/tools",

"ja/use-dify/workspace/app-management",

"ja/use-dify/workspace/team-members-management",

"ja/use-dify/workspace/personal-account-management",

diff --git a/ja/use-dify/build/collaboration.mdx b/ja/use-dify/build/collaboration.mdx

new file mode 100644

index 00000000..627142ec

--- /dev/null

+++ b/ja/use-dify/build/collaboration.mdx

@@ -0,0 +1,20 @@

+---

+title: ワークスペースメンバーとの共同作業

+sidebarTitle: コラボレーション

+icon: "users"

+---

+

+ ⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/build/collaboration)を参照してください。

+

+編集権限以上を持つワークスペースメンバーは、同じワークフローを同時に編集できます。キャンバスを右クリックして**コメントを追加**を選択し、アイデアを共有できます。

+

+より素早く複数のコメントを追加するには、`C` キーを押してコメントモードに入ります。コメント内で他のメンバーを `@` メンションすると、メールで通知されます。

+

+

+ セルフホスト環境では、コラボレーション機能はデフォルトで無効です。有効にするには、以下の環境変数を設定してください:

+

+ - `ENABLE_COLLABORATION_MODE` = `true`

+ - `SERVER_WORKER_CLASS` = `geventwebsocket.gunicorn.workers.GeventWebSocketWorker`

+

+ カスタムドメインでデプロイする場合は、`NEXT_PUBLIC_SOCKET_URL` に WebSocket サーバーの URL も設定してください。

+

diff --git a/ja/use-dify/build/file-system.mdx b/ja/use-dify/build/file-system.mdx

new file mode 100644

index 00000000..25be4211

--- /dev/null

+++ b/ja/use-dify/build/file-system.mdx

@@ -0,0 +1,110 @@

+---

+title: ファイルシステム

+icon: "folder-tree"

+keyword: skills, skill

+---

+

+ ⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/build/file-system)を参照してください。

+

+[サンドボックスランタイム](/ja/use-dify/build/runtime#サンドボックスランタイム)を使用する各アプリケーションには、LLM が必要に応じてファイルの読み取り、書き込み、処理を行えるファイルシステムがあります。

+

+ファイルシステムには2種類のファイルが含まれます:

+

+- **リソース**:Skill など、アップロードまたは作成された永続ファイル。

+

+- **アーティファクト**:LLM が各実行時に生成する一時ファイル。

+

+ +

+## リソース

+

+リソースはワークフロー用に作成またはインポートしたファイルです。LLM は読み取りのみ可能で、変更はできません。リソースは実行間で永続し、アプリのエクスポート時に含まれます。

+

+### Skill

+

+[Skill](https://agentskills.io/home) は、指示、ナレッジ、スクリプト、その他の参考資料を特定のタスク用にバンドルします——一度定義すれば、ワークフロー間で再利用できます。

+

+たとえば、マーケティングコピーの生成のたびにスタイルガイドラインを繰り返し記述してブランド素材をアップロードする代わりに、すべてを含む `marketing-copy` Skill を作成し、必要なときに参照するだけで済みます。

+

+Skill は詳細な SOP(標準作業手順書)、LLM は能力のある新入社員と考えてください。新入社員は汎用的な能力を持っていますが、会社固有のプロセスは知りません。Skill は必要なすべて——手順、参考資料、使用するツール——を提供し、期待通りにタスクを完了できるようにします。

+

+#### Skill の作成またはインポート

+

+他で使用していた Skill のインポート、用意された Skill テンプレートの利用、またはファイルシステムでのカスタム Skill の直接作成が可能です。

+

+すべての Skill には `SKILL.md` ファイルが必要です。このファイルでタスクの内容、Skill の使用タイミング、実行手順を定義します。

+

+`SKILL.md` 内では、利用可能なリソース(スクリプト、テンプレート、コンテキスト資料、[Dify ツール](/ja/use-dify/workspace/tools))を参照し、いつどのように使用するかを指定できます。

+

+

+

+## リソース

+

+リソースはワークフロー用に作成またはインポートしたファイルです。LLM は読み取りのみ可能で、変更はできません。リソースは実行間で永続し、アプリのエクスポート時に含まれます。

+

+### Skill

+

+[Skill](https://agentskills.io/home) は、指示、ナレッジ、スクリプト、その他の参考資料を特定のタスク用にバンドルします——一度定義すれば、ワークフロー間で再利用できます。

+

+たとえば、マーケティングコピーの生成のたびにスタイルガイドラインを繰り返し記述してブランド素材をアップロードする代わりに、すべてを含む `marketing-copy` Skill を作成し、必要なときに参照するだけで済みます。

+

+Skill は詳細な SOP(標準作業手順書)、LLM は能力のある新入社員と考えてください。新入社員は汎用的な能力を持っていますが、会社固有のプロセスは知りません。Skill は必要なすべて——手順、参考資料、使用するツール——を提供し、期待通りにタスクを完了できるようにします。

+

+#### Skill の作成またはインポート

+

+他で使用していた Skill のインポート、用意された Skill テンプレートの利用、またはファイルシステムでのカスタム Skill の直接作成が可能です。

+

+すべての Skill には `SKILL.md` ファイルが必要です。このファイルでタスクの内容、Skill の使用タイミング、実行手順を定義します。

+

+`SKILL.md` 内では、利用可能なリソース(スクリプト、テンプレート、コンテキスト資料、[Dify ツール](/ja/use-dify/workspace/tools))を参照し、いつどのように使用するかを指定できます。

+

+ +

+#### プロンプトでの Skill の参照

+

+プロンプトエディターで `/` を入力し、**ファイル**タブから Skill フォルダーを選択します。

+

+LLM は最初に Skill のフロントマター(名前、説明、メタデータ)を読み取り、必要な場合にのみ全内容を読み込みます。これによりトークンが節約され、複数の Skill を使用する場合に特に効率的です。

+

+## アーティファクト

+

+アーティファクトは LLM が実行中に生成するファイル——レポート、画像、その他の出力です。LLM はアーティファクトに対して完全な読み書き権限を持ちます。

+

+**Skills** タブまたはキャンバス下部の**変数検査**パネルでアーティファクトのプレビューとダウンロードができます。

+

+### アーティファクトのライフサイクル

+

+アーティファクトはテスト環境と本番環境で異なるライフサイクルを持ちます。アプリのエクスポート時にはアーティファクトは含まれません。

+

+

+

+ アーティファクトはテスト実行間で保持されます。クリアするには、**変数検査**パネルの**すべてリセット**をクリックします。

+

+

+ アーティファクトは各実行にスコープされ、実行完了時に自動的にクリアされます。

+

+

+

+

+ **アーティファクト**の下に `.bashrc` や `.profile` などのシステムファイルが表示されることがあります。これらはサンドボックス環境の一部であり、実行間で保持されます。

+

+

+### エンドユーザーへのアーティファクトの出力

+

+アーティファクトはサンドボックス環境に保存されており、エンドユーザーに直接公開できません。出力するには、別の Agent ノードを通じて抽出する必要があります:

+

+1. ファイルを生成するノードの下流に Agent ノードを追加します。

+

+2. **Agent モード**をオフにし、**構造化出力**を有効にします。

+

+3. ファイル型の構造化出力変数を追加します。

+

+4. **対話履歴の追加**から上流 Agent ノードの対話履歴をインポートします。これにより LLM がファイルパスを特定できます。

+

+5. ユーザーメッセージで、モデルにファイルの抽出と出力を指示します(例:「生成された PDF ファイルを出力してください」)。

+

+6. 回答ノードまたは出力ノードで、Agent ノードのファイル出力変数を参照します。

+

+## サポートされるファイルタイプと操作

+

+ファイルシステム内のすべてのファイルはダウンロード可能です。一部はプレビューや編集も可能です。

+

+

+

+

+ リソースのみ編集可能です。

+

+ - **テキスト**: TXT, MD, MDX, HTML, HTM, XML, CSV

+ - **コード**: Python, JavaScript, JSON, YAML および [Monaco Editor](https://microsoft.github.io/monaco-editor/) がサポートするすべての言語

+ - **設定**: PROPERTIES, VTT

+

+

+ - **ドキュメント**: PDF, DOCX, DOC, XLSX, XLS, PPTX, PPT, EPUB

+ - **画像**: JPG, JPEG, PNG, GIF, WEBP, SVG

+ - **データ**: CSV, TSV, SQLite (.sqlite, .db) - テーブルプレビューのみ

+ - **メール**: EML, MSG

+

+

+ - **音声**: MP3, M4A, WAV, WEBM, AMR

+ - **動画**: MP4, MOV, MPEG, MPGA

+ - **その他**: カスタムファイル拡張子

+

+

diff --git a/ja/use-dify/build/runtime.mdx b/ja/use-dify/build/runtime.mdx

new file mode 100644

index 00000000..36c02a75

--- /dev/null

+++ b/ja/use-dify/build/runtime.mdx

@@ -0,0 +1,72 @@

+---

+title: ランタイム

+icon: "cube"

+---

+

+ ⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/build/runtime)を参照してください。

+

+ランタイムはワークフローが実行される環境で、LLM がアクセス・実行できる範囲を定めます。

+

+Dify は2種類のランタイム環境を提供しています:**サンドボックスランタイム**と**クラシックランタイム**。それぞれ異なるユースケースに最適化されています。

+

+## 概要

+

+

+

+

+ **適用シーン:** LLM が自律的に問題を解決する必要がある複雑なタスク。より強力ですが、速度は遅くトークン消費も多くなります。

+

+

+ サンドボックスランタイムでは、LLM が隔離環境で**コマンドラインを実行**できます。ターミナルでコマンドを使ってできることは、すべて LLM にもできます:

+

+ - **スクリプトやプログラムの実行** - コードを実行してデータを処理し、出力を生成し、あらゆる計算を行う

+

+ - **必要なツールのインストール** - pip やその他のパッケージマネージャーを使ってライブラリやツールをオンデマンドでダウンロード

+

+ - **外部リソースへのアクセス** - URL からファイルを取得、リポジトリのクローン、外部ソースからのデータ取得

+

+ - **ファイルの操作** - [ファイルシステム](/ja/use-dify/build/file-system)内のリソース([Skill](/ja/use-dify/build/file-system#skill) など)にアクセスし、さまざまな形式のファイルを処理し、スクリプトやツールを使ってマルチモーダルなアーティファクトを生成

+

+

+ サンドボックスランタイムでは、Agent ノードがクラシックランタイムにおける LLM ノードと Agent ノードの両方の役割を兼ねます。

+

+ これらの高度な機能が不要な簡単なタスクには、**[Agent モード](/ja/use-dify/nodes/agent#コマンド実行の有効化(agent-モード))** をオフにすることで、より高速なレスポンスと低いトークンコストを実現できます。

+

+

+ **LLM が真の Agent になります**。モデルが十分に強力なツール呼び出しと推論能力を持っている限り、どのコマンドを実行すべきかを自律的に判断し、タスクを完了できます。

+

+ LLM の能力が強力になったからこそ、サンドボックスでの実行が必要です。隔離環境は LLM に十分な自由度を与えつつ、安全な運用を保証します。

+

+

+ デフォルトのサンドボックスプロバイダー:

+

+ - Dify Cloud は E2B を使用。

+

+ - セルフホスト環境は SSH VM を使用。

+

+ **設定** > **サンドボックスプロバイダー**で他のプロバイダーを選択・設定できます。

+

+

+

+

+

+

+ **適用シーン:** シンプルで迅速なタスク。機能は限定的ですが、より高速で効率的です。

+

+

+ クラシックランタイムでは、LLM が最も得意とすることを行います:情報の分析、テキストの生成、問題の推論、そして事前設定されたツールの自律的な活用によるタスクの完了です。

+

+ 特定のツールキットを渡すイメージです——タスクは遂行できますが、**提供されたツールの範囲に限定されます**。

+

+

+

+

+## 比較表

+

+| 項目 | サンドボックスランタイム | クラシックランタイム |

+|:------------------------------|:-------------------------------------|:------------------------------------|

+| **適用シーン** | 複雑な自律的問題解決 | シンプルで明確なタスク |

+| **LLM の自律度** | 必要なコマンドを自由に実行 | 設定されたツールを使用 |

+| **ファイルシステム** | ✅ | ❌ |

+| **Skill** | ✅ | ❌ |

+| **アプリのエクスポート形式** | `.zip`(DSL + リソースファイル) | `.yml`(DSL ファイル) |

diff --git a/ja/use-dify/nodes/agent.mdx b/ja/use-dify/nodes/agent.mdx

index 7bdcfc3e..d3378fac 100644

--- a/ja/use-dify/nodes/agent.mdx

+++ b/ja/use-dify/nodes/agent.mdx

@@ -1,118 +1,382 @@

---

-title: "エージェント"

-description: "複雑なタスク実行のためにLLMにツールの自律制御を与える"

+title: "Agent"

+description: "LLM に複雑なタスクを自律的に完了させる"

icon: "robot"

---

⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/agent)を参照してください。

-

-エージェントノードは、LLMにツールの自律的な制御権を与え、どのツールをいつ使用するかを反復的に決定できるようにします。すべてのステップを事前に計画する代わりに、エージェントは問題を動的に推論し、複雑なタスクを完了するために必要に応じてツールを呼び出します。

-

-

-

+

+#### プロンプトでの Skill の参照

+

+プロンプトエディターで `/` を入力し、**ファイル**タブから Skill フォルダーを選択します。

+

+LLM は最初に Skill のフロントマター(名前、説明、メタデータ)を読み取り、必要な場合にのみ全内容を読み込みます。これによりトークンが節約され、複数の Skill を使用する場合に特に効率的です。

+

+## アーティファクト

+

+アーティファクトは LLM が実行中に生成するファイル——レポート、画像、その他の出力です。LLM はアーティファクトに対して完全な読み書き権限を持ちます。

+

+**Skills** タブまたはキャンバス下部の**変数検査**パネルでアーティファクトのプレビューとダウンロードができます。

+

+### アーティファクトのライフサイクル

+

+アーティファクトはテスト環境と本番環境で異なるライフサイクルを持ちます。アプリのエクスポート時にはアーティファクトは含まれません。

+

+

+

+ アーティファクトはテスト実行間で保持されます。クリアするには、**変数検査**パネルの**すべてリセット**をクリックします。

+

+

+ アーティファクトは各実行にスコープされ、実行完了時に自動的にクリアされます。

+

+

+

+

+ **アーティファクト**の下に `.bashrc` や `.profile` などのシステムファイルが表示されることがあります。これらはサンドボックス環境の一部であり、実行間で保持されます。

+

+

+### エンドユーザーへのアーティファクトの出力

+

+アーティファクトはサンドボックス環境に保存されており、エンドユーザーに直接公開できません。出力するには、別の Agent ノードを通じて抽出する必要があります:

+

+1. ファイルを生成するノードの下流に Agent ノードを追加します。

+

+2. **Agent モード**をオフにし、**構造化出力**を有効にします。

+

+3. ファイル型の構造化出力変数を追加します。

+

+4. **対話履歴の追加**から上流 Agent ノードの対話履歴をインポートします。これにより LLM がファイルパスを特定できます。

+

+5. ユーザーメッセージで、モデルにファイルの抽出と出力を指示します(例:「生成された PDF ファイルを出力してください」)。

+

+6. 回答ノードまたは出力ノードで、Agent ノードのファイル出力変数を参照します。

+

+## サポートされるファイルタイプと操作

+

+ファイルシステム内のすべてのファイルはダウンロード可能です。一部はプレビューや編集も可能です。

+

+

+

+

+ リソースのみ編集可能です。

+

+ - **テキスト**: TXT, MD, MDX, HTML, HTM, XML, CSV

+ - **コード**: Python, JavaScript, JSON, YAML および [Monaco Editor](https://microsoft.github.io/monaco-editor/) がサポートするすべての言語

+ - **設定**: PROPERTIES, VTT

+

+

+ - **ドキュメント**: PDF, DOCX, DOC, XLSX, XLS, PPTX, PPT, EPUB

+ - **画像**: JPG, JPEG, PNG, GIF, WEBP, SVG

+ - **データ**: CSV, TSV, SQLite (.sqlite, .db) - テーブルプレビューのみ

+ - **メール**: EML, MSG

+

+

+ - **音声**: MP3, M4A, WAV, WEBM, AMR

+ - **動画**: MP4, MOV, MPEG, MPGA

+ - **その他**: カスタムファイル拡張子

+

+

diff --git a/ja/use-dify/build/runtime.mdx b/ja/use-dify/build/runtime.mdx

new file mode 100644

index 00000000..36c02a75

--- /dev/null

+++ b/ja/use-dify/build/runtime.mdx

@@ -0,0 +1,72 @@

+---

+title: ランタイム

+icon: "cube"

+---

+

+ ⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/build/runtime)を参照してください。

+

+ランタイムはワークフローが実行される環境で、LLM がアクセス・実行できる範囲を定めます。

+

+Dify は2種類のランタイム環境を提供しています:**サンドボックスランタイム**と**クラシックランタイム**。それぞれ異なるユースケースに最適化されています。

+

+## 概要

+

+

+

+

+ **適用シーン:** LLM が自律的に問題を解決する必要がある複雑なタスク。より強力ですが、速度は遅くトークン消費も多くなります。

+

+

+ サンドボックスランタイムでは、LLM が隔離環境で**コマンドラインを実行**できます。ターミナルでコマンドを使ってできることは、すべて LLM にもできます:

+

+ - **スクリプトやプログラムの実行** - コードを実行してデータを処理し、出力を生成し、あらゆる計算を行う

+

+ - **必要なツールのインストール** - pip やその他のパッケージマネージャーを使ってライブラリやツールをオンデマンドでダウンロード

+

+ - **外部リソースへのアクセス** - URL からファイルを取得、リポジトリのクローン、外部ソースからのデータ取得

+

+ - **ファイルの操作** - [ファイルシステム](/ja/use-dify/build/file-system)内のリソース([Skill](/ja/use-dify/build/file-system#skill) など)にアクセスし、さまざまな形式のファイルを処理し、スクリプトやツールを使ってマルチモーダルなアーティファクトを生成

+

+

+ サンドボックスランタイムでは、Agent ノードがクラシックランタイムにおける LLM ノードと Agent ノードの両方の役割を兼ねます。

+

+ これらの高度な機能が不要な簡単なタスクには、**[Agent モード](/ja/use-dify/nodes/agent#コマンド実行の有効化(agent-モード))** をオフにすることで、より高速なレスポンスと低いトークンコストを実現できます。

+

+

+ **LLM が真の Agent になります**。モデルが十分に強力なツール呼び出しと推論能力を持っている限り、どのコマンドを実行すべきかを自律的に判断し、タスクを完了できます。

+

+ LLM の能力が強力になったからこそ、サンドボックスでの実行が必要です。隔離環境は LLM に十分な自由度を与えつつ、安全な運用を保証します。

+

+

+ デフォルトのサンドボックスプロバイダー:

+

+ - Dify Cloud は E2B を使用。

+

+ - セルフホスト環境は SSH VM を使用。

+

+ **設定** > **サンドボックスプロバイダー**で他のプロバイダーを選択・設定できます。

+

+

+

+

+

+

+ **適用シーン:** シンプルで迅速なタスク。機能は限定的ですが、より高速で効率的です。

+

+

+ クラシックランタイムでは、LLM が最も得意とすることを行います:情報の分析、テキストの生成、問題の推論、そして事前設定されたツールの自律的な活用によるタスクの完了です。

+

+ 特定のツールキットを渡すイメージです——タスクは遂行できますが、**提供されたツールの範囲に限定されます**。

+

+

+

+

+## 比較表

+

+| 項目 | サンドボックスランタイム | クラシックランタイム |

+|:------------------------------|:-------------------------------------|:------------------------------------|

+| **適用シーン** | 複雑な自律的問題解決 | シンプルで明確なタスク |

+| **LLM の自律度** | 必要なコマンドを自由に実行 | 設定されたツールを使用 |

+| **ファイルシステム** | ✅ | ❌ |

+| **Skill** | ✅ | ❌ |

+| **アプリのエクスポート形式** | `.zip`(DSL + リソースファイル) | `.yml`(DSL ファイル) |

diff --git a/ja/use-dify/nodes/agent.mdx b/ja/use-dify/nodes/agent.mdx

index 7bdcfc3e..d3378fac 100644

--- a/ja/use-dify/nodes/agent.mdx

+++ b/ja/use-dify/nodes/agent.mdx

@@ -1,118 +1,382 @@

---

-title: "エージェント"

-description: "複雑なタスク実行のためにLLMにツールの自律制御を与える"

+title: "Agent"

+description: "LLM に複雑なタスクを自律的に完了させる"

icon: "robot"

---

⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/agent)を参照してください。

-

-エージェントノードは、LLMにツールの自律的な制御権を与え、どのツールをいつ使用するかを反復的に決定できるようにします。すべてのステップを事前に計画する代わりに、エージェントは問題を動的に推論し、複雑なタスクを完了するために必要に応じてツールを呼び出します。

-

-

-  -

-

-## エージェント戦略

-

-エージェント戦略は、エージェントの思考と行動を定義します。モデルの能力とタスク要件に最も適したアプローチを選択してください。

-

-

-

-

-

-## エージェント戦略

-

-エージェント戦略は、エージェントの思考と行動を定義します。モデルの能力とタスク要件に最も適したアプローチを選択してください。

-

-

-  -

-

-

- 大規模言語モデルのネイティブな関数呼び出し機能を使用して、toolsパラメータを通じてツール定義を直接渡します。大規模言語モデルは、組み込まれたメカニズムを使用して、いつどのようにツールを呼び出すかを決定します。

-

- GPT-4、Claude 3.5、および関数呼び出しサポートが堅牢な他のモデルに最適です。

+

+

+ [サンドボックスランタイム](/ja/use-dify/build/runtime#サンドボックスランタイム)では、Agent ノードは LLM に自律的なコマンドライン実行能力を与えます。ツールの呼び出し、スクリプトの実行、外部リソースへのアクセス、[ファイルシステム](/ja/use-dify/build/file-system)の操作、マルチモーダル出力の生成が可能です。

+

+ これにはトレードオフがあります:レスポンス時間が長くなり、トークン消費も増えます。シンプルなタスクをより速く効率的に処理するには、**[Agent モード](#コマンド実行の有効化(agent-モード))** をオフにしてこれらの機能を無効にできます。

+

+ ## モデルの選択

+

+ 設定済みのプロバイダーからタスクに最適なモデルを選択します。

+

+ 選択後、モデルパラメータを調整してレスポンスの生成方法を制御できます。利用可能なパラメータとプリセットはモデルによって異なります。

+

+ ## プロンプトの作成

+

+ モデルに入力の処理方法とレスポンスの生成方法を指示します。`/` を入力して変数やファイルシステム内のリソースを挿入したり、`@` を入力して [Dify ツール](/ja/use-dify/workspace/tools)を参照したりできます。

+

+ どこから始めればよいかわからない場合や、既存のプロンプトを改善したい場合は、AI アシスト付きプロンプトジェネレーターをお試しください。

+

+

+

+

-

-

-

- 大規模言語モデルのネイティブな関数呼び出し機能を使用して、toolsパラメータを通じてツール定義を直接渡します。大規模言語モデルは、組み込まれたメカニズムを使用して、いつどのようにツールを呼び出すかを決定します。

-

- GPT-4、Claude 3.5、および関数呼び出しサポートが堅牢な他のモデルに最適です。

+

+

+ [サンドボックスランタイム](/ja/use-dify/build/runtime#サンドボックスランタイム)では、Agent ノードは LLM に自律的なコマンドライン実行能力を与えます。ツールの呼び出し、スクリプトの実行、外部リソースへのアクセス、[ファイルシステム](/ja/use-dify/build/file-system)の操作、マルチモーダル出力の生成が可能です。

+

+ これにはトレードオフがあります:レスポンス時間が長くなり、トークン消費も増えます。シンプルなタスクをより速く効率的に処理するには、**[Agent モード](#コマンド実行の有効化(agent-モード))** をオフにしてこれらの機能を無効にできます。

+

+ ## モデルの選択

+

+ 設定済みのプロバイダーからタスクに最適なモデルを選択します。

+

+ 選択後、モデルパラメータを調整してレスポンスの生成方法を制御できます。利用可能なパラメータとプリセットはモデルによって異なります。

+

+ ## プロンプトの作成

+

+ モデルに入力の処理方法とレスポンスの生成方法を指示します。`/` を入力して変数やファイルシステム内のリソースを挿入したり、`@` を入力して [Dify ツール](/ja/use-dify/workspace/tools)を参照したりできます。

+

+ どこから始めればよいかわからない場合や、既存のプロンプトを改善したい場合は、AI アシスト付きプロンプトジェネレーターをお試しください。

+

+

+

+  +

+

+

+

+

+  +

+

+

+ ### 指示とメッセージの指定

+

+ システム指示を定義し、**メッセージを追加**をクリックしてユーザー/アシスタントメッセージを追加します。すべて順番にプロンプトとしてモデルに送信されます。

+

+ モデルと直接会話するイメージです:

+

+ - **システム指示**はモデルのレスポンスルールを設定します——役割、トーン、行動ガイドライン。

+

+ - **ユーザーメッセージ**はモデルに送信する内容——質問、リクエスト、タスク。

+

+ - **アシスタントメッセージ**はモデルのレスポンスです。

+

+ ### 入力とルールの分離

+

+ システム指示で役割とルールを定義し、ユーザーメッセージで実際のタスク入力を渡します。例:

+

+ ```bash wrap

+ # システム指示

+ あなたは子ども向けの物語作家です。ユーザーの入力に基づいて物語を書いてください。簡単な言葉と温かいトーンを使ってください。

+

+ # ユーザーメッセージ

+ ウサギと恥ずかしがり屋のハリネズミが友達になる、おやすみ前のお話を書いてください。

+ ```

+

+ すべてをシステム指示にまとめる方が簡単に見えるかもしれませんが、役割定義とタスク入力を分離することで、モデルにとってより明確な構造になります。

+

+ ### 対話履歴のシミュレーション

+

+ アシスタントメッセージがモデルのレスポンスなら、なぜ手動で追加するのか疑問に思うかもしれません。

+

+ ユーザーメッセージとアシスタントメッセージを交互に追加することで、プロンプト内に対話履歴をシミュレーションできます。モデルはこれらを過去のやり取りとして扱い、動作の誘導に役立ちます。

+

+ ### 上流 LLM からの対話履歴のインポート

+

+ **対話履歴の追加**をクリックして、上流の Agent ノードから対話履歴をインポートします。これによりモデルは上流で何が起こったかを把握し、そのノードが中断したところから続けることができます。

+

+ 対話履歴には**ユーザー**メッセージ、**アシスタント**メッセージ、**ツール**メッセージが含まれます。Agent ノードの `context` 出力変数で確認できます。

+

+

+ システム指示はノード固有のため含まれません。

+

+

+ 複数の Agent ノードを連結する場合に有用です:

+

+ - 対話履歴をインポートしない場合、下流ノードは上流ノードの最終出力のみを受け取り、それがどのように導き出されたかはわかりません。

+

+ - 対話履歴をインポートすると、プロセス全体が見えます:ユーザーが何を質問したか、どのツールが呼び出されたか、どのような結果が返されたか、モデルがどのように推論したか。

+

+ **自動追加されるユーザーメッセージで新しいタスクを指定してください。** インポートされた履歴は現在のノードのメッセージの前に追加されるため、モデルはこれを1つの連続した会話として認識します。インポートされた履歴は通常アシスタントメッセージで終わるため、モデルは次に何をすべきかを知るためのフォローアップユーザーメッセージが必要です。

+

+

+

+ 2つの Agent ノードが順番に実行されるとします:Agent A はデータを分析してチャート画像を生成し、サンドボックスの出力フォルダーに保存します。Agent B はこれらのチャートを含む最終レポートを作成します。

+

+ Agent B が Agent A の最終テキスト出力のみを受け取る場合、分析結論はわかりますが、どのファイルが生成されどこに保存されているかはわかりません。

+

+ Agent A の対話履歴をインポートすることで、Agent B はツールメッセージから正確なファイルパスを確認でき、チャートをレポートに埋め込むことができます。

+

+ Agent A の対話履歴インポート後に Agent B が受け取る完全なメッセージシーケンス:

+

+ ```bash wrap

+ # Agent B のシステム指示

+ 1. System: "あなたはレポートデザイナーです。ビジュアルを埋め込んだプロフェッショナルなレポートを作成してください。"

+

+ # Agent A から

+ 2. User: "Q3 の売上データを分析し、可視化を作成してください。"

+

+ # Agent A から

+ 3. Tool: [bash] 棒グラフを作成:/output/q3_sales_by_region.png

+ 4. Tool: [bash] トレンドラインを作成:/output/q3_monthly_trend.png

+

+ # Agent A から

+ 5. Assistant: "Q3 の売上データを分析し、2つのチャートを作成しました..."

+

+ # Agent B のユーザーメッセージ

+ 6. User: "生成されたチャートを含む PDF レポートを作成してください。"

+ ```

+

+ Agent A の対話履歴をインポートすることで、Agent B はどのファイルが存在し、どこにあるかを正確に把握し、レポートに直接埋め込むことができます。

+

+

+

+

+

+ 例 1 の続きとして、生成された PDF レポートをエンドユーザーに提供したいとします。アーティファクトはエンドユーザーに直接公開できないため、3つ目の Agent ノードでファイルを抽出する必要があります。

+

+ Agent C の設定:

+

+ - **Agent モード**:オフ

+

+ - **構造化出力**:有効にし、ファイル型の出力変数を追加

+

+ - **対話履歴**:Agent B からインポート

+

+ - **ユーザーメッセージ**:「生成された PDF を出力してください。」

+

+ Agent B の対話履歴インポート後に Agent C が受け取る完全なメッセージシーケンス:

+ ```bash wrap

+ # Agent C のシステム指示(省略可)

+ 1. System:(なし)

+

+ # Agent A からのユーザーメッセージとツールメッセージ(簡潔にするため省略)

+ 2. ...

+

+ # Agent B から

+ 3. User: "生成されたチャートを含む PDF レポートを作成してください。"

+

+ # Agent B から

+ 4. Tool: [bash] レポートを作成:/output/q3_sales_report.pdf

+

+ # Agent B から

+ 5. Assistant: "チャートを埋め込んだ PDF レポートを作成しました..."

+

+ # Agent C のユーザーメッセージ

+ 6. User: "生成された PDF を出力してください。"

+ ```

+

+ Agent C はインポートされた対話履歴からファイルパスを特定し、ファイル変数として出力します。その後、回答ノードまたは出力ノードでこの変数を参照し、ファイルをエンドユーザーに提供できます。

+

+

+

+ ### Jinja2 を使った動的プロンプトの作成

+

+ [Jinja2](https://jinja.palletsprojects.com/en/stable/) テンプレートを使って、プロンプトに条件分岐、ループ、その他のロジックを追加できます。例えば、変数の値に応じて指示をカスタマイズできます。

+

+

+ ```jinja2 wrap

+ あなたは

+ {% if user_level == "beginner" %}忍耐強く親切な

+ {% elif user_level == "intermediate" %}プロフェッショナルで効率的な

+ {% else %}シニアエキスパートレベルの

+ {% endif %} アシスタントです。

+

+ {% if user_level == "beginner" %}

+ わかりやすい言葉で説明してください。必要に応じて例を示してください。専門用語は避けてください。

+ {% elif user_level == "intermediate" %} 一部の専門用語を使用できますが、適切な説明を付けてください。実践的なアドバイスとベストプラクティスを提供してください。

+ {% else %} 技術的な詳細に踏み込み、専門用語を使用してください。高度なユースケースと最適化ソリューションに焦点を当ててください。

+ {% endif %}

+ ```

+

+

+ デフォルトでは、すべての可能な指示をモデルに送信し、条件を説明し、どれに従うかをモデルに判断させる必要がありますが、この方法は必ずしも信頼できるとは限りません。

+

+ Jinja2 テンプレートを使えば、定義された条件に合致する指示のみが送信されるため、動作が予測可能になり、トークンの使用量も削減されます。

+

+ ## コマンド実行の有効化(Agent モード)

+

+ **Agent モード**をオンにすると、モデルが組み込みの bash ツールを使ってサンドボックスランタイムでコマンドラインを実行できるようになります。

+

+ これはすべての高度な機能の基盤です:モデルが他のツールを呼び出す、ファイル操作を行う、スクリプトを実行する、外部リソースにアクセスする——これらすべては bash ツールを呼び出して基盤となるコマンドラインを実行することで行われます。

+

+ これらの機能が不要なシンプルなタスクでは、**Agent モード**をオフにすることで、より高速なレスポンスと低いトークンコストを実現できます。

+

+ **最大イテレーション回数の調整**

+

+ **高度な設定**の**最大イテレーション回数**は、モデルが1つのリクエストに対して推論-行動サイクル(思考、ツール呼び出し、結果処理)を繰り返す回数を制限します。

+

+ 複数のツール呼び出しを必要とする複雑なマルチステップタスクでは、この値を増やしてください。値が大きいほどレイテンシとトークンコストが増加します。

+

+ ## 対話メモリの有効化(チャットフローのみ)

+

+

+ メモリはこのノード内でのみ有効です。異なる会話間では保持されません。

+

+

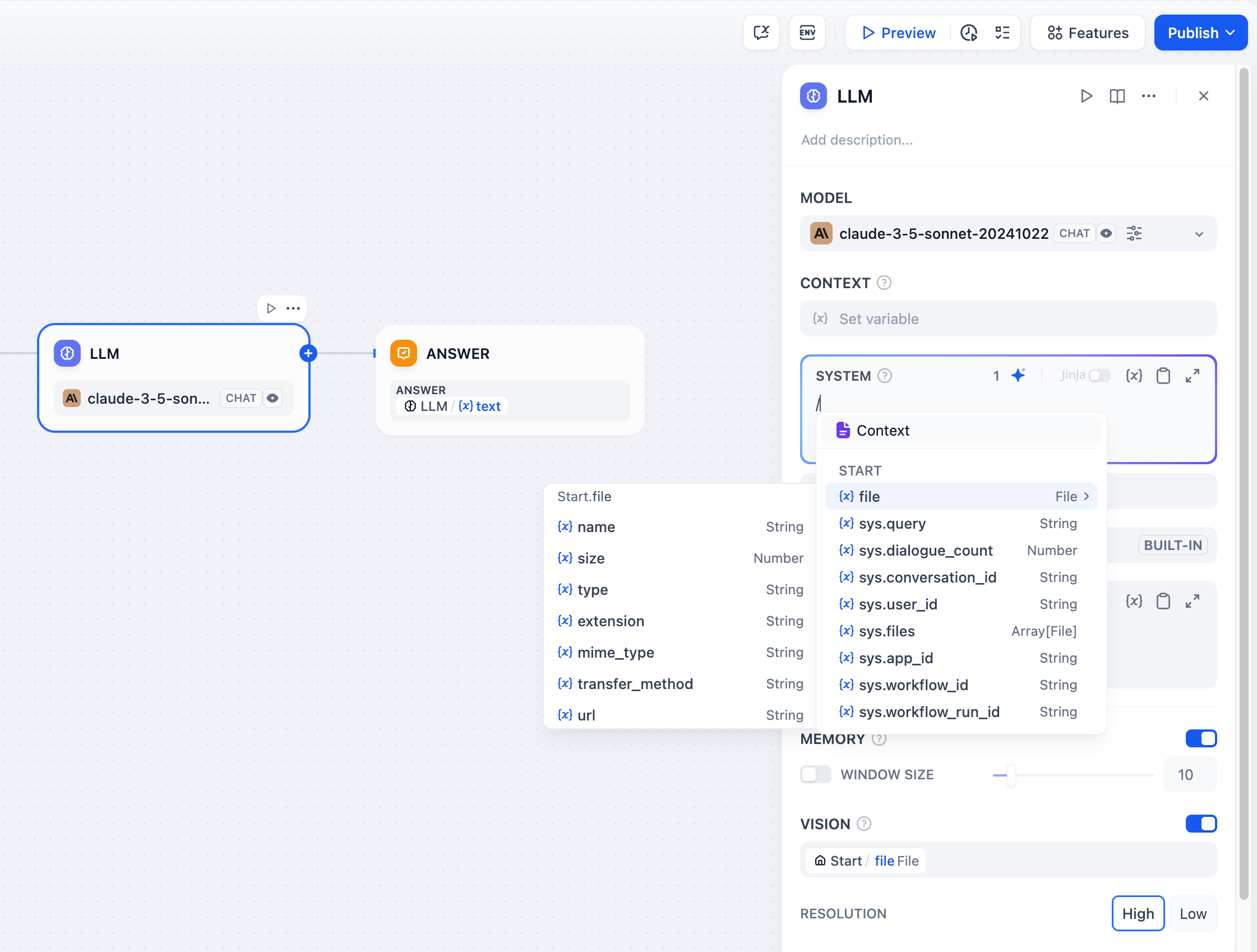

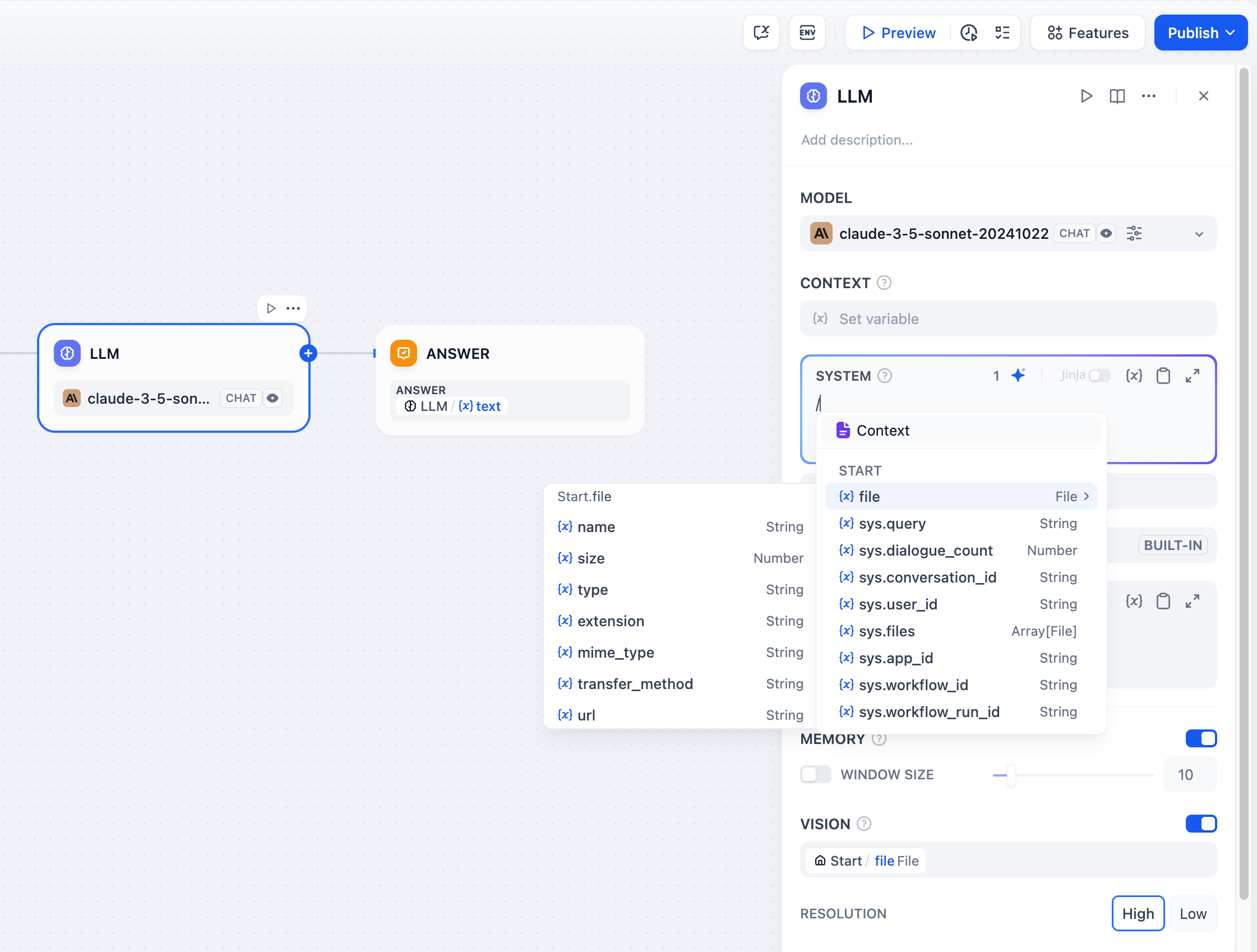

+ **メモリ**を有効にすると最近の対話が保持され、LLM がフォローアップの質問に一貫して回答できるようになります。

+

+ 現在のユーザークエリとアップロードされたファイルを渡すためのユーザーメッセージが自動的に追加されます。これはメモリが最近のユーザー-アシスタント間のやり取りを保存することで機能するためです。ユーザークエリがユーザーメッセージを通じて渡されないと、ユーザー側で記録するものがなくなります。

+

+ **ウィンドウサイズ**は保持する最近のやり取り数を制御します。例えば `5` は、直近の5組のユーザークエリと LLM レスポンスを保持します。

+

+ ## コンテキストの追加

+

+ **高度な設定** > **コンテキスト**で、LLM に追加の参照情報を提供し、ハルシネーションを減らしてレスポンスの精度を向上させます。

+

+ 一般的なパターン:ナレッジ検索ノードから[検索結果を渡す](/ja/use-dify/nodes/knowledge-retrieval#llm-ノードとの連携)ことで、検索拡張生成(RAG)を実現します。

+

+ ## マルチモーダル入力の処理

+

+ マルチモーダル対応モデルに画像、音声、動画、ドキュメントを処理させるには、以下のいずれかの方法を選択します:

+

+ - プロンプトでファイル変数を直接参照する。

+

+ - **高度な設定**で **Vision** を有効にし、ファイル変数を選択する。

+

+ **解像度**は画像処理の詳細レベルのみを制御します:

+

+ - **高**:複雑な画像でより高精度だが、より多くのトークンを使用

+

+ - **低**:シンプルな画像でより高速、より少ないトークンで処理

+

+ マルチモーダル機能を持たないモデルの場合は、[サンドボックスへのファイルアップロード](/ja/use-dify/nodes/upload-file-to-sandbox)ノードでファイルをサンドボックスにアップロードします。Agent ノードがコマンドラインを実行してツールのインストールやスクリプトの実行を行い、モデルがネイティブに処理できないファイル形式も処理できます。

+

+ ## 思考プロセスとツール呼び出しをレスポンスから分離

+

+ モデルの思考プロセスやツール呼び出しを含まないクリーンなレスポンスを取得するには、`generations.content` 出力変数を使用します。

+

+ `generations` 変数自体にはすべての中間ステップと最終レスポンスが含まれます。

+

+ ## 構造化出力の強制

+

+ 指示で出力形式を記述しても、一貫性のない結果が生じることがあります。より信頼性の高いフォーマットを実現するには、構造化出力を有効にして定義済みの JSON スキーマを強制します。

+

+

+ ネイティブ JSON をサポートしないモデルの場合、Dify はスキーマをプロンプトに含めますが、厳密な遵守は保証されません。

+

+

+

+

+

+

+ ### 指示とメッセージの指定

+

+ システム指示を定義し、**メッセージを追加**をクリックしてユーザー/アシスタントメッセージを追加します。すべて順番にプロンプトとしてモデルに送信されます。

+

+ モデルと直接会話するイメージです:

+

+ - **システム指示**はモデルのレスポンスルールを設定します——役割、トーン、行動ガイドライン。

+

+ - **ユーザーメッセージ**はモデルに送信する内容——質問、リクエスト、タスク。

+

+ - **アシスタントメッセージ**はモデルのレスポンスです。

+

+ ### 入力とルールの分離

+

+ システム指示で役割とルールを定義し、ユーザーメッセージで実際のタスク入力を渡します。例:

+

+ ```bash wrap

+ # システム指示

+ あなたは子ども向けの物語作家です。ユーザーの入力に基づいて物語を書いてください。簡単な言葉と温かいトーンを使ってください。

+

+ # ユーザーメッセージ

+ ウサギと恥ずかしがり屋のハリネズミが友達になる、おやすみ前のお話を書いてください。

+ ```

+

+ すべてをシステム指示にまとめる方が簡単に見えるかもしれませんが、役割定義とタスク入力を分離することで、モデルにとってより明確な構造になります。

+

+ ### 対話履歴のシミュレーション

+

+ アシスタントメッセージがモデルのレスポンスなら、なぜ手動で追加するのか疑問に思うかもしれません。

+

+ ユーザーメッセージとアシスタントメッセージを交互に追加することで、プロンプト内に対話履歴をシミュレーションできます。モデルはこれらを過去のやり取りとして扱い、動作の誘導に役立ちます。

+

+ ### 上流 LLM からの対話履歴のインポート

+

+ **対話履歴の追加**をクリックして、上流の Agent ノードから対話履歴をインポートします。これによりモデルは上流で何が起こったかを把握し、そのノードが中断したところから続けることができます。

+

+ 対話履歴には**ユーザー**メッセージ、**アシスタント**メッセージ、**ツール**メッセージが含まれます。Agent ノードの `context` 出力変数で確認できます。

+

+

+ システム指示はノード固有のため含まれません。

+

+

+ 複数の Agent ノードを連結する場合に有用です:

+

+ - 対話履歴をインポートしない場合、下流ノードは上流ノードの最終出力のみを受け取り、それがどのように導き出されたかはわかりません。

+

+ - 対話履歴をインポートすると、プロセス全体が見えます:ユーザーが何を質問したか、どのツールが呼び出されたか、どのような結果が返されたか、モデルがどのように推論したか。

+

+ **自動追加されるユーザーメッセージで新しいタスクを指定してください。** インポートされた履歴は現在のノードのメッセージの前に追加されるため、モデルはこれを1つの連続した会話として認識します。インポートされた履歴は通常アシスタントメッセージで終わるため、モデルは次に何をすべきかを知るためのフォローアップユーザーメッセージが必要です。

+

+

+

+ 2つの Agent ノードが順番に実行されるとします:Agent A はデータを分析してチャート画像を生成し、サンドボックスの出力フォルダーに保存します。Agent B はこれらのチャートを含む最終レポートを作成します。

+

+ Agent B が Agent A の最終テキスト出力のみを受け取る場合、分析結論はわかりますが、どのファイルが生成されどこに保存されているかはわかりません。

+

+ Agent A の対話履歴をインポートすることで、Agent B はツールメッセージから正確なファイルパスを確認でき、チャートをレポートに埋め込むことができます。

+

+ Agent A の対話履歴インポート後に Agent B が受け取る完全なメッセージシーケンス:

+

+ ```bash wrap

+ # Agent B のシステム指示

+ 1. System: "あなたはレポートデザイナーです。ビジュアルを埋め込んだプロフェッショナルなレポートを作成してください。"

+

+ # Agent A から

+ 2. User: "Q3 の売上データを分析し、可視化を作成してください。"

+

+ # Agent A から

+ 3. Tool: [bash] 棒グラフを作成:/output/q3_sales_by_region.png

+ 4. Tool: [bash] トレンドラインを作成:/output/q3_monthly_trend.png

+

+ # Agent A から

+ 5. Assistant: "Q3 の売上データを分析し、2つのチャートを作成しました..."

+

+ # Agent B のユーザーメッセージ

+ 6. User: "生成されたチャートを含む PDF レポートを作成してください。"

+ ```

+

+ Agent A の対話履歴をインポートすることで、Agent B はどのファイルが存在し、どこにあるかを正確に把握し、レポートに直接埋め込むことができます。

+

+

+

+

+

+ 例 1 の続きとして、生成された PDF レポートをエンドユーザーに提供したいとします。アーティファクトはエンドユーザーに直接公開できないため、3つ目の Agent ノードでファイルを抽出する必要があります。

+

+ Agent C の設定:

+

+ - **Agent モード**:オフ

+

+ - **構造化出力**:有効にし、ファイル型の出力変数を追加

+

+ - **対話履歴**:Agent B からインポート

+

+ - **ユーザーメッセージ**:「生成された PDF を出力してください。」

+

+ Agent B の対話履歴インポート後に Agent C が受け取る完全なメッセージシーケンス:

+ ```bash wrap

+ # Agent C のシステム指示(省略可)

+ 1. System:(なし)

+

+ # Agent A からのユーザーメッセージとツールメッセージ(簡潔にするため省略)

+ 2. ...

+

+ # Agent B から

+ 3. User: "生成されたチャートを含む PDF レポートを作成してください。"

+

+ # Agent B から

+ 4. Tool: [bash] レポートを作成:/output/q3_sales_report.pdf

+

+ # Agent B から

+ 5. Assistant: "チャートを埋め込んだ PDF レポートを作成しました..."

+

+ # Agent C のユーザーメッセージ

+ 6. User: "生成された PDF を出力してください。"

+ ```

+

+ Agent C はインポートされた対話履歴からファイルパスを特定し、ファイル変数として出力します。その後、回答ノードまたは出力ノードでこの変数を参照し、ファイルをエンドユーザーに提供できます。

+

+

+

+ ### Jinja2 を使った動的プロンプトの作成

+

+ [Jinja2](https://jinja.palletsprojects.com/en/stable/) テンプレートを使って、プロンプトに条件分岐、ループ、その他のロジックを追加できます。例えば、変数の値に応じて指示をカスタマイズできます。

+

+

+ ```jinja2 wrap

+ あなたは

+ {% if user_level == "beginner" %}忍耐強く親切な

+ {% elif user_level == "intermediate" %}プロフェッショナルで効率的な

+ {% else %}シニアエキスパートレベルの

+ {% endif %} アシスタントです。

+

+ {% if user_level == "beginner" %}

+ わかりやすい言葉で説明してください。必要に応じて例を示してください。専門用語は避けてください。

+ {% elif user_level == "intermediate" %} 一部の専門用語を使用できますが、適切な説明を付けてください。実践的なアドバイスとベストプラクティスを提供してください。

+ {% else %} 技術的な詳細に踏み込み、専門用語を使用してください。高度なユースケースと最適化ソリューションに焦点を当ててください。

+ {% endif %}

+ ```

+

+

+ デフォルトでは、すべての可能な指示をモデルに送信し、条件を説明し、どれに従うかをモデルに判断させる必要がありますが、この方法は必ずしも信頼できるとは限りません。

+

+ Jinja2 テンプレートを使えば、定義された条件に合致する指示のみが送信されるため、動作が予測可能になり、トークンの使用量も削減されます。

+

+ ## コマンド実行の有効化(Agent モード)

+

+ **Agent モード**をオンにすると、モデルが組み込みの bash ツールを使ってサンドボックスランタイムでコマンドラインを実行できるようになります。

+

+ これはすべての高度な機能の基盤です:モデルが他のツールを呼び出す、ファイル操作を行う、スクリプトを実行する、外部リソースにアクセスする——これらすべては bash ツールを呼び出して基盤となるコマンドラインを実行することで行われます。

+

+ これらの機能が不要なシンプルなタスクでは、**Agent モード**をオフにすることで、より高速なレスポンスと低いトークンコストを実現できます。

+

+ **最大イテレーション回数の調整**

+

+ **高度な設定**の**最大イテレーション回数**は、モデルが1つのリクエストに対して推論-行動サイクル(思考、ツール呼び出し、結果処理)を繰り返す回数を制限します。

+

+ 複数のツール呼び出しを必要とする複雑なマルチステップタスクでは、この値を増やしてください。値が大きいほどレイテンシとトークンコストが増加します。

+

+ ## 対話メモリの有効化(チャットフローのみ)

+

+

+ メモリはこのノード内でのみ有効です。異なる会話間では保持されません。

+

+

+ **メモリ**を有効にすると最近の対話が保持され、LLM がフォローアップの質問に一貫して回答できるようになります。

+

+ 現在のユーザークエリとアップロードされたファイルを渡すためのユーザーメッセージが自動的に追加されます。これはメモリが最近のユーザー-アシスタント間のやり取りを保存することで機能するためです。ユーザークエリがユーザーメッセージを通じて渡されないと、ユーザー側で記録するものがなくなります。

+

+ **ウィンドウサイズ**は保持する最近のやり取り数を制御します。例えば `5` は、直近の5組のユーザークエリと LLM レスポンスを保持します。

+

+ ## コンテキストの追加

+

+ **高度な設定** > **コンテキスト**で、LLM に追加の参照情報を提供し、ハルシネーションを減らしてレスポンスの精度を向上させます。

+

+ 一般的なパターン:ナレッジ検索ノードから[検索結果を渡す](/ja/use-dify/nodes/knowledge-retrieval#llm-ノードとの連携)ことで、検索拡張生成(RAG)を実現します。

+

+ ## マルチモーダル入力の処理

+

+ マルチモーダル対応モデルに画像、音声、動画、ドキュメントを処理させるには、以下のいずれかの方法を選択します:

+

+ - プロンプトでファイル変数を直接参照する。

+

+ - **高度な設定**で **Vision** を有効にし、ファイル変数を選択する。

+

+ **解像度**は画像処理の詳細レベルのみを制御します:

+

+ - **高**:複雑な画像でより高精度だが、より多くのトークンを使用

+

+ - **低**:シンプルな画像でより高速、より少ないトークンで処理

+

+ マルチモーダル機能を持たないモデルの場合は、[サンドボックスへのファイルアップロード](/ja/use-dify/nodes/upload-file-to-sandbox)ノードでファイルをサンドボックスにアップロードします。Agent ノードがコマンドラインを実行してツールのインストールやスクリプトの実行を行い、モデルがネイティブに処理できないファイル形式も処理できます。

+

+ ## 思考プロセスとツール呼び出しをレスポンスから分離

+

+ モデルの思考プロセスやツール呼び出しを含まないクリーンなレスポンスを取得するには、`generations.content` 出力変数を使用します。

+

+ `generations` 変数自体にはすべての中間ステップと最終レスポンスが含まれます。

+

+ ## 構造化出力の強制

+

+ 指示で出力形式を記述しても、一貫性のない結果が生じることがあります。より信頼性の高いフォーマットを実現するには、構造化出力を有効にして定義済みの JSON スキーマを強制します。

+

+

+ ネイティブ JSON をサポートしないモデルの場合、Dify はスキーマをプロンプトに含めますが、厳密な遵守は保証されません。

+

+

+  +

+ 1. **出力変数**の横で**構造化**をオンにします。出力変数リストの末尾に `structured_output` 変数が表示されます。

+

+ 2. **設定**をクリックし、以下のいずれかの方法で出力スキーマを定義します。

+

+ - **ビジュアルエディター**:ノーコードインターフェースでシンプルな構造を定義。対応する JSON スキーマが自動生成されます。

+

+ - **JSON Schema**:ネストされたオブジェクト、配列、バリデーションルールを含む複雑な構造のスキーマを直接記述。

+

+ - **AI 生成**:自然言語でニーズを記述し、AI にスキーマを生成させる。

+

+ - **JSON インポート**:既存の JSON オブジェクトを貼り付けて、対応するスキーマを自動生成。

+

+

+ ファイル型の構造化出力変数を使用して、サンドボックスからアーティファクトを抽出し、エンドユーザーに提供できます。詳細は[エンドユーザーへのアーティファクトの出力](/ja/use-dify/build/file-system#エンドユーザーへのアーティファクトの出力)を参照してください。

+

+

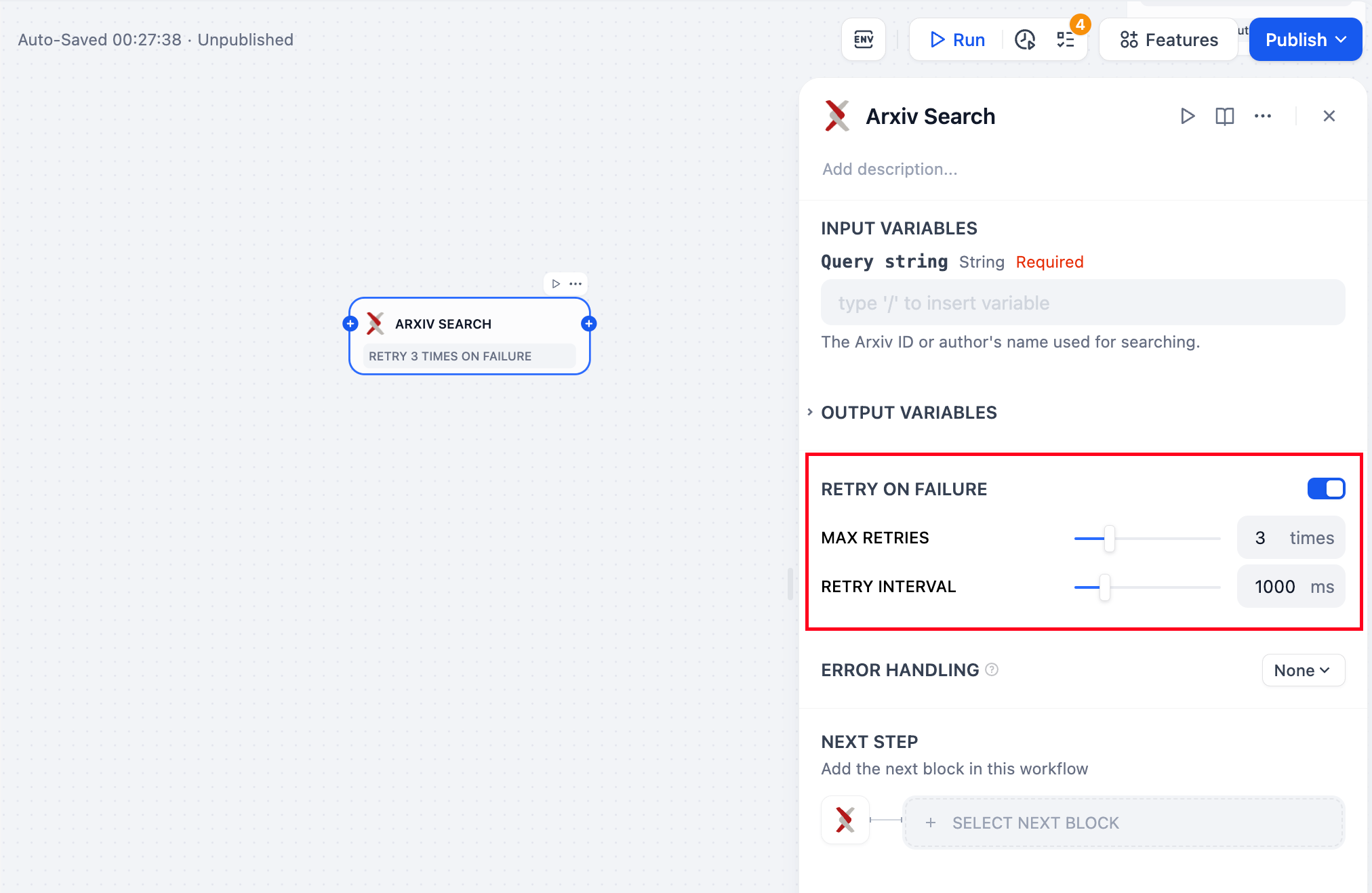

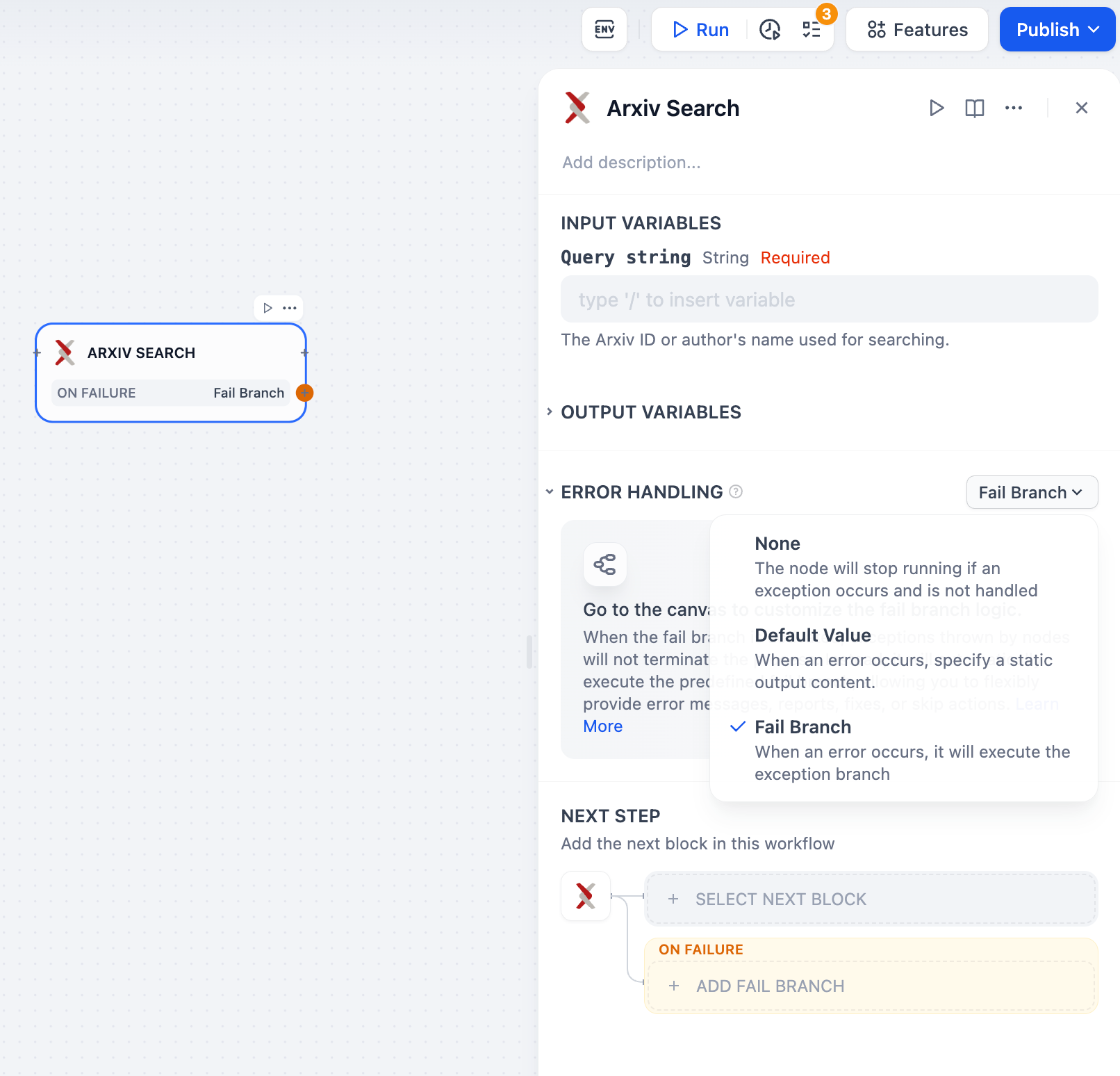

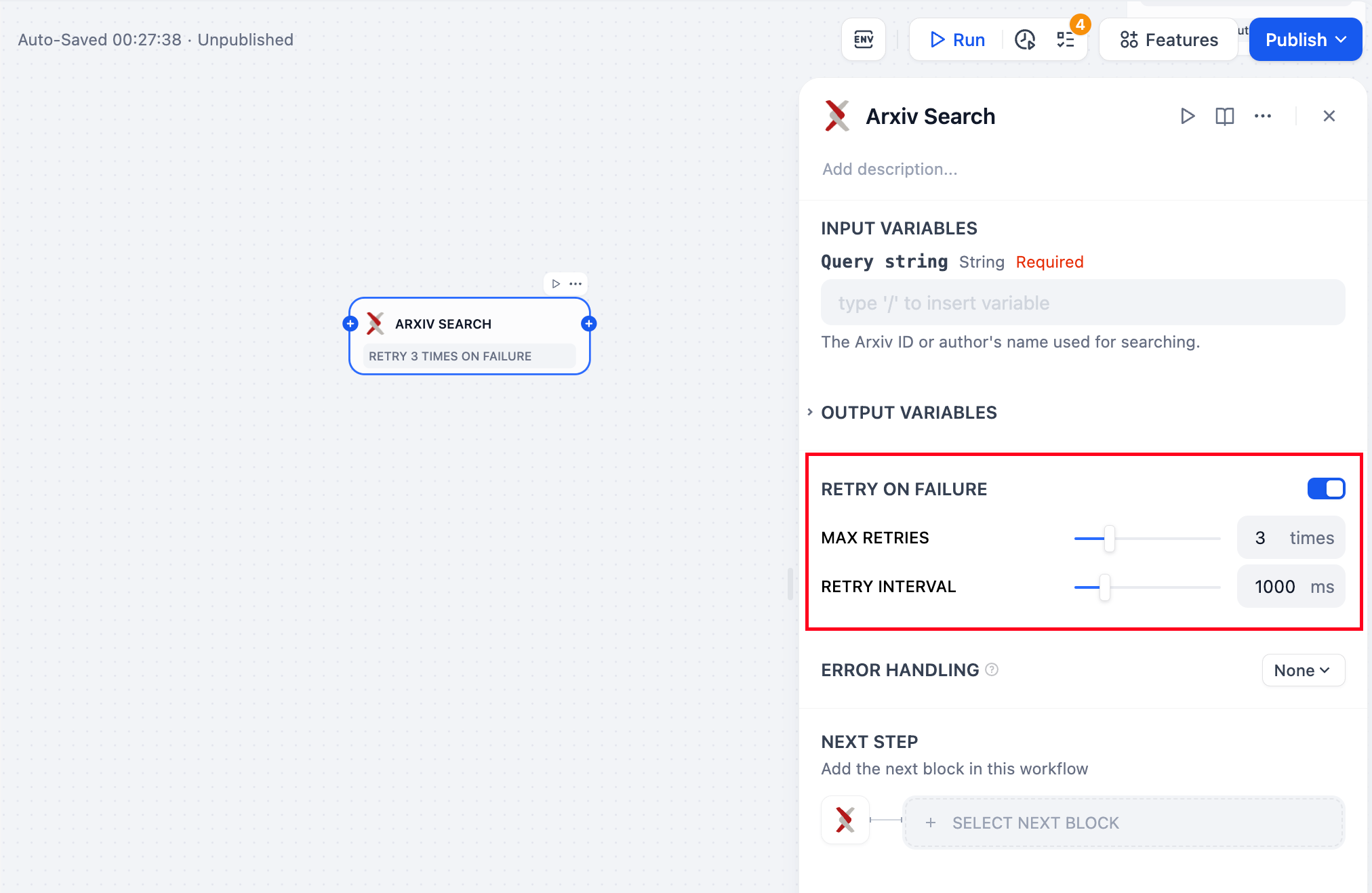

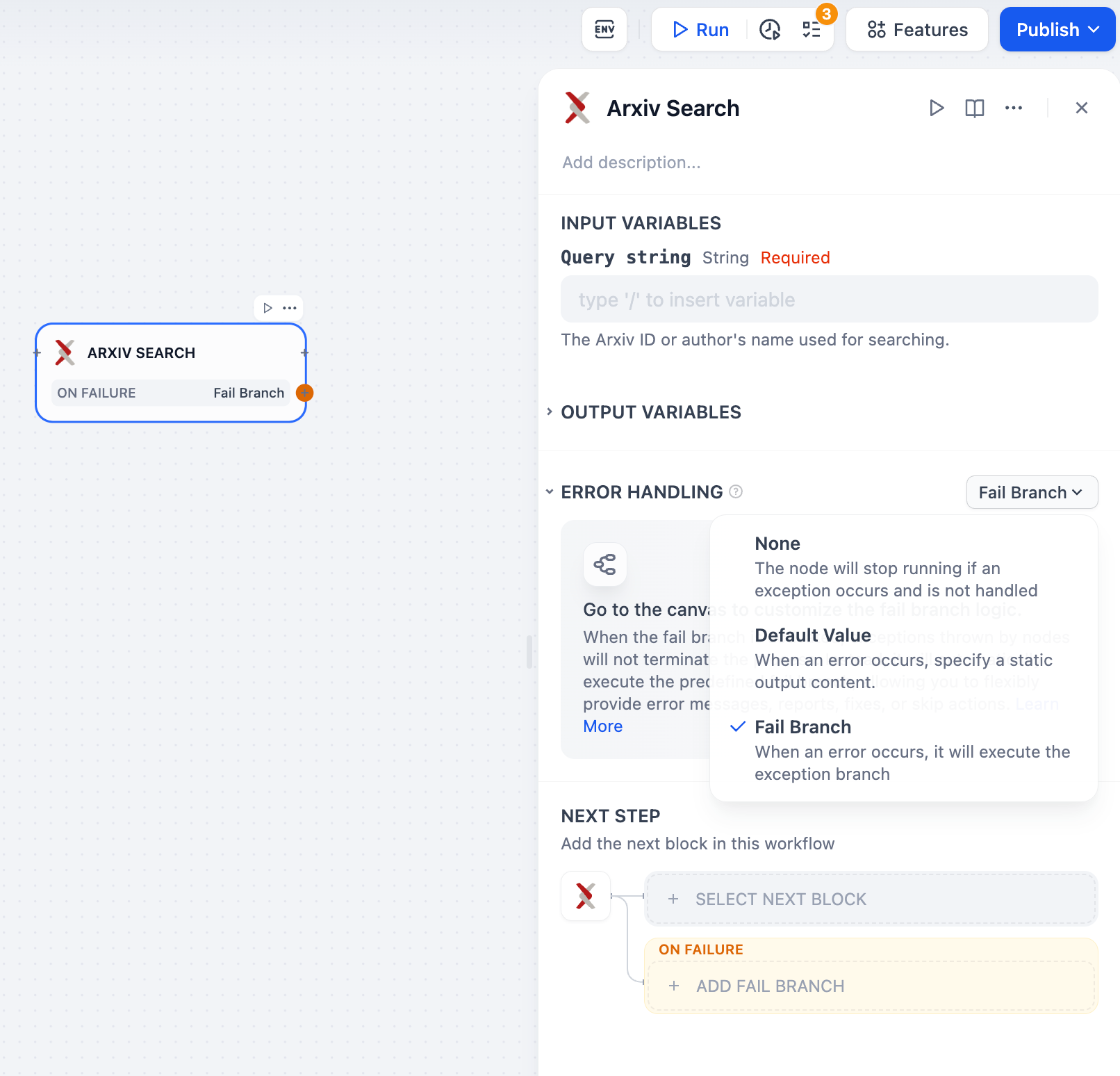

+ ## エラー処理

+

+ 一時的な問題(ネットワークの不具合など)に対する自動リトライ、またはエラーが続く場合にワークフローの実行を継続するための代替エラー処理戦略を設定します。

+

+

+

+ 1. **出力変数**の横で**構造化**をオンにします。出力変数リストの末尾に `structured_output` 変数が表示されます。

+

+ 2. **設定**をクリックし、以下のいずれかの方法で出力スキーマを定義します。

+

+ - **ビジュアルエディター**:ノーコードインターフェースでシンプルな構造を定義。対応する JSON スキーマが自動生成されます。

+

+ - **JSON Schema**:ネストされたオブジェクト、配列、バリデーションルールを含む複雑な構造のスキーマを直接記述。

+

+ - **AI 生成**:自然言語でニーズを記述し、AI にスキーマを生成させる。

+

+ - **JSON インポート**:既存の JSON オブジェクトを貼り付けて、対応するスキーマを自動生成。

+

+

+ ファイル型の構造化出力変数を使用して、サンドボックスからアーティファクトを抽出し、エンドユーザーに提供できます。詳細は[エンドユーザーへのアーティファクトの出力](/ja/use-dify/build/file-system#エンドユーザーへのアーティファクトの出力)を参照してください。

+

+

+ ## エラー処理

+

+ 一時的な問題(ネットワークの不具合など)に対する自動リトライ、またはエラーが続く場合にワークフローの実行を継続するための代替エラー処理戦略を設定します。

+

+  +

-

-

- 明示的な推論ステップを通じて大規模言語モデルを導く構造化されたプロンプトを使用します。透明な行動→観察**サイクルに従います。

-

- ネイティブな関数呼び出し機能を持たないモデルや、明示的な推論トレースが必要な場合によく機能します。

+

+

+ クラシックランタイムでは、Agent ノードは LLM にツールの自律的な制御権を与え、どのツールをいつ使用するかを反復的に判断できるようにします。Agent はすべてのステップを事前に計画するのではなく、問題を動的に推論し、必要に応じてツールを呼び出して複雑なタスクを完了します。

+

+

+

+

-

-

- 明示的な推論ステップを通じて大規模言語モデルを導く構造化されたプロンプトを使用します。透明な行動→観察**サイクルに従います。

-

- ネイティブな関数呼び出し機能を持たないモデルや、明示的な推論トレースが必要な場合によく機能します。

+

+

+ クラシックランタイムでは、Agent ノードは LLM にツールの自律的な制御権を与え、どのツールをいつ使用するかを反復的に判断できるようにします。Agent はすべてのステップを事前に計画するのではなく、問題を動的に推論し、必要に応じてツールを呼び出して複雑なタスクを完了します。

+

+

+  +

+

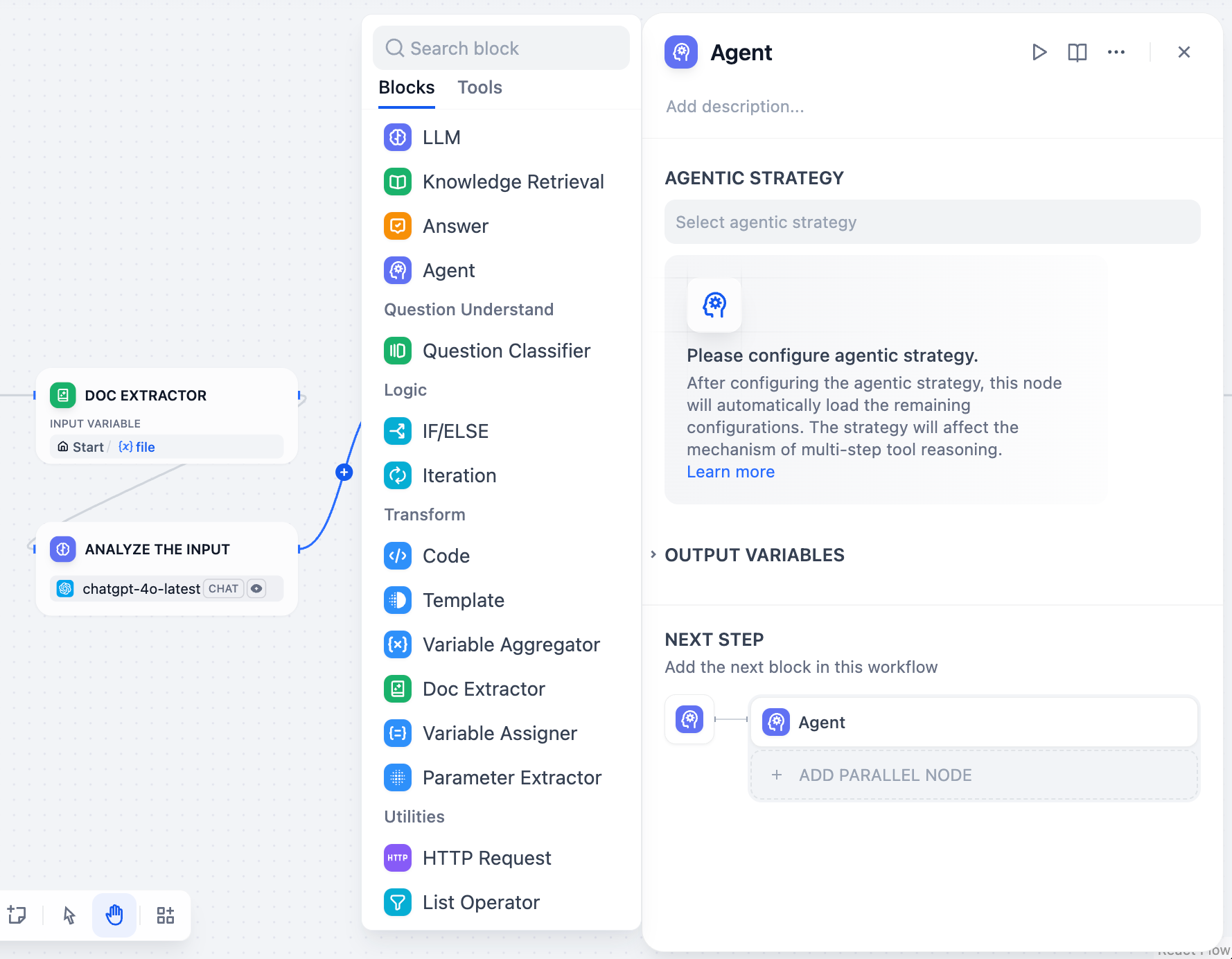

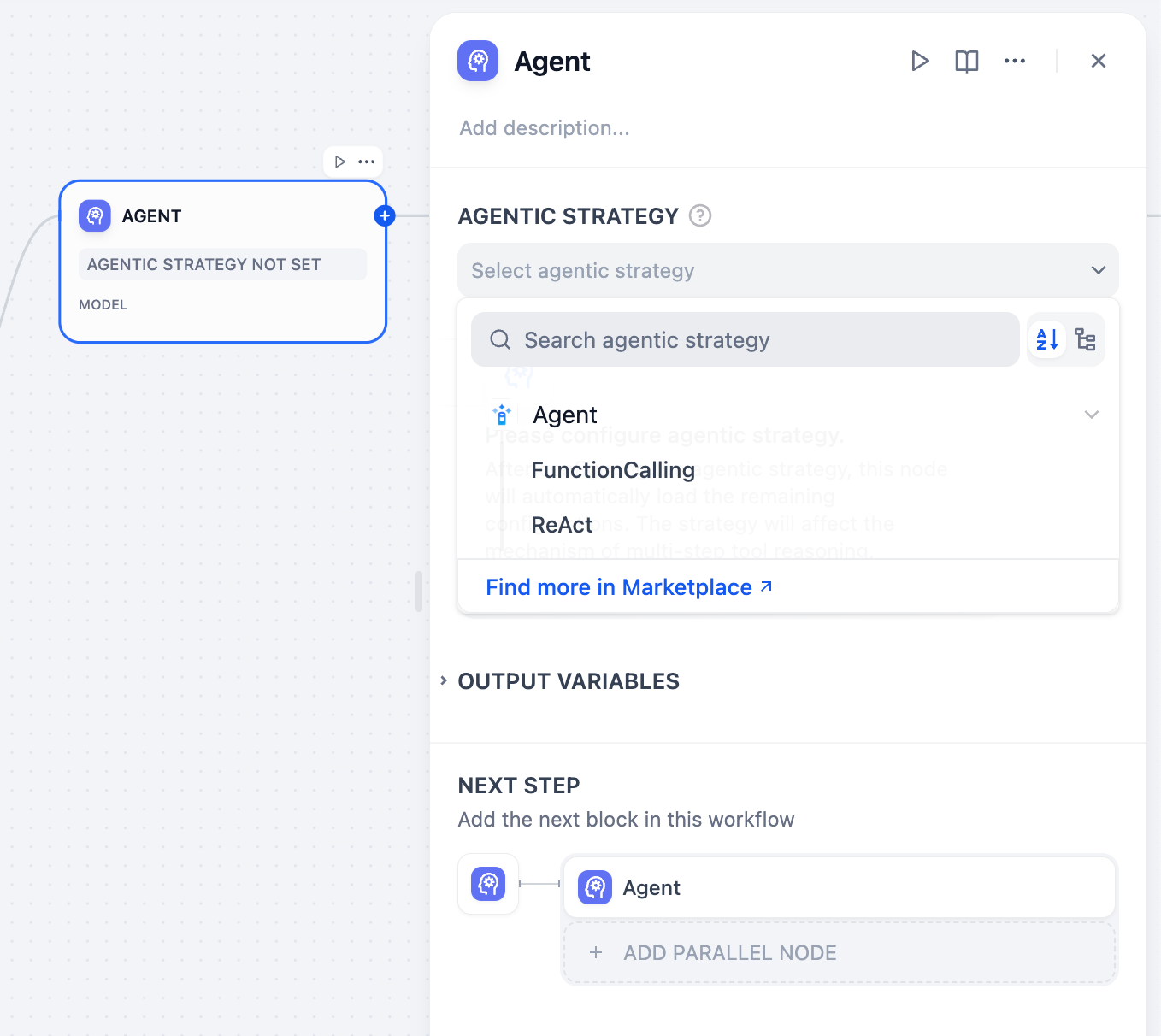

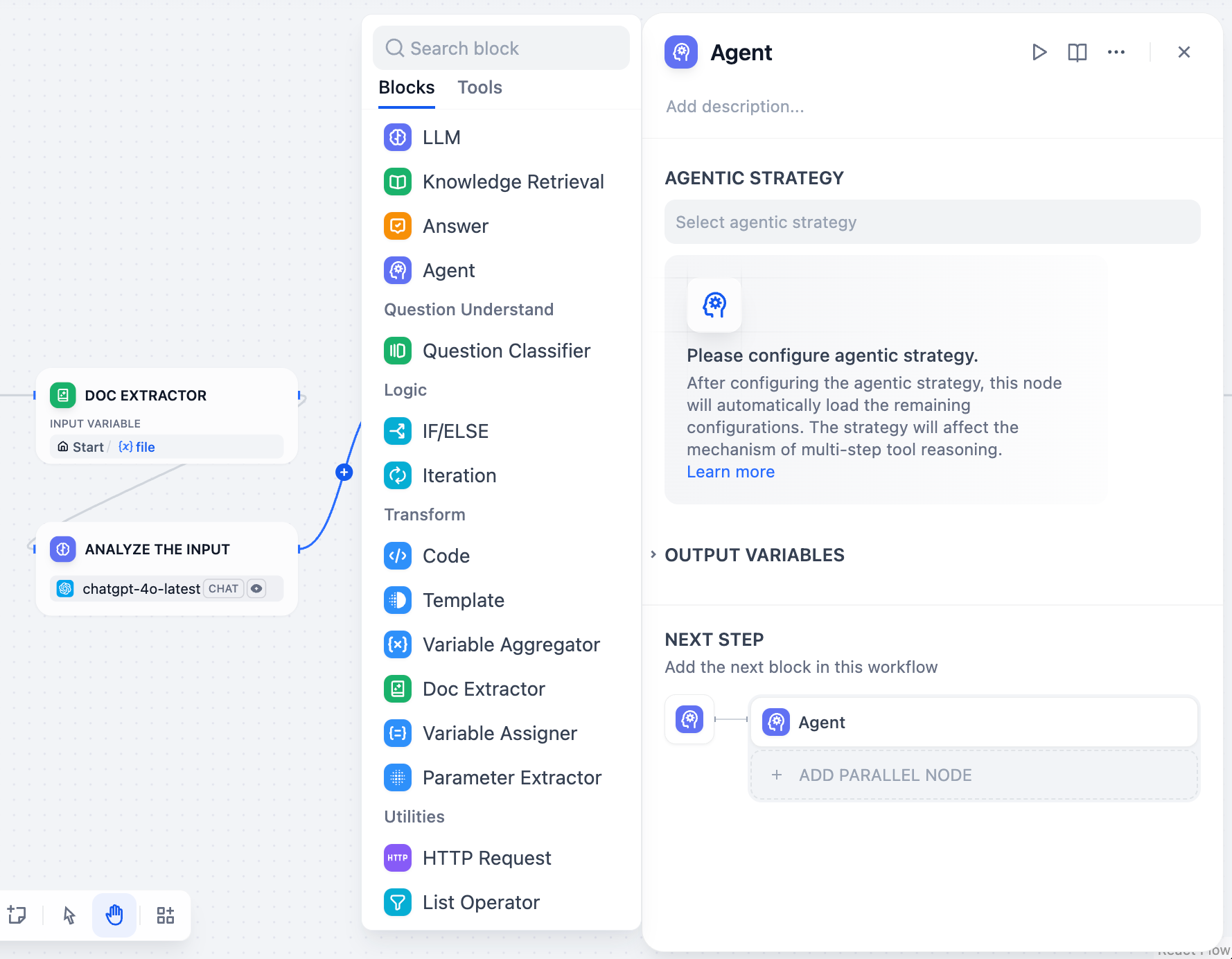

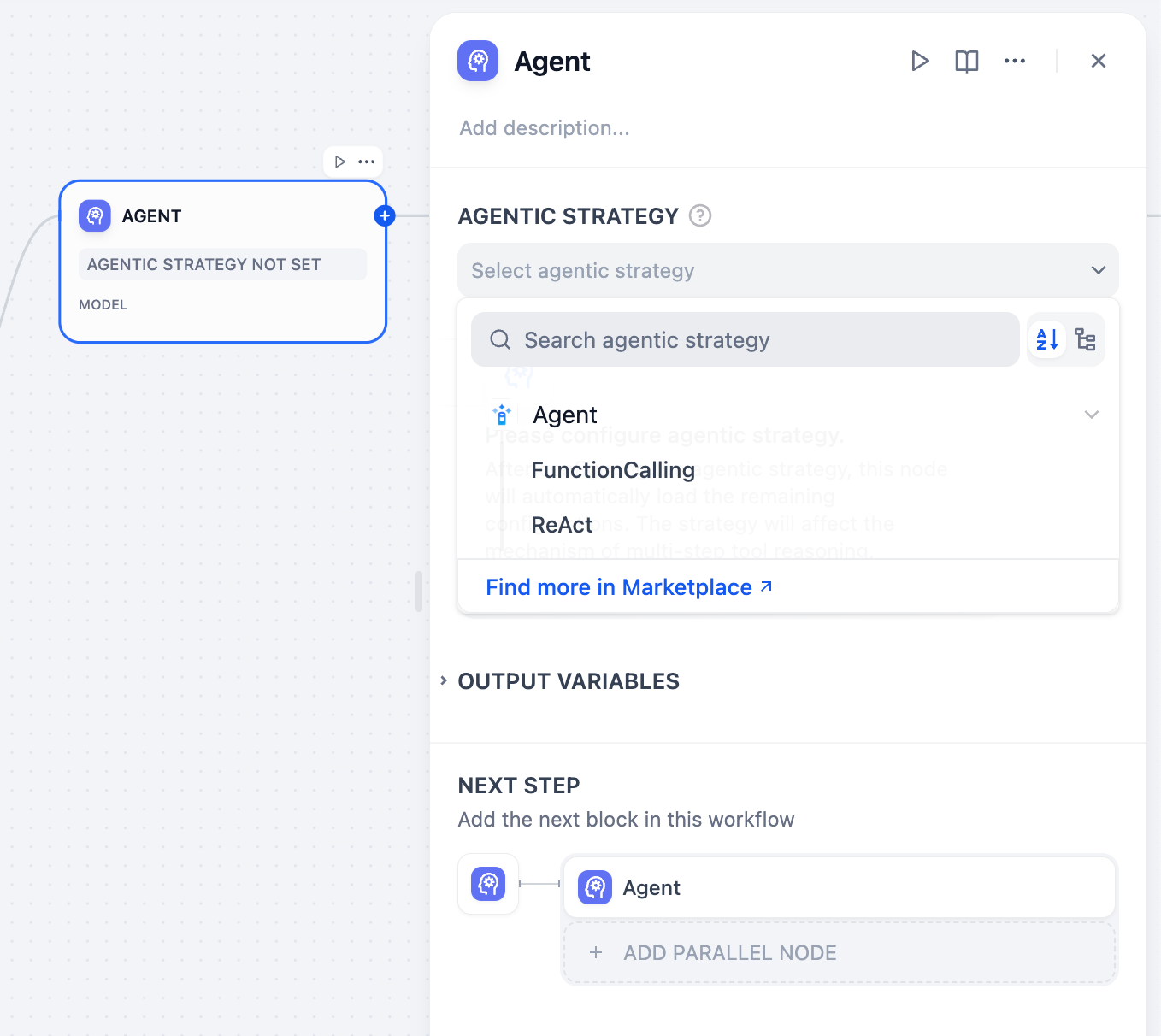

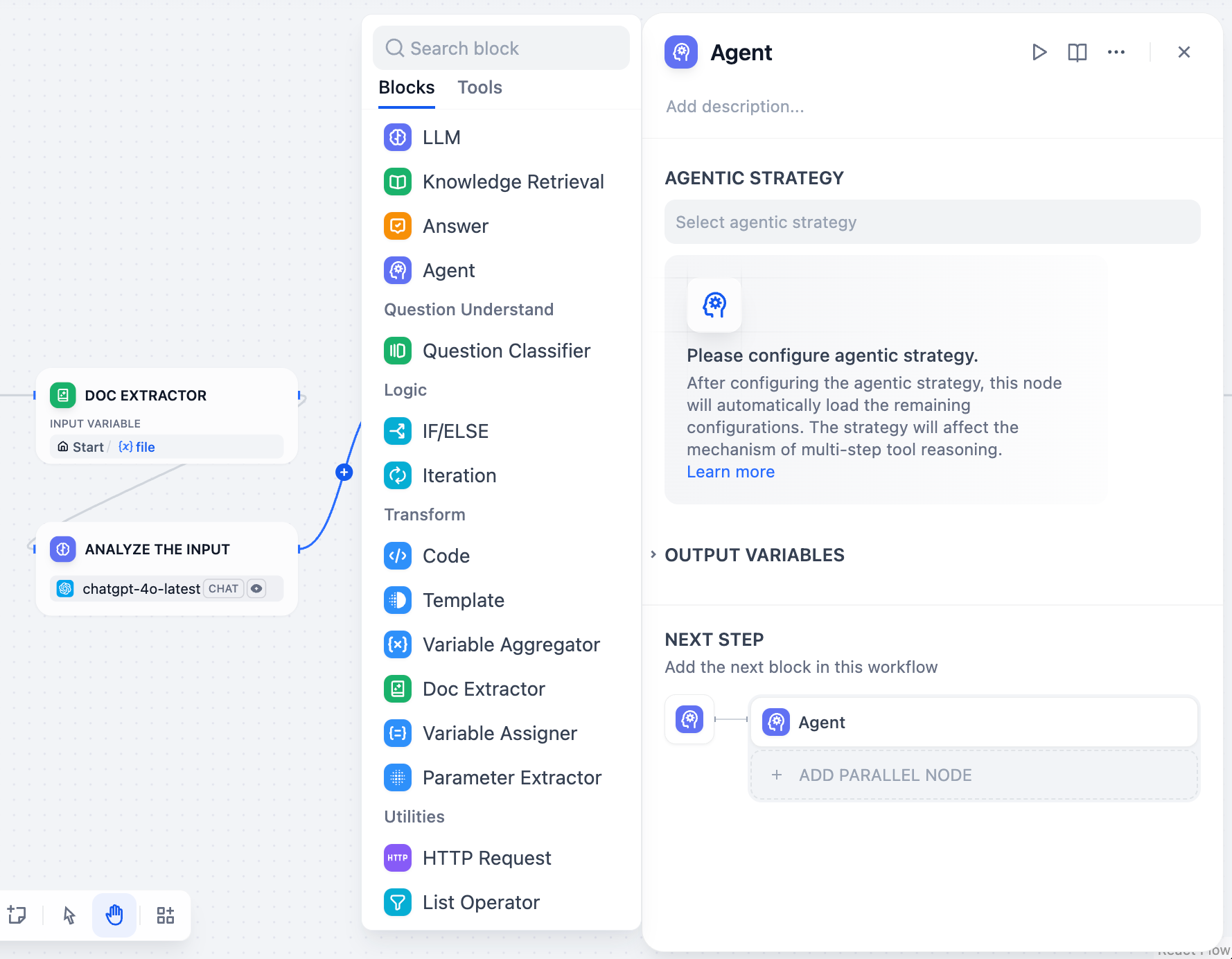

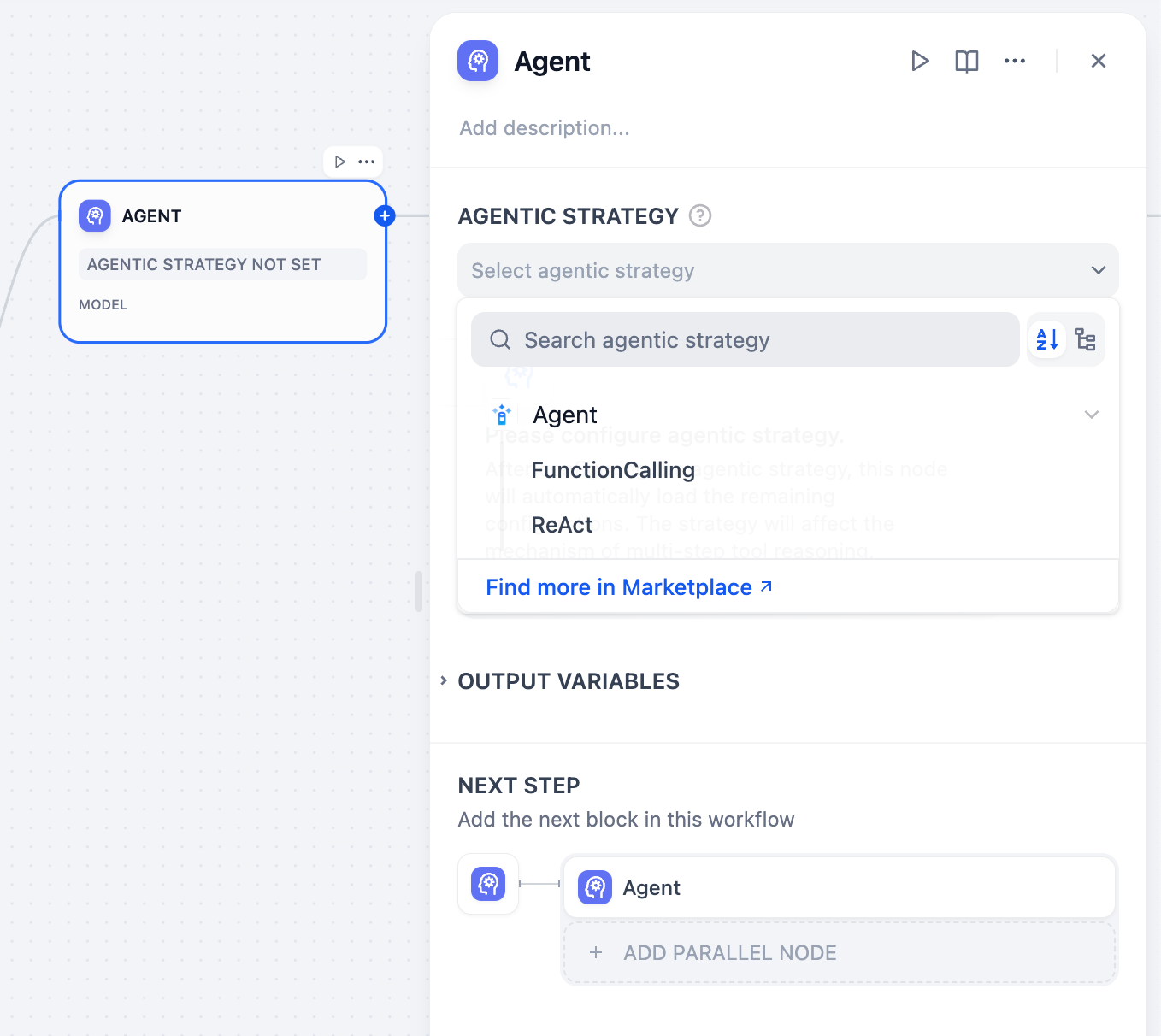

+ ## Agent 戦略

+

+ Agent 戦略は Agent の思考と行動の方法を定義します。モデルの能力とタスクの要件に最も適したアプローチを選択してください。

+

+

+

+

+

+ ## Agent 戦略

+

+ Agent 戦略は Agent の思考と行動の方法を定義します。モデルの能力とタスクの要件に最も適したアプローチを選択してください。

+

+

+  +

+

+

+

+ LLM のネイティブな Function Calling 機能を使用し、tools パラメータを通じてツール定義を直接渡します。LLM は組み込みメカニズムを使って、いつどのようにツールを呼び出すかを判断します。

+

+ GPT-4、Claude 3.5 など、強力な Function Calling サポートを持つモデルに最適です。

+

+

+

+ 構造化されたプロンプトを使い、LLM を明示的な推論ステップに導きます。**思考 → 行動 → 観察**のサイクルに従い、透明な意思決定を行います。

+

+ ネイティブな Function Calling 機能を持たないモデルや、明示的な推論トレースが必要な場合に適しています。

+

+

+

+

+ **マーケットプレイス → Agent 戦略**から追加の戦略をインストールするか、[コミュニティリポジトリ](https://github.com/langgenius/dify-plugins)にカスタム戦略を提供してください。

+

+

+

+

+

+

+

+

+ LLM のネイティブな Function Calling 機能を使用し、tools パラメータを通じてツール定義を直接渡します。LLM は組み込みメカニズムを使って、いつどのようにツールを呼び出すかを判断します。

+

+ GPT-4、Claude 3.5 など、強力な Function Calling サポートを持つモデルに最適です。

+

+

+

+ 構造化されたプロンプトを使い、LLM を明示的な推論ステップに導きます。**思考 → 行動 → 観察**のサイクルに従い、透明な意思決定を行います。

+

+ ネイティブな Function Calling 機能を持たないモデルや、明示的な推論トレースが必要な場合に適しています。

+

+

+

+

+ **マーケットプレイス → Agent 戦略**から追加の戦略をインストールするか、[コミュニティリポジトリ](https://github.com/langgenius/dify-plugins)にカスタム戦略を提供してください。

+

+

+

+  +

+

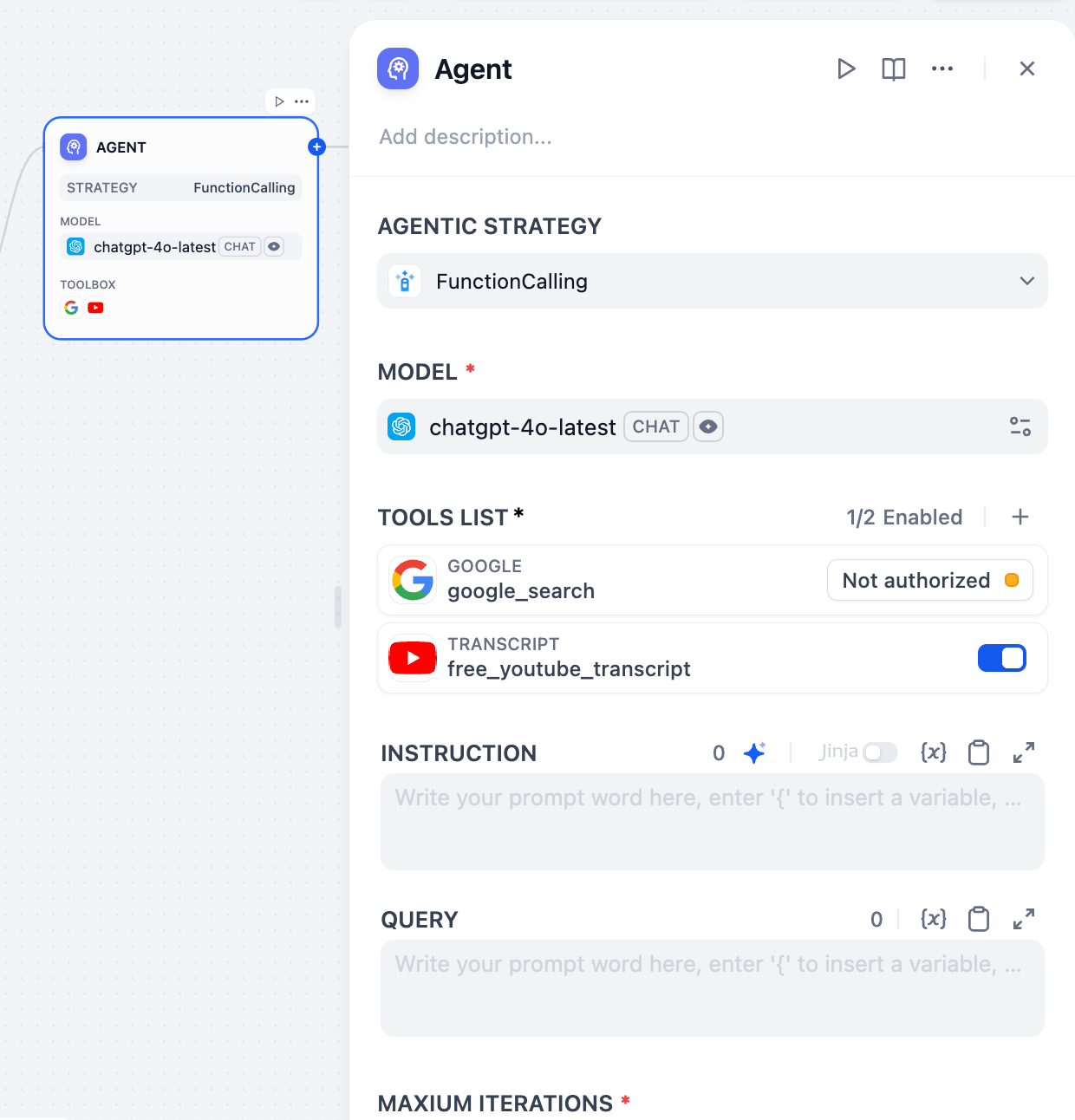

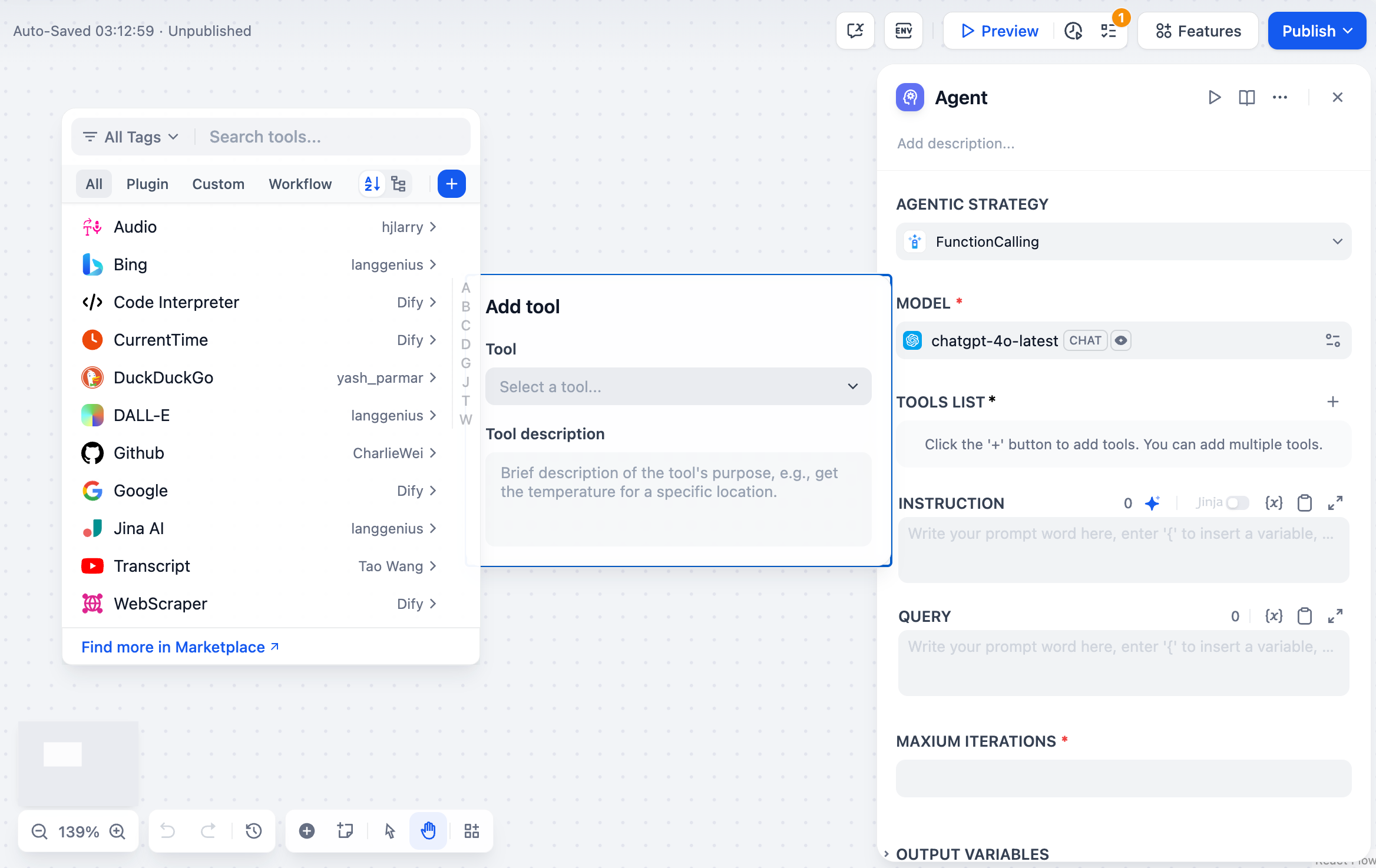

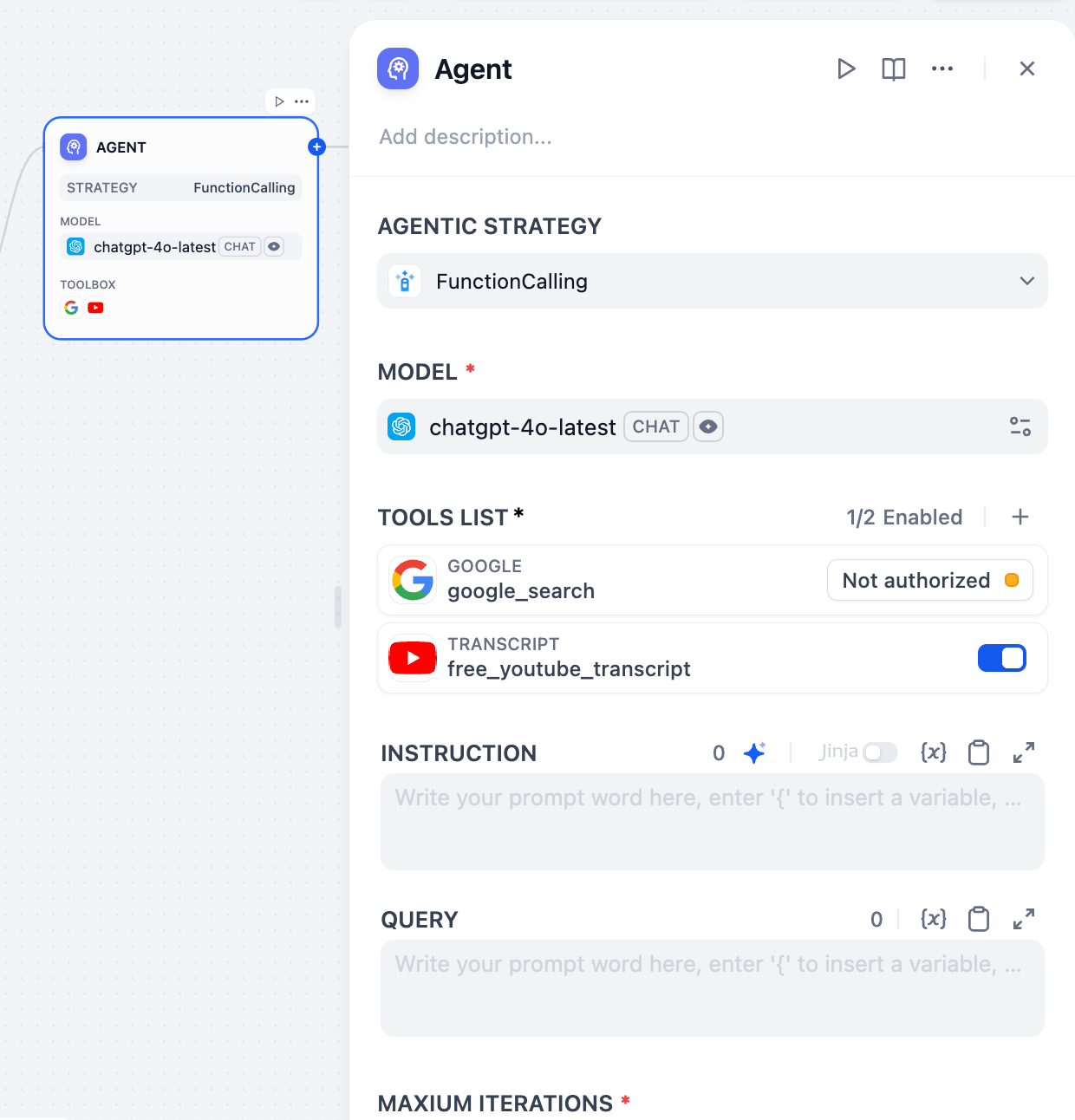

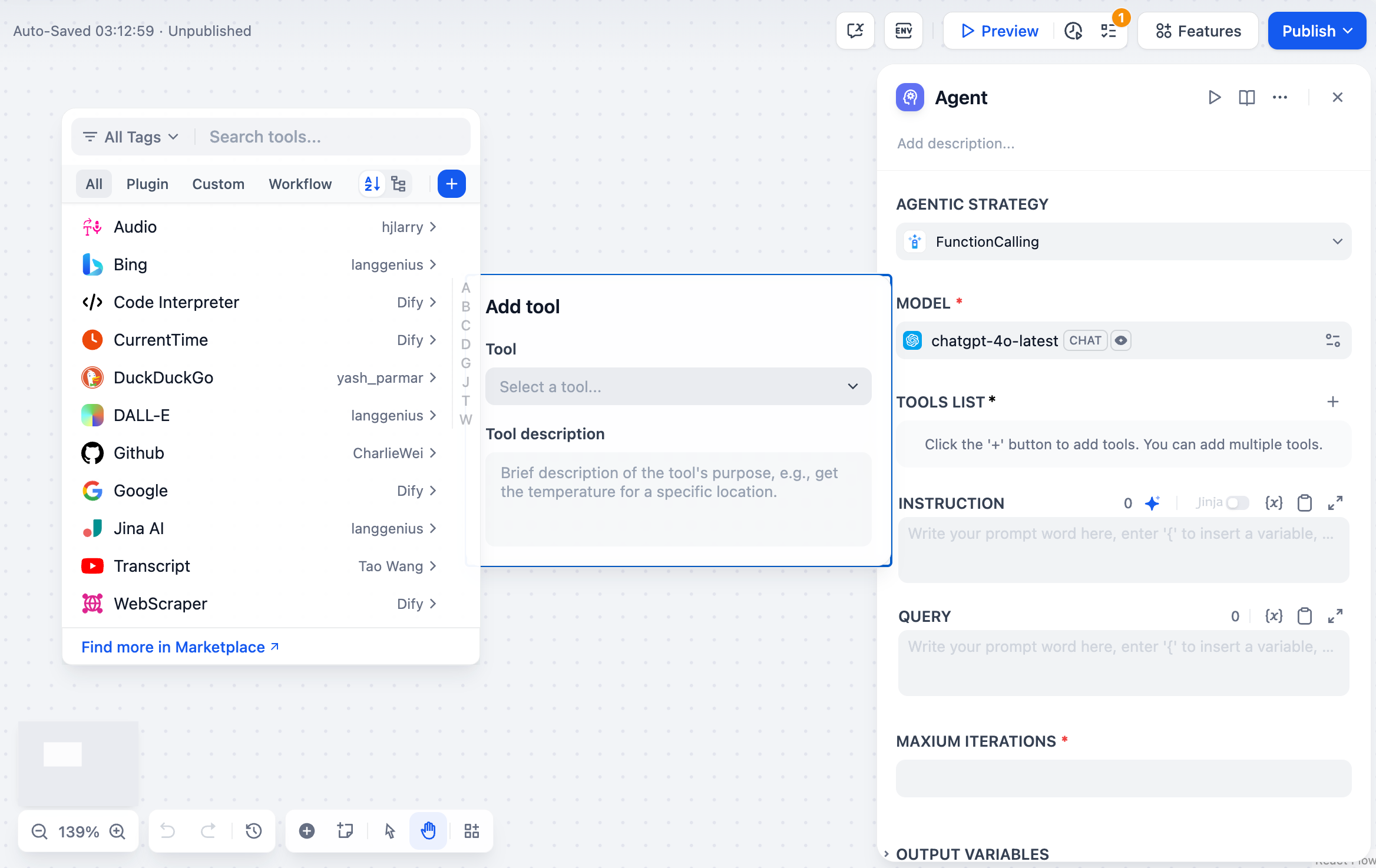

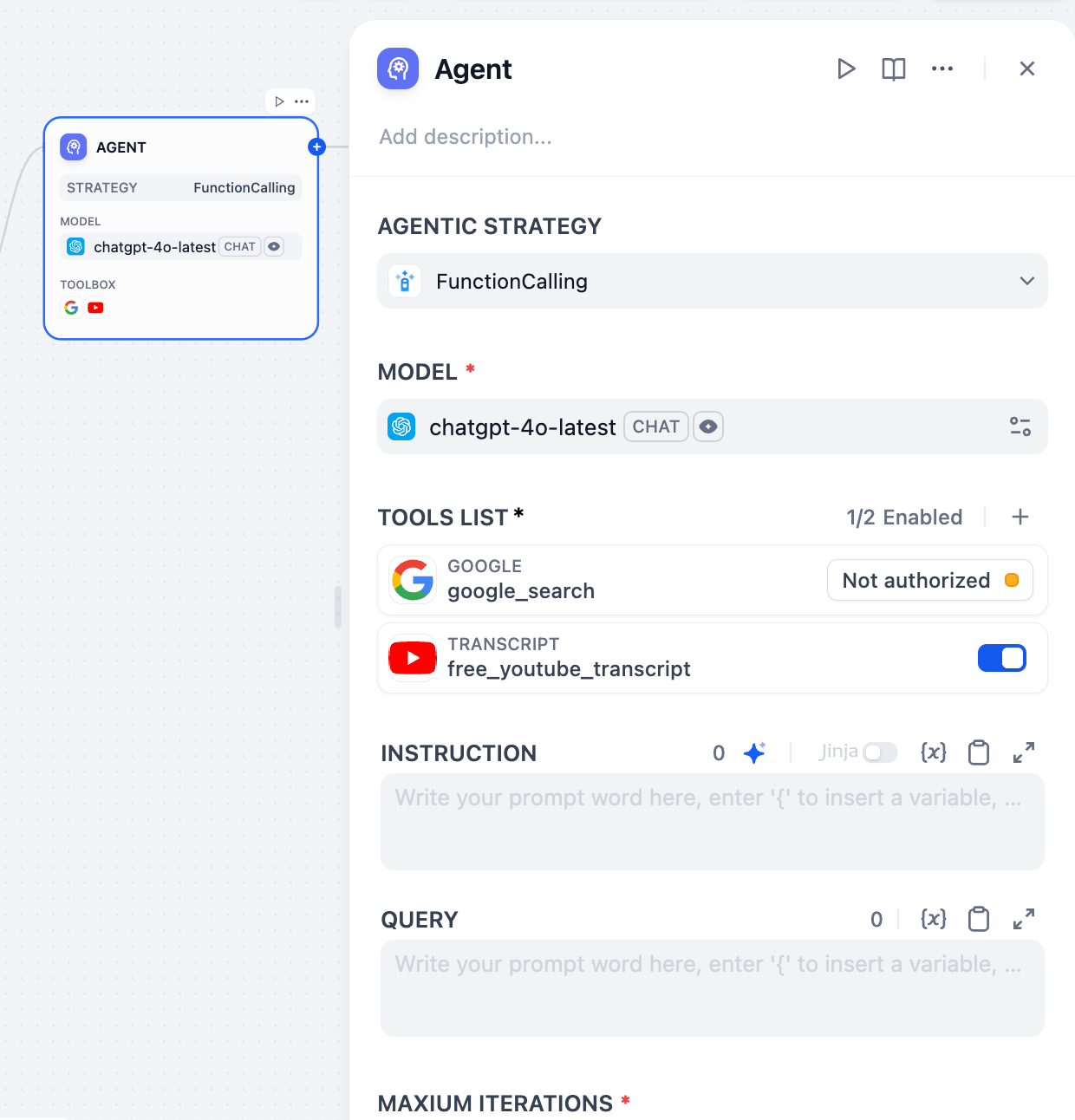

+ ## 設定

+

+ ### モデル選択

+

+ 選択した Agent 戦略をサポートする LLM を選択します。より高性能なモデルは複雑な推論をより良く処理しますが、イテレーションあたりのコストが高くなります。Function Calling 戦略を使用する場合は、モデルが Function Calling をサポートしていることを確認してください。

+

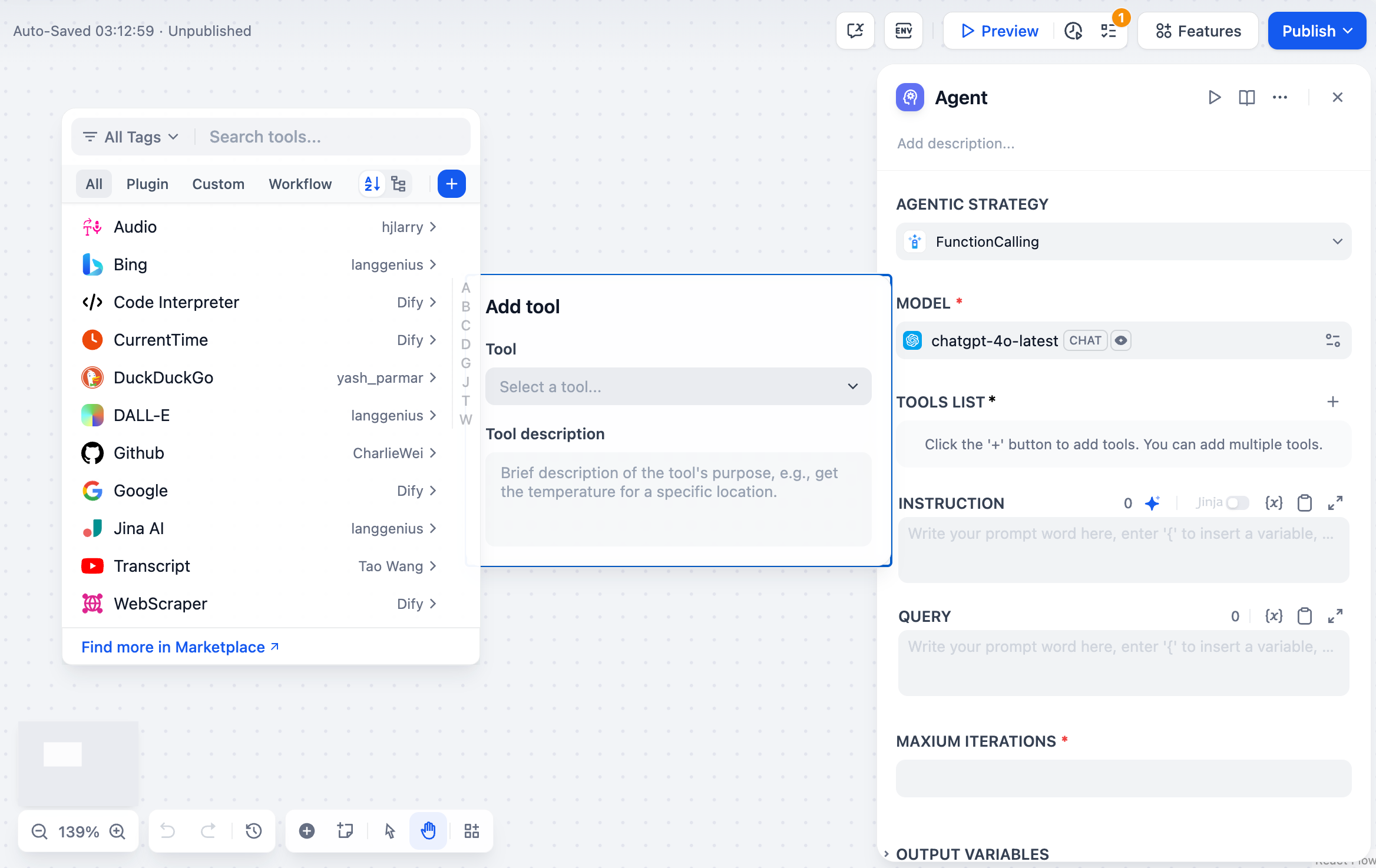

+ ### ツール設定

+

+ Agent がアクセスできるツールを設定します。各ツールには以下が必要です:

+

+ **認証** - ワークスペースで設定された外部サービスの API キーと認証情報

+

+ **説明** - ツールの機能と使用タイミングの明確な説明(これが Agent の意思決定を導きます)

+

+ **パラメータ** - 適切なバリデーションを伴う必須およびオプションの入力

+

+ ### 指示とコンテキスト

+

+ 自然言語の指示で Agent の役割、目標、コンテキストを定義します。上流のワークフローノードから変数を参照するには Jinja2 構文を使用します。

+

+ **クエリ**は Agent が処理すべきユーザー入力またはタスクを指定します。以前のワークフローノードからの動的コンテンツを使用できます。

+

+

+

+

+

+ ## 設定

+

+ ### モデル選択

+

+ 選択した Agent 戦略をサポートする LLM を選択します。より高性能なモデルは複雑な推論をより良く処理しますが、イテレーションあたりのコストが高くなります。Function Calling 戦略を使用する場合は、モデルが Function Calling をサポートしていることを確認してください。

+

+ ### ツール設定

+

+ Agent がアクセスできるツールを設定します。各ツールには以下が必要です:

+

+ **認証** - ワークスペースで設定された外部サービスの API キーと認証情報

+

+ **説明** - ツールの機能と使用タイミングの明確な説明(これが Agent の意思決定を導きます)

+

+ **パラメータ** - 適切なバリデーションを伴う必須およびオプションの入力

+

+ ### 指示とコンテキスト

+

+ 自然言語の指示で Agent の役割、目標、コンテキストを定義します。上流のワークフローノードから変数を参照するには Jinja2 構文を使用します。

+

+ **クエリ**は Agent が処理すべきユーザー入力またはタスクを指定します。以前のワークフローノードからの動的コンテンツを使用できます。

+

+

+  +

+

+ ### 実行制御

+

+ **最大イテレーション回数**は無限ループを防ぐための安全上限を設定します。タスクの複雑さに応じて設定してください——シンプルなタスクは3〜5回、複雑な調査は10〜15回が目安です。

+

+ **メモリ**は TokenBufferMemory を使って Agent が記憶する過去のメッセージ数を制御します。メモリウィンドウを大きくするとコンテキストが増えますが、トークンコストも増加します。これにより、ユーザーが以前のアクションを参照できる会話の連続性が実現します。

+

+ ### ツールパラメータの自動生成

+

+ ツールには**自動生成**または**手動入力**として設定されたパラメータがあります。自動生成パラメータ(`auto: false`)は Agent が自動的に設定し、手動入力パラメータはツールの永続設定の一部となる明示的な値が必要です。

+

+

+

+ ## 出力変数

+

+ Agent ノードは以下を含む包括的な出力を提供します:

+

+ **最終回答** - クエリに対する Agent の最終レスポンス

+

+ **ツール出力** - 実行中の各ツール呼び出しの結果

+

+ **推論トレース** - ステップごとの意思決定プロセス(特に ReAct 戦略で詳細)。JSON 出力で確認可能

+

+ **イテレーション回数** - 使用された推論サイクル数

+

+ **成功ステータス** - Agent がタスクを正常に完了したかどうか

+

+ **Agent ログ** - デバッグとモニタリングのためのメタデータを含む構造化ログイベント

+

+ ## ユースケース

+

+ **調査と分析** - Agent は複数のソースを自律的に検索し、情報を統合して包括的な回答を提供できます。

+

+ **トラブルシューティング** - 情報の収集、仮説のテスト、発見に基づくアプローチの調整が必要な診断タスク。

+

+ **マルチステップデータ処理** - 次のアクションが中間結果に依存する複雑なワークフロー。

+

+ **動的 API 統合** - API 呼び出しの順序が事前に決定できない応答と条件に依存するシナリオ。

+

+ ## ベストプラクティス

+

+ **明確なツール説明**は、Agent が各ツールをいつどのように効果的に使用するかを理解するのに役立ちます。

+

+ **適切なイテレーション制限**は、複雑なタスクに十分な柔軟性を確保しながらコストの暴走を防ぎます。

+

+ **詳細な指示**は、Agent の役割、目標、制約や優先事項に関するコンテキストを提供します。

+

+ **メモリ管理**は、ユースケースの要件に基づいてコンテキスト保持とトークン効率のバランスをとります。

+

-

-

- **マーケットプレイス → エージェント戦略**から追加戦略をインストールするか、[コミュニティリポジトリ](https://github.com/langgenius/dify-plugins)にカスタム戦略を貢献してください。

-

-

-

-

+

+

+ ### 実行制御

+

+ **最大イテレーション回数**は無限ループを防ぐための安全上限を設定します。タスクの複雑さに応じて設定してください——シンプルなタスクは3〜5回、複雑な調査は10〜15回が目安です。

+

+ **メモリ**は TokenBufferMemory を使って Agent が記憶する過去のメッセージ数を制御します。メモリウィンドウを大きくするとコンテキストが増えますが、トークンコストも増加します。これにより、ユーザーが以前のアクションを参照できる会話の連続性が実現します。

+

+ ### ツールパラメータの自動生成

+

+ ツールには**自動生成**または**手動入力**として設定されたパラメータがあります。自動生成パラメータ(`auto: false`)は Agent が自動的に設定し、手動入力パラメータはツールの永続設定の一部となる明示的な値が必要です。

+

+

+

+ ## 出力変数

+

+ Agent ノードは以下を含む包括的な出力を提供します:

+

+ **最終回答** - クエリに対する Agent の最終レスポンス

+

+ **ツール出力** - 実行中の各ツール呼び出しの結果

+

+ **推論トレース** - ステップごとの意思決定プロセス(特に ReAct 戦略で詳細)。JSON 出力で確認可能

+

+ **イテレーション回数** - 使用された推論サイクル数

+

+ **成功ステータス** - Agent がタスクを正常に完了したかどうか

+

+ **Agent ログ** - デバッグとモニタリングのためのメタデータを含む構造化ログイベント

+

+ ## ユースケース

+

+ **調査と分析** - Agent は複数のソースを自律的に検索し、情報を統合して包括的な回答を提供できます。

+

+ **トラブルシューティング** - 情報の収集、仮説のテスト、発見に基づくアプローチの調整が必要な診断タスク。

+

+ **マルチステップデータ処理** - 次のアクションが中間結果に依存する複雑なワークフロー。

+

+ **動的 API 統合** - API 呼び出しの順序が事前に決定できない応答と条件に依存するシナリオ。

+

+ ## ベストプラクティス

+

+ **明確なツール説明**は、Agent が各ツールをいつどのように効果的に使用するかを理解するのに役立ちます。

+

+ **適切なイテレーション制限**は、複雑なタスクに十分な柔軟性を確保しながらコストの暴走を防ぎます。

+

+ **詳細な指示**は、Agent の役割、目標、制約や優先事項に関するコンテキストを提供します。

+

+ **メモリ管理**は、ユースケースの要件に基づいてコンテキスト保持とトークン効率のバランスをとります。

+

-

-

- **マーケットプレイス → エージェント戦略**から追加戦略をインストールするか、[コミュニティリポジトリ](https://github.com/langgenius/dify-plugins)にカスタム戦略を貢献してください。

-

-

-

-  -

-

-## 設定

-

-### モデル選択

-

-選択したエージェント戦略をサポートする大規模言語モデルを選択してください。より高性能なモデルは複雑な推論をより良く処理しますが、反復あたりのコストが高くなります。その戦略を使用する場合は、モデルが関数呼び出しをサポートしていることを確認してください。

-

-### ツール設定

-

-エージェントがアクセスできるツールを設定します。各ツールには以下が必要です:

-

-**認証** - ワークスペースで設定された外部サービス用のAPIキーと認証情報

-

-**説明** - ツールの機能と使用タイミングの明確な説明(これがエージェントの意思決定を導きます)

-

-**パラメータ** - 適切な検証を伴うツールが受け入れる必須およびオプションの入力

-

-### 指示とコンテキスト

-

-自然言語の指示を使用してエージェントの役割、目標、コンテキストを定義します。上流のワークフローノードから変数を参照するには、Jinja2構文を使用します。

-

-**クエリ**は、エージェントが作業すべきユーザー入力またはタスクを指定します。これは以前のワークフローノードからの動的コンテンツにすることができます。

-

-

-

-

-

-## 設定

-

-### モデル選択

-

-選択したエージェント戦略をサポートする大規模言語モデルを選択してください。より高性能なモデルは複雑な推論をより良く処理しますが、反復あたりのコストが高くなります。その戦略を使用する場合は、モデルが関数呼び出しをサポートしていることを確認してください。

-

-### ツール設定

-

-エージェントがアクセスできるツールを設定します。各ツールには以下が必要です:

-

-**認証** - ワークスペースで設定された外部サービス用のAPIキーと認証情報

-

-**説明** - ツールの機能と使用タイミングの明確な説明(これがエージェントの意思決定を導きます)

-

-**パラメータ** - 適切な検証を伴うツールが受け入れる必須およびオプションの入力

-

-### 指示とコンテキスト

-

-自然言語の指示を使用してエージェントの役割、目標、コンテキストを定義します。上流のワークフローノードから変数を参照するには、Jinja2構文を使用します。

-

-**クエリ**は、エージェントが作業すべきユーザー入力またはタスクを指定します。これは以前のワークフローノードからの動的コンテンツにすることができます。

-

-

-  -

-

-### 実行制御

-

-**最大反復数**は、無限ループを防ぐための安全制限を設定します。タスクの複雑さに基づいて設定してください - 単純なタスクには3-5回の反復が必要ですが、複雑な調査には10-15回必要な場合があります。

-

-**メモリ**は、TokenBufferMemoryを使用してエージェントが記憶する過去のメッセージ数を制御します。より大きなメモリウィンドウはより多くのコンテキストを提供しますが、トークンコストが増加します。これにより、ユーザーが以前のアクションを参照できる会話の継続性が可能になります。

-

-### ツールパラメータ自動生成

-

-ツールには**自動生成**または**手動入力**として設定されたパラメータがあります。自動生成パラメータ(`auto: false`)はエージェントによって自動的に設定され、手動入力パラメータはツールの永続的な設定の一部となる明示的な値が必要です。

-

-

-

-## 出力変数

-

-エージェントノードは以下を含む包括的な出力を提供します:

-

-**最終回答** - クエリに対するエージェントの最終的な応答

-

-**ツール出力** - 実行中の各ツール呼び出しからの結果

-

-**推論トレース** - JSON出力で利用可能なステップバイステップの決定プロセス(特に推論と行動戦略で詳細)

-

-**反復回数** - 使用された推論サイクルの数

-

-**成功ステータス** - エージェントがタスクを正常に完了したかどうか

-

-**エージェントログ** - ツール呼び出しのデバッグと監視のためのメタデータを含む構造化されたログイベント

-

-## 使用例

-

-**調査と分析** - エージェントは複数のソースを自律的に検索し、情報を統合し、包括的。

-

-**トラブルシューティング** - エージェントが情報を収集し、仮説をテストし、発見に基づいてアプローチを適応させる必要がある診断タスク。

-

-**マルチステップデータ処理** - 次のアクションが中間結果に依存する複雑なワークフロー。

-

-**動的API統合** - API呼び出しの順序が事前に決定できない応答と条件に依存するシナリオ。

-

-## ベストプラクティス

-

-**明確なツール説明**は、エージェントが各ツールをいつどのように効果的に使用するかを理解するのに役立ちます。

-

-**適切な反復制限**は、複雑なタスクに対して十分な柔軟性を確保しながら、暴走コストを防ぎます。

-

-**詳細な指示**は、エージェントの役割、目標、制約や好みについてのコンテキストを提供します。

-

-**メモリ管理**は、使用例の要件に基づいて、コンテキスト保持とトークン効率のバランスを取ります。

diff --git a/ja/use-dify/nodes/command.mdx b/ja/use-dify/nodes/command.mdx

new file mode 100644

index 00000000..8ee66361

--- /dev/null

+++ b/ja/use-dify/nodes/command.mdx

@@ -0,0 +1,15 @@

+---

+title: コマンド実行

+description: ワークフロー内でシェルコマンドを直接実行

+icon: "rectangle-terminal"

+---

+

+ ⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/command)を参照してください。

+

+

+ このノードはサンドボックスランタイムを使用するアプリケーションでのみ利用可能です。

+

+

+Agent ノードはコマンドラインを自律的に実行できますが、実行するコマンドが明確で LLM の推論が不要な場合は、コマンド実行ノードの方が適しています。より高速で、トークンを消費しません。

+

+コマンドはデフォルトでルートディレクトリで実行されます。別の作業ディレクトリを使用するには、既存のパスまたは実行中に上流ノードによって作成されるパスを入力してください。

diff --git a/ja/use-dify/nodes/knowledge-retrieval.mdx b/ja/use-dify/nodes/knowledge-retrieval.mdx

index 3c73bd49..6b702f27 100644

--- a/ja/use-dify/nodes/knowledge-retrieval.mdx

+++ b/ja/use-dify/nodes/knowledge-retrieval.mdx

@@ -1,37 +1,33 @@

---

-title: 知識検索

+title: ナレッジ検索

icon: "database"

---

⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/knowledge-retrieval)を参照してください。

-## はじめに

+ナレッジ検索ノードを使用して、既存のナレッジベースをワークフローに統合します。このノードは特定のナレッジからクエリに関連する情報を検索し、下流ノード(LLM など)で使用するコンテキスト情報として結果を出力します。

-知識検索ノードを使用すると、既存のナレッジベースをChatflowやワークフローに統合できます。このノードは指定されたナレッジからクエリに関連する情報を検索し、その結果を下流ノード(例:LLM)で利用できるコンテキスト情報として出力します。

+以下はチャットフローでナレッジ検索ノードを使用する例です:

-以下はChatflowにおける知識検索ノードの利用例です:

+1. **ユーザー入力**ノードがユーザーのクエリを収集します。

-1. **ユーザー入力** ノードがユーザーの質問を収集します。

+2. **ナレッジ検索**ノードが選択されたナレッジベースからユーザーのクエリに関連するコンテンツを検索し、結果を出力します。

-2. **知識検索** ノードが選択されたナレッジベースからユーザーの質問に関連するコンテンツを検索し、検索結果を出力します。

+3. **LLM** ノードがユーザーのクエリと検索されたナレッジの両方に基づいてレスポンスを生成します。

-3. **LLM** ノードがユーザーの質問と検索されたナレッジの両方をもとに回答を生成します。

+4. **回答**ノードが LLM のレスポンスをユーザーに返します。

-4. **回答** ノードがLLMの応答をユーザーへ返します。

+

-

+ナレッジ検索ノードを使用する前に、少なくとも1つの利用可能なナレッジベースがあることを確認してください。ナレッジベースの作成方法については、[ナレッジ](/ja/use-dify/knowledge/readme#ナレッジの作成)を参照してください。

- 知識検索ノードを使用する前に、少なくとも1つのナレッジベースが利用可能であることを確認してください。ナレッジベースの作成方法については、[ナレッジ](/ja/use-dify/knowledge/readme#ナレッジの作成)を参照してください。

+ Dify Cloud では、ナレッジ検索の操作は契約プランに応じたレート制限が適用されます。詳細は[ナレッジリクエストレート制限](/ja/use-dify/knowledge/knowledge-request-rate-limit)を参照してください。

-

- Dify Cloudでは、知識検索の操作は契約プランに応じたレートリミットが適用されます。詳細は[ナレッジベースの要求頻度制限](/ja/use-dify/knowledge/knowledge-request-rate-limit)を参照してください。

-

+## ナレッジ検索ノードの設定

-## 設定

-

-知識検索ノードを正常に機能させるには、次の点を指定する必要があります:

+ナレッジ検索ノードを正しく機能させるには、以下を指定する必要があります:

- **何を**検索するか(クエリ)

@@ -39,98 +35,90 @@ icon: "database"

- **どのように**検索結果を処理するか(ノードレベルの検索設定)

-また、ドキュメントのメタデータを利用してフィルタベースの検索を有効化し、検索精度をさらに向上させることもできます。

+また、ドキュメントのメタデータを使用してフィルタベースの検索を有効にし、検索精度をさらに向上させることもできます。

### クエリの指定

-ノードが選択されたナレッジベースで検索するクエリ内容を指定します。

+選択したナレッジベースでノードが検索するクエリ内容を指定します。

-- **クエリテキスト**:テキスト変数を選択します。たとえば、Chatflowでは`userinput.query`を使用してユーザー入力を参照したり、ワークフローではカスタムのテキスト型ユーザー入力変数を使用したりできます。

+- **クエリテキスト**:テキスト変数を選択します。例えば、チャットフローでは `userinput.query` でユーザー入力を参照したり、ワークフローではカスタムのテキスト型ユーザー入力変数を使用したりできます。

-- **クエリ画像**:画像変数を選択します。例えば、ユーザー入力ノードを通じてユーザーがアップロードした画像を使用して画像検索を行います。画像サイズの上限は2 MBです。

+- **クエリ画像**:画像変数を選択します。例えば、ユーザー入力ノードを通じてユーザーがアップロードした画像を使用して画像検索を行います。画像サイズの上限は 2 MB です。

- セルフホスト環境では、環境変数`ATTACHMENT_IMAGE_FILE_SIZE_LIMIT`を変更することで画像サイズ上限を調整できます。

+ セルフホスト環境では、環境変数 `ATTACHMENT_IMAGE_FILE_SIZE_LIMIT` で画像サイズの上限を調整できます。

- **クエリ画像**オプションは、少なくとも1つのマルチモーダルナレッジベースが追加されている場合のみ利用できます。

+ **クエリ画像**オプションは、少なくとも1つのマルチモーダルナレッジベースが追加されている場合のみ利用可能です。

- そのようなナレッジベースには**Vision**アイコンが表示されており、マルチモーダル埋め込みモデルを使用していることを示しています。

+ そのようなナレッジベースには **Vision** タグが付いており、マルチモーダル埋め込みモデルを使用していることを示しています。

-### 検索対象ナレッジベースの選択

+### 検索対象のナレッジを選択

-ノードでクエリ内容に関連するコンテンツを検索するためのナレッジベースを1つ以上追加します。

+クエリに関連するコンテンツを検索するためのナレッジベースを1つ以上追加します。

-複数のナレッジベースを追加した場合、まずすべてのナレッジベースから同時に検索を行い、その後[ノードレベルの検索設定](#ノードレベルの検索設定)に従って結果を統合・処理します。

+複数のナレッジベースを追加した場合、まずすべてから同時に検索が行われ、その後[ノードレベルの検索設定](#ノードレベルの検索設定)に従って結果が統合・処理されます。

- **Vision**アイコンが付いたナレッジベースはクロスモーダル検索をサポートしており、セマンティックな関連性に基づいてテキストと画像の両方を検索できます。

+ **Vision** タグが付いたナレッジベースはクロスモーダル検索をサポートしており、セマンティックな関連性に基づいてテキストと画像の両方を検索できます。

-

- 追加したナレッジベースの横にある**編集**アイコンをクリックすると、知識検索ノード内で直接その設定を変更できます。

-

- これらの設定の詳細については、[ナレッジ設定の管理](/ja/use-dify/knowledge/manage-knowledge/introduction)をご覧ください。

-

+追加したナレッジベースの横にある**編集**アイコンをクリックすると、[設定](/ja/use-dify/knowledge/manage-knowledge/introduction)を変更できます。

### ノードレベルの検索設定

-ナレッジベースから取得した検索結果を、ノード内でどのように処理するかを微調整できます。

+ナレッジベースから取得された検索結果をノードでどのように処理するかを微調整します。

- 検索設定には2つのレイヤーがあります—ナレッジベースレベルと知識検索ノードレベルです。

-

- これらは2つの連続したフィルターと考えてください:ナレッジベースの設定が最初の結果プールを決定し、ノードの設定がさらに結果を再ランク付けまたは絞り込みます。

+ 検索設定には2つのレイヤーがあります——ナレッジベースレベルとナレッジ検索ノードレベルです。

+

+ 2つの連続したフィルターと考えてください:ナレッジベースの設定が最初の結果プールを決定し、ノードの設定がさらに結果を再ランク付けまたは絞り込みます。

-- **Rerank設定**

+- **Rerank 設定**

- - **ウェイト設定**:再ランク付け時におけるセマンティック類似度とキーワード一致の相対的な比重です。セマンティックの比重を高くすると意味的関連性を重視し、キーワードの比重を高くすると正確な一致を重視します。

+ - **加重スコア**:再ランク付け時のセマンティック類似度とキーワード一致の相対的な重み。セマンティックの重みを高くすると意味的な関連性が優先され、キーワードの重みを高くすると完全一致が優先されます。

- **ウェイト設定**は、追加したナレッジベースがすべて高品質タイプである場合のみ利用できます。

+ **加重スコア**は、追加されたすべてのナレッジベースが高品質タイプの場合にのみ利用可能です。

- - **Rerankモデル**:クエリとの関連度に基づいてすべての結果を再スコアリング・並べ替えするRerankモデルです。

+ - **Rerank モデル**:クエリとの関連度に基づいてすべての結果を再スコアリング・並べ替えする Rerank モデルです。

-

- マルチモーダルナレッジベースが追加されている場合は、マルチモーダルRerankモデル(**Vision**アイコン付き)も選択してください。そうでない場合、検索された画像は再ランク付けおよび最終出力から除外されます。

-

+

+ マルチモーダルナレッジベースが追加されている場合は、マルチモーダル Rerank モデル(**Vision** タグ付き)も選択してください。そうでないと、検索された画像が再ランク付けと最終出力から除外されます。

+

-- **トップK**:再ランク後に返す結果の最大件数です。Rerankモデルを選択している場合、この値はモデルの最大入力容量(モデルが一度に処理できるテキスト量)に基づいて自動的に調整されます。

+- **トップ K**:再ランク付け後に返す上位結果の最大数。Rerank モデルを選択している場合、この値はモデルの最大入力容量(一度に処理可能なテキスト量)に基づいて自動調整されます。

-- **スコア閾値**:返される結果の最低類似度スコアです。この閾値未満の結果は除外されます。高めに設定すると関連性の厳密な検索が行われ、低めにするとより広範なマッチを含めることができます。

+- **スコア閾値**:返される結果の最低類似度スコア。この閾値未満の結果は除外されます。高めの閾値は厳密な関連性を、低めの閾値はより広範なマッチを含めます。

-### メタデータフィルタの有効化

+### メタデータフィルタリングの有効化

-既存のドキュメントメタデータを使用して、ナレッジベース内の特定のドキュメントに検索を制限し、検索精度を向上させます。

+既存の[ドキュメントメタデータ](/ja/use-dify/knowledge/metadata)を使用して、ナレッジベース内の特定のドキュメントに検索を制限し、検索精度を向上させます。

-メタデータフィルタを有効にすると、知識検索ノードはナレッジベース全体を検索するのではなく、指定されたメタデータ条件に一致するドキュメントのみを検索します。これは、大規模で多様なナレッジベースでのターゲット検索に特に有用です。

-

-

- ドキュメントメタデータの作成と管理については、[メタデータ](/ja/use-dify/knowledge/metadata)を参照してください。

-

+メタデータフィルタリングを有効にすると、ナレッジ検索ノードはナレッジベース全体ではなく、指定されたメタデータ条件に一致するドキュメントのみを検索します。大規模で多様なナレッジベースでの絞り込み検索に特に有用です。

## 出力

-知識検索ノードの出力は`result`という変数として返されます。この変数は検索されたドキュメントチャンクの配列で、各チャンクにはコンテンツ、メタデータ、タイトル、その他の属性が含まれます。

+ナレッジ検索ノードは `result` という名前の変数として検索結果を出力します。これはドキュメントチャンクの配列で、各チャンクにはコンテンツ、メタデータ、タイトル、その他の属性が含まれます。

-検索結果に画像添付が含まれる場合、`result`変数には画像メタデータを含む`files`というフィールドも含まれます。

+検索結果に画像添付が含まれる場合、`result` 変数には画像の詳細を含む `files` フィールドも含まれます。

-## LLMノードとの連携

+## LLM ノードとの連携

-LLMノードでユーザーの質問に回答するためのコンテキストとして検索結果を使用するには:

+LLM ノードで検索結果をコンテキストとして使用するには:

-1. **コンテキスト**フィールドで、知識検索ノードの`result`変数を選択します。

+1. **高度な設定** > **コンテキスト**で、ナレッジ検索ノードの `result` 変数を選択します。

-2. プロンプトフィールドで、`Context`変数とユーザー入力変数(例:Chatflowの`userinput.query`)の両方を参照します。

+2. システム指示で `Context` 変数を参照します。

-3. (任意)LLMがVision機能に対応している場合(**Vision**アイコン付き)、**Vision**を有効にして検索された画像を解釈させることができます。

+3. 省略可:LLM が Vision 対応の場合、**Vision** を有効にして検索結果内の画像添付を処理させます。

- **Vision**を有効にすると、LLMは検索された画像を自動的に処理します。**Vision**入力フィールドで`Context`変数を再度手動で参照する必要はありません。

+ 検索結果を Vision の入力として指定する必要はありません。**Vision** を有効にすると、LLM は検索された画像を自動的に処理します。

-

-

-

-### 実行制御

-

-**最大反復数**は、無限ループを防ぐための安全制限を設定します。タスクの複雑さに基づいて設定してください - 単純なタスクには3-5回の反復が必要ですが、複雑な調査には10-15回必要な場合があります。

-

-**メモリ**は、TokenBufferMemoryを使用してエージェントが記憶する過去のメッセージ数を制御します。より大きなメモリウィンドウはより多くのコンテキストを提供しますが、トークンコストが増加します。これにより、ユーザーが以前のアクションを参照できる会話の継続性が可能になります。

-

-### ツールパラメータ自動生成

-

-ツールには**自動生成**または**手動入力**として設定されたパラメータがあります。自動生成パラメータ(`auto: false`)はエージェントによって自動的に設定され、手動入力パラメータはツールの永続的な設定の一部となる明示的な値が必要です。

-

-

-

-## 出力変数

-

-エージェントノードは以下を含む包括的な出力を提供します:

-

-**最終回答** - クエリに対するエージェントの最終的な応答

-

-**ツール出力** - 実行中の各ツール呼び出しからの結果

-

-**推論トレース** - JSON出力で利用可能なステップバイステップの決定プロセス(特に推論と行動戦略で詳細)

-

-**反復回数** - 使用された推論サイクルの数

-

-**成功ステータス** - エージェントがタスクを正常に完了したかどうか

-

-**エージェントログ** - ツール呼び出しのデバッグと監視のためのメタデータを含む構造化されたログイベント

-

-## 使用例

-

-**調査と分析** - エージェントは複数のソースを自律的に検索し、情報を統合し、包括的。

-

-**トラブルシューティング** - エージェントが情報を収集し、仮説をテストし、発見に基づいてアプローチを適応させる必要がある診断タスク。

-

-**マルチステップデータ処理** - 次のアクションが中間結果に依存する複雑なワークフロー。

-

-**動的API統合** - API呼び出しの順序が事前に決定できない応答と条件に依存するシナリオ。

-

-## ベストプラクティス

-

-**明確なツール説明**は、エージェントが各ツールをいつどのように効果的に使用するかを理解するのに役立ちます。

-

-**適切な反復制限**は、複雑なタスクに対して十分な柔軟性を確保しながら、暴走コストを防ぎます。

-

-**詳細な指示**は、エージェントの役割、目標、制約や好みについてのコンテキストを提供します。

-

-**メモリ管理**は、使用例の要件に基づいて、コンテキスト保持とトークン効率のバランスを取ります。

diff --git a/ja/use-dify/nodes/command.mdx b/ja/use-dify/nodes/command.mdx

new file mode 100644

index 00000000..8ee66361

--- /dev/null

+++ b/ja/use-dify/nodes/command.mdx

@@ -0,0 +1,15 @@

+---

+title: コマンド実行

+description: ワークフロー内でシェルコマンドを直接実行

+icon: "rectangle-terminal"

+---

+

+ ⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/command)を参照してください。

+

+

+ このノードはサンドボックスランタイムを使用するアプリケーションでのみ利用可能です。

+

+

+Agent ノードはコマンドラインを自律的に実行できますが、実行するコマンドが明確で LLM の推論が不要な場合は、コマンド実行ノードの方が適しています。より高速で、トークンを消費しません。

+

+コマンドはデフォルトでルートディレクトリで実行されます。別の作業ディレクトリを使用するには、既存のパスまたは実行中に上流ノードによって作成されるパスを入力してください。

diff --git a/ja/use-dify/nodes/knowledge-retrieval.mdx b/ja/use-dify/nodes/knowledge-retrieval.mdx

index 3c73bd49..6b702f27 100644

--- a/ja/use-dify/nodes/knowledge-retrieval.mdx

+++ b/ja/use-dify/nodes/knowledge-retrieval.mdx

@@ -1,37 +1,33 @@

---

-title: 知識検索

+title: ナレッジ検索

icon: "database"

---

⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/knowledge-retrieval)を参照してください。

-## はじめに

+ナレッジ検索ノードを使用して、既存のナレッジベースをワークフローに統合します。このノードは特定のナレッジからクエリに関連する情報を検索し、下流ノード(LLM など)で使用するコンテキスト情報として結果を出力します。

-知識検索ノードを使用すると、既存のナレッジベースをChatflowやワークフローに統合できます。このノードは指定されたナレッジからクエリに関連する情報を検索し、その結果を下流ノード(例:LLM)で利用できるコンテキスト情報として出力します。

+以下はチャットフローでナレッジ検索ノードを使用する例です:

-以下はChatflowにおける知識検索ノードの利用例です:

+1. **ユーザー入力**ノードがユーザーのクエリを収集します。

-1. **ユーザー入力** ノードがユーザーの質問を収集します。

+2. **ナレッジ検索**ノードが選択されたナレッジベースからユーザーのクエリに関連するコンテンツを検索し、結果を出力します。

-2. **知識検索** ノードが選択されたナレッジベースからユーザーの質問に関連するコンテンツを検索し、検索結果を出力します。

+3. **LLM** ノードがユーザーのクエリと検索されたナレッジの両方に基づいてレスポンスを生成します。

-3. **LLM** ノードがユーザーの質問と検索されたナレッジの両方をもとに回答を生成します。

+4. **回答**ノードが LLM のレスポンスをユーザーに返します。

-4. **回答** ノードがLLMの応答をユーザーへ返します。

+

-

+ナレッジ検索ノードを使用する前に、少なくとも1つの利用可能なナレッジベースがあることを確認してください。ナレッジベースの作成方法については、[ナレッジ](/ja/use-dify/knowledge/readme#ナレッジの作成)を参照してください。

- 知識検索ノードを使用する前に、少なくとも1つのナレッジベースが利用可能であることを確認してください。ナレッジベースの作成方法については、[ナレッジ](/ja/use-dify/knowledge/readme#ナレッジの作成)を参照してください。

+ Dify Cloud では、ナレッジ検索の操作は契約プランに応じたレート制限が適用されます。詳細は[ナレッジリクエストレート制限](/ja/use-dify/knowledge/knowledge-request-rate-limit)を参照してください。

-

- Dify Cloudでは、知識検索の操作は契約プランに応じたレートリミットが適用されます。詳細は[ナレッジベースの要求頻度制限](/ja/use-dify/knowledge/knowledge-request-rate-limit)を参照してください。

-

+## ナレッジ検索ノードの設定

-## 設定

-

-知識検索ノードを正常に機能させるには、次の点を指定する必要があります:

+ナレッジ検索ノードを正しく機能させるには、以下を指定する必要があります:

- **何を**検索するか(クエリ)

@@ -39,98 +35,90 @@ icon: "database"

- **どのように**検索結果を処理するか(ノードレベルの検索設定)

-また、ドキュメントのメタデータを利用してフィルタベースの検索を有効化し、検索精度をさらに向上させることもできます。

+また、ドキュメントのメタデータを使用してフィルタベースの検索を有効にし、検索精度をさらに向上させることもできます。

### クエリの指定

-ノードが選択されたナレッジベースで検索するクエリ内容を指定します。

+選択したナレッジベースでノードが検索するクエリ内容を指定します。

-- **クエリテキスト**:テキスト変数を選択します。たとえば、Chatflowでは`userinput.query`を使用してユーザー入力を参照したり、ワークフローではカスタムのテキスト型ユーザー入力変数を使用したりできます。

+- **クエリテキスト**:テキスト変数を選択します。例えば、チャットフローでは `userinput.query` でユーザー入力を参照したり、ワークフローではカスタムのテキスト型ユーザー入力変数を使用したりできます。

-- **クエリ画像**:画像変数を選択します。例えば、ユーザー入力ノードを通じてユーザーがアップロードした画像を使用して画像検索を行います。画像サイズの上限は2 MBです。

+- **クエリ画像**:画像変数を選択します。例えば、ユーザー入力ノードを通じてユーザーがアップロードした画像を使用して画像検索を行います。画像サイズの上限は 2 MB です。

- セルフホスト環境では、環境変数`ATTACHMENT_IMAGE_FILE_SIZE_LIMIT`を変更することで画像サイズ上限を調整できます。

+ セルフホスト環境では、環境変数 `ATTACHMENT_IMAGE_FILE_SIZE_LIMIT` で画像サイズの上限を調整できます。

- **クエリ画像**オプションは、少なくとも1つのマルチモーダルナレッジベースが追加されている場合のみ利用できます。

+ **クエリ画像**オプションは、少なくとも1つのマルチモーダルナレッジベースが追加されている場合のみ利用可能です。

- そのようなナレッジベースには**Vision**アイコンが表示されており、マルチモーダル埋め込みモデルを使用していることを示しています。

+ そのようなナレッジベースには **Vision** タグが付いており、マルチモーダル埋め込みモデルを使用していることを示しています。

-### 検索対象ナレッジベースの選択

+### 検索対象のナレッジを選択

-ノードでクエリ内容に関連するコンテンツを検索するためのナレッジベースを1つ以上追加します。

+クエリに関連するコンテンツを検索するためのナレッジベースを1つ以上追加します。

-複数のナレッジベースを追加した場合、まずすべてのナレッジベースから同時に検索を行い、その後[ノードレベルの検索設定](#ノードレベルの検索設定)に従って結果を統合・処理します。

+複数のナレッジベースを追加した場合、まずすべてから同時に検索が行われ、その後[ノードレベルの検索設定](#ノードレベルの検索設定)に従って結果が統合・処理されます。

- **Vision**アイコンが付いたナレッジベースはクロスモーダル検索をサポートしており、セマンティックな関連性に基づいてテキストと画像の両方を検索できます。

+ **Vision** タグが付いたナレッジベースはクロスモーダル検索をサポートしており、セマンティックな関連性に基づいてテキストと画像の両方を検索できます。

-

- 追加したナレッジベースの横にある**編集**アイコンをクリックすると、知識検索ノード内で直接その設定を変更できます。

-

- これらの設定の詳細については、[ナレッジ設定の管理](/ja/use-dify/knowledge/manage-knowledge/introduction)をご覧ください。

-

+追加したナレッジベースの横にある**編集**アイコンをクリックすると、[設定](/ja/use-dify/knowledge/manage-knowledge/introduction)を変更できます。

### ノードレベルの検索設定

-ナレッジベースから取得した検索結果を、ノード内でどのように処理するかを微調整できます。

+ナレッジベースから取得された検索結果をノードでどのように処理するかを微調整します。

- 検索設定には2つのレイヤーがあります—ナレッジベースレベルと知識検索ノードレベルです。

-

- これらは2つの連続したフィルターと考えてください:ナレッジベースの設定が最初の結果プールを決定し、ノードの設定がさらに結果を再ランク付けまたは絞り込みます。

+ 検索設定には2つのレイヤーがあります——ナレッジベースレベルとナレッジ検索ノードレベルです。

+

+ 2つの連続したフィルターと考えてください:ナレッジベースの設定が最初の結果プールを決定し、ノードの設定がさらに結果を再ランク付けまたは絞り込みます。

-- **Rerank設定**

+- **Rerank 設定**

- - **ウェイト設定**:再ランク付け時におけるセマンティック類似度とキーワード一致の相対的な比重です。セマンティックの比重を高くすると意味的関連性を重視し、キーワードの比重を高くすると正確な一致を重視します。

+ - **加重スコア**:再ランク付け時のセマンティック類似度とキーワード一致の相対的な重み。セマンティックの重みを高くすると意味的な関連性が優先され、キーワードの重みを高くすると完全一致が優先されます。

- **ウェイト設定**は、追加したナレッジベースがすべて高品質タイプである場合のみ利用できます。

+ **加重スコア**は、追加されたすべてのナレッジベースが高品質タイプの場合にのみ利用可能です。

- - **Rerankモデル**:クエリとの関連度に基づいてすべての結果を再スコアリング・並べ替えするRerankモデルです。

+ - **Rerank モデル**:クエリとの関連度に基づいてすべての結果を再スコアリング・並べ替えする Rerank モデルです。

-

- マルチモーダルナレッジベースが追加されている場合は、マルチモーダルRerankモデル(**Vision**アイコン付き)も選択してください。そうでない場合、検索された画像は再ランク付けおよび最終出力から除外されます。

-

+

+ マルチモーダルナレッジベースが追加されている場合は、マルチモーダル Rerank モデル(**Vision** タグ付き)も選択してください。そうでないと、検索された画像が再ランク付けと最終出力から除外されます。

+

-- **トップK**:再ランク後に返す結果の最大件数です。Rerankモデルを選択している場合、この値はモデルの最大入力容量(モデルが一度に処理できるテキスト量)に基づいて自動的に調整されます。

+- **トップ K**:再ランク付け後に返す上位結果の最大数。Rerank モデルを選択している場合、この値はモデルの最大入力容量(一度に処理可能なテキスト量)に基づいて自動調整されます。

-- **スコア閾値**:返される結果の最低類似度スコアです。この閾値未満の結果は除外されます。高めに設定すると関連性の厳密な検索が行われ、低めにするとより広範なマッチを含めることができます。

+- **スコア閾値**:返される結果の最低類似度スコア。この閾値未満の結果は除外されます。高めの閾値は厳密な関連性を、低めの閾値はより広範なマッチを含めます。

-### メタデータフィルタの有効化

+### メタデータフィルタリングの有効化

-既存のドキュメントメタデータを使用して、ナレッジベース内の特定のドキュメントに検索を制限し、検索精度を向上させます。

+既存の[ドキュメントメタデータ](/ja/use-dify/knowledge/metadata)を使用して、ナレッジベース内の特定のドキュメントに検索を制限し、検索精度を向上させます。

-メタデータフィルタを有効にすると、知識検索ノードはナレッジベース全体を検索するのではなく、指定されたメタデータ条件に一致するドキュメントのみを検索します。これは、大規模で多様なナレッジベースでのターゲット検索に特に有用です。

-

-

- ドキュメントメタデータの作成と管理については、[メタデータ](/ja/use-dify/knowledge/metadata)を参照してください。

-

+メタデータフィルタリングを有効にすると、ナレッジ検索ノードはナレッジベース全体ではなく、指定されたメタデータ条件に一致するドキュメントのみを検索します。大規模で多様なナレッジベースでの絞り込み検索に特に有用です。

## 出力

-知識検索ノードの出力は`result`という変数として返されます。この変数は検索されたドキュメントチャンクの配列で、各チャンクにはコンテンツ、メタデータ、タイトル、その他の属性が含まれます。

+ナレッジ検索ノードは `result` という名前の変数として検索結果を出力します。これはドキュメントチャンクの配列で、各チャンクにはコンテンツ、メタデータ、タイトル、その他の属性が含まれます。

-検索結果に画像添付が含まれる場合、`result`変数には画像メタデータを含む`files`というフィールドも含まれます。

+検索結果に画像添付が含まれる場合、`result` 変数には画像の詳細を含む `files` フィールドも含まれます。

-## LLMノードとの連携

+## LLM ノードとの連携

-LLMノードでユーザーの質問に回答するためのコンテキストとして検索結果を使用するには:

+LLM ノードで検索結果をコンテキストとして使用するには:

-1. **コンテキスト**フィールドで、知識検索ノードの`result`変数を選択します。

+1. **高度な設定** > **コンテキスト**で、ナレッジ検索ノードの `result` 変数を選択します。

-2. プロンプトフィールドで、`Context`変数とユーザー入力変数(例:Chatflowの`userinput.query`)の両方を参照します。

+2. システム指示で `Context` 変数を参照します。

-3. (任意)LLMがVision機能に対応している場合(**Vision**アイコン付き)、**Vision**を有効にして検索された画像を解釈させることができます。

+3. 省略可:LLM が Vision 対応の場合、**Vision** を有効にして検索結果内の画像添付を処理させます。

- **Vision**を有効にすると、LLMは検索された画像を自動的に処理します。**Vision**入力フィールドで`Context`変数を再度手動で参照する必要はありません。

+ 検索結果を Vision の入力として指定する必要はありません。**Vision** を有効にすると、LLM は検索された画像を自動的に処理します。

- +チャットフローでは、ナレッジを参照したレスポンスの横に引用がデフォルトで表示されます。キャンバス右上の**機能**で**引用と帰属**をオフにすることで無効にできます。

diff --git a/ja/use-dify/nodes/llm.mdx b/ja/use-dify/nodes/llm.mdx

index 5b00f589..d2c839e4 100644

--- a/ja/use-dify/nodes/llm.mdx

+++ b/ja/use-dify/nodes/llm.mdx

@@ -1,131 +1,219 @@

---

title: "LLM"

-description: "テキスト生成と分析のための言語モデルを起動"

+description: "大規模言語モデルを呼び出し、テキスト生成・分析、ツールによる複雑なタスクの実行を行う"

icon: "brain"

---

⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/llm)を参照してください。

-LLMノードは大規模言語モデルを呼び出してテキスト、画像、ドキュメントを処理します。設定されたモデルにプロンプトを送信し、その応答を取得します。構造化出力、コンテキスト管理、マルチモーダル入力をサポートしています。

+LLM ノードは大規模言語モデルを呼び出し、指示と上流ノードからの入力に基づいてレスポンスを生成します。

-

-

+チャットフローでは、ナレッジを参照したレスポンスの横に引用がデフォルトで表示されます。キャンバス右上の**機能**で**引用と帰属**をオフにすることで無効にできます。

diff --git a/ja/use-dify/nodes/llm.mdx b/ja/use-dify/nodes/llm.mdx

index 5b00f589..d2c839e4 100644

--- a/ja/use-dify/nodes/llm.mdx

+++ b/ja/use-dify/nodes/llm.mdx

@@ -1,131 +1,219 @@

---

title: "LLM"

-description: "テキスト生成と分析のための言語モデルを起動"

+description: "大規模言語モデルを呼び出し、テキスト生成・分析、ツールによる複雑なタスクの実行を行う"

icon: "brain"

---

⚠️ このドキュメントはAIによって自動翻訳されています。不正確な部分がある場合は、[英語版](/en/use-dify/nodes/llm)を参照してください。

-LLMノードは大規模言語モデルを呼び出してテキスト、画像、ドキュメントを処理します。設定されたモデルにプロンプトを送信し、その応答を取得します。構造化出力、コンテキスト管理、マルチモーダル入力をサポートしています。

+LLM ノードは大規模言語モデルを呼び出し、指示と上流ノードからの入力に基づいてレスポンスを生成します。

-

-  -

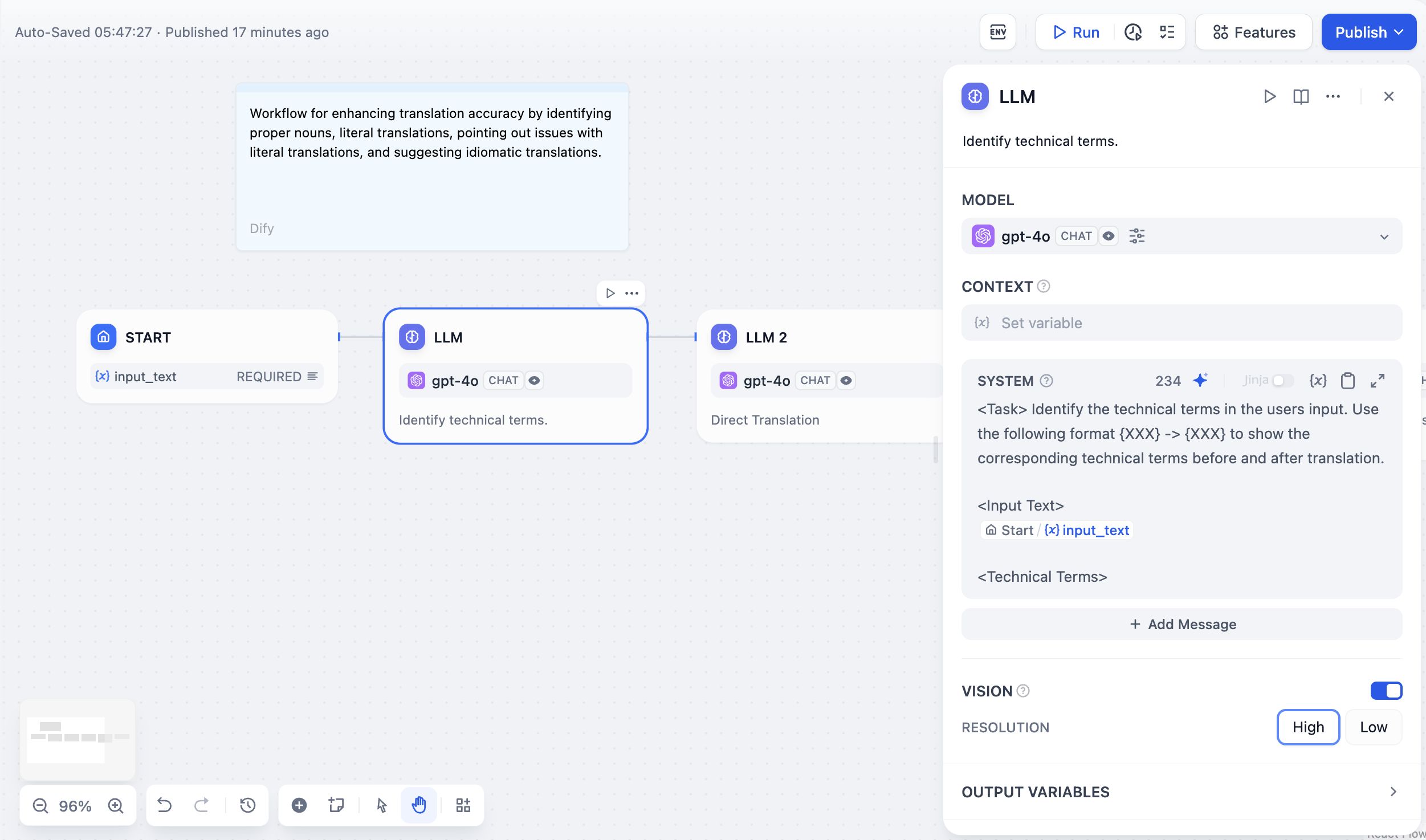

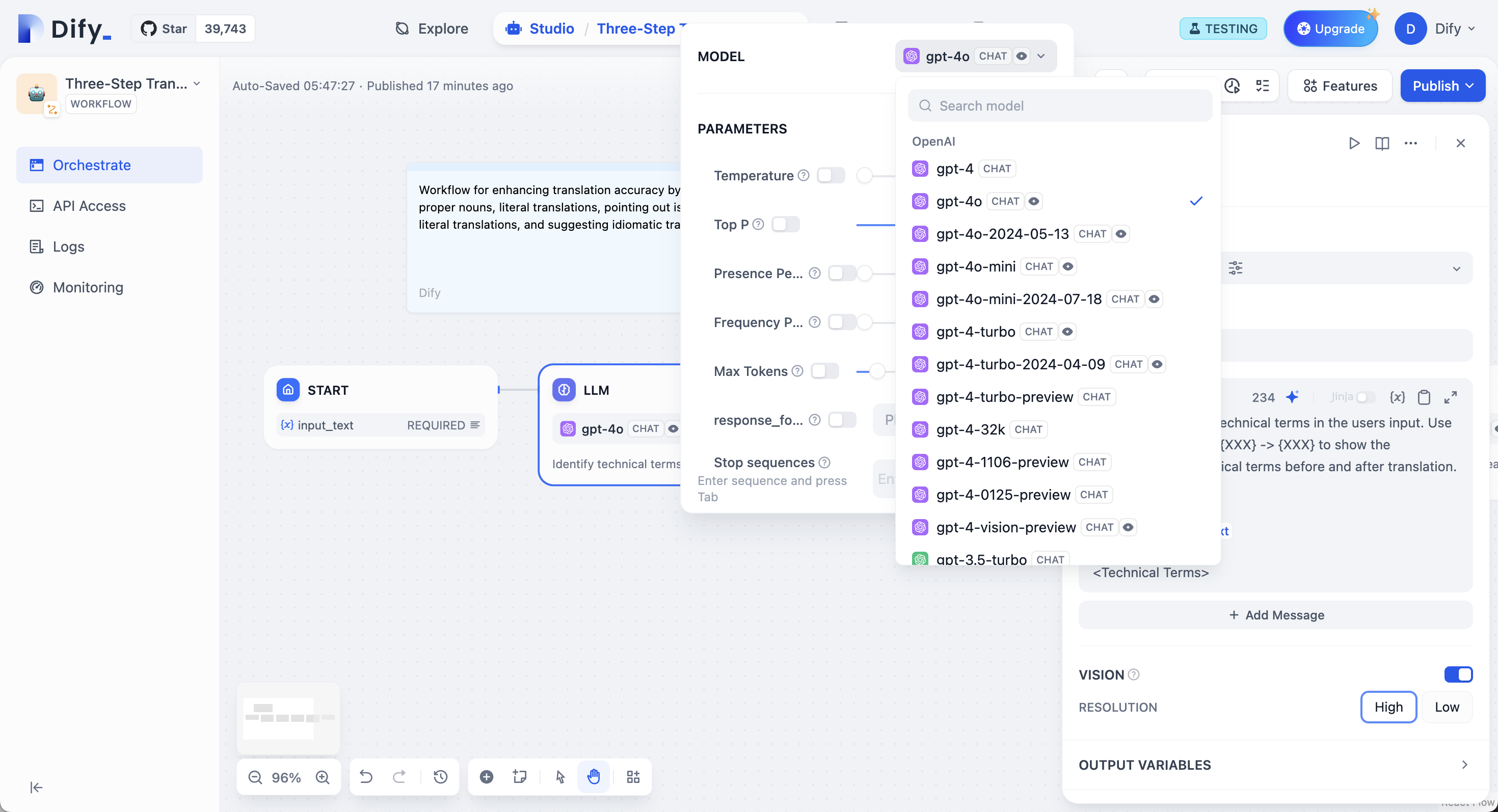

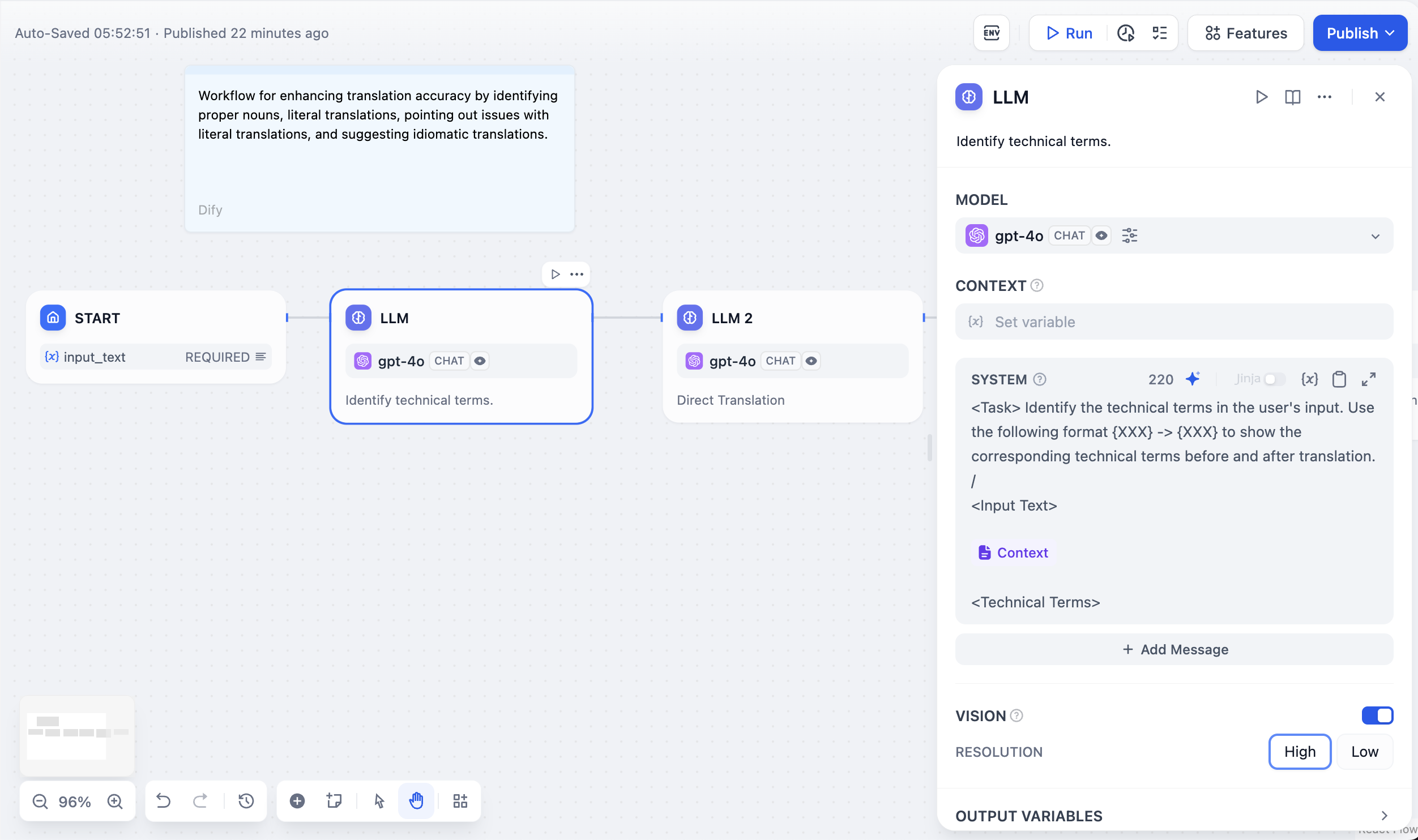

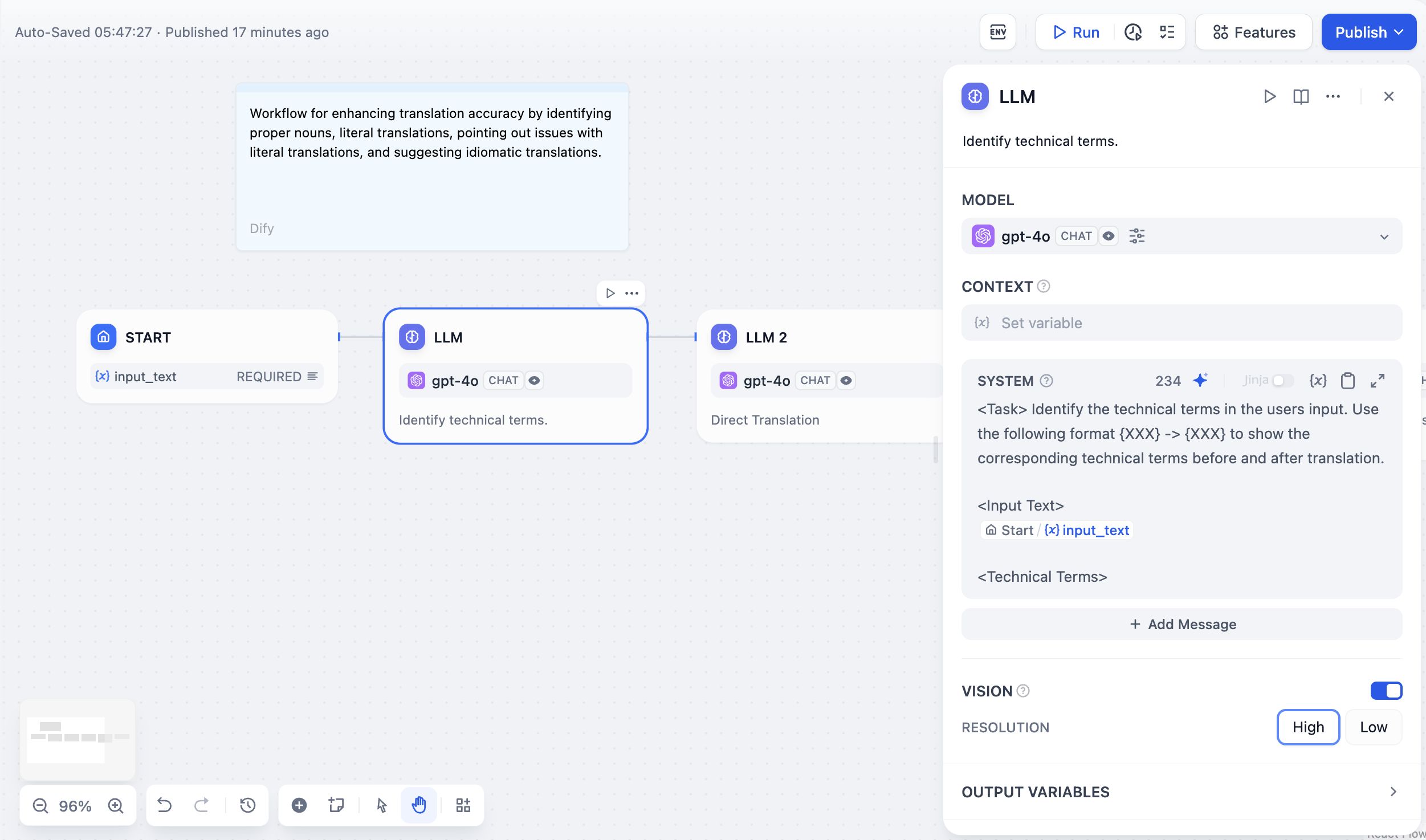

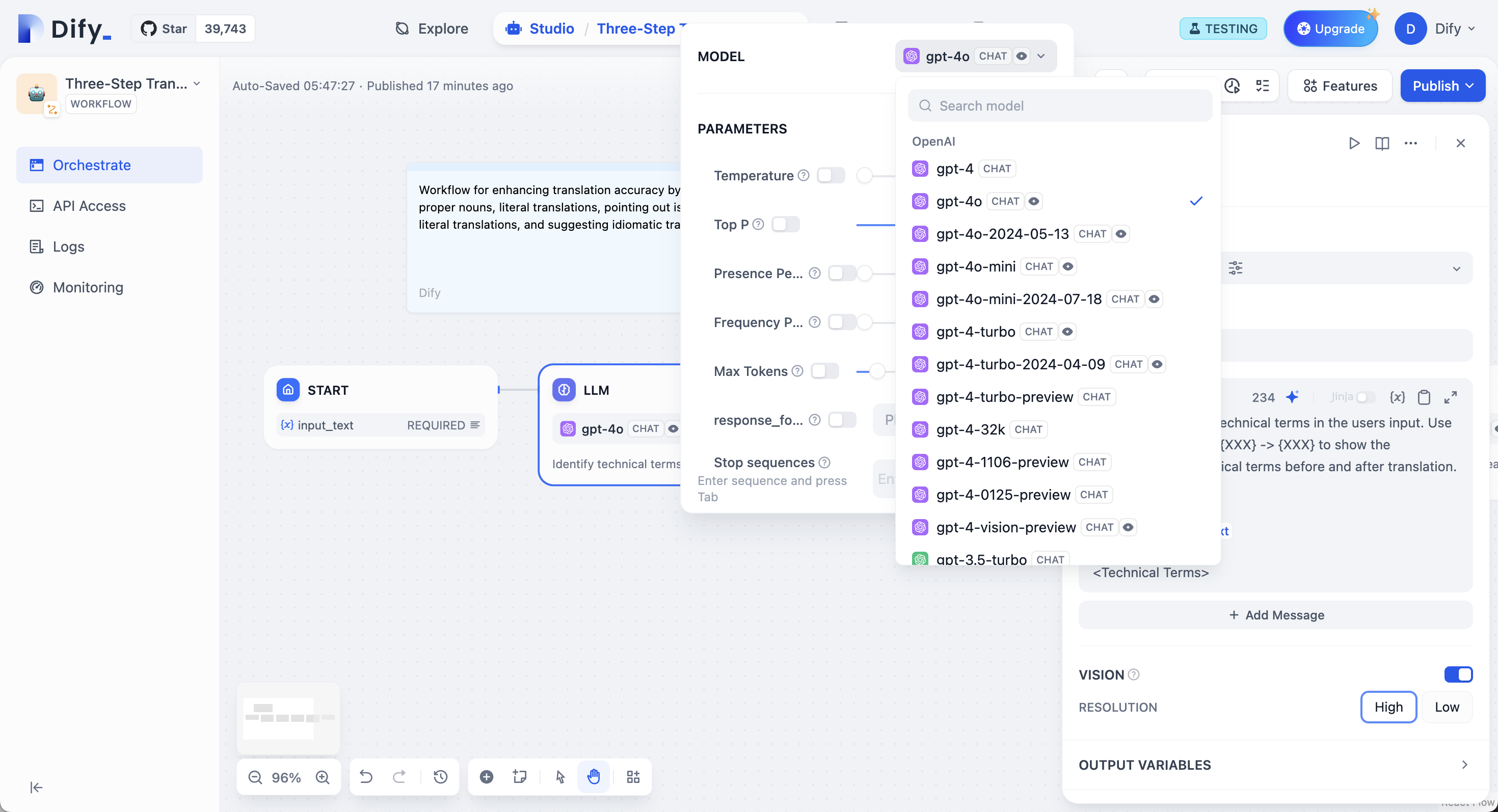

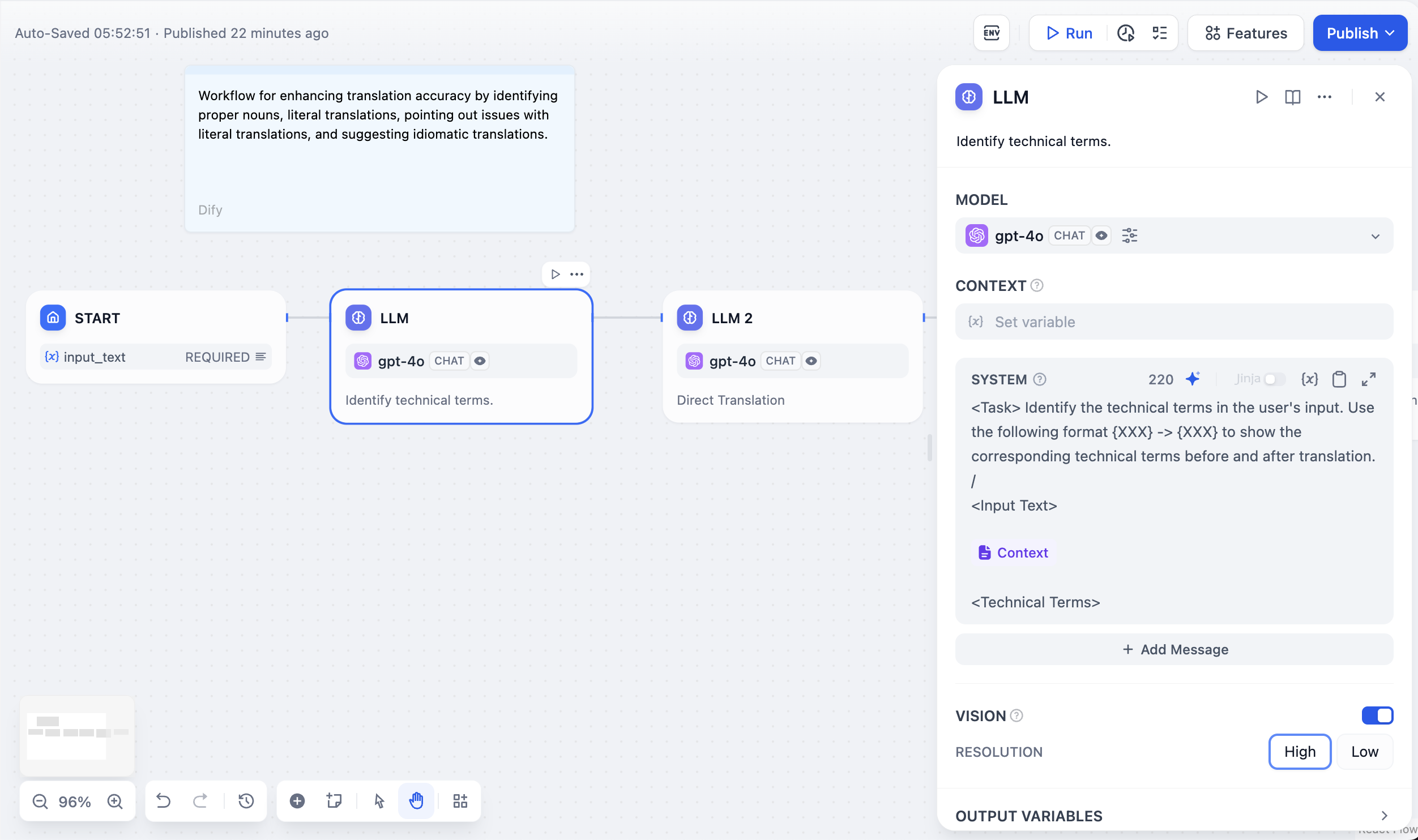

+## モデルの選択

+

+設定済みのプロバイダーからタスクに最適なモデルを選択します。

+

+選択後、モデルパラメータを調整してレスポンスの生成方法を制御できます。利用可能なパラメータとプリセットはモデルによって異なります。

+

+## プロンプトの作成

+

+モデルに入力の処理方法とレスポンスの生成方法を指示します。`/` または `{` を入力して変数を参照できます。

+

+どこから始めればよいかわからない場合や、既存のプロンプトを改善したい場合は、AI アシスト付きプロンプトジェネレーターをお試しください。

+

+

+

+

-

+## モデルの選択

+

+設定済みのプロバイダーからタスクに最適なモデルを選択します。

+

+選択後、モデルパラメータを調整してレスポンスの生成方法を制御できます。利用可能なパラメータとプリセットはモデルによって異なります。

+

+## プロンプトの作成

+

+モデルに入力の処理方法とレスポンスの生成方法を指示します。`/` または `{` を入力して変数を参照できます。

+

+どこから始めればよいかわからない場合や、既存のプロンプトを改善したい場合は、AI アシスト付きプロンプトジェネレーターをお試しください。

+

+

+

+  +

+

+

+

+

+  +

+

+

+### 指示とメッセージの指定

+

+システム指示を定義し、**メッセージを追加**をクリックしてユーザー/アシスタントメッセージを追加します。すべて順番にプロンプトとしてモデルに送信されます。

+

+モデルと直接会話するイメージです:

+

+- **システム指示**はモデルのレスポンスルールを設定します——役割、トーン、行動ガイドライン。

+

+- **ユーザーメッセージ**はモデルに送信する内容——質問、リクエスト、タスク。

+

+- **アシスタントメッセージ**はモデルのレスポンスです。

+

+### 入力とルールの分離

+

+システム指示で役割とルールを定義し、ユーザーメッセージで実際のタスク入力を渡します。例:

+

+```bash wrap

+# システム指示

+あなたは子ども向けの物語作家です。ユーザーの入力に基づいて物語を書いてください。簡単な言葉と温かいトーンを使ってください。

+

+# ユーザーメッセージ

+ウサギと恥ずかしがり屋のハリネズミが友達になる、おやすみ前のお話を書いてください。

+```

+

+すべてをシステム指示にまとめる方が簡単に見えるかもしれませんが、役割定義とタスク入力を分離することで、モデルにとってより明確な構造になります。

+

+### 対話履歴のシミュレーション

+

+アシスタントメッセージがモデルのレスポンスなら、なぜ手動で追加するのか疑問に思うかもしれません。

+

+ユーザーメッセージとアシスタントメッセージを交互に追加することで、プロンプト内に対話履歴をシミュレーションできます。モデルはこれらを過去のやり取りとして扱い、動作の誘導に役立ちます。

+

+### 上流 LLM からの対話履歴のインポート

+

+**対話履歴の追加**をクリックして、上流の Agent または LLM ノードから対話履歴をインポートします。これによりモデルは上流で何が起こったかを把握し、そのノードが中断したところから続けることができます。

+

+対話履歴には**ユーザー**メッセージ、**アシスタント**メッセージ、**ツール**メッセージが含まれます。Agent または LLM ノードの `context` 出力変数で確認できます。

- LLMノードを使用する前に、**システム設定 → モデルプロバイダー**で少なくとも1つのモデルプロバイダーを設定してください。

+ システム指示はノード固有のため含まれません。

-## モデル選択とパラメータ

+複数の Agent または LLM ノードを連結する場合に有用です:

-設定したモデルプロバイダーから任意のモデルを選択できます。異なるモデルはそれぞれ異なるタスクに適しています。GPT-4とClaude 3.5は複雑な推論を得意としますがコストが高く、GPT-3.5 Turboは機能と価格のバランスが取れています。ローカル展開には、Ollama、LocalAI、Xinferenceを使用してください。

+- 対話履歴をインポートしない場合、下流ノードは上流ノードの最終出力のみを受け取り、それがどのように導き出されたかはわかりません。

-

-

+

+

+

+### 指示とメッセージの指定

+

+システム指示を定義し、**メッセージを追加**をクリックしてユーザー/アシスタントメッセージを追加します。すべて順番にプロンプトとしてモデルに送信されます。

+

+モデルと直接会話するイメージです:

+

+- **システム指示**はモデルのレスポンスルールを設定します——役割、トーン、行動ガイドライン。

+

+- **ユーザーメッセージ**はモデルに送信する内容——質問、リクエスト、タスク。

+

+- **アシスタントメッセージ**はモデルのレスポンスです。

+

+### 入力とルールの分離

+

+システム指示で役割とルールを定義し、ユーザーメッセージで実際のタスク入力を渡します。例:

+

+```bash wrap

+# システム指示

+あなたは子ども向けの物語作家です。ユーザーの入力に基づいて物語を書いてください。簡単な言葉と温かいトーンを使ってください。

+

+# ユーザーメッセージ

+ウサギと恥ずかしがり屋のハリネズミが友達になる、おやすみ前のお話を書いてください。

+```

+

+すべてをシステム指示にまとめる方が簡単に見えるかもしれませんが、役割定義とタスク入力を分離することで、モデルにとってより明確な構造になります。

+

+### 対話履歴のシミュレーション

+

+アシスタントメッセージがモデルのレスポンスなら、なぜ手動で追加するのか疑問に思うかもしれません。

+

+ユーザーメッセージとアシスタントメッセージを交互に追加することで、プロンプト内に対話履歴をシミュレーションできます。モデルはこれらを過去のやり取りとして扱い、動作の誘導に役立ちます。

+

+### 上流 LLM からの対話履歴のインポート

+

+**対話履歴の追加**をクリックして、上流の Agent または LLM ノードから対話履歴をインポートします。これによりモデルは上流で何が起こったかを把握し、そのノードが中断したところから続けることができます。

+

+対話履歴には**ユーザー**メッセージ、**アシスタント**メッセージ、**ツール**メッセージが含まれます。Agent または LLM ノードの `context` 出力変数で確認できます。

- LLMノードを使用する前に、**システム設定 → モデルプロバイダー**で少なくとも1つのモデルプロバイダーを設定してください。

+ システム指示はノード固有のため含まれません。

-## モデル選択とパラメータ

+複数の Agent または LLM ノードを連結する場合に有用です:

-設定したモデルプロバイダーから任意のモデルを選択できます。異なるモデルはそれぞれ異なるタスクに適しています。GPT-4とClaude 3.5は複雑な推論を得意としますがコストが高く、GPT-3.5 Turboは機能と価格のバランスが取れています。ローカル展開には、Ollama、LocalAI、Xinferenceを使用してください。

+- 対話履歴をインポートしない場合、下流ノードは上流ノードの最終出力のみを受け取り、それがどのように導き出されたかはわかりません。

-

-  -

+- 対話履歴をインポートすると、プロセス全体が見えます:ユーザーが何を質問したか、どのツールが呼び出されたか、どのような結果が返されたか、モデルがどのように推論したか。

-モデルパラメータは応答生成を制御します。**温度**は0(決定的)から1(創造的)の範囲です。**Top P**は確率によって単語選択を制限します。**頻度ペナルティ**は繰り返しを減らします。**存在ペナルティ**は新しいトピックを促進します。プリセットも使用できます:**精密**、**バランス**、**創造的**。

+**自動追加されるユーザーメッセージで新しいタスクを指定してください。** インポートされた履歴は現在のノードのメッセージの前に追加されるため、モデルはこれを1つの連続した会話として認識します。インポートされた履歴は通常アシスタントメッセージで終わるため、モデルは次に何をすべきかを知るためのフォローアップユーザーメッセージが必要です。

-## プロンプト設定

+

-インターフェースはモデルタイプに基づいて適応します。チャットモデルではメッセージロール(**システム**は動作用、**ユーザー**は入力用、**アシスタント**は例用)を使用し、補完モデルでは単純なテキスト継続を使用します。

+ 2つの LLM ノードが順番に実行されるとします:LLM A は検索ツールを呼び出してトピックを調査し、LLM B は調査結果に基づいてレポートを作成します。

-プロンプト内でワークフロー変数を二重中括弧で参照します:`{{variable_name}}`。変数はモデルに到達する前に実際の値で置き換えられます。

+ LLM B が LLM A の最終テキスト出力のみを受け取る場合、結論を要約できますが、検証や具体的なソースの引用はできません。LLM A の対話履歴をインポートすることで、LLM B は各ツール呼び出しの生データを確認し、レポートで直接参照できます。

-```text

-System: あなたは技術文書の専門家です。

-User: {{user_input}}

+ LLM A の対話履歴インポート後に LLM B が受け取る完全なメッセージシーケンス:

+

+ ```bash wrap

+ # LLM B のシステム指示

+ 1. System: "あなたはプロフェッショナルなレポートライターです..."

+

+ # LLM A から

+ 2. User: "EV 市場の新しいトレンドは何ですか?"

+

+ # LLM A から

+ 3. Tool: [URL と生データを含む検索結果]

+

+ # LLM A から

+ 4. Assistant: "検索結果に基づくと、主なトレンドは..."

+

+ # LLM B のユーザーメッセージ

+ 5. User: "500語の市場分析レポートを作成してください。"

+ ```

+

+ LLM B は次のことを理解します:調査プロセス(質問、検索、要約)を見た上で、テキスト出力だけでは得られない生データを含め、その情報に基づいてレポートを作成する必要があるということです。

+

+

+

+### Jinja2 を使った動的プロンプトの作成

+

+[Jinja2](https://jinja.palletsprojects.com/en/stable/) 構文で動的プロンプトを作成できます。例えば、条件分岐を使って変数の値に応じた指示をカスタマイズできます。

+

+

+```jinja2 wrap

+あなたは

+{% if user_level == "beginner" %}忍耐強く親切な

+{% elif user_level == "intermediate" %}プロフェッショナルで効率的な

+{% else %}シニアエキスパートレベルの

+{% endif %} アシスタントです。

+

+{% if user_level == "beginner" %}

+わかりやすい言葉で説明してください。必要に応じて例を示してください。専門用語は避けてください。

+{% elif user_level == "intermediate" %} 一部の専門用語を使用できますが、適切な説明を付けてください。実践的なアドバイスとベストプラクティスを提供してください。

+{% else %} 技術的な詳細に踏み込み、専門用語を使用してください。高度なユースケースと最適化ソリューションに焦点を当ててください。

+{% endif %}

```

+

-## コンテキスト変数

+デフォルトでは、すべての可能な指示をモデルに送信し、条件を説明し、どれに従うかをモデルに判断させる必要がありますが、この方法は必ずしも信頼できるとは限りません。

-コンテキスト変数はソース帰属を保持しながら外部知識を注入します。これにより、大規模言語モデルがあなたの特定のドキュメントを使用して質問に答えるRAGアプリケーションが可能になります。

+Jinja2 テンプレートを使えば、定義された条件に合致する指示のみが送信されるため、動作が予測可能になり、トークンの使用量も削減されます。

-

-

-

+- 対話履歴をインポートすると、プロセス全体が見えます:ユーザーが何を質問したか、どのツールが呼び出されたか、どのような結果が返されたか、モデルがどのように推論したか。

-モデルパラメータは応答生成を制御します。**温度**は0(決定的)から1(創造的)の範囲です。**Top P**は確率によって単語選択を制限します。**頻度ペナルティ**は繰り返しを減らします。**存在ペナルティ**は新しいトピックを促進します。プリセットも使用できます:**精密**、**バランス**、**創造的**。

+**自動追加されるユーザーメッセージで新しいタスクを指定してください。** インポートされた履歴は現在のノードのメッセージの前に追加されるため、モデルはこれを1つの連続した会話として認識します。インポートされた履歴は通常アシスタントメッセージで終わるため、モデルは次に何をすべきかを知るためのフォローアップユーザーメッセージが必要です。

-## プロンプト設定

+

-インターフェースはモデルタイプに基づいて適応します。チャットモデルではメッセージロール(**システム**は動作用、**ユーザー**は入力用、**アシスタント**は例用)を使用し、補完モデルでは単純なテキスト継続を使用します。

+ 2つの LLM ノードが順番に実行されるとします:LLM A は検索ツールを呼び出してトピックを調査し、LLM B は調査結果に基づいてレポートを作成します。

-プロンプト内でワークフロー変数を二重中括弧で参照します:`{{variable_name}}`。変数はモデルに到達する前に実際の値で置き換えられます。

+ LLM B が LLM A の最終テキスト出力のみを受け取る場合、結論を要約できますが、検証や具体的なソースの引用はできません。LLM A の対話履歴をインポートすることで、LLM B は各ツール呼び出しの生データを確認し、レポートで直接参照できます。

-```text

-System: あなたは技術文書の専門家です。

-User: {{user_input}}

+ LLM A の対話履歴インポート後に LLM B が受け取る完全なメッセージシーケンス:

+

+ ```bash wrap

+ # LLM B のシステム指示

+ 1. System: "あなたはプロフェッショナルなレポートライターです..."

+

+ # LLM A から

+ 2. User: "EV 市場の新しいトレンドは何ですか?"

+

+ # LLM A から

+ 3. Tool: [URL と生データを含む検索結果]

+

+ # LLM A から

+ 4. Assistant: "検索結果に基づくと、主なトレンドは..."

+

+ # LLM B のユーザーメッセージ

+ 5. User: "500語の市場分析レポートを作成してください。"

+ ```

+

+ LLM B は次のことを理解します:調査プロセス(質問、検索、要約)を見た上で、テキスト出力だけでは得られない生データを含め、その情報に基づいてレポートを作成する必要があるということです。

+

+

+

+### Jinja2 を使った動的プロンプトの作成

+

+[Jinja2](https://jinja.palletsprojects.com/en/stable/) 構文で動的プロンプトを作成できます。例えば、条件分岐を使って変数の値に応じた指示をカスタマイズできます。

+

+

+```jinja2 wrap

+あなたは

+{% if user_level == "beginner" %}忍耐強く親切な

+{% elif user_level == "intermediate" %}プロフェッショナルで効率的な

+{% else %}シニアエキスパートレベルの

+{% endif %} アシスタントです。

+

+{% if user_level == "beginner" %}

+わかりやすい言葉で説明してください。必要に応じて例を示してください。専門用語は避けてください。

+{% elif user_level == "intermediate" %} 一部の専門用語を使用できますが、適切な説明を付けてください。実践的なアドバイスとベストプラクティスを提供してください。

+{% else %} 技術的な詳細に踏み込み、専門用語を使用してください。高度なユースケースと最適化ソリューションに焦点を当ててください。

+{% endif %}

```

+

-## コンテキスト変数

+デフォルトでは、すべての可能な指示をモデルに送信し、条件を説明し、どれに従うかをモデルに判断させる必要がありますが、この方法は必ずしも信頼できるとは限りません。

-コンテキスト変数はソース帰属を保持しながら外部知識を注入します。これにより、大規模言語モデルがあなたの特定のドキュメントを使用して質問に答えるRAGアプリケーションが可能になります。

+Jinja2 テンプレートを使えば、定義された条件に合致する指示のみが送信されるため、動作が予測可能になり、トークンの使用量も削減されます。

-

-  -

+## コンテキストの追加

-知識検索ノードの出力をLLMノードのコンテキスト入力に接続し、次のように参照します:

+**高度な設定** > **コンテキスト**で、LLM に追加の参照情報を提供し、ハルシネーションを減らしてレスポンスの精度を向上させます。

-```text

-このコンテキストのみを使用して回答してください:

-{{knowledge_retrieval.result}}

+一般的なパターン:ナレッジ検索ノードから[検索結果を渡す](/ja/use-dify/nodes/knowledge-retrieval#llm-ノードとの連携)ことで、検索拡張生成(RAG)を実現します。

-質問:{{user_question}}

-```

+## 対話メモリの有効化(チャットフローのみ)

-知識検索からのコンテキスト変数を使用する場合、Difyは自動的に引用を追跡するため、ユーザーは情報源を確認できます。

+

+ メモリはこのノード内でのみ有効です。異なる会話間では保持されません。

+

-## 構造化出力

+**メモリ**を有効にすると最近の対話が保持され、LLM がフォローアップの質問に一貫して回答できるようになります。

-プログラムで使用するために、JSONなどの特定のデータ形式での応答をモデルに強制します。3つの方法で設定できます:

+現在のユーザークエリとアップロードされたファイルを渡すためのユーザーメッセージが自動的に追加されます。これはメモリが最近のユーザー-アシスタント間のやり取りを保存することで機能するためです。ユーザークエリがユーザーメッセージを通じて渡されないと、ユーザー側で記録するものがなくなります。

-

-

- シンプルな構造のためのユーザーフレンドリーなインターフェース。名前とタイプでフィールドを追加し、必須フィールドをマークし、説明を設定します。エディターは自動的にJSONスキーマを生成します。

-

-

-

- ネストされたオブジェクト、配列、検証ルールを含む複雑な構造のためにスキーマを直接記述します。

-

- ```json

- {

- "type": "object",

- "properties": {

- "sentiment": {

- "type": "string",

- "enum": ["positive", "negative", "neutral"]

- }

- },

- "required": ["sentiment"]

- }

- ```

-

-

-

- 平易な言語でニーズを説明し、AIにスキーマを生成させます。

-

-

+**ウィンドウサイズ**は保持する最近のやり取り数を制御します。例えば `5` は、直近の5組のユーザークエリと LLM レスポンスを保持します。

-

- ネイティブJSON対応のモデルは構造化出力を確実に処理します。その他のモデルについては、Difyがプロンプトにスキーマを含めますが、結果は異なる場合があります。

-

+## Dify ツールの利用

-## メモリとファイル処理

+

+ Tool Call タグが付いたモデルのみが Dify ツールを利用できます。

-

-メモリを有効にすると、チャットフロー会話内の複数のLLM呼び出しでコンテキストを維持できます。有効にすると、以前のインタラクションがフォーマットされたユーザー - アシスタント出力として後続のプロンプトに含まれます。`USER`テンプレートを編集することで、ユーザープロンプトに入力される内容をカスタマイズできます。メモリはノード固有であり、異なる会話間では持続しません。

+

+

-

+## コンテキストの追加

-知識検索ノードの出力をLLMノードのコンテキスト入力に接続し、次のように参照します:

+**高度な設定** > **コンテキスト**で、LLM に追加の参照情報を提供し、ハルシネーションを減らしてレスポンスの精度を向上させます。

-```text

-このコンテキストのみを使用して回答してください:

-{{knowledge_retrieval.result}}

+一般的なパターン:ナレッジ検索ノードから[検索結果を渡す](/ja/use-dify/nodes/knowledge-retrieval#llm-ノードとの連携)ことで、検索拡張生成(RAG)を実現します。

-質問:{{user_question}}

-```

+## 対話メモリの有効化(チャットフローのみ)

-知識検索からのコンテキスト変数を使用する場合、Difyは自動的に引用を追跡するため、ユーザーは情報源を確認できます。

+

+ メモリはこのノード内でのみ有効です。異なる会話間では保持されません。

+

-## 構造化出力

+**メモリ**を有効にすると最近の対話が保持され、LLM がフォローアップの質問に一貫して回答できるようになります。

-プログラムで使用するために、JSONなどの特定のデータ形式での応答をモデルに強制します。3つの方法で設定できます:

+現在のユーザークエリとアップロードされたファイルを渡すためのユーザーメッセージが自動的に追加されます。これはメモリが最近のユーザー-アシスタント間のやり取りを保存することで機能するためです。ユーザークエリがユーザーメッセージを通じて渡されないと、ユーザー側で記録するものがなくなります。

-

-

- シンプルな構造のためのユーザーフレンドリーなインターフェース。名前とタイプでフィールドを追加し、必須フィールドをマークし、説明を設定します。エディターは自動的にJSONスキーマを生成します。

-

-

-

- ネストされたオブジェクト、配列、検証ルールを含む複雑な構造のためにスキーマを直接記述します。

-

- ```json

- {

- "type": "object",

- "properties": {

- "sentiment": {

- "type": "string",

- "enum": ["positive", "negative", "neutral"]

- }

- },

- "required": ["sentiment"]

- }

- ```

-

-

-

- 平易な言語でニーズを説明し、AIにスキーマを生成させます。

-

-

+**ウィンドウサイズ**は保持する最近のやり取り数を制御します。例えば `5` は、直近の5組のユーザークエリと LLM レスポンスを保持します。

-

- ネイティブJSON対応のモデルは構造化出力を確実に処理します。その他のモデルについては、Difyがプロンプトにスキーマを含めますが、結果は異なる場合があります。

-

+## Dify ツールの利用

-## メモリとファイル処理

+

+ Tool Call タグが付いたモデルのみが Dify ツールを利用できます。

-

-メモリを有効にすると、チャットフロー会話内の複数のLLM呼び出しでコンテキストを維持できます。有効にすると、以前のインタラクションがフォーマットされたユーザー - アシスタント出力として後続のプロンプトに含まれます。`USER`テンプレートを編集することで、ユーザープロンプトに入力される内容をカスタマイズできます。メモリはノード固有であり、異なる会話間では持続しません。

+

+  +

+

-**ファイル処理**では、マルチモーダルモデル用にプロンプトにファイル変数を追加します。GPT-4Vは画像を、ClaudeはPDFを直接処理しますが、他のモデルでは前処理が必要な場合があります。

+[Dify ツール](/ja/use-dify/workspace/tools)を追加して、モデルが外部サービスや API と連携できるようにします。ウェブ検索やデータベースクエリなど、リアルタイムデータやテキスト生成を超えるアクションが必要なタスクに有用です。

-### ビジョン機能設定

+追加したツールは無効化・削除でき、設定も変更できます。より明確なツール説明により、モデルがツールの使用タイミングを適切に判断できます。

-画像を処理する際、詳細レベルを制御できます:

-- **高詳細** - 複雑な画像でより良い精度を提供しますが、より多くのトークンを使用します

-- **低詳細** - シンプルな画像でより少ないトークンでより高速な処理

+**最大イテレーション回数の調整**

-ビジョン機能のデフォルト変数セレクターは`userinput.files`で、ユーザー入力ノードからファイルを自動的に取得します。

+**高度な設定**の**最大イテレーション回数**は、モデルが1つのリクエストに対して推論-行動サイクル(思考、ツール呼び出し、結果処理)を繰り返す回数を制限します。

-

-

+

+

-**ファイル処理**では、マルチモーダルモデル用にプロンプトにファイル変数を追加します。GPT-4Vは画像を、ClaudeはPDFを直接処理しますが、他のモデルでは前処理が必要な場合があります。

+[Dify ツール](/ja/use-dify/workspace/tools)を追加して、モデルが外部サービスや API と連携できるようにします。ウェブ検索やデータベースクエリなど、リアルタイムデータやテキスト生成を超えるアクションが必要なタスクに有用です。

-### ビジョン機能設定

+追加したツールは無効化・削除でき、設定も変更できます。より明確なツール説明により、モデルがツールの使用タイミングを適切に判断できます。

-画像を処理する際、詳細レベルを制御できます:

-- **高詳細** - 複雑な画像でより良い精度を提供しますが、より多くのトークンを使用します

-- **低詳細** - シンプルな画像でより少ないトークンでより高速な処理

+**最大イテレーション回数の調整**

-ビジョン機能のデフォルト変数セレクターは`userinput.files`で、ユーザー入力ノードからファイルを自動的に取得します。

+**高度な設定**の**最大イテレーション回数**は、モデルが1つのリクエストに対して推論-行動サイクル(思考、ツール呼び出し、結果処理)を繰り返す回数を制限します。

-

-  -

+複数のツール呼び出しを必要とする複雑なマルチステップタスクでは、この値を増やしてください。値が大きいほどレイテンシとトークンコストが増加します。

-## Jinja2テンプレートサポート

+## マルチモーダル入力の処理

-LLMプロンプトは高度な変数処理のためにJinja2テンプレートをサポートしています。Jinja2モード(`edition_type: "jinja2"`)を使用すると、次のことができます:

+*マルチモーダル対応*モデルに画像、音声、動画、ドキュメントを処理させるには、以下のいずれかの方法を選択します:

-```jinja2

-{% for item in search_results %}

-{{ loop.index }}. {{ item.title }}: {{ item.content }}

-{% endfor %}

-```

+ - プロンプトでファイル変数を直接参照する。

-Jinja2変数は通常の変数置換とは別に処理され、プロンプト内でループ、条件文、複雑なデータ変換が可能になります。

+ - **高度な設定**で **Vision** を有効にし、ファイル変数を選択する。

-## ストリーミング出力

+ **解像度**は画像処理の詳細レベルのみを制御します:

-LLMノードはデフォルトでストリーミング出力をサポートしています。各テキストチャンクは`RunStreamChunkEvent`として生成され、リアルタイムの応答表示が可能になります。ファイル出力(画像、ドキュメント)はストリーミング中に自動的に処理され保存されます。

+ - **高**:複雑な画像でより高精度だが、より多くのトークンを使用

-## エラーハンドリング

+ - **低**:シンプルな画像でより高速、より少ないトークンで処理

-失敗したLLM呼び出しのリトライ動作を設定します。最大リトライ回数、リトライ間隔、バックオフ乗数を設定します。リトライが十分でない場合のデフォルト値、エラールーティング、代替モデルなどのフォールバック戦略を定義します。

+## 思考プロセスとツール呼び出しをレスポンスから分離

+

+モデルの思考プロセスやツール呼び出し(もしあれば)を含まないクリーンなレスポンスを取得するには、`text` 出力変数(**推論タグ分離を有効化**をオンにした状態)または `generation.content` を参照します。

+

+`generations` 変数自体にはすべての中間ステップと最終レスポンスが含まれます。

+

+## 構造化出力の強制

+

+指示で出力形式を記述しても、一貫性のない結果が生じることがあります。より信頼性の高いフォーマットを実現するには、構造化出力を有効にして定義済みの JSON スキーマを強制します。

+

+

+ ネイティブ JSON をサポートしないモデルの場合、Dify はスキーマをプロンプトに含めますが、厳密な遵守は保証されません。

+

+

+

-

+複数のツール呼び出しを必要とする複雑なマルチステップタスクでは、この値を増やしてください。値が大きいほどレイテンシとトークンコストが増加します。

-## Jinja2テンプレートサポート

+## マルチモーダル入力の処理

-LLMプロンプトは高度な変数処理のためにJinja2テンプレートをサポートしています。Jinja2モード(`edition_type: "jinja2"`)を使用すると、次のことができます:

+*マルチモーダル対応*モデルに画像、音声、動画、ドキュメントを処理させるには、以下のいずれかの方法を選択します:

-```jinja2

-{% for item in search_results %}

-{{ loop.index }}. {{ item.title }}: {{ item.content }}

-{% endfor %}

-```

+ - プロンプトでファイル変数を直接参照する。

-Jinja2変数は通常の変数置換とは別に処理され、プロンプト内でループ、条件文、複雑なデータ変換が可能になります。

+ - **高度な設定**で **Vision** を有効にし、ファイル変数を選択する。